十分抱歉,由于项目太忙(我会说自己懒吗?)柳猫一直没有更新自己的手记,现在,就让柳猫来讲讲十个常用的深度学习算法。

过去十年里,人们对机器学习的兴趣经历了爆炸式的整长。我们几乎每天都可以在计算机程序、行业会议和媒体上看到机器学习的身影。很多关于机器学习的讨论都混淆了“机器学习能做什么”和“人类希望机器学习能做什么”。从根本上讲,机器学习是运用算法从原始数据中提取信息,并用某种类型的模型进行表示,然后使用该模型对一些尚未用模型表示的其他数据来进行推断。

神经网络就是机器学习各类模型中的其中一类,并且已经存在了至少50年。神经网络的基本单位是节点,它的想法大致来源于哺乳动物大脑中的生物神经元。生物大脑中的神经元节点之间的链接是随着时间推移不断演化的,而神经网络中的神经元节点链接也借鉴了这一点,会不断演化(通过“训练”的方式)。

神经网络中很多重要框架的建立和改进都完成于二十世纪八十年代中期和九十年代初期。然而,要想获得较好结果需要大量的时间和数据,由于当时计算机的能力有限,神经网络的发展受到了一定的阻碍,人们的关注度也随之下降。二十一世纪初期,计算机的运算能力呈指数级增长,业界也见证了计算机技术发展的“寒武纪爆炸”——这在之前都是无法想象的。深度学习以一个竞争者的姿态出现,在计算能力爆炸式增长的十年里脱颖而出,并且赢得了许多重要的机器学习竞赛。其热度在2017年仍然不减。如今,在机器学习的出现的地方我们都能看到深度学习的身影。

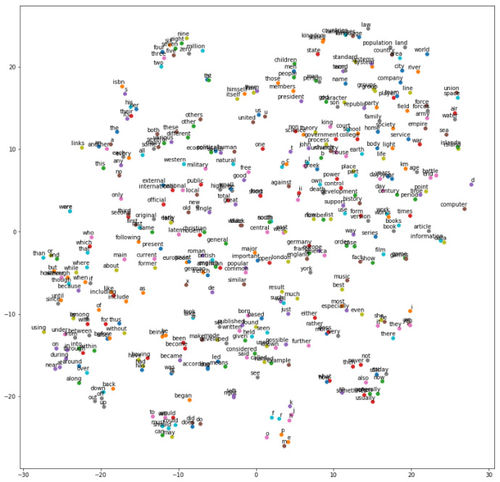

这是柳猫自己做的一个小例子,词向量的 t-SNE 投影,通过相似性进行聚类。

最近,我开始阅读关于深度学习的学术论文。根据我的个人研究,以下文章对这个领域的发展产生了巨大的影响:

-

1998年NYU的文章《基于梯度学习的文档识别》(Gradient-Based Learning Applied to Document Recognition) 介绍了卷积神经网络在机器学习中的应用。

-

Toronto 2009年的文章《深度波兹曼机器》(Deep Boltzmann Machines) 针对波兹曼机提出了一种新的学习算法,其中包含许多隐藏层。

-

Stanford 和 Google 2012年联合发表的文章《使用大规模非监督学习构建高层特征》(Building High-Level Features Using Large-Scale Unsupervised Learning) 解决了仅利用未标记的数据构建高级、特定类的特征检测器的问题。

-

Berkeley 2013年的文章《用于一般视觉识别的深层卷积激活特征》(DeCAF——A Deep Convolutional Activation Feature for Generic Visual Recognition) 发布了名为 DeCAF 的算法,这是深度卷积激活特征的一个开源实现,使用相关的网络参数,视觉研究人员能够利用一系列视觉概念学习范例进行深入实验。

-

DeepMind 2016年的文章《用深度强化学习玩Atari》(Playing Atari with Deep Reinforcement Learning) 提出了第一个可以成功地通过强化学习从高维感官输入中直接学习控制策略的深度学习模型。

柳猫整理了人工智能工程师 10 个用于解决机器学习问题的强大的深度学习方法。但是,我们首先需要定义什么是深度学习。

如何定义深度学习是很多

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2135

2135

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?