本文由码农场同步,最新版本请查看原文:http://www.hankcs.com/ml/sgd-cnn.html

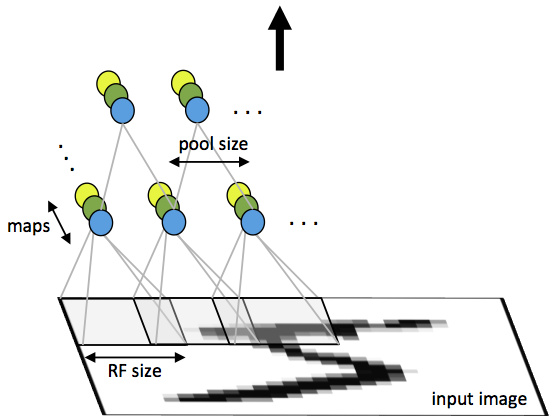

斯坦福UFLDL中CNN剩下两章的笔记,辅以两次编程练习,至此完成了CNN的学习。梯度下降概述诸如L-BFGS之类的批优化方法每次更新都使用整个训练集,能够收敛到局部最优。因为要设置的超参数很少,所以很好用,matlab里也有许多类似minFunc之类开箱即用的实现。但实践中计算整个训练集的损失函数和梯度是很慢的,极端情况下甚至无法把整个数据集装进单机内存里。批优化的另一个短处是无法在线处理新数据。随机梯度下降( $SGD$ )解决了这两个问题,在跑了单个或者少量的训练样本后,便可沿着目标函数的负梯度更新参...

继续阅读:码农场 » 随机梯度下降与卷积神经网络

原文链接:http://www.hankcs.com/ml/sgd-cnn.html

3044

3044

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?