简介:本文介绍了如何通过组合Tomcat应用服务器、Apache HTTP服务器和Memcached缓存系统,构建一个高性能、可扩展的Web应用集群。涉及各个组件的介绍,集群配置步骤,以及必要的部署和维护建议,以提升Web应用的性能和可靠性。

1. Tomcat应用服务器介绍

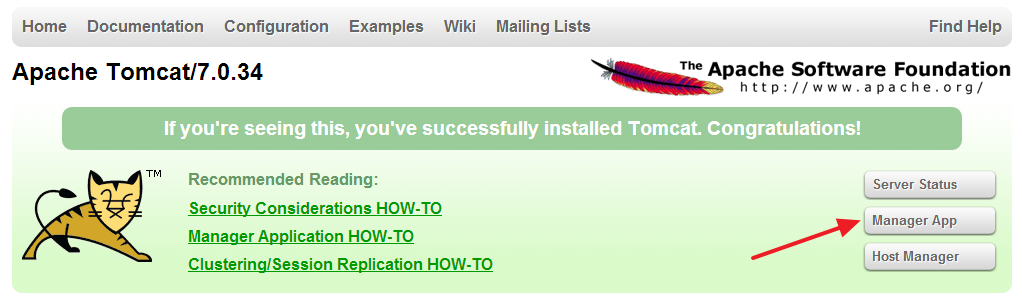

在企业级应用中,Apache Tomcat(简称Tomcat)是Java开发者最熟悉不过的开源应用服务器。Tomcat不仅作为Servlet容器,支持Java Servlet和JavaServer Pages(JSP)的运行,而且它也是Apache基金会JServe的一个重要子项目。它作为一个轻量级的Web服务器,被广泛应用于Java Web应用的部署和运行。

1.1 Tomcat的核心功能与架构

Tomcat的核心功能包括管理Java Web应用的生命周期、提供请求处理和响应机制以及实现安全控制。从架构角度看,Tomcat主要由连接器(Connector)和容器(Container)两大部分组成。连接器负责监听端口,接收客户端的请求并将其转发至容器;容器负责创建、管理和销毁Servlet实例,并处理业务逻辑。

1.2 Tomcat与Java EE的关系

尽管Tomcat本身是围绕Servlet技术构建的,但它也能支持部分Java EE(Java Platform, Enterprise Edition)规范。例如,Tomcat可以作为JavaServer Faces(JSF)和JAX-RS(Java API for RESTful Web Services)等技术的运行环境。不过,对于更复杂的企业级应用,开发者可能会选择更全面的Java EE应用服务器,如JBoss或WebLogic等。总的来说,Tomcat是Java Web应用开发和小型部署的理想选择,兼具易用性和高效率。

2. Apache作为反向代理和负载均衡器的配置

2.1 Apache的基本配置和功能

2.1.1 Apache服务器的安装与启动

Apache服务器的安装过程通常较为直接,用户可以通过包管理器快速安装,例如在Linux系统中,常用的命令是 sudo apt-get install apache2 或者 sudo yum install httpd ,取决于所使用的Linux发行版。安装完成后,可以通过运行 sudo systemctl start apache2 或 sudo service httpd start 来启动Apache服务器。

2.1.2 Apache的基本配置选项

Apache的核心配置文件位于 /etc/apache2 (Debian/Ubuntu系统)或 /etc/httpd/conf (Red Hat/CentOS系统)目录下,最常用的配置文件是 httpd.conf 或 apache2.conf 。在这些配置文件中,可以通过更改 ServerName 指令来设置服务器的名称,通过 ServerAdmin 设置管理员的邮件地址,并且可以配置 DocumentRoot 来指定服务器根目录,即网页文件存放的位置。

# 示例Apache配置片段

ServerName ***

*** "/var/www/html"

在配置文件中,还有一系列指令可以控制访问权限、日志记录、性能优化以及安全设置等。每个指令的详细解释和用途,可以在Apache官方文档中找到详细说明。

2.2 Apache反向代理的配置

2.2.1 反向代理的工作原理

反向代理是部署在服务器端的代理服务器,它接收外部的HTTP请求,然后将这些请求转发到内部服务器,再将内部服务器的响应返回给客户端。反向代理的主要作用包括负载均衡、缓存静态内容、提供安全防护等。

2.2.2 反向代理的配置示例

为了配置Apache作为反向代理,需要在Apache的配置文件中启用 mod_proxy 模块,并使用 ProxyPass 和 ProxyPassReverse 指令。以下是一个配置示例,它将客户端请求从根路径 / 转发到后端应用服务器,地址为 *** 。

LoadModule proxy_module modules/mod_proxy.so

LoadModule proxy_ajp_module modules/mod_proxy_ajp.so

LoadModule proxy_http_module modules/mod_proxy_http.so

ProxyPass / ajp://***.*.*.*:8080/

ProxyPassReverse / ajp://***.*.*.*:8080/

上述配置中, ProxyPass 指令定义了请求转发的规则,而 ProxyPassReverse 用于确保重定向和URL改写时的正确性。

2.3 Apache负载均衡器的配置

2.3.1 负载均衡的概念与重要性

负载均衡是指将工作负载(如HTTP请求)分发到多个服务器的处理过程,目的是提高系统的处理能力、可靠性和可用性。负载均衡器可以是硬件设备,也可以是软件解决方案,Apache HTTP Server通过 mod_proxy 模块提供了简单的负载均衡功能。

2.3.2 负载均衡的实现方式和配置技巧

Apache通过 mod_proxy 模块的 Proxy 指令和其子指令 ProxyPass 来实现负载均衡。一种常见的配置是使用轮询(Round-Robin)机制,该机制会按顺序将每个新的请求分配给下一个服务器。

ProxyPass / balancer://mycluster/

<Proxy balancer://mycluster>

BalancerMember ***

***

* 更多后端服务器可以按照上面的格式添加

</Proxy>

上述配置定义了一个负载均衡集群 mycluster ,包含两个后端服务器。 BalancerMember 指令将请求依次分配给这些服务器。Apache还提供了其他负载均衡算法,如基于权重的分配和基于性能的分配。

Apache服务器可以通过简单的配置实现反向代理和负载均衡的功能,但要注意,这仅仅适用于小型到中等规模的部署。对于大型、高并发的环境,专业的硬件或软件负载均衡解决方案将更可靠且更具可扩展性。

3. Memcached的分布式内存缓存机制

3.1 Memcached缓存系统的概述

3.1.1 Memcached的工作原理

Memcached 是一个高性能的分布式内存对象缓存系统,用于在动态应用中减少数据库负载,加速动态Web应用。其核心思想是通过缓存数据库查询结果减少数据库访问次数,从而提升应用性能。

在Memcached中,缓存的数据被存储在内存中,通常是以键值对的形式存在。当应用需要访问数据时,它会先查询Memcached。如果数据存在(称为“命中”),则直接返回这些数据;如果不存在(称为“未命中”),则需要从数据库加载数据,然后将数据存储在Memcached中以便下次访问。

Memcached通过简单的内存管理机制,比如LRU(最近最少使用)算法,自动地回收内存空间,保证了高可用性和高性能。尽管Memcached是内存中的存储系统,但它的优势是快速、简单,能够适应大规模数据的存储和检索。

3.1.2 Memcached的基本术语

- Item :指缓存中的一个数据项,每个item都有一个唯一的key以及对应的value。

- Key :用于访问item的字符串标识符。在设计key时,需要确保它们是唯一的。

- Value :缓存的值,可以是任何类型的数据,如字符串、数字等。

- Slab :Memcached使用slab分配器来管理内存,将内存分割成大小不一的块,每个slab用于存储相同大小的数据项。

- Server :运行Memcached服务的服务器。

- Client :使用Memcached的客户端程序,负责数据存取操作。

3.2 Memcached的安装与配置

3.2.1 Memcached服务器的安装步骤

安装Memcached通常非常直接,以下是基于Linux系统的安装步骤:

- 下载Memcached源代码包。

- 解压源代码包并进入目录。

- 使用

./configure、make和make install进行编译安装。 - 验证安装是否成功。

以下是安装命令的示例:

# 安装依赖

sudo apt-get install libevent-dev

# 下载并解压

wget ***

* 编译安装

cd memcached-1.6.9

./configure

make

sudo make install

# 验证安装

memcached -h

3.2.2 Memcached配置参数详解

Memcached使用配置文件来定制启动参数,但是也可以在命令行中直接指定。配置参数包括监听地址、端口、最大连接数、内存使用大小等。以下是几个关键参数:

-

-m <bytes>:限制使用的最大内存量,单位是MB。 -

-u <username>:以指定的用户身份运行Memcached。 -

-p <num>:设置Memcached监听的TCP端口。 -

-P <file>:指定pid文件的路径,用于保存Memcached的进程ID。 -

-l <ip_addr>:绑定的监听地址,可以是IP或域名。

可以通过命令行启动Memcached,并设置这些参数:

memcached -p 11211 -m 512 -u nobody

这里,我们设置了监听端口为11211,最大内存为512MB,并使用nobody用户来运行Memcached。

3.3 Memcached的高级功能和实践

3.3.1 数据过期策略和内存管理

Memcached通过设置数据项的过期时间来管理数据生命周期。每个数据项都有一个过期时间(time to live, TTL),一旦时间到达,该数据项就会被自动删除。

- TTL设置 :可以在存储数据项时,通过

-e选项设置TTL值。单位是秒。例如:set key1 0 900 10表示设置key1的TTL为900秒。 - 内存溢出策略 :当超出最大内存限制时,Memcached根据LRU策略自动移除最不常访问的数据项。

可以通过客户端对数据项设置过期时间,确保缓存数据的有效性和及时性。

3.3.2 分布式缓存的实际应用案例

在实际应用中,将Memcached用于缓存数据库查询结果,或存储会话信息等,可以显著提高应用的响应速度。以下是一个分布式缓存实践案例:

- 应用场景 :用户信息的存储和检索。使用Memcached缓存用户信息,避免每次访问都查询数据库。

- 步骤 :

- 当应用收到用户请求,首先检查Memcached中是否有用户信息。

- 如果命中,则直接返回用户信息。

- 如果未命中,则从数据库查询用户信息,并存入Memcached,然后返回给用户。

- 代码实现 :

def get_user(user_id):

client = memcache.Client(['***.*.*.*:11211'], debug=0)

user = client.get('user:%s' % user_id) # 尝试从缓存中获取数据

if user is None:

user = database.query('SELECT * FROM users WHERE id = %s' % user_id) # 查询数据库

client.set('user:%s' % user_id, user, 3600) # 将数据存储到缓存中,并设置1小时后过期

return user

在这个例子中,使用Python的memcache客户端库从Memcached中获取用户信息。如果缓存未命中,将从数据库中查询,并把结果存储到Memcached中。这种方法可以大大减少数据库负载,并提高用户请求的响应速度。

以上就是对Memcached分布式内存缓存机制的详细介绍。在接下来的章节中,我们将探讨在集群环境中如何实现负载均衡策略。

4. 集群环境下的负载均衡策略实施

在现代化的IT基础设施中,负载均衡是优化应用性能和保障高可用性不可或缺的一环。它能够将进入的网络流量有效地分配到多台服务器上,从而提高系统的处理能力,确保服务的稳定性和可扩展性。本章将深入探讨负载均衡的策略和算法,并以Apache与Tomcat整合为例,讲解如何实施负载均衡策略。

4.1 负载均衡的策略和算法

负载均衡策略的实施主要涉及算法的选择,这些算法决定了如何将流量分配到后端服务器。一个合适的算法能够带来更为均衡的负载分配,减少单点故障的风险。

4.1.1 负载均衡算法的选择与对比

在众多的负载均衡算法中,最为常见的包括轮询(Round Robin)、最小连接(Least Connections)、加权轮询(Weighted Round Robin)和基于IP哈希(IP Hash)的策略。

- 轮询算法 :简单而公平,每次将请求分配给下一台服务器。但它不考虑服务器的实时负载状态。

- 最小连接算法 :优先将新的请求发送到当前活动连接数最少的服务器上,适合处理时间差异较大的情况。

- 加权轮询算法 :对服务器分配权重,按照权重比例来分配请求,适用于服务器处理能力不均的情况。

- 基于IP哈希的算法 :利用客户端的IP地址计算哈希值,相同IP的请求将总是路由到同一台服务器,适用于会话保持。

每种算法有其适用场景,对于集群环境,选择合适的算法显得尤为重要。例如,如果应用服务状态保持短暂,且无状态化良好,轮询或加权轮询可能是优选;如果应用依赖于用户会话,那么IP哈希策略更为合适。

4.1.2 集群中的会话持久性问题

在多服务器环境中,会话持久性是一个需要特别注意的问题。如果用户与系统的交互跨越多个请求,那么需要保证这些请求被分配到同一台服务器上处理。这通常是通过会话粘滞性(Session Stickiness)来实现的。

实现会话粘滞性的方法之一是使用基于IP哈希的负载均衡算法。这种方法能够确保来自同一IP地址的请求总是被路由到相同的服务器上。然而,这种方法的一个缺点是如果服务器宕机,那么所有来自该IP的请求可能会丢失。

另外一种方法是通过外部存储,如Redis或Memcached,来存储会话数据。这样,不管请求被分配到哪台服务器,都可以从共享的存储中检索到用户的会话信息。这种方法的好处是提高了系统的可扩展性和容错性,但增加了系统的复杂性。

4.2 Apache与Tomcat的整合

Apache和Tomcat的整合是实现负载均衡的一个常见方式。整合后,Apache负责接收客户端的请求,然后通过配置好的负载均衡策略将请求转发给Tomcat服务器集群进行处理。

4.2.1 配置Apache与Tomcat整合实现负载均衡

要实现Apache与Tomcat的整合,首先需要安装并配置Apache HTTP Server,并启用mod_proxy和mod_proxy_http模块。以下是配置步骤的简要概述:

-

安装Apache HTTP Server,并启用必要的模块:

bash sudo apt-get install apache2 sudo a2enmod proxy proxy_http -

编辑Apache配置文件(通常是httpd.conf或apache2.conf),添加虚拟主机配置来实现负载均衡:

apache <VirtualHost *:80> *** ProxyPreserveHost On ProxyPass / ***集群IP:端口/ ProxyPassReverse / ***集群IP:端口/ </VirtualHost>在这段配置中,tomcat集群IP:端口应替换为实际的Tomcat服务器地址和端口。 -

重启Apache服务以使配置生效:

bash sudo systemctl restart apache2

4.2.2 调整和优化整合方案的性能

整合方案实施后,需要进行调整和优化以满足具体的性能需求。这包括但不限于:

- 监控 :利用监控工具(如Apache的mod_status模块或第三方工具)持续监控服务器的健康状况和性能指标。

- 日志分析 :定期分析Apache和Tomcat的日志,以识别可能的性能瓶颈或配置问题。

- 连接池优化 :根据应用的访问模式调整Tomcat的连接池大小,以减少响应时间和提高吞吐量。

- 缓存策略 :通过Apache和Tomcat的缓存机制,如mod_cache,减少后端服务器的请求压力。

通过这些优化措施,可以确保负载均衡实施后的集群环境能够高效稳定地运行。

5. 多节点Memcached集群的设置与维护

Memcached作为一个高性能的分布式内存对象缓存系统,广泛应用于减轻数据库负载、提升动态Web应用性能的场景。在多节点的环境下,它能通过增加节点的方式线性提升整个集群的缓存容量和处理能力。本章节将介绍如何设置和维护一个多节点的Memcached集群。

5.1 Memcached集群的搭建

5.1.1 配置多个Memcached实例

搭建Memcached集群的第一步是配置多个Memcached实例。每个实例都将运行在不同的服务器或不同的端口上,以便于区分并独立管理。

memcached -d -m 256 -u memcached -p 11211 -l ***.*.*.*

memcached -d -m 256 -u memcached -p 11212 -l ***.*.*.*

memcached -d -m 256 -u memcached -p 11213 -l ***.*.*.*

上述命令启动了三个Memcached实例,分别监听在不同的端口上。其中 -d 参数表示后台运行, -m 参数指定内存分配给Memcached的大小, -u 参数指定运行Memcached的用户, -p 参数指定监听端口, -l 参数指定绑定的IP地址。

5.1.2 使用一致性哈希来实现数据分布

为了在多个Memcached节点之间有效地分布数据,通常采用一致性哈希(Consistent Hashing)算法。一致性哈希可以在增加或删除节点时最小化数据的迁移。

# 示例代码,使用libketama一致性哈希算法的Python客户端

from libketama import KetamaServer

from libketama import KetamaClient

servers = [KetamaServer('***.*.*.*', 11211),

KetamaServer('***.*.*.*', 11212),

KetamaServer('***.*.*.*', 11213)]

client = KetamaClient(servers)

上述Python代码创建了一个客户端,利用libketama库实现了一致性哈希的算法,将数据均匀地分发到三个Memcached实例中。在实际部署时,这些服务器地址和端口应替换为实际运行的节点。

5.2 Memcached集群的监控与维护

5.2.1 监控工具和性能指标

为了保证Memcached集群的稳定运行,必须定期对其进行监控。常用的监控工具有 memcached-tool 、 stats.py 以及 nagios 等,它们可以提供集群的性能指标,如命中率、内存使用率、连接数等。

# 使用memcache-tool获取统计信息

memcache-tool ***.*.*.*:11211 stats

通过上述命令行指令可以获取Memcached实例的统计信息。这些数据对于评估集群性能、监控缓存命中率和及时发现性能瓶颈至关重要。

5.2.2 故障诊断和集群的扩展策略

当Memcached集群中某个节点出现故障时,集群应当能够继续提供服务,同时应尽快诊断故障原因并恢复服务。此外,随着应用负载的增长,可能需要增加更多的节点以扩展集群。

graph LR

A[开始诊断] --> B[检查Memcached状态]

B --> C[查看服务器资源]

C -->|资源耗尽| D[优化资源使用]

C -->|无资源问题| E[检查网络连接]

E -->|网络问题| F[修复网络故障]

E -->|网络正常| G[重启服务或实例]

F --> H[结束诊断]

G --> H

D --> H

上图描述了故障诊断的流程,它帮助管理员快速定位问题所在并采取相应措施。对于集群的扩展策略,通常需要考虑整体的缓存容量需求、系统负载和数据分布策略,从而合理地添加节点并重新分配数据。

多节点Memcached集群的设置与维护不仅涉及基础配置,还包括对集群性能的持续监控和优化。通过本章节的介绍,读者应该能够理解并掌握如何搭建和维护一个稳定、高效的Memcached集群。

简介:本文介绍了如何通过组合Tomcat应用服务器、Apache HTTP服务器和Memcached缓存系统,构建一个高性能、可扩展的Web应用集群。涉及各个组件的介绍,集群配置步骤,以及必要的部署和维护建议,以提升Web应用的性能和可靠性。

1590

1590

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?