简介:遗传算法和模拟退火是两种有效的全局优化技术,能解决诸如作业车间调度这类复杂的非线性和组合优化问题。在Python中实现这两种算法并应用于JSP,需考虑问题建模、编码策略、约束条件,并利用科学计算库进行算法框架和优化技巧的编写。通过对比不同算法结果,评估性能与稳定性,为生产调度提供智能解决方案。

1. 作业车间调度问题(JSP)介绍

1.1 JSP的定义和重要性

作业车间调度问题(Job Shop Scheduling Problem, JSP)是工业工程和运营管理中的一个经典优化问题,它要求在一系列作业中,按照特定的约束条件,合理安排每项作业在各个机器上的加工顺序和时间,以达到某种优化目标,例如最小化完工时间或最大化生产效率。

1.2 JSP问题的分类

JSP问题可根据其约束条件和优化目标的不同进行分类。常见的分类包括:静态与动态调度、单一目标与多目标优化、确定性与不确定性作业环境。针对这些分类,研究者们提出了多种模型和算法来解决JSP问题,其中包括启发式算法、数学规划方法和智能优化算法等。

1.3 JSP的现实应用场景

JSP的现实应用场景广泛,从传统的制造工厂到现代的服务行业都有其身影。例如,在汽车制造工厂中,通过优化调度可以减少生产周期、提高机器利用率;在医院中,合理安排手术室和医生的时间可以提高服务质量和患者满意度。JSP不仅是理论研究的重要对象,也是企业在提高竞争力时必须解决的实际问题。

JSP问题的复杂性和其在各行各业的应用价值,使其成为人工智能、运筹学和计算机科学等多领域交叉研究的热点,对于推动工业自动化和管理科学的发展具有重要的意义。

2. 遗传算法(GA)与模拟退火(SA)原理与应用

2.1 遗传算法的基本概念和工作流程

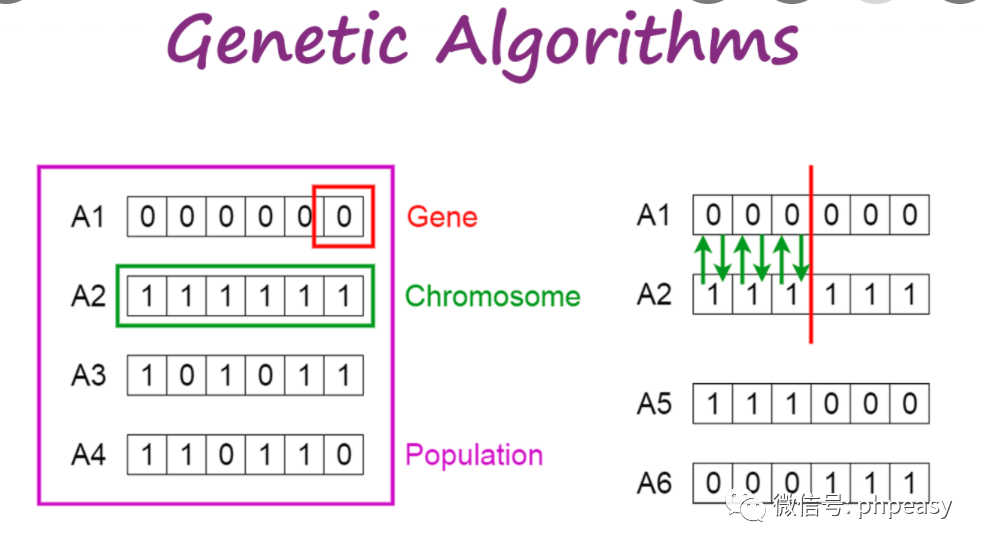

遗传算法是受达尔文进化论中自然选择和遗传学原理启发的一类搜索算法。它通过模拟自然进化的过程,随机生成一组候选解,并依据适应度对它们进行选择和优化。遗传算法是优化和搜索问题的重要工具,尤其适用于解决那些传统算法难以处理的复杂问题。

2.1.1 遗传算法的起源与发展

遗传算法由美国学者John Holland在上世纪70年代初期提出,随后得到了广泛关注和发展。Holland和其同事以及学生在密歇根大学展开了对遗传算法的深入研究,为算法的理论基础和应用推广奠定了坚实的基础。

随着时间的推移,遗传算法逐渐被应用到多个领域,包括但不限于机器学习、工程优化、调度、经济学等。算法本身也经历了一系列的改进和创新,如引入多种群遗传算法、改进选择机制等,以适应更复杂的优化问题。

2.1.2 遗传算法的关键操作与实现步骤

遗传算法主要包含选择(Selection)、交叉(Crossover)和变异(Mutation)三个基本操作,它们是算法中实现种群进化的核心环节。实现步骤通常包括以下几个阶段:

- 初始化:随机生成初始种群。

- 适应度评估:对种群中的每个个体进行适应度评估。

- 选择:根据个体的适应度,按照一定的规则选择优秀个体进入下一代。

- 交叉:将选中的个体配对并交换部分基因,产生新的个体。

- 变异:以一定的概率改变个体的某些基因,以增加种群的多样性。

- 终止条件判断:如果达到预设的迭代次数或适应度满足要求,则终止算法。

遗传算法的关键在于如何设计这三个操作,以使算法能够有效地收敛至最优解。

# 示例代码:简单遗传算法的Python实现

import numpy as np

# 适应度函数示例

def fitness_function(individual):

# 这里使用一个简单的适应度函数:个体中1的数量

return np.sum(individual == 1)

# 初始化种群

def initialize_population(size, gene_length):

return np.random.randint(2, size=(size, gene_length))

# 选择操作

def selection(population, fitness_scores):

# 轮盘赌选择法

# 首先计算适应度比例

fitness_proportion = fitness_scores / np.sum(fitness_scores)

# 计算累积概率

cumulative_prob = np.cumsum(fitness_proportion)

# 初始化选出的个体

selected_population = np.zeros_like(population)

for i in range(len(population)):

r = np.random.rand()

for j in range(len(cumulative_prob)):

if r <= cumulative_prob[j]:

selected_population[i] = population[j]

break

return selected_population

# 交叉操作

def crossover(parent1, parent2):

# 单点交叉

crossover_point = np.random.randint(1, len(parent1))

child1 = np.concatenate((parent1[:crossover_point], parent2[crossover_point:]))

child2 = np.concatenate((parent2[:crossover_point], parent1[crossover_point:]))

return child1, child2

# 变异操作

def mutation(individual):

# 基因突变

mutation_point = np.random.randint(len(individual))

individual[mutation_point] = 1 - individual[mutation_point]

return individual

# 算法参数设置

population_size = 100

gene_length = 10

generations = 50

# 算法执行

population = initialize_population(population_size, gene_length)

for gen in range(generations):

fitness_scores = np.array([fitness_function(ind) for ind in population])

population = selection(population, fitness_scores)

population_next = []

for i in range(0, population_size, 2):

parent1, parent2 = population[i], population[i+1]

child1, child2 = crossover(parent1, parent2)

population_next.extend([child1, child2])

population = np.array(population_next)

# 输出结果

best_individual = population[np.argmax(fitness_scores)]

print("Best Individual: ", best_individual)

print("Best Fitness: ", np.max(fitness_scores))

在上述代码中,我们首先定义了一个简单的适应度函数,然后初始化种群,并通过选择、交叉和变异操作进行遗传算法的基本流程。每一代都会选出适应度最高的个体作为下一代的候选者。经过一定的迭代次数后,我们找到了适应度最高的个体。

3. 遗传算法的编码、选择、交叉和变异策略

3.1 遗传算法的编码方式

3.1.1 二进制编码与实数编码的适用场景

遗传算法作为启发式搜索算法的一种,编码是其构建解空间的基础。在遗传算法中,二进制编码是最常见且广泛使用的编码方式。这种方法将问题的每个参数或决策变量转换为二进制形式,便于进行交叉和变异操作。然而,在一些问题上,如连续参数优化问题,二进制编码可能不够直观且操作复杂。

实数编码是二进制编码的补充,它直接用参数的实际值作为编码,因此更加直观且易于理解和操作。实数编码在处理连续空间优化问题时表现得更为高效,因为它可以直接在解的参数上进行操作,而不需要繁琐的二进制到实数的转换过程。

3.1.2 编码策略对算法性能的影响

不同的编码策略对遗传算法的搜索效率和解的质量有着重要影响。二进制编码因为其离散性,更适合于离散问题和组合优化问题。实数编码则更适合于参数优化问题,它能够提供更平滑的搜索空间,从而有可能找到更加精确的解。

在选择编码策略时,需要根据实际问题的特性来决定。如果问题具有连续的解空间,实数编码通常会是更好的选择。如果问题具有离散的特征,那么二进制编码可能更为合适。在某些情况下,结合使用两种编码策略能够提供更好的搜索能力。

# 示例:二进制编码与实数编码的简单对比

import numpy as np

# 假设有一个参数优化问题,参数范围是[0, 10]

# 使用二进制编码

binary_representation_length = 10

decimal_number = np.random.randint(0, 2**binary_representation_length)

binary_string = bin(decimal_number)[2:].zfill(binary_representation_length)

# 使用实数编码

real_number_representation = np.random.uniform(0, 10)

print("二进制编码: ", binary_string)

print("实数编码: ", real_number_representation)

表格:编码方式对比

| 特性 | 二进制编码 | 实数编码 | |----------------------|---------|---------| | 适用问题类型 | 离散问题和组合优化 | 连续参数优化 | | 解空间平滑度 | 低 | 高 | | 编码长度 | 取决于问题规模 | 通常较短 | | 转换过程 | 需要转换 | 直接使用 | | 优化精度 | 较低 | 较高 | | 实现复杂度 | 较低 | 较高 |

3.2 遗传算法的选择机制

3.2.1 轮盘赌选择、锦标赛选择等常见方法

选择机制在遗传算法中起到决定下一代种群的作用。轮盘赌选择和锦标赛选择是两种最常用的策略。轮盘赌选择根据个体的适应度占总适应度的比例来决定其被选中的概率。这种方法简单易实现,但可能导致高适应度个体过度占据优势,从而导致种群多样性的丧失。

锦标赛选择通过随机选择一定数量的个体进行“锦标赛”,再选出其中最适应的个体。这种方法能够较好地平衡选择压力和保持种群多样性。锦标赛大小的选择对算法性能有很大影响,较大的锦标赛可能会导致选择压力增大,而较小的锦标赛则可能导致遗传算法过早收敛。

3.2.2 选择机制对种群多样性的维护

种群多样性是遗传算法避免早熟收敛的关键。选择机制不仅需要考虑适应度高的个体,还需要考虑维持种群多样性,以促进算法探索新的解空间。一些改进的选择机制,如拥挤距离选择和精英保留策略,被引入以更好地维护种群多样性。

拥挤距离选择考虑了个体在解空间中的分布情况,倾向于选择那些处于拥挤区域的个体,从而促使种群分散开来。精英保留策略则是保证每一代中适应度最高的几个个体能够遗传到下一代,确保优秀基因的传递。

# 示例:轮盘赌选择和锦标赛选择的简单实现

# 轮盘赌选择

def roulette_wheel_selection(fitness_list):

total_fitness = sum(fitness_list)

probability = [f / total_fitness for f in fitness_list]

selected_index = np.random.choice(len(fitness_list), p=probability)

return selected_index

# 锦标赛选择

def tournament_selection(fitness_list, tournament_size=2):

participants = np.random.choice(len(fitness_list), tournament_size, replace=False)

winner = participants[np.argmax([fitness_list[i] for i in participants])]

return winner

fitness_list = np.random.rand(10) # 假设的适应度列表

print("轮盘赌选择结果: ", roulette_wheel_selection(fitness_list))

print("锦标赛选择结果: ", tournament_selection(fitness_list))

3.3 遗传算法的交叉与变异操作

3.3.1 单点交叉、多点交叉与均匀交叉的对比

交叉是遗传算法中产生新个体的重要手段,它的目的是结合两个父代个体的特征,产生包含新特征的子代个体。单点交叉、多点交叉和均匀交叉是三种基本的交叉策略。

单点交叉通过随机选择一个交叉点,并交换该点两侧的基因片段来生成子代。这种方法操作简单,但可能丢失父代中某些有利的基因组合。

多点交叉通过选择两个以上的交叉点,能够生成更加多样化的子代,但也可能增加算法的随机性,降低收敛速度。

均匀交叉则是在父代的每个基因位点上进行交叉,相当于每个基因位点都有可能来自两个父代中的任何一个,这种方法能够增加遗传的多样性。

3.3.2 变异率的设定与变异操作的多样性

变异操作是遗传算法中用于维持和引入种群多样性的手段。变异率的设定对算法的探索能力和收敛速度有着重要影响。过高的变异率可能导致算法表现得过于随机,而过低的变异率则可能导致算法陷入局部最优解。

变异操作的多样性体现在不同的变异策略上,如翻转变异、交换变异、均匀变异等。翻转变异适用于二进制编码,而交换变异适用于排列编码。均匀变异则允许基因位点取值范围内的任何值,适用于实数编码。

# 示例:单点交叉、多点交叉和均匀交叉的简单实现

# 单点交叉

def single_point_crossover(parent1, parent2):

crossover_point = np.random.randint(1, len(parent1)-1)

child1 = np.concatenate((parent1[:crossover_point], parent2[crossover_point:]))

child2 = np.concatenate((parent2[:crossover_point], parent1[crossover_point:]))

return child1, child2

# 多点交叉

def multi_point_crossover(parent1, parent2, num_points=2):

points = np.random.choice(len(parent1), num_points, replace=False)

points.sort()

child1, child2 = [], []

start, end = 0, 0

for point in points:

child1 += parent1[start:point]

child2 += parent2[start:point]

start = point

child1 += parent1[end:]

child2 += parent2[end:]

return np.array(child1), np.array(child2)

# 均匀交叉

def uniform_crossover(parent1, parent2):

child1, child2 = [], []

for gene1, gene2 in zip(parent1, parent2):

if np.random.rand() < 0.5:

child1.append(gene1)

child2.append(gene2)

else:

child1.append(gene2)

child2.append(gene1)

return np.array(child1), np.array(child2)

# 示例用的父代个体

parent1, parent2 = np.array([1, 0, 1, 0]), np.array([0, 1, 0, 1])

print("单点交叉结果: ", single_point_crossover(parent1, parent2))

print("多点交叉结果: ", multi_point_crossover(parent1, parent2))

print("均匀交叉结果: ", uniform_crossover(parent1, parent2))

在本章节中,我们详细介绍了遗传算法中编码策略、选择机制、交叉与变异操作的原理和实现方法。通过对比不同策略的适用场景和优缺点,我们可以针对具体问题选择最合适的遗传算法组件,以期达到更好的搜索效果和解的质量。下文将继续探讨模拟退火算法的温度设定、冷却策略及接受准则设计,为理解与实现遗传算法与模拟退火算法提供更全面的视角。

4. 模拟退火的温度、冷却策略和接受准则

模拟退火算法(Simulated Annealing, SA)是一种通用概率算法,用于在给定一个大的搜寻空间内寻找足够好的解。它是受物理退火过程启发而设计的优化算法,在众多领域被广泛应用,包括电子设计自动化、电路设计、以及生产调度等领域。本章将详细介绍模拟退火算法的核心要素:温度的设定与控制、冷却策略的设计,以及接受准则的实现与调整。

4.1 模拟退火的温度设置与控制

模拟退火算法的温度参数起着至关重要的作用。它直接影响着算法的探索能力和最终解的质量。温度设置太高可能导致算法在解空间中过于随机地搜索,而设置太低可能使算法过早地收敛于局部最优解,失去探索全局最优解的能力。

4.1.1 初始温度的确定方法

初始温度是模拟退火算法开始阶段的温度设定。一个有效的方法是利用“能量”差的统计分布来确定,即从一个随机解开始,进行多次微小的随机扰动,并记录每次扰动的能量差,然后根据能量差的分布来推断初始温度。

import numpy as np

def calculate_energy_differences(objective_function):

current_solution = initial_solution()

current_energy = objective_function(current_solution)

energy_differences = []

for _ in range(1000):

new_solution = perturb_solution(current_solution)

new_energy = objective_function(new_solution)

energy_difference = new_energy - current_energy

energy_differences.append(energy_difference)

# 计算能量差的统计分布

# 这里简化为计算能量差的平均值

average_energy_difference = np.mean(energy_differences)

return average_energy_difference

# 定义初始解和目标函数的示例

def initial_solution():

return np.random.rand()

def objective_function(solution):

# 这里用一个示例函数来模拟真实的目标函数

return -solution ** 2

# 计算初始能量差

initial_temp = calculate_energy_differences(objective_function)

4.1.2 温度衰减函数的选择与实验

温度衰减函数负责模拟退火过程中的温度下降。常见的有指数衰减函数和线性衰减函数。选择合适的衰减函数和参数能够更好地控制算法的探索与收敛行为。

def exponential_temperature_decay(temperature, alpha=0.9):

"""

指数衰减函数,alpha 是衰减因子。

"""

return temperature * alpha

def linear_temperature_decay(temperature, beta=0.01):

"""

线性衰减函数,beta 是衰减系数。

"""

return max(temperature - beta, 0)

# 假设初始温度为1000

current_temp = 1000

# 应用不同的衰减函数

exponential_temp = exponential_temperature_decay(current_temp)

linear_temp = linear_temperature_decay(current_temp)

# 打印结果

print(f"初始温度: {current_temp}")

print(f"指数衰减后的温度: {exponential_temp}")

print(f"线性衰减后的温度: {linear_temp}")

4.2 模拟退火的冷却策略

冷却策略决定了退火过程中温度如何下降,包括温度下降的速度和阶段。选择恰当的冷却策略能够平衡算法的全局搜索能力和局部搜索能力,是模拟退火算法成功的关键。

4.2.1 固定冷却率与自适应冷却率的比较

固定冷却率是指温度按照固定的比率下降,比如每一阶段温度乘以0.9。自适应冷却率会根据当前的搜索状态动态调整温度下降的速度,有可能在初期下降得快一些,后期下降得慢一些,以适应不同的搜索阶段。

graph LR

A[开始] --> B[计算初始温度]

B --> C{冷却策略选择}

C -->|固定冷却率| D[温度下降固定比率]

C -->|自适应冷却率| E[根据当前搜索状态调整冷却率]

D --> F[选择新解]

E --> F

F --> G{是否满足终止条件}

G -->|是| H[输出当前最优解]

G -->|否| C

4.2.2 多阶段冷却策略的设计与实现

多阶段冷却策略将退火过程分成几个阶段,每个阶段使用不同的冷却率。这种方式可以在不同阶段根据需要进行细致的调整,以便在算法的早期阶段快速探索解空间,在后期阶段精细化搜索。

def multistage_cooling(temperature, stages):

"""

多阶段冷却策略函数,stages 是一个包含每个阶段的冷却率的列表。

"""

for stage_rate in stages:

temperature = max(temperature * stage_rate, 1) # 确保温度不低于1

return temperature

# 假设初始温度为1000

current_temp = 1000

# 设置不同阶段的冷却率

stages = [0.9, 0.8, 0.7]

# 应用多阶段冷却策略

multi_stage_temp = multistage_cooling(current_temp, stages)

# 打印结果

print(f"初始温度: {current_temp}")

print(f"应用多阶段冷却后的温度: {multi_stage_temp}")

4.3 接受准则的设计与调整

接受准则在模拟退火算法中决定一个新解是否被接受。它的核心是Metropolis准则,该准则允许一定概率的“恶化解”被接受,以此避免算法陷入局部最优。

4.3.1 Metropolis准则的原理与应用

Metropolis准则的核心思想是,即使新解的性能更差,也有一定概率被接受,概率大小与当前温度和解的性能差有关。具体公式如下:

$$ P(e, e') = \begin{cases} 1 & \text{if } e' < e \ e^{(e' - e) / T} & \text{if } e' \ge e \end{cases}

其中,$P$是新解被接受的概率,$e$是当前解的能量,$e'$是新解的能量,$T$是当前温度。

4.3.2 接受准则对算法寻优能力的影响

接受准则的设定直接影响算法在解空间中的搜索行为。过于宽松的接受准则可能会导致算法在解空间中随机游走,而过于严格的接受准则则可能使算法快速收敛于局部最优。因此,设计合理的接受准则对于找到全局最优解至关重要。

def metropolis_criterion(current_energy, new_energy, temperature):

"""

Metropolis接受准则函数。

"""

if new_energy < current_energy:

return 1.0 # 能量更低,接受新解

else:

probability = np.exp((new_energy - current_energy) / temperature)

random_number = np.random.rand()

return 1 if random_number < probability else 0 # 以一定概率接受更差的解

# 假设当前解的能量为10,新解的能量为12,当前温度为50

current_energy = 10

new_energy = 12

temperature = 50

# 计算新解被接受的概率

acceptance_probability = metropolis_criterion(current_energy, new_energy, temperature)

# 打印结果

print(f"新解被接受的概率: {acceptance_probability}")

本章详细介绍了模拟退火算法中的温度设定、冷却策略和接受准则,这些关键要素共同决定了算法的性能和最终解的质量。通过合理地设置这些参数,可以在不同阶段对算法进行精细的调整,从而达到更好的优化效果。

5. Python实现遗传算法与模拟退火的框架构建

在作业车间调度问题(JSP)中,遗传算法(GA)与模拟退火(SA)是两种非常流行的启发式搜索技术。它们因能有效处理复杂和大规模的优化问题而受到广泛关注。本章将深入探讨如何使用Python实现这两种算法的框架,并为实现过程提供代码示例。这一部分内容对IT专业人士来说是极具吸引力的,因为它们可以直接应用于实际问题,并且可以根据特定问题进行定制。

5.1 Python环境搭建与工具库介绍

5.1.1 安装Python及配置开发环境

Python是一种高级编程语言,广泛应用于数据分析、人工智能、网络开发等领域。为了在本地计算机上搭建Python开发环境,我们首先需要下载并安装Python。安装完成后,推荐使用集成开发环境(IDE),比如PyCharm或Visual Studio Code,它们提供了代码编辑、调试和项目管理等强大功能。

安装Python时,请确保勾选“Add Python to PATH”选项,这样可以在命令行中直接调用Python解释器。接下来,通过pip安装一些常用的科学计算库,如NumPy、SciPy、Matplotlib等。

5.1.2 常用科学计算库的功能与选择

- NumPy是一个支持大型多维数组和矩阵运算的库,它提供了高性能的数学函数库。

- SciPy是基于NumPy构建的,用于解决科学和工程中的各种问题,如线性代数、优化问题等。

- Matplotlib是Python中用于绘图的库,可以生成高质量的二维图形,方便我们进行结果的可视化分析。

以下是使用pip安装这些库的命令:

pip install numpy scipy matplotlib

这些库的安装为我们的算法实现提供了强大的支持。下面我们进入遗传算法和模拟退火算法的框架构建。

5.2 遗传算法框架的构建与实现

5.2.1 算法框架的设计原则

在设计遗传算法框架时,我们遵循以下原则:

- 模块化:将算法的各个部分(如编码、选择、交叉、变异)设计为独立的模块,便于维护和修改。

- 通用性:确保框架具有足够的通用性,能够适应不同的问题域,只需对参数进行简单配置即可。

- 扩展性:提供接口,方便在需要时添加新的操作或策略,以进一步优化算法性能。

5.2.2 编码、选择、交叉、变异策略的Python实现

在Python中实现遗传算法的各个部分时,我们首先定义一个表示个体的类,然后为编码、选择、交叉和变异操作分别定义方法。以下是一个简化的代码示例,展示了如何实现遗传算法的基本框架:

import numpy as np

class Individual:

def __init__(self, chromosome):

self.chromosome = chromosome

self.fitness = None

def calculate_fitness(self):

# 这里是计算个体适应度的逻辑,根据JSP问题的具体定义来实现

pass

class GeneticAlgorithm:

def __init__(self):

self.population = []

def initialize_population(self, size, chromosome_length):

# 初始化种群

pass

def select(self):

# 实现选择操作

pass

def crossover(self):

# 实现交叉操作

pass

def mutate(self):

# 实现变异操作

pass

def next_generation(self):

# 生成下一代种群

pass

def run(self):

# 运行遗传算法

pass

# 实例化遗传算法并运行

ga = GeneticAlgorithm()

ga.run()

在上述代码中,我们定义了 Individual 类来表示种群中的个体,并在 GeneticAlgorithm 类中实现了初始化种群、选择、交叉、变异和生成下一代种群的方法。 run 方法将整合以上步骤,并实现遗传算法的主循环。

5.3 模拟退火框架的构建与实现

5.3.1 温度、冷却策略的Python实现

模拟退火算法的实现依赖于温度控制和冷却策略的设计。以下是一个简化的代码示例,展示了如何实现模拟退火算法的基本框架:

class SimulatedAnnealing:

def __init__(self, initial_temp, cooling_rate):

self.current_temp = initial_temp

self.cooling_rate = cooling_rate

def generate_new_solution(self):

# 生成新的解

pass

def accept_solution(self, new_solution):

# 判断是否接受新解

pass

def cool_down(self):

# 实现冷却步骤

self.current_temp *= (1 - self.cooling_rate)

def run(self):

# 运行模拟退火算法

current_solution = self.initialize_solution()

while not self.is_termination_condition_met():

new_solution = self.generate_new_solution()

if self.accept_solution(new_solution):

current_solution = new_solution

self.cool_down()

return current_solution

# 实例化模拟退火算法并运行

sa = SimulatedAnnealing(1000, 0.01)

best_solution = sa.run()

在上述代码中,我们定义了 SimulatedAnnealing 类来表示模拟退火算法,并实现了初始化解、生成新解、判断是否接受新解、冷却步骤和运行算法的方法。 run 方法将整合以上步骤,并实现模拟退火算法的主循环。

5.3.2 接受准则与解空间搜索过程的实现

模拟退火算法的接受准则通常基于Metropolis准则,即当新解比当前解好时,一定接受;当新解不如当前解时,有一定的概率接受新解,这个概率随着温度的降低而减小。以下是接受准则的代码实现:

def accept_criterion(old_fitness, new_fitness, current_temp):

if new_fitness > old_fitness:

return True

else:

probability = np.exp((new_fitness - old_fitness) / current_temp)

return probability > np.random.rand()

在解空间搜索过程中,我们生成新解并使用接受准则来决定是否更新当前解,然后执行冷却步骤,直到满足终止条件。

在接下来的章节中,我们将详细探讨如何对这两种算法进行优化,包括并行计算和适应度比例选择等策略,以提高算法的性能和效率。

6. 算法优化技巧,如并行计算和适应度比例选择

6.1 并行计算在算法优化中的应用

6.1.1 并行计算的基本概念与优势

在优化遗传算法(GA)和模拟退火(SA)等复杂搜索算法时,计算的效率和速度往往成为瓶颈。并行计算作为一种提高计算效率的技术,能够显著加快算法的执行速度。其基本概念是将问题分割成多个部分,然后使用多个计算资源同时进行求解。并行计算的优势在于可以利用现代多核处理器或分布式计算资源,实现算法的快速迭代和大规模数据处理。

在GA和SA中,可以对种群的个体进行并行评估,或者在模拟退火中对多个温度状态进行并行探索。并行计算可以提升算法的执行效率,缩短问题求解时间,同时还可以增强算法处理大规模问题的能力。

6.1.2 并行遗传算法与模拟退火的设计策略

并行遗传算法(PGA)和并行模拟退火(PSA)的设计策略涉及算法的同步机制和通信协议。对于PGA,一种常见的设计策略是将种群分割为多个子种群,每个子种群在独立的处理器上执行选择、交叉和变异操作,定期进行信息交换。PGA的关键在于如何设计有效的信息交换机制,以避免早熟收敛并保持种群多样性。

而对于PSA,设计策略可以包含多个温度并行更新,每个温度下独立的解空间搜索。通过并行执行不同温度下的搜索,可以加快算法的冷却过程,从而提高算法的搜索效率。PSA中需要考虑的关键是如何在保证算法效率的同时,合理地平衡并行搜索与全局最优解之间的关系。

6.2 适应度比例选择与算法性能提升

6.2.1 适应度比例选择的概念与实现方法

适应度比例选择(Fitness Proportionate Selection),又称轮盘赌选择,是一种遗传算法中常见的选择策略。其核心思想是根据个体的适应度值在总适应度中的比例来确定个体被选中的概率。适应度越高的个体有更大的机会被选中进行繁殖,但低适应度个体也有机会被选中,从而保持种群的多样性。

具体实现时,首先需要计算每个个体的选择概率,然后基于这个概率来随机选择个体。例如,如果种群中个体的适应度分别为 f1, f2, ..., fn ,那么每个个体的选择概率可以表示为 p_i = f_i / Σf_i ,其中 Σ 表示对所有个体的适应度求和。在Python代码中,可以使用 random.choices 函数来实现这种选择。

# 示例代码:适应度比例选择的实现

import random

# 适应度列表,表示每个个体的适应度值

fitness = [5, 20, 10, 15]

# 计算总适应度

total_fitness = sum(fitness)

# 进行适应度比例选择

selected_indices = random.choices(range(len(fitness)), weights=fitness, k=10)

# selected_indices 包含根据适应度比例选择出的索引

6.2.2 适应度比例选择对算法收敛速度的影响

适应度比例选择机制对算法的收敛速度和最终解的质量有显著影响。由于适应度高的个体被选中的概率更大,这种选择方法倾向于快速收敛到较高适应度的区域,但同时也容易导致早熟收敛,失去探索新解的能力。为了缓解这个问题,通常会采取一些技术手段,比如调整选择压力、引入精英选择策略,或者配合其他选择机制使用。

6.3 算法性能和稳定性的评估方法

6.3.1 性能评估指标的定义与计算

评估遗传算法或模拟退火算法的性能通常使用几个关键指标,如收敛速度、解的质量、种群多样性等。收敛速度可以通过观察适应度随迭代次数变化的曲线来分析;解的质量通常用最优解、平均解或者解与已知最优解之间的差距来衡量;种群多样性可以用种群中不同个体的多样性指数来衡量。

在Python中,可以使用matplotlib库来绘制适应度曲线,评估算法的收敛速度。代码示例如下:

# 示例代码:绘制适应度曲线

import matplotlib.pyplot as plt

# 假设fitness_curve是一个包含适应度值的列表,记录了算法每一代的适应度

fitness_curve = [100, 150, 200, 230, 250, 260, 265, 270, 275]

# 绘制适应度曲线

plt.plot(fitness_curve)

plt.xlabel('Generation')

plt.ylabel('Fitness')

plt.title('Fitness Progression over Generations')

plt.show()

6.3.2 稳定性评估与算法鲁棒性分析

算法的稳定性是指算法在多次运行后,是否能够一致地找到高质量的解。评估算法稳定性的一个简单方法是多次运行算法,并记录每次运行的最终适应度。通过统计分析这些数据(如计算平均值、标准差等),可以对算法的稳定性进行量化评估。

鲁棒性分析则是在不同条件下对算法进行测试,比如在不同的问题规模、不同的初始参数下运行算法,看算法是否能够保持一致的性能。如果算法在各种条件下都能稳定地找到高质量的解,则认为算法具有良好的鲁棒性。

稳定性与鲁棒性分析对于算法的实际应用至关重要,它们能够帮助我们了解算法的适用范围,并指导我们在实际问题中如何选择和调整算法参数。

简介:遗传算法和模拟退火是两种有效的全局优化技术,能解决诸如作业车间调度这类复杂的非线性和组合优化问题。在Python中实现这两种算法并应用于JSP,需考虑问题建模、编码策略、约束条件,并利用科学计算库进行算法框架和优化技巧的编写。通过对比不同算法结果,评估性能与稳定性,为生产调度提供智能解决方案。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?