-

作者:Tian Wang, Junming Fan, Pai Zheng

-

单位:香港理工大学工业及系统工程系

-

论文标题:An LLM-based vision and language cobot navigation approach for Human-centric Smart Manufacturing

-

论文链接:https://www.sciencedirect.com/science/article/pii/S0278612524000864

-

出版信息:Journal of Manufacturing Systems 75 (2024) 299–305

主要贡献

-

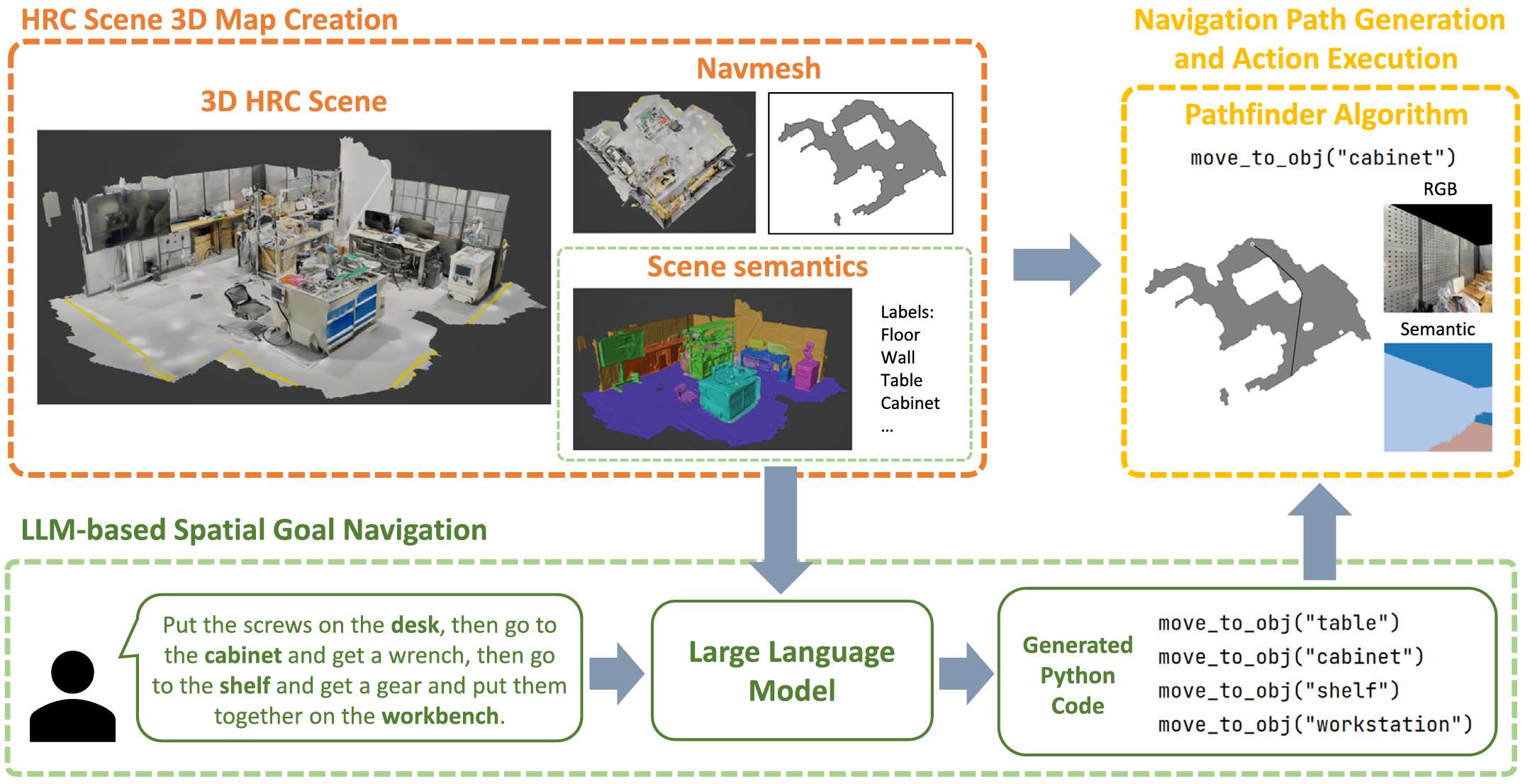

论文提出基于大模型的视觉和语言协作机器人导航方法,用于以人为本的智能制造(HSM),通过结合自然语言理解和路径规划算法,实现了在制造环境中进行工具取用的自动化导航。

-

使用三维点云技术对真实的人机协作制造场景进行了重建和标注,提供了环境的详细表示,使得机器人能够更好地理解其周围的环境并执行复杂的导航任务。

-

利用GPT-3.5-turbo模型来理解和解析人类操作员的自然语言指令,并生成相应的Python代码来触发机器人的导航动作,提高了机器人在复杂任务中的交互性和适应性。

-

通过在AI Habitat模拟器中实现和测试所提出的框架,论文展示了该系统在单目标和多目标导航任务中的有效性,有效地辅助人类操作员完成制造任务。

研究背景

研究问题

论文主要解决的问题是如何在智能制造环境中,利用大模型(LLM)实现视觉和语言的协作机器人(cobot)导航,以解决制造过程中由于反复取工具而导致的中断问题。

研究难点

该问题的研究难点包括:

-

如何准确理解复杂的人类自然语言指令,

-

如何在复杂的三维环境中进行有效的路径规划,

-

以及如何实现机器人与人类操作员的自然交互。

相关工作

-

LLM用于智能制造(HSM):

-

HSM是Industry 5.0的一个关键特征,强调将人类置于生产系统的核心位置,以增强工人的健康和安全。

-

LLM因其强大的少样本推理和泛化能力,在HSM中表现出色,能够实现高级动态任务规划和自然的人机交互(HRI)。

-

现有研究包括将制造知识集成到LLM中进行信息检索、使用LLM进行质量缺陷推理和响应、以及在制造任务中理解和设计工具路径等。

-

-

移动机器人在制造中的应用:

-

在智能制造系统中,使用移动机器人进行车间物料搬运已成为不可或缺的一部分。

-

现有的研究主要集中在AGV的调度和路径规划上,但大多数系统在非结构化环境中表现不佳,缺乏灵活性和人机交互能力。

-

这些系统未能满足Industry 5.0对灵活性和人本性的要求。

-

-

基于LLM的视觉语言导航:

-

VLN是AI领域的一个新兴研究方向,旨在促进人类与AI智能体之间的协作互动。

-

LLM的出现使得VLN任务能够在少样本情况下实现空间目标导航。

-

现有研究主要集中在家庭和休闲场景中,工业和制造任务的研究较少。

-

论文创新性地提出了一个基于LLM的VLN方法,用于HSM,以支持未来的工具取用任务。

-

方法

HRC场景3D地图创建

- 场景扫描与建模:

-

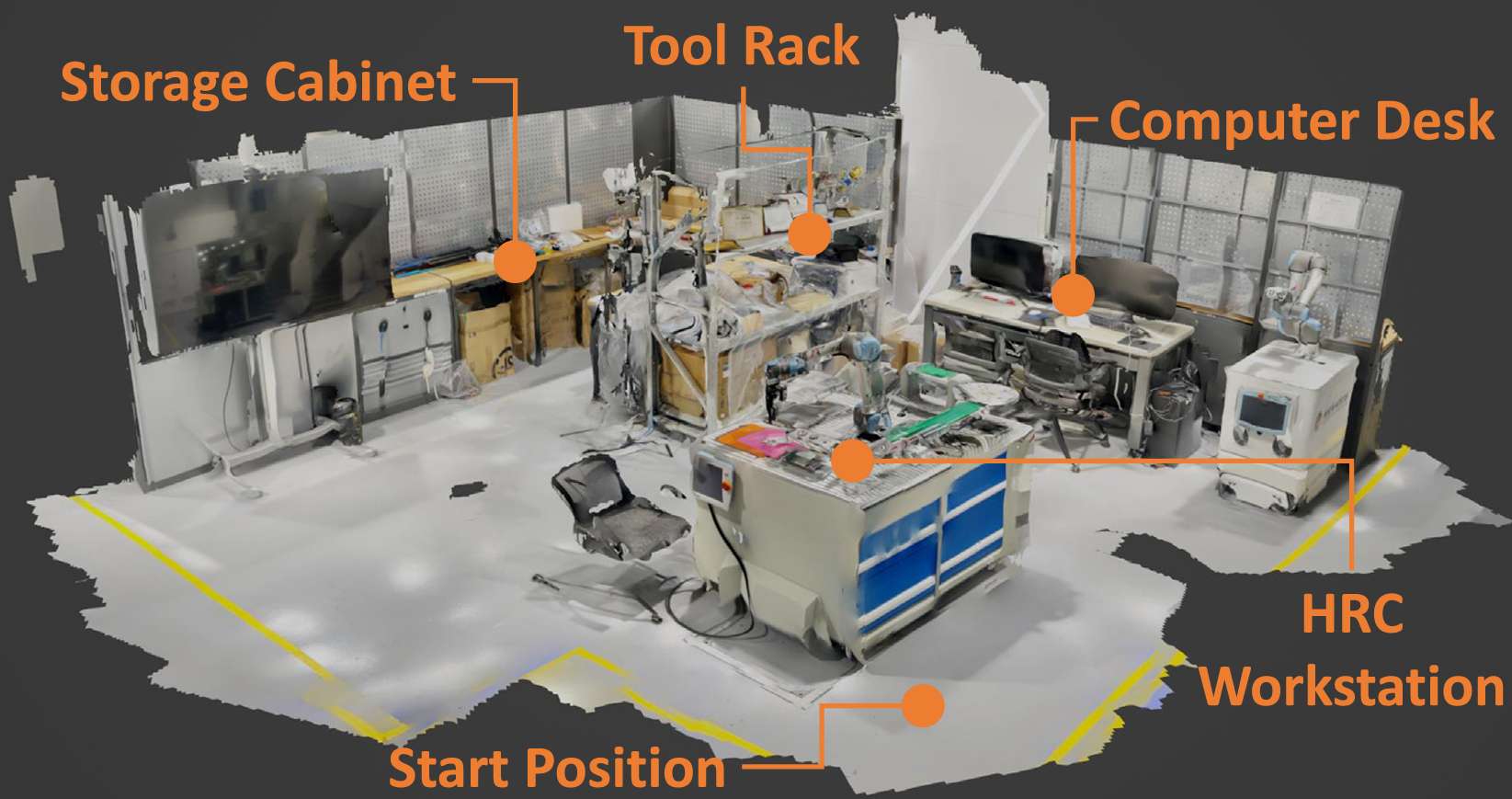

对真实的HRC(人机协作)制造空间进行扫描,以适应视觉和语言协作机器人导航任务。

-

这个空间包括HRC工作站、电脑桌、工具架和储物柜。

-

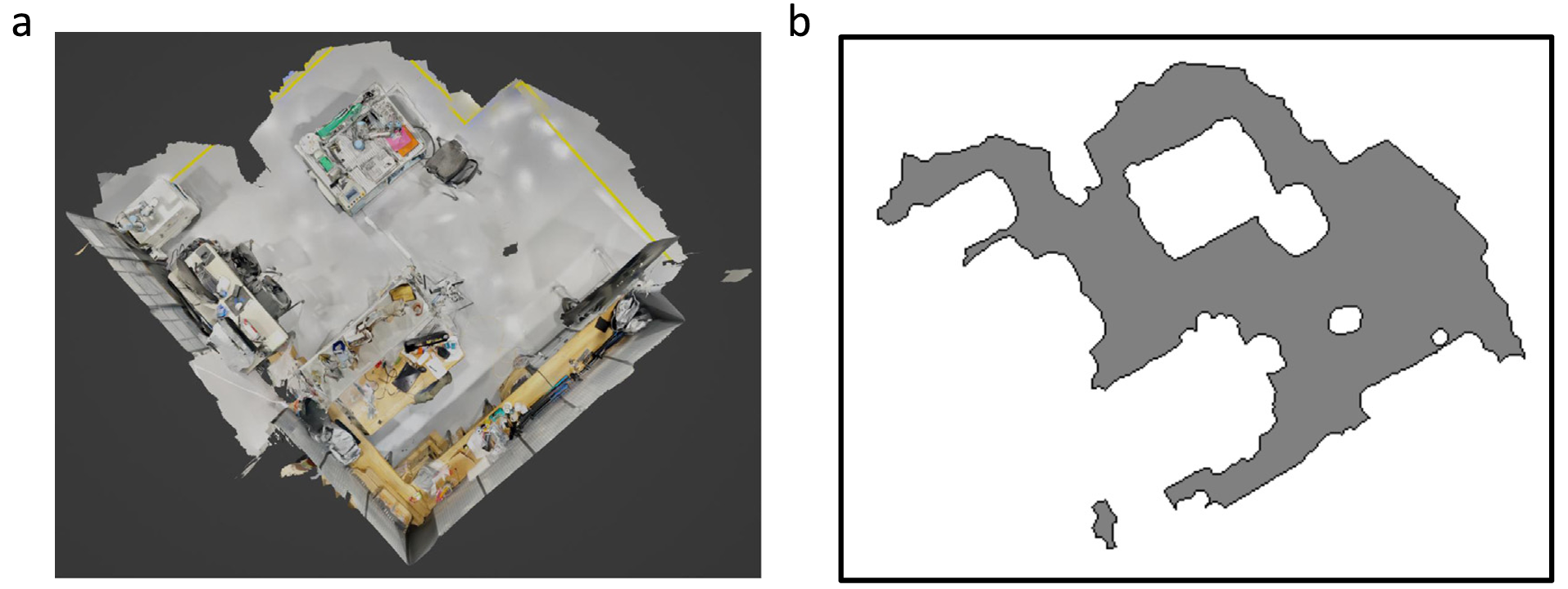

- Navmesh计算:

-

基于HRC场景的网格模型,生成Navmesh。

-

Navmesh是一种数据结构,用于计算可行走区域并在虚拟环境中生成导航路径。

-

将环境划分为一系列可行走的三角形,每个三角形代表一个适合导航的区域。

-

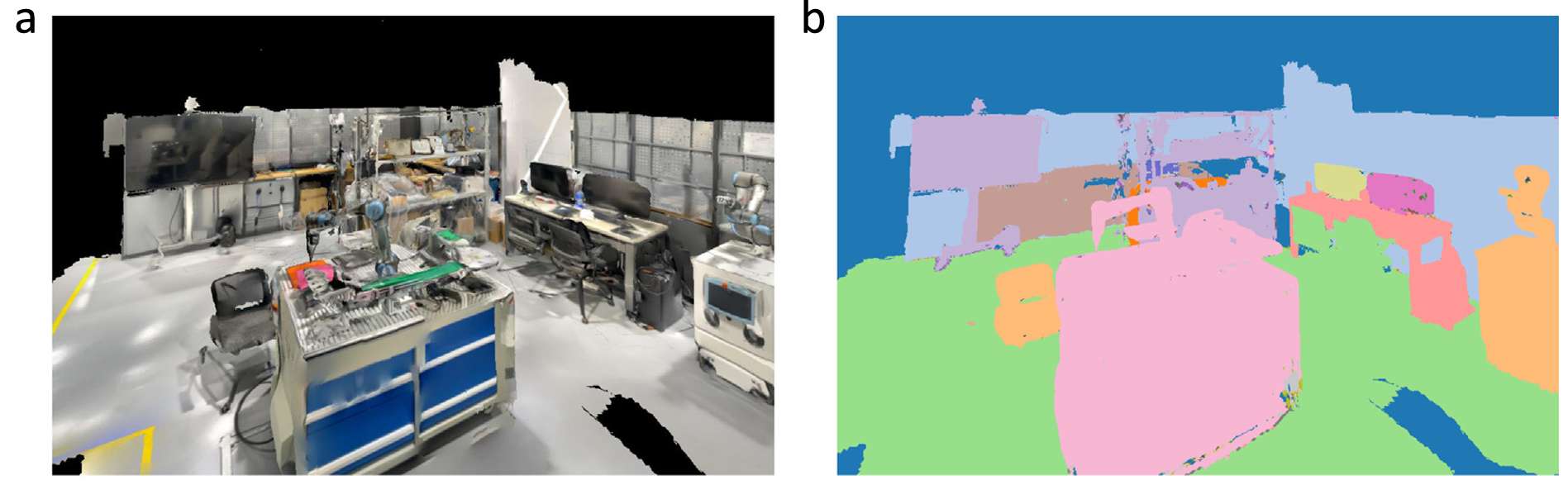

- 场景语义标注:

-

通过对PLY格式的3D点云模型进行标注,生成场景的语义信息。

-

这包括识别特定目标的空间坐标,以便后续的导航路径规划。

-

通过给顶点分配相同的RGB特性和面元素分配“object_id”属性,实现对场景中物体的识别和标记。

-

基于LLM的空间目标导航

- GPT-3.5-turbo模型:

-

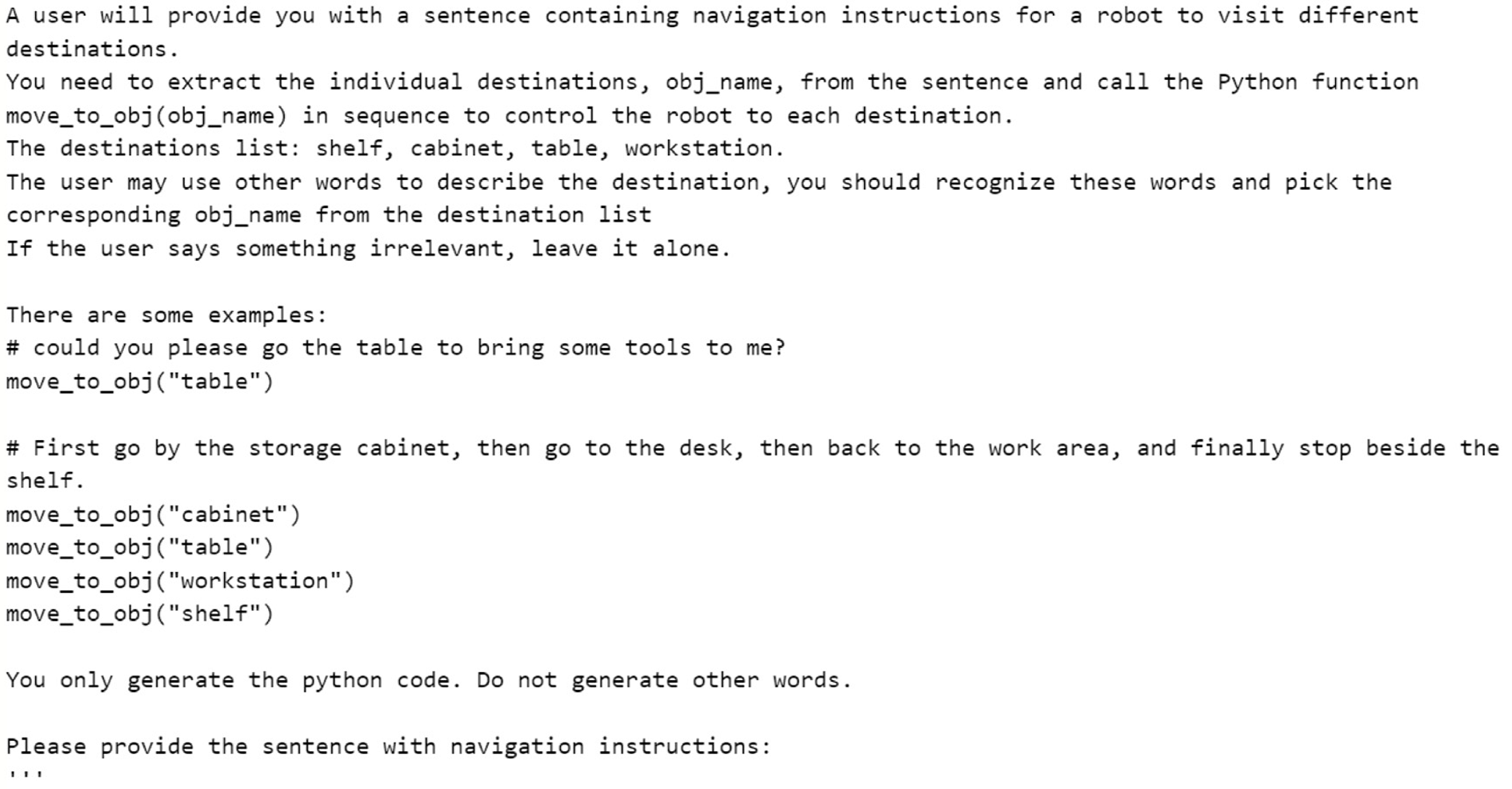

使用OpenAI的GPT-3.5-turbo模型将对话和指令转换为可执行的Python代码,以实现空间目标导航任务。

-

- 自然语言理解:

-

通过设置包含任务描述、示例和用户输入的提示,模型学习语言中的统计模式和上下文信息,生成与给定提示和用户输入一致的文本输出。

-

- 代码生成与执行:

-

将生成的Python代码打印出来供用户审查,并使用Python的“exec”函数执行代码。

-

代码调用“move_to_obj”函数,使机器人根据用户的导航指令移动。

-

导航路径生成与动作执行

- Pathfinder模块:

-

使用Habitat-sim中的Pathfinder模块来生成导航路径和执行动作。

-

该模块利用之前生成的Navmesh和LLM识别的目的地,生成从当前位置到子目标的最短路径序列。

-

- 路径执行:

-

在导航执行过程中,计算当前点和下一个点之间的方向向量和长度,以确定智能体的移动方向和距离。

-

执行动作如“move_forward”以实现前进,并根据下一个点的方向向量计算旋转角度,转换为四元数以引导智能体沿路径正确方向行进。

-

- 迭代过程:

-

通过重复此过程,智能体逐步通过每个路径点,执行适当的动作,并逐渐接近目标位置。

-

案例研究

通过模拟实验验证了所提出的AGV(自动导引车)系统是否能够准确理解用户的自然语言指令,并在模拟环境中自主导航至目的地以完成人机协作(HRC)制造任务。

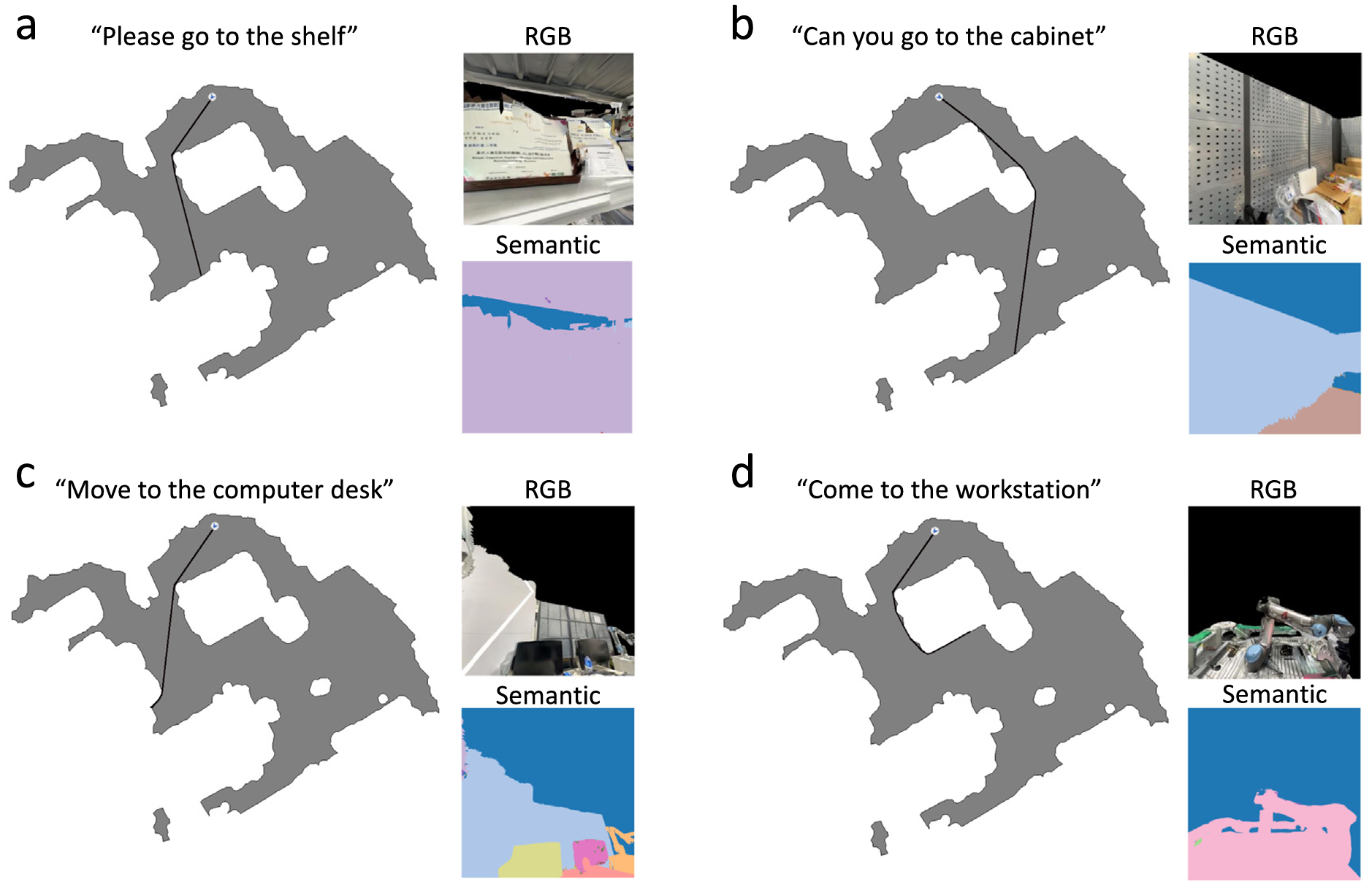

单目标导航

- 实验设置:

-

在这个实验中,考虑了HRC场景中的四个目标:工具架(shelf)、储物柜(cabinet)、电脑桌(table)和工作站(workstation)。

-

起始点设置在场景边缘。

-

- 实验目标:

-

验证AGV是否能够准确规划路径并移动到每个目的地。

-

提供的自然语言指令只包含一个导航目标,例如“请去桌子”或“移动到货架”。

-

-

结果展示:

-

实验结果显示,LLM能够准确识别语言指令中的目标点,即使使用不同的词汇描述目的地。

-

Pathfinder算法成功规划了从起始点到给定目的地的路径,AGV能够成功到达导航目标。

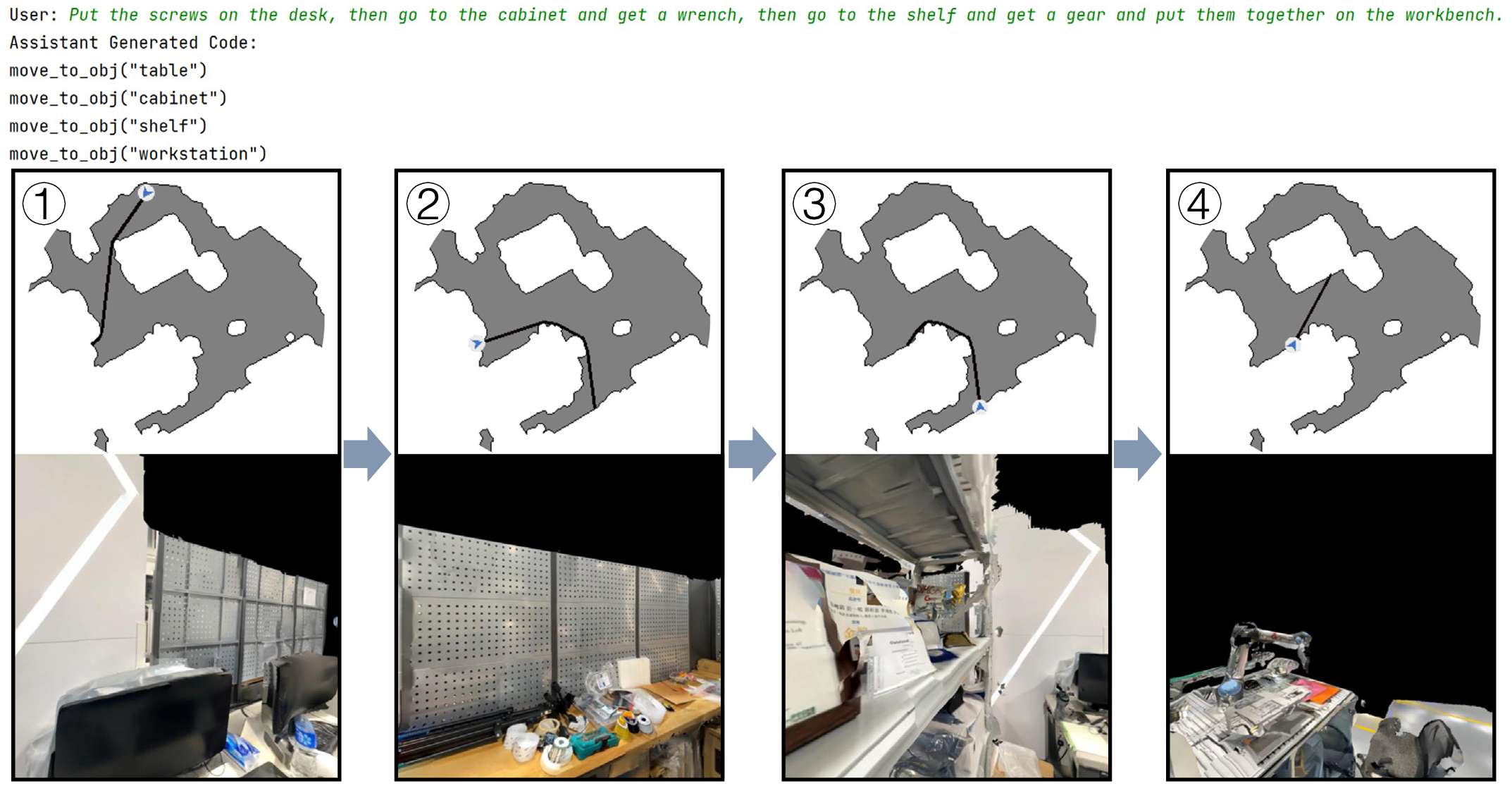

多目标导航

- 实验设置:

-

在这个实验中,目标是验证AGV是否能够处理包含多个目标的复杂指令。

-

输入提示包括四个导航目标、非导航干扰项(如螺丝、扳手和齿轮),以及与索引列表相比用于描述导航目标的不同词汇。

-

- 实验目标:

-

期望LLM能够生成正确的Python代码,使智能体在模拟器中执行连续的导航动作。

-

-

结果展示:

-

实验结果显示,LLM根据用户的命令成功生成了四行代码,并在模拟器中执行了它们,完成了多目标导航。

-

Pathfinder算法从当前位置到子目标规划了路径,并在每次路径规划后返回高亮显示路径的俯视图。

-

实验结果表明,AGV成功地按照用户的命令在HRC场景中执行了导航操作。

总结

-

论文提出了基于LLM的视觉和语言协作机器人导航框架,用于智能制造中的工具取回。

-

通过重建和注释真实的三维协作机器人场景,利用LLM理解人类自然语言指令,并生成Python代码进行路径规划,最终在仿真环境中验证了该框架的有效性。

-

该方法不仅提高了操作员的作业效率和安全性,还推动了智能制造中人机协作的发展。

-

未来的工作将探索自动场景分割算法,以提高系统的定量评估指标。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?