1.前置条件

- ubuntu中已经安装idea,jdk,scala,spark

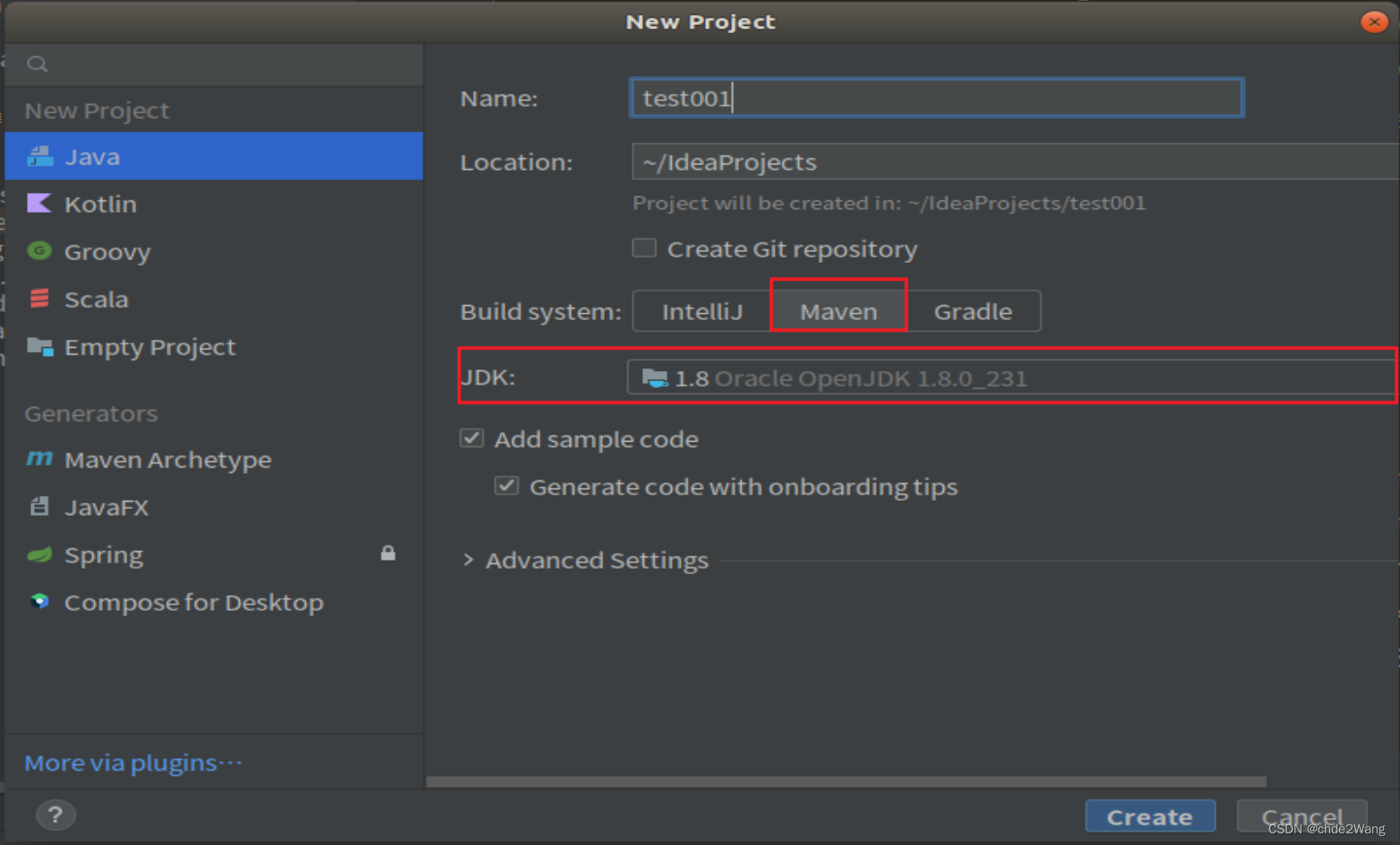

2.打开idea,新建,选择Maven项目

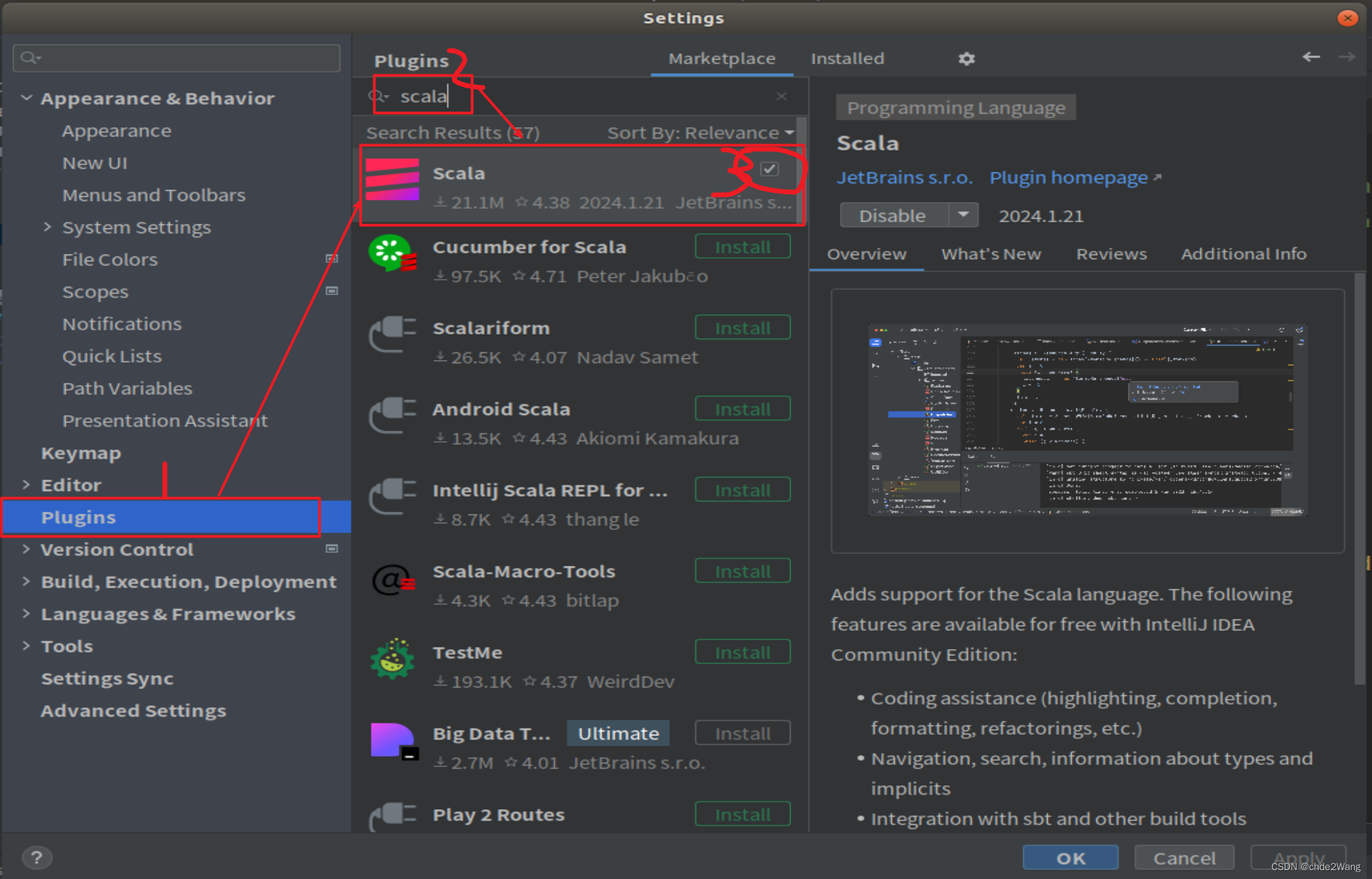

3.在IDEA中,File-Setting-Plugin,下载Scala插件

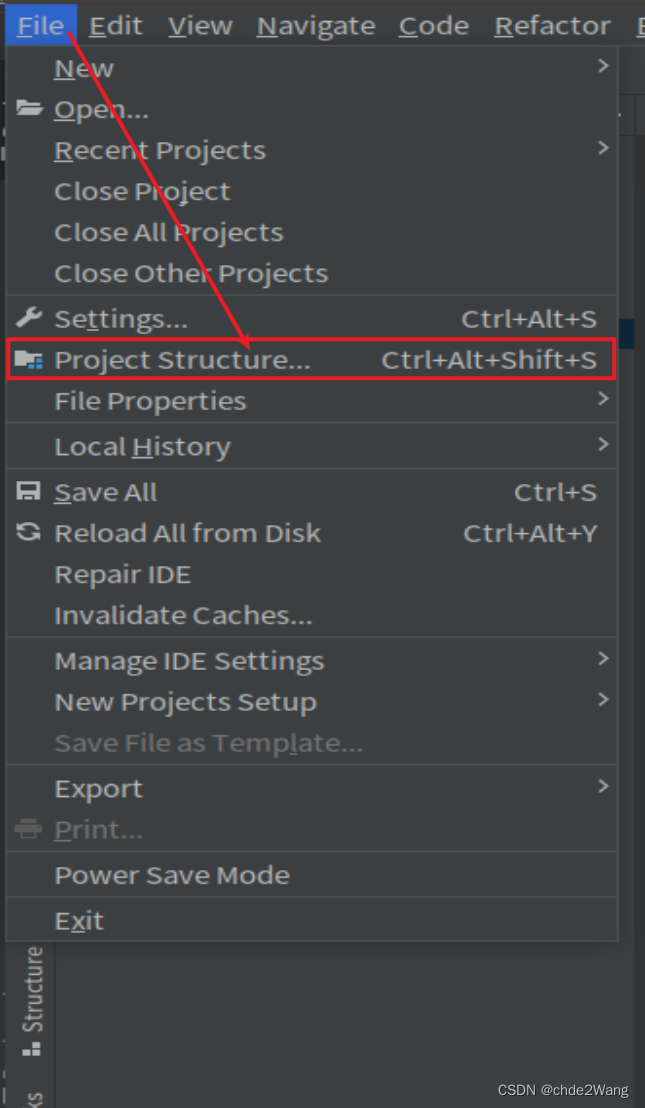

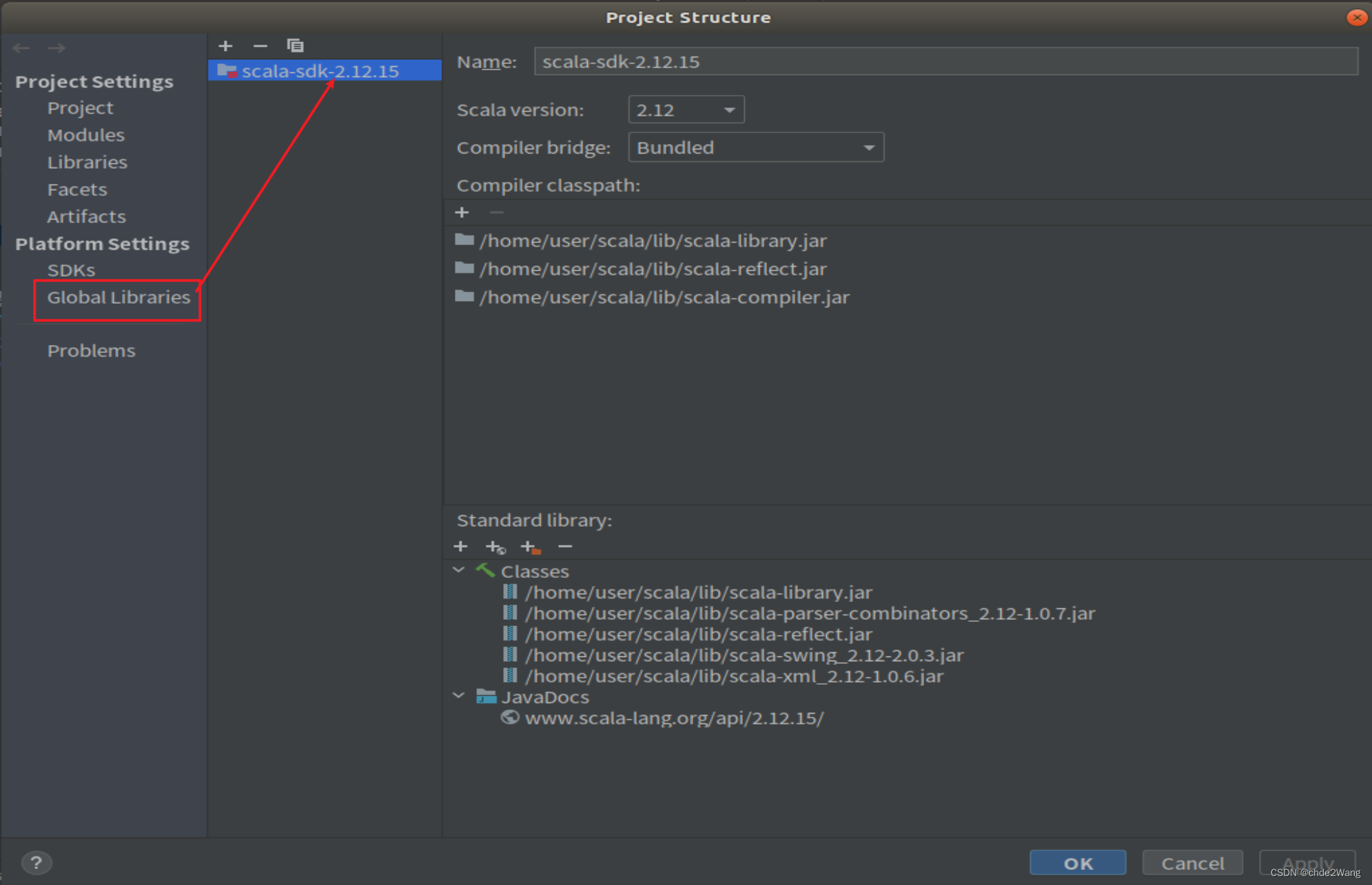

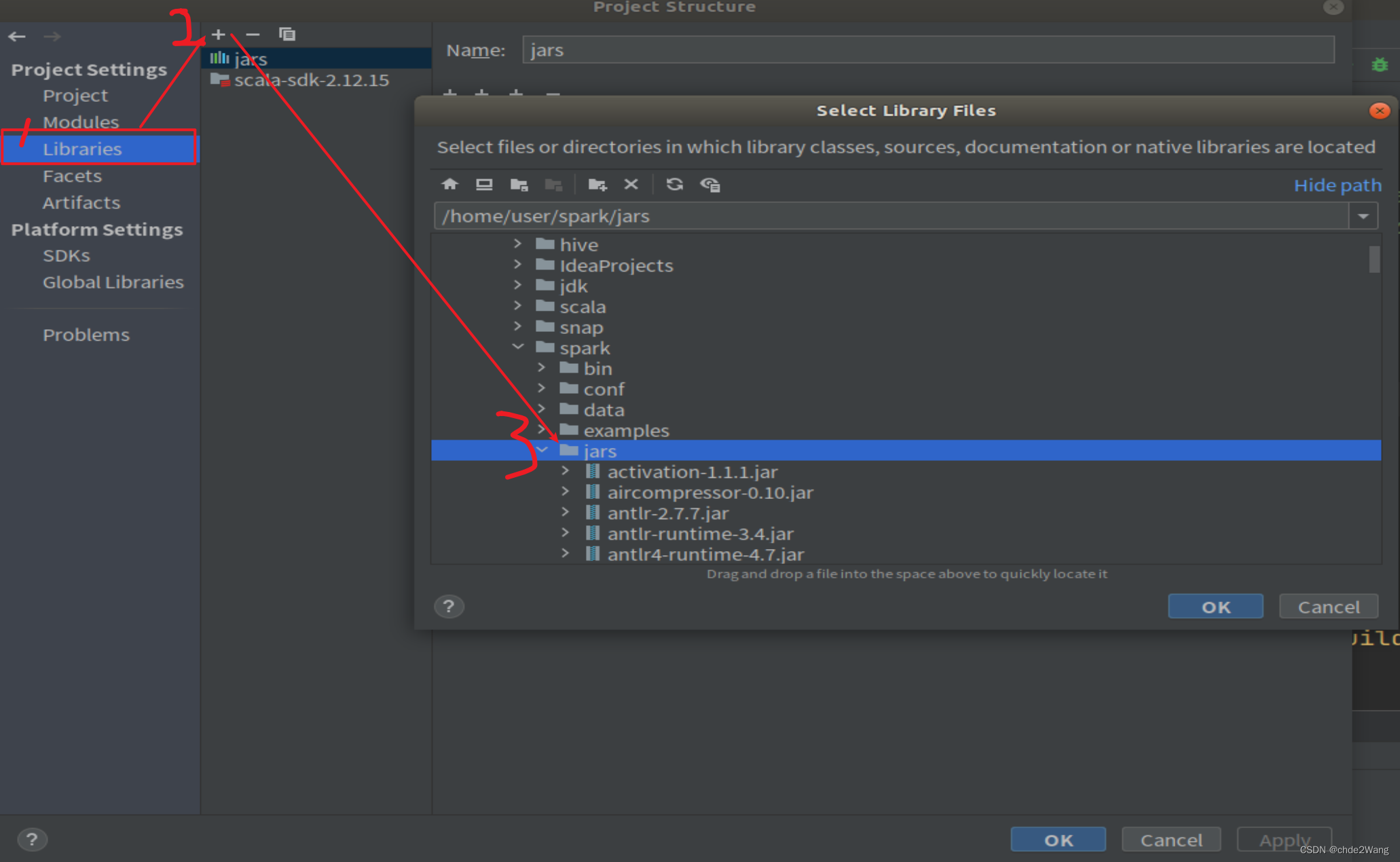

4.File-project structure,导入插件

4.1在全局库中,选择导入刚才的scala插件

4.2在项目库中,导入spark安装目录jar包所在路径

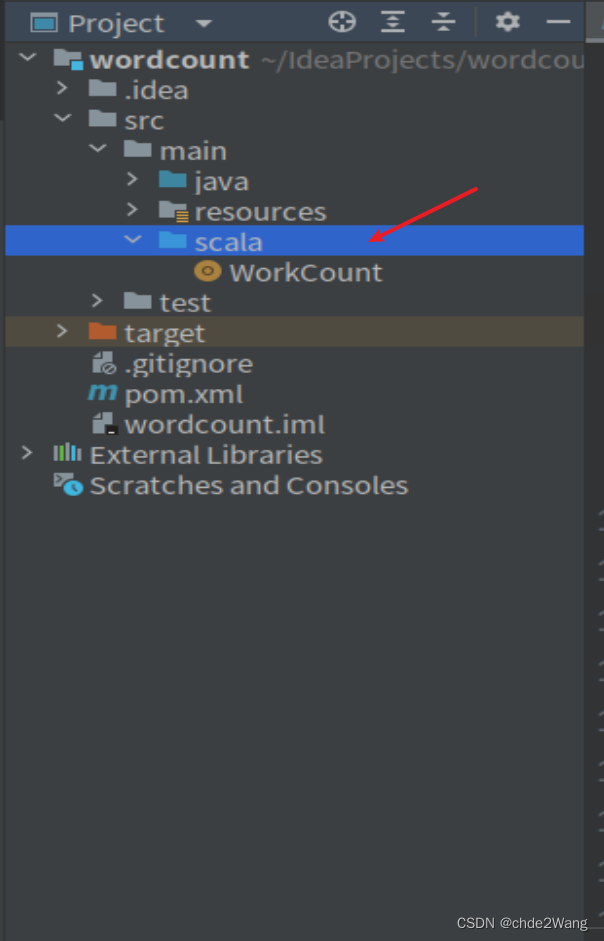

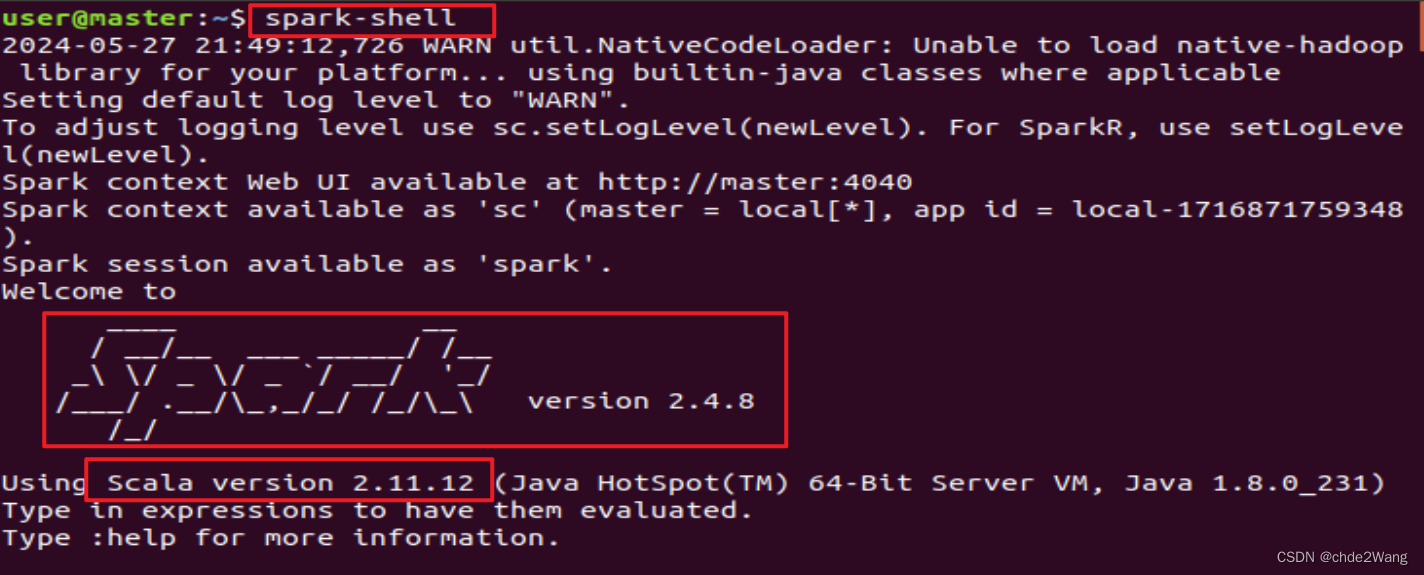

5.在原项目的main目录下新建scala文件夹,并右击,将其设置为Source Root,在scala文件夹下,右击新建scala型Object文件WordCount。

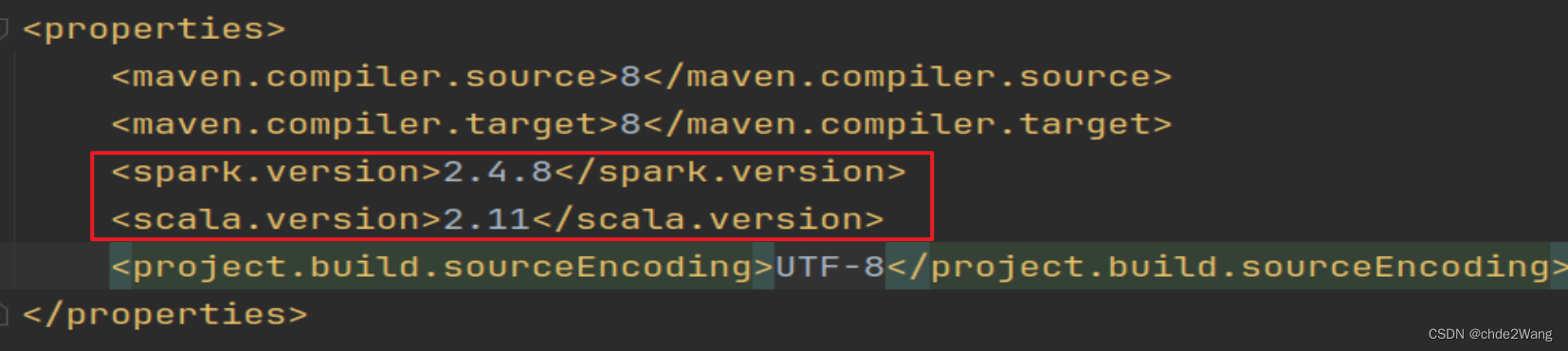

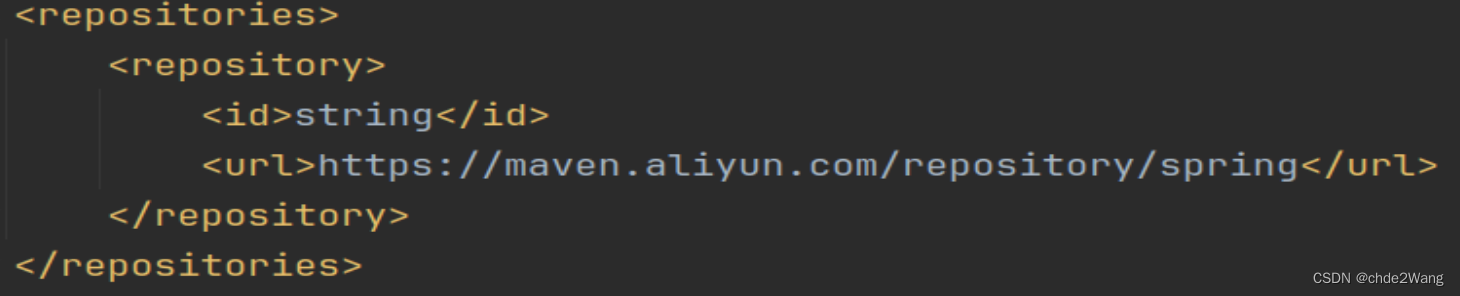

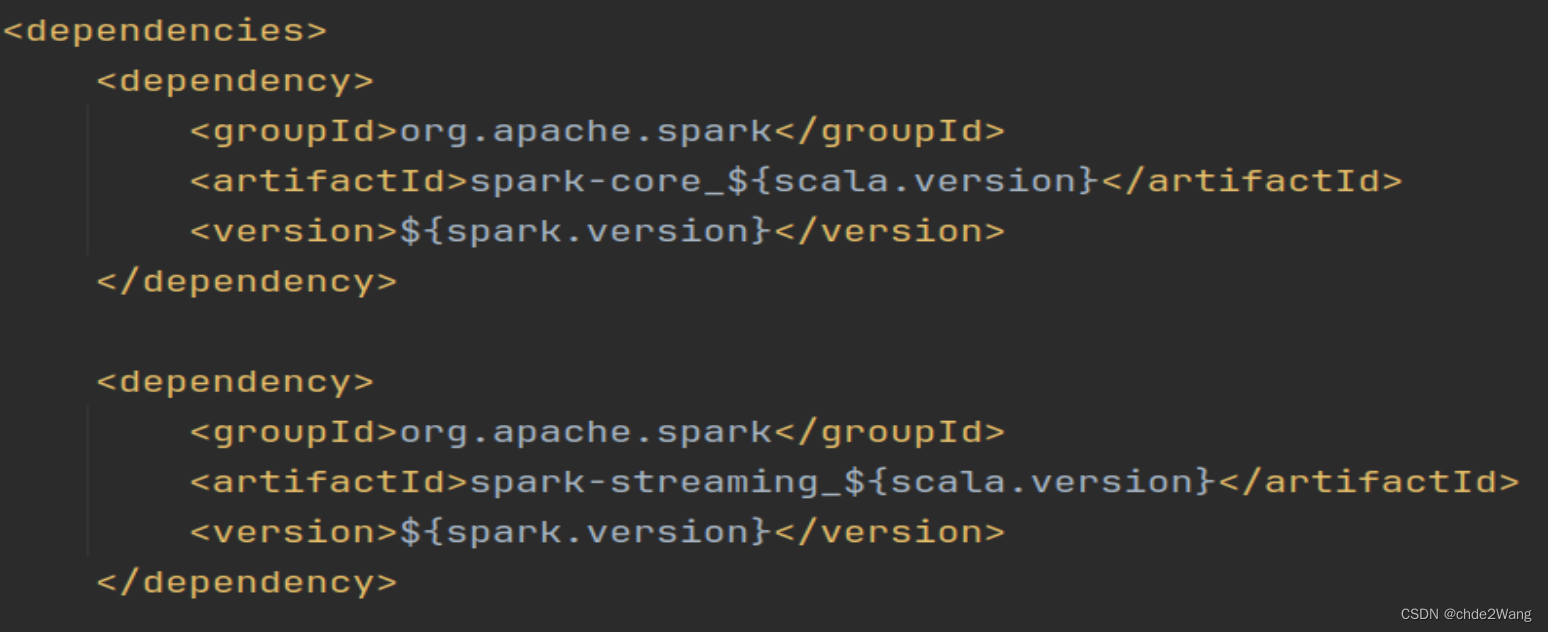

6.在pom.xml中添加如下内容:

然后再pom.xml的右上角点击Load Maven Change,自动下载各个依赖包文件。

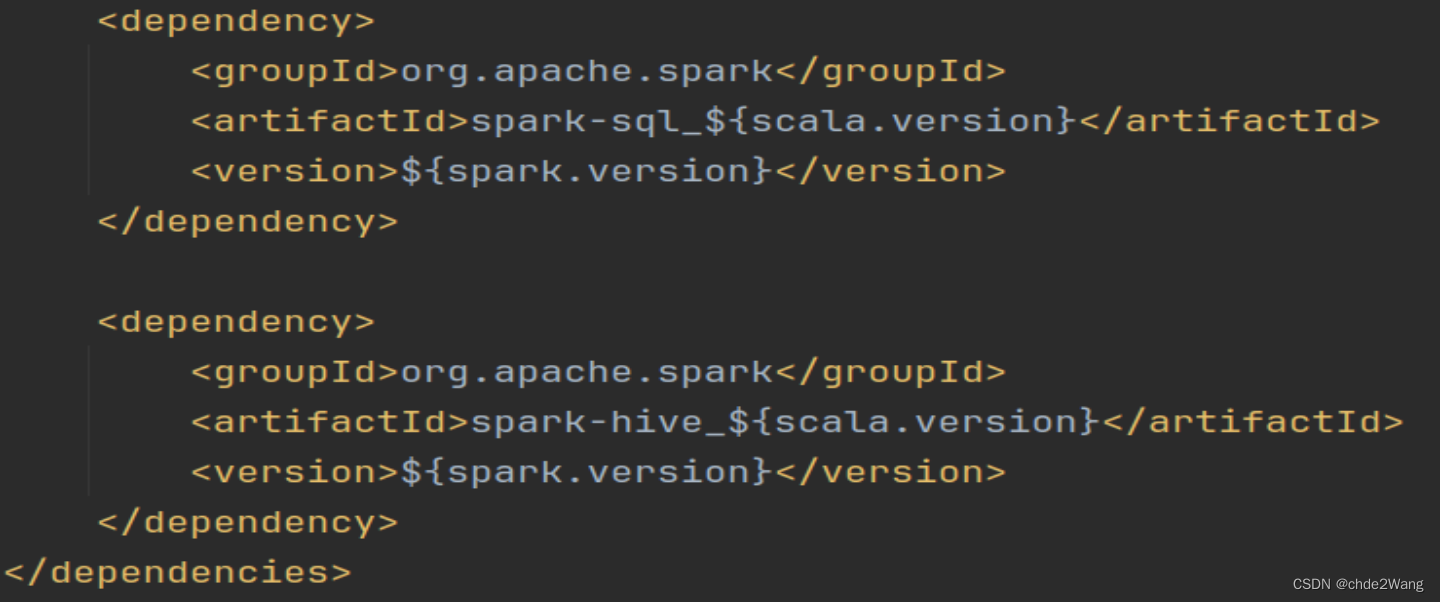

注意scala版本和spark版本可以在cmd窗口输入spark-shell进行查看。

7.此时在WordCount.scala中输入测试代码,及导入spark包不会报错。

参考自:https://www.hangge.com/blog/cache/detail_3313.html

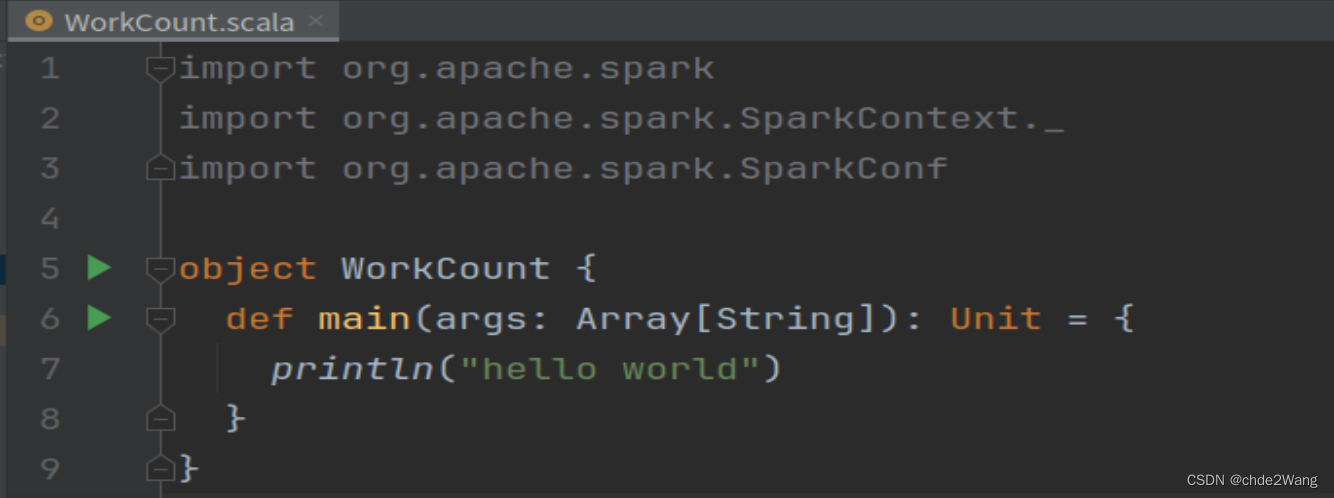

有很多地方需要pom文件导入maven依赖,以给pom文件添加一个spark-core的依赖为例:

在使用IDEA过程中,有很多地方需要pom文件导入maven依赖,以给pom文件添加一个spark-core的依赖为例:

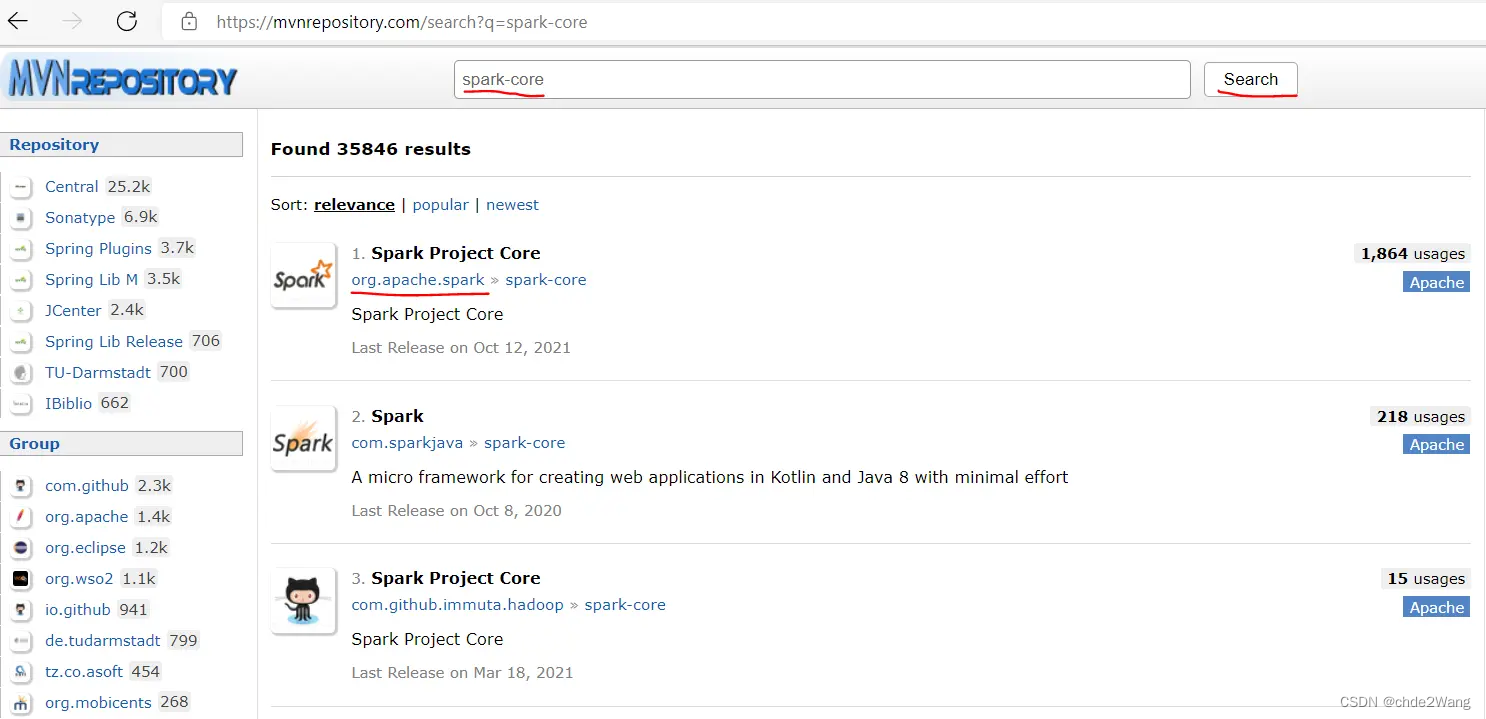

1.找并进入网站:Maven Repository: Search/Browse/Explore (mvnrepository.com)

2.在搜索框输入:spark-core,点击搜索,选择Apache版本的

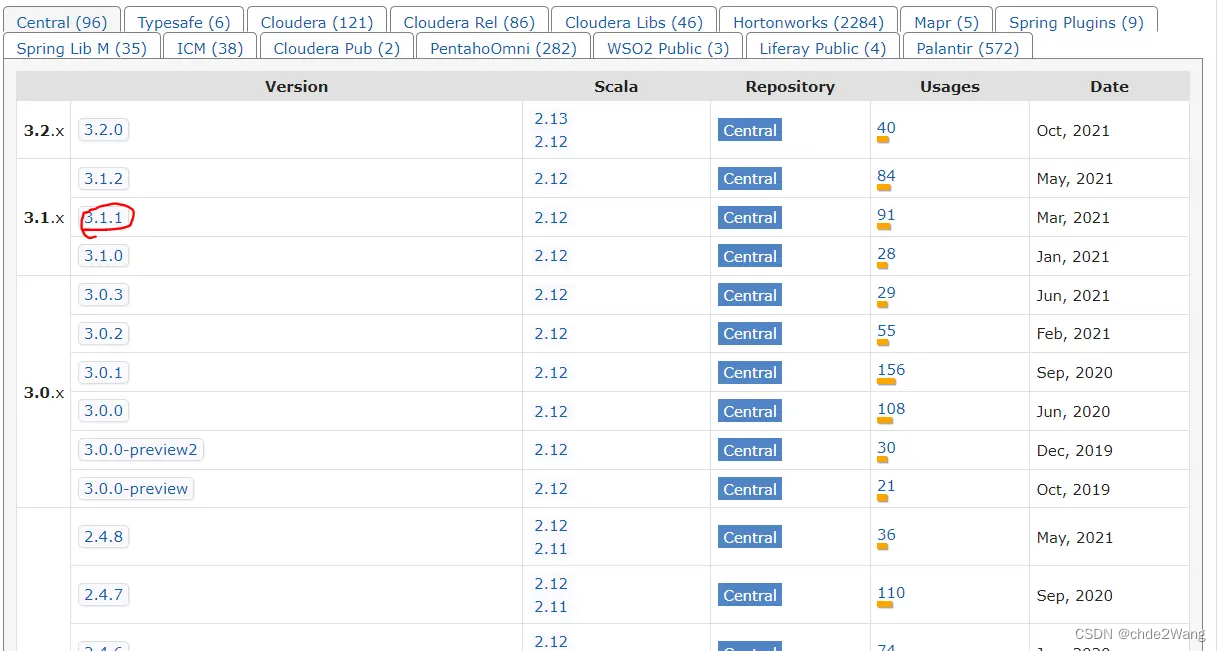

3.找到自己想要的版本(我选的3.1.1),点击version的小方框

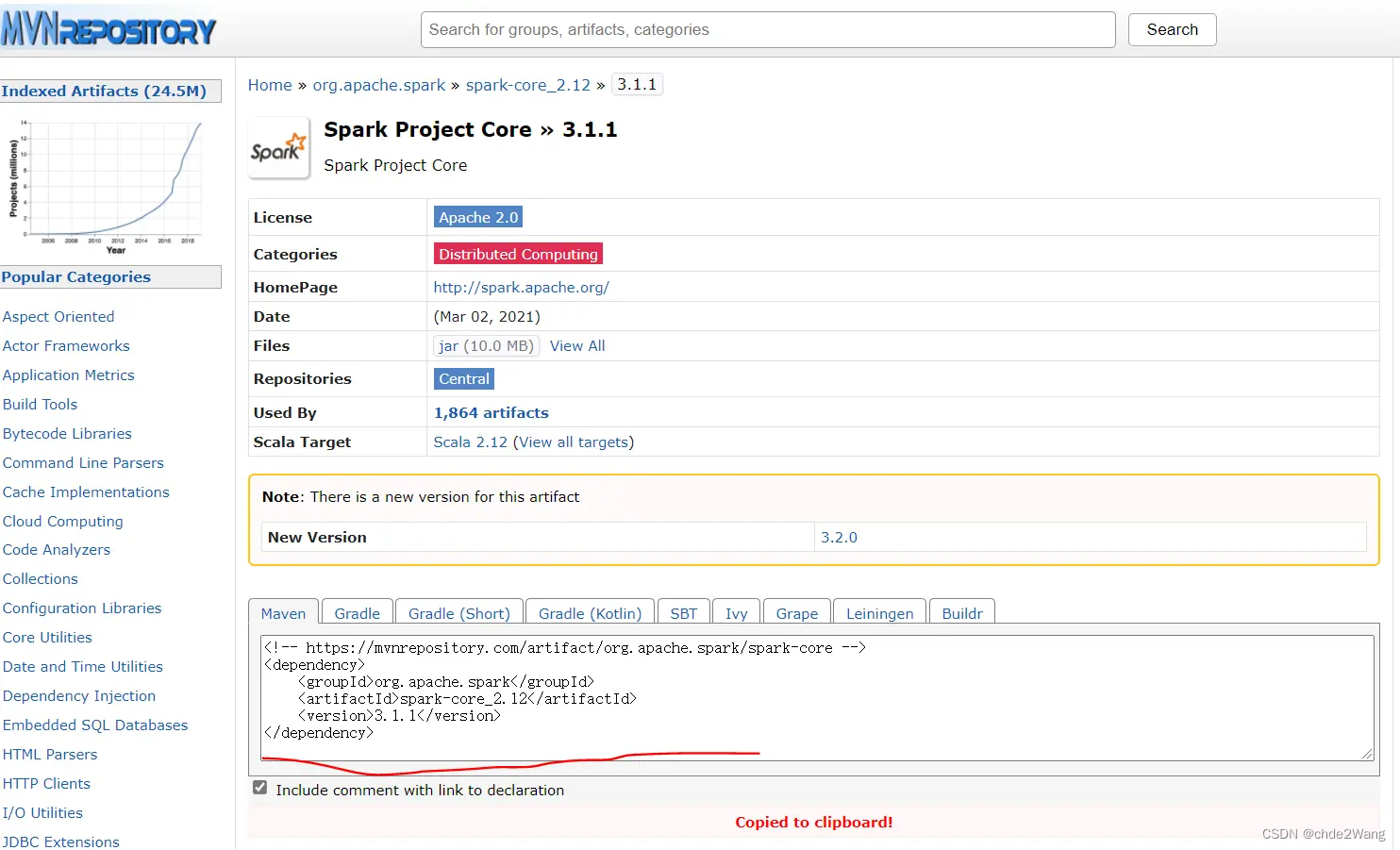

4.进入界面之后,复制下面maven方框的命令

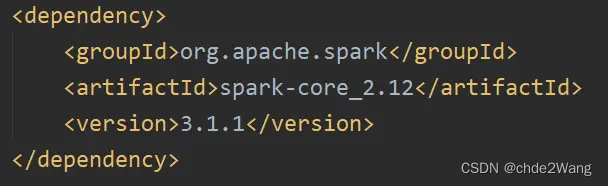

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-core_2.12</artifactId>

<version>3.1.1</version>

</dependency>

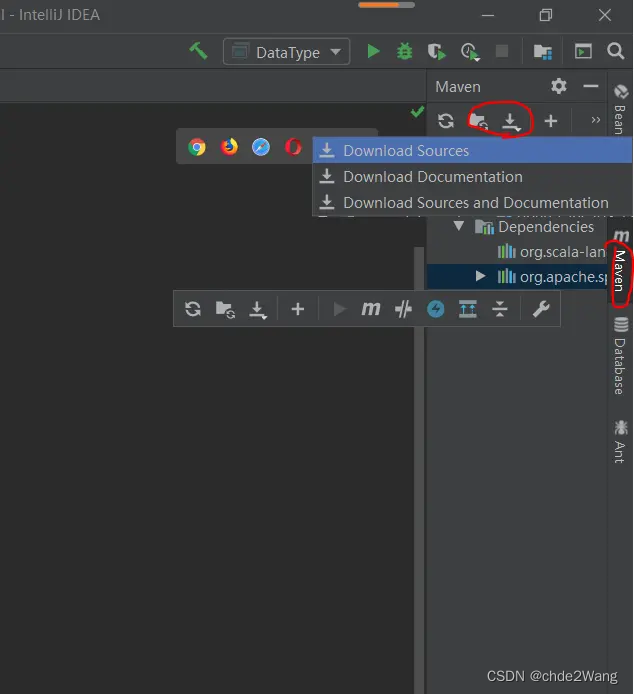

之前如果没有添加过依赖包,字段“org.apache.spark”、“spark-core_2.12”和“3.1.1”是红色的,说明IDEA里面没有该源码包,此时需要下载源码,点开IDEA右侧maven视图,找到下面带有红色波浪线的地方(下图没有是因为我下载过了),然后点击下载符号,选择“Download Sources”下载即可。(Download Sources是下载源码,Download Documentation是下载文档,一般选择下载源码)

其他依赖包、源码按上述操作导入下载即可。

参考自:https://blog.csdn.net/weixin_62535174/article/details/121474333?spm=1001.2014.3001.5501

411

411

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?