决策树(decision tree)

工具:pycharm +anancoda+可视化graphvizs

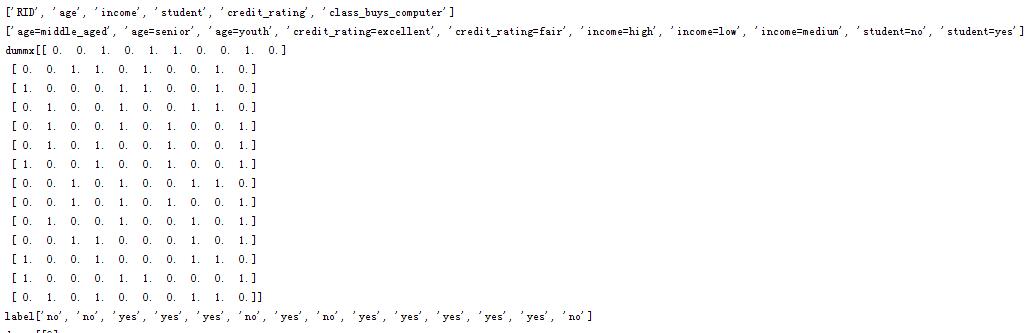

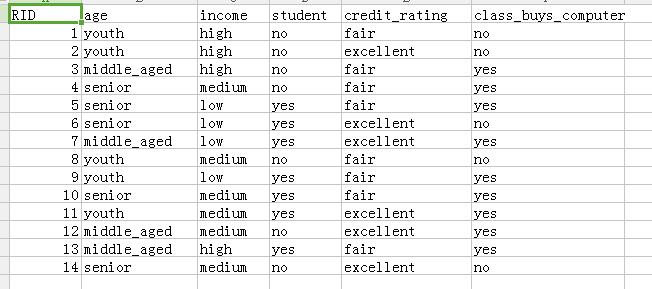

数据表:

代码如下:

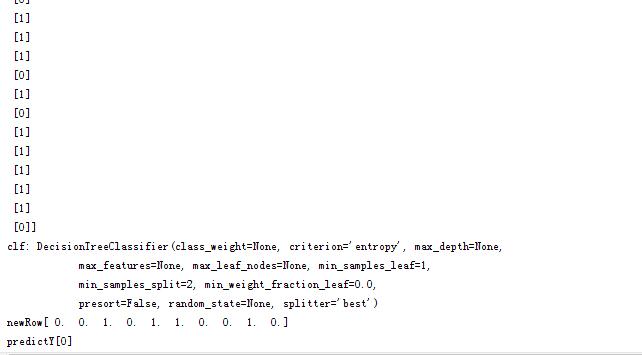

from sklearn.feature_extraction import DictVectorizer #将dict类型的list数据,转换成numpy array import csv #读取CSV文件 from sklearn import tree #导入决策树算法 from sklearn import preprocessing #数据预处理 # 读入数据 allOriginalData=open(r'F:\好好学习\01DTree\AllElectronics.csv') reader=csv.reader (allOriginalData) #用reader来代表所有数据 header=next(reader) #header是指数据的第一行,就是数据的特征 print (header) #因为SK包的数据输入是有一定的要求的,他的输入不能是类别。只能是 0,1。所以要先将数据转化成DICT类型 #然后用DictVextorizer的函数进行转换 featurelist=[]#定义一个存放特征的列表 labellist=[]#定义一个存放标签的列表 for row in reader:#以行遍历所有数据 labellist.append(row[-1])#取出最后一个值,这个值是每条数据的标签 rowDict={}#定义一个字典类型 for i in range(1,len(row)-1): rowDict[header[i]]=row[i]#把每条数据的 特征:属性 插入字典 featurelist.append(rowDict)#把字典插入列表 #print(labellist) #print(featurelist) vec=DictVectorizer()#实例化 dummx=vec.fit_transform(featurelist).toarray()#使用实例内的方法对数据进行转换 print(vec.get_feature_names())#打印出转换后的数据的表头 print("dummx"+str(dummx))#打印出转换后的数据的表值 la=preprocessing.LabelBinarizer()#实例化 dummy=la.fit_transform(labellist)#数据的转换 print("label"+str(labellist)) print("dummy"+str(dummy)) #上面的过程就是把数据都转换成符合格式的数据了 #可以调用sk包中的决策树算法进行分类 clf=tree.DecisionTreeClassifier(criterion='entropy')#使用信息增益的方法 clf=clf.fit(dummx,dummy)#构建决策树 print("clf: " + str(clf))#打印 #输出到TD3.DOT文件中 with open("IDTree.dot", 'w') as f: f = tree.export_graphviz(clf, out_file=f)#要安装可视化工具graphviz #预测数据 oneRow=dummx[0,:]#取出一条数据进行修改 newRow=oneRow oneRow[0]=0 oneRow[2]=1 #进行预测 print("newRow"+str(newRow)) predictY=clf.predict(newRow) print("predictY"+str(predictY))

运行结果:

转化dot文件至pdf可视化决策树(cmd):dot -Tpdf 路径文件.dot

-o =路径文字.pdf

接下来做一个决策树经典例题

小王是一家著名高尔夫俱乐部的经理。但是他被雇员数量问题搞得心情十分不好。某些天好像所有人都來玩高尔夫,以至于所有员工都忙的团团转还是应付不过来,而有些天不知道什么原因却一个人也不来,俱乐部为雇员数量浪费了不少资金。

小王的目的是通过下周天气预报寻找什么时候人们会打高尔夫,以适时调整雇员数量。因此首先他必须了解人们决定是否打球的原因。

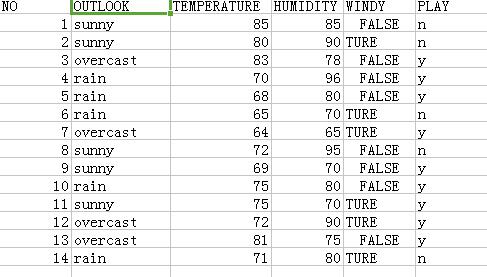

在2周时间内我们得到以下记录:

天气状况有晴,云和雨;气温用华氏温度表示;相对湿度用百分比;还有有无风。当然还有顾客是不是在这些日子光顾俱乐部。最终他得到了14列5行的数据表格

代码如下:

from sklearn.feature_extraction import DictVectorizer import csv from sklearn import tree from sklearn import preprocessing alldata=open(r'F:\Python\example1.csv','r',encoding='utf-8') reader=csv.reader(alldata) headers=next(reader) print(headers) label=[] feature=[] for row in reader: label.append(row[-1]) rowDict={} for i in range(1,len(row)-1 ): if row[i].isdigit() and i>1:#对那些连续的属性值做一个简单的离散化 row[i]= int(int(row[i])/10) rowDict[headers[i]]=row[i] feature.append(rowDict) print(feature) vec=DictVectorizer() dummX=vec.fit_transform(feature).toarray() print(str(dummX)) lb=preprocessing.LabelBinarizer() dummY=lb.fit_transform(label) print(str(dummY)) clf=tree.DecisionTreeClassifier(criterion='gini') clf=clf.fit(dummX,dummY) with open("F:\\Python\\example.dot", 'w') as f: f = tree.export_graphviz(clf, feature_names=vec.get_feature_names(), out_file=f)

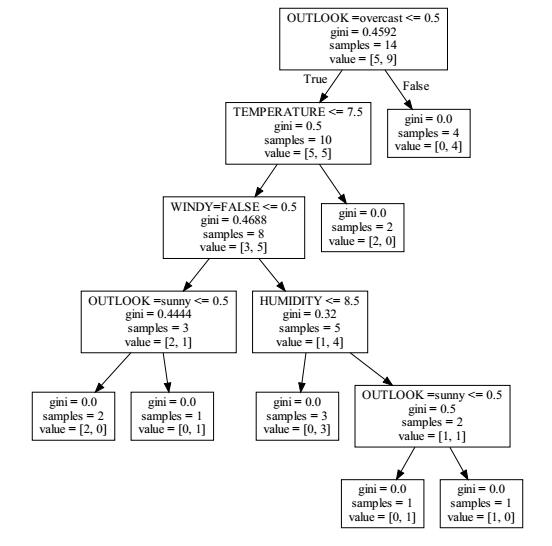

结果图:

关于决策树的理论知识,请大家阅读《机器学习》。剪枝,连续与缺失值,GINI系数。更多知识

280

280

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?