环境:

win10

jdk1.8

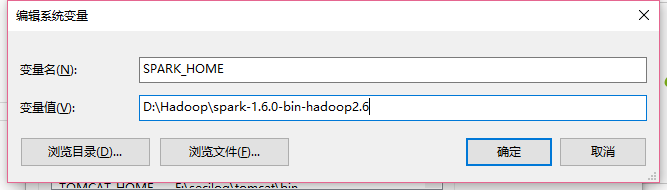

之前有在虚拟机或者集群上安装spark安装包的,解压到你想要放spark的本地目录下,比如我的目录就是D:\Hadoop\spark-1.6.0-bin-hadoop2.6

/**

*注意:

之前在linux环境下安装的spark的版本是spark-2.2.0-bin-hadoop2.6,但后来搭建eclipse的spark开发环境时发现spark-2.2.0-bin-hadoop2.6解压后没有lib文件,也就没有关键的spark-assembly-1.6.0-hadoop2.6.0.jar这个jar包,不知道spark-2.2.0以后怎么支持eclipse的开发,所以我换了spark-1.6.0,如果有知道的大神,谢谢在下边留言指导一下。

**/

下边就简单了,先配置spark的环境变量,先添加一个SPARK_HOME,如下:

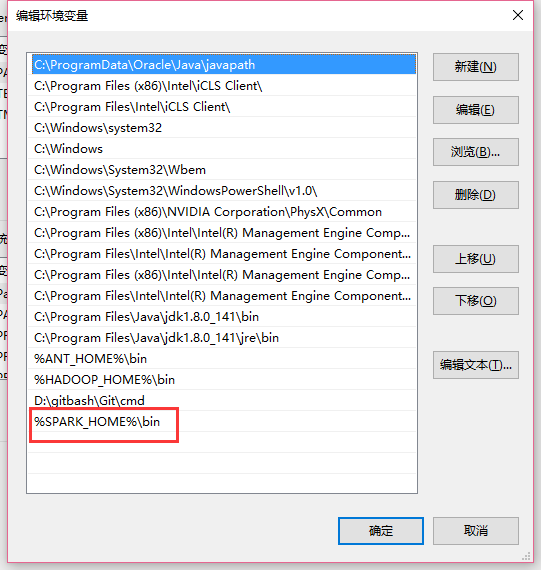

然后把SPARK_HOME配置到path,如下:

这样环境就搭好了,然后就是在eclipse上创建一个普通的java项

本文介绍了如何在Windows 10环境下,使用Eclipse配置Spark Java编译环境。主要内容包括设置SPARK_HOME环境变量,将spark-assembly-1.6.0-hadoop2.6.0.jar导入Java项目,并提供了一个简单的WordCount程序示例。

本文介绍了如何在Windows 10环境下,使用Eclipse配置Spark Java编译环境。主要内容包括设置SPARK_HOME环境变量,将spark-assembly-1.6.0-hadoop2.6.0.jar导入Java项目,并提供了一个简单的WordCount程序示例。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

312

312

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?