中文预训练模型

1 ERNIE

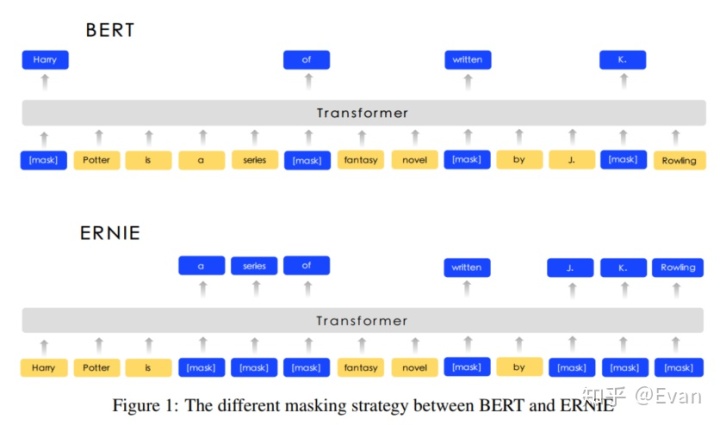

1.1 ERNIE和BERT的不同

ERNIE采用了不同的MASK策略:

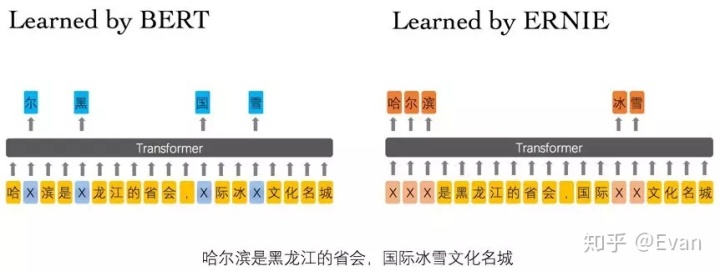

中文的例子:

- Learned by BERT :哈 [mask] 滨是 [mask] 龙江的省会,[mask] 际冰 [mask] 文化名城。

- Learned by ERNIE:[mask] [mask] [mask] 是黑龙江的省会,国际 [mask] [mask] 文化名城。

- ERNIE 通过学习词与实体的表达,使模型能够建模出『哈尔滨』与『黑龙江』的关系,学到『哈尔滨』是『黑龙江』的省会以及『哈尔滨』是个冰雪城市

- ERNIE学习出哈尔滨、黑龙江的完整概念的语义表示,学习出哈尔滨、黑龙江实体间的语义关系

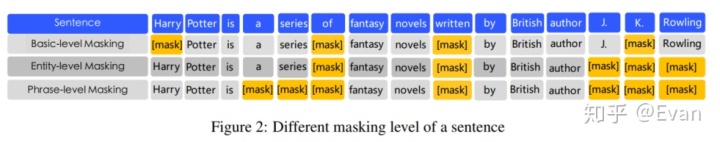

1.2 集成三种MASK策略

- Basic-level:字级别的MASK

- phrase-level:短语(a series of)

- entity-level:人名,地名,组织名,产品名

1.3 多源数据

- Chinese Wikepedia

- Baidu Baike

- Baidu news

- Baidu Tieba

1.4 DLM:Dialogue Language Model

假设:对话数据的学习是语义表示的重要途径, 往往相同回复对应的 Qu

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?