看不懂啊看不懂,一碰到某些问题,我觉着自己的线性代数就算再回炉重造个八百遍都不一定有用

做线性回归过程中碰到了一个很超出我理解能力的东西,QR分解

按照从别处看来的概念来说,它的主要作用是把一个矩阵分解成一个正交矩阵外乘一个上三角矩阵

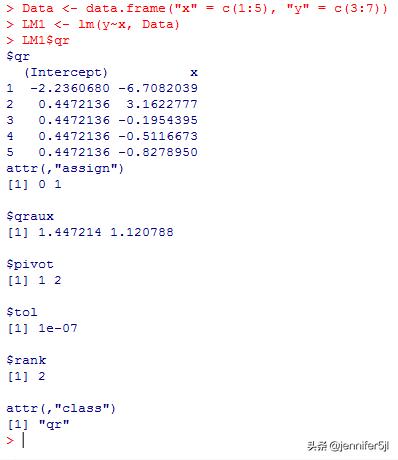

举个例子:

Data

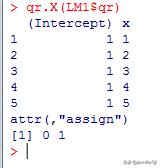

为啥特地用lm而不直接用qr函数呢?是因为线性回归过程并没有直接使用x&y的组合,当咱用qr.X把这个QR分解还原到源数据时,可以看到,它其实增加了一个全部为1的Intercept列

而分解出来的结果可以用qr.Q和qr.R来查看,其中Q是正交矩阵,R是上三角矩阵

#正交矩阵,其转置和本身外乘得单位矩阵I

Q1

<

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1875

1875

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?