本文展示pyspark与mysql、hive、hdfs的连接实例。一是为了纪念:终于走过n个坑,自己搭配好本地hadoop环境;一是为了让还不会pyspark的人有个初步的印象,毕竟数据分析师除了会使用python以外,会使用spark也是很有必要的。

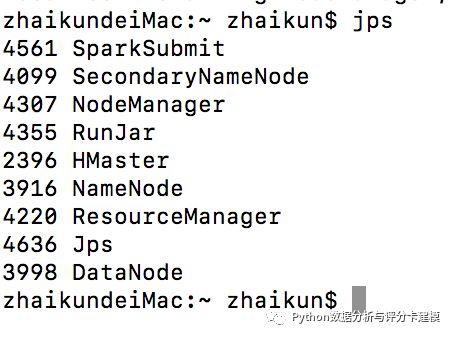

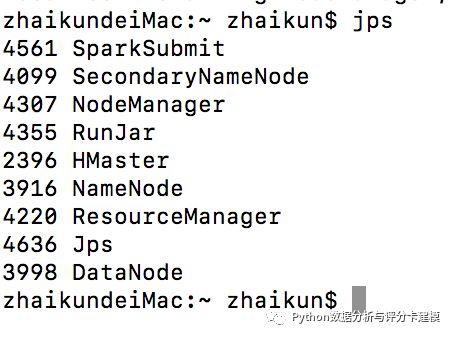

首先jps命令:

该启动的都启动了。

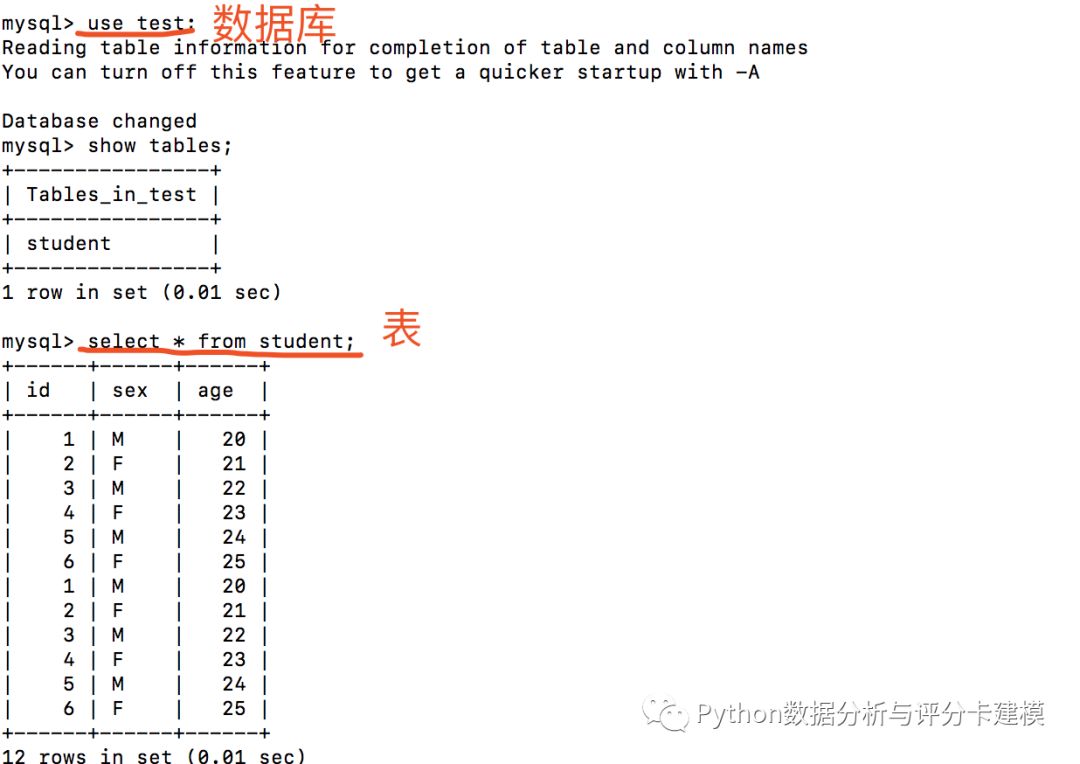

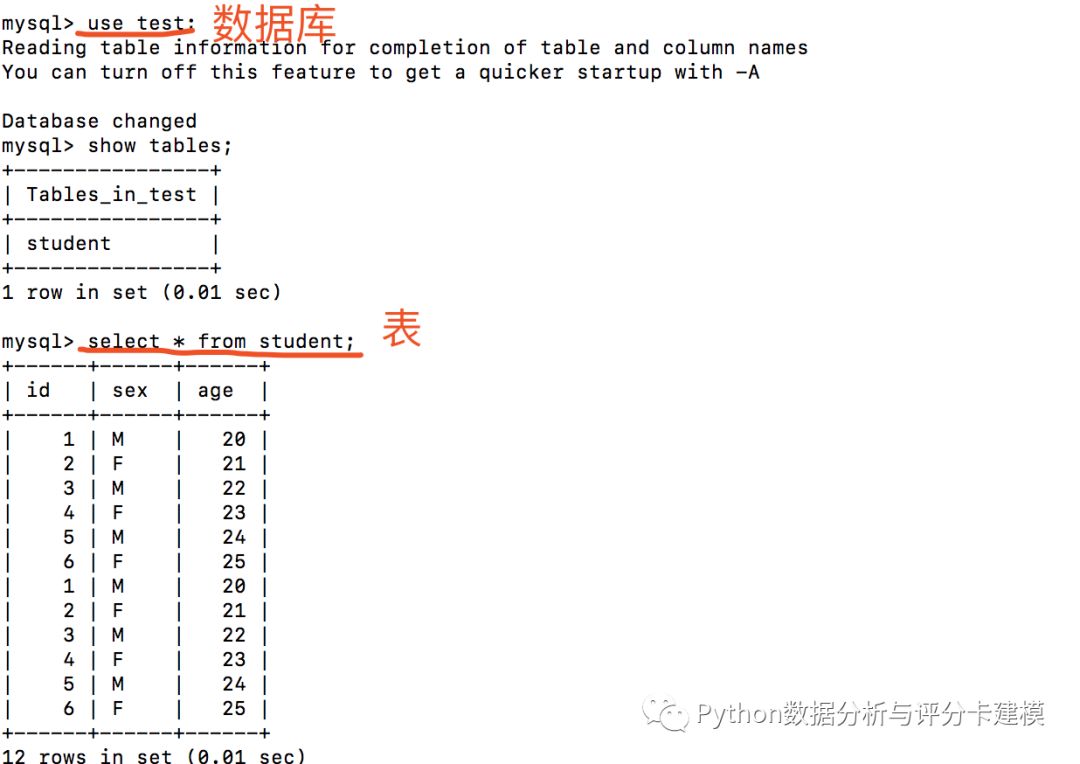

让我们先看看mysql里有什么:

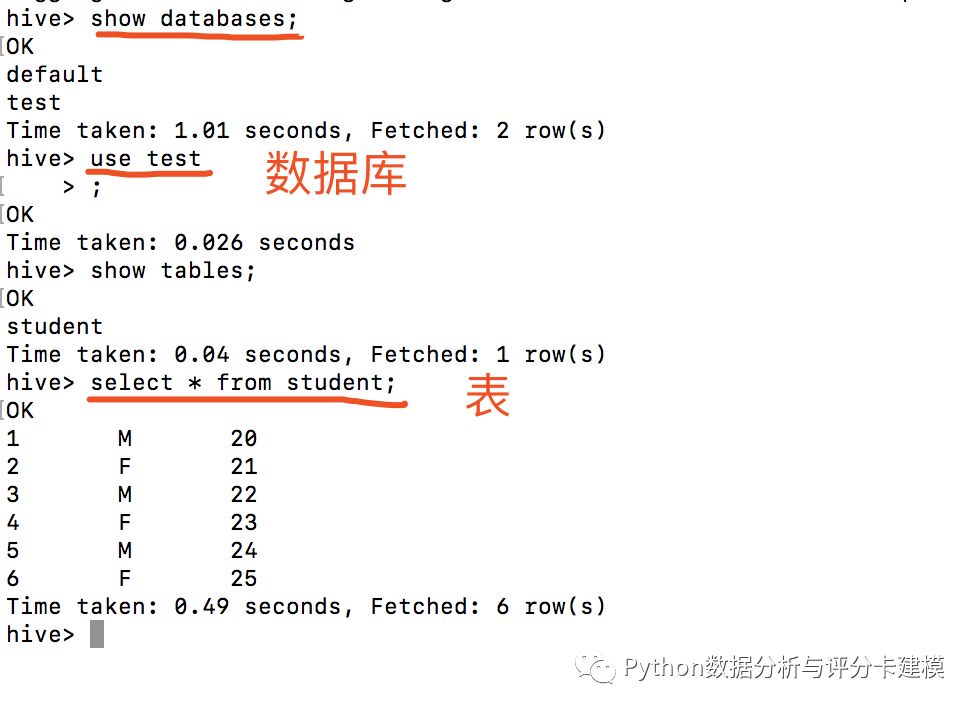

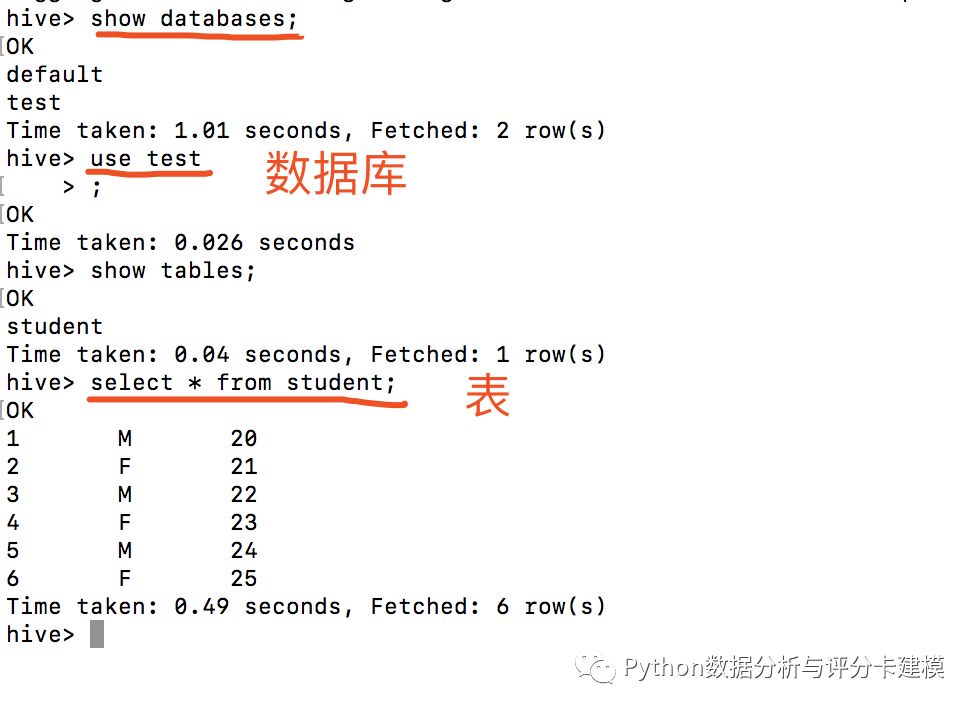

让我们再看看hive:

细心的同学会发现,mysql与hive的sql语句完全一样。

下面开始打开pyspark。我是用notebook作为pyspark的编辑环境的。

本文展示pyspark与mysql、hive、hdfs的连接实例。一是为了纪念:终于走过n个坑,自己搭配好本地hadoop环境;一是为了让还不会pyspark的人有个初步的印象,毕竟数据分析师除了会使用python以外,会使用spark也是很有必要的。

首先jps命令:

该启动的都启动了。

让我们先看看mysql里有什么:

让我们再看看hive:

细心的同学会发现,mysql与hive的sql语句完全一样。

下面开始打开pyspark。我是用notebook作为pyspark的编辑环境的。

4544

4544

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?