机器学习——降维算法-线性判别分析(LDA)

在机器学习领域,线性判别分析(Linear Discriminant Analysis,简称LDA)是一种经典的降维技术,用于在保持数据集类别信息的同时降低数据维度。本文将介绍LDA算法的理论基础、算法过程、优缺点以及与PCA算法的区别与联系,并通过Python实现一个简单的LDA算法示例,最后给出总结。

1. LDA理论基础

线性判别分析的理论基础是在降维的同时,最大化类别之间的差异性,并最小化类别内部的差异性。它通过寻找数据投影方向,使得不同类别的样本在投影后尽可能分开,同一类别的样本尽可能聚集在一起。

2. LDA算法过程

LDA算法的过程如下:

- 计算每个类别的均值向量(class means)。

- 计算类内散度矩阵(within-class scatter matrix)和类间散度矩阵(between-class scatter matrix)。

- 对类间散度矩阵进行特征值分解,得到特征值和特征向量。

- 选择特征值最大的k个特征向量作为投影方向,构建投影矩阵。

- 将数据集投影到选定的投影方向上,实现降维。

3. LDA算法的优缺点

优点:

- 能够最大化类别之间的差异性,保留了数据集的类别信息。

- 在数据集类别明显的情况下,降维后的数据分布更加有利于分类。

缺点:

- 对异常值比较敏感,需要进行数据预处理。

- 在数据集类别重叠较大的情况下,效果可能不佳。

- 计算复杂度较高,对大规模数据集计算量较大。

4. LDA算法和PCA算法的区别与联系

LDA算法和PCA算法都是常用的降维技术,但它们的基本思想和应用场景有所不同:

- PCA是一种无监督学习的降维技术,主要目标是保留数据集的主要信息,而不考虑样本的类别信息。

- LDA是一种有监督学习的降维技术,主要目标是最大化类别之间的差异性,保留数据集的类别信息。

- PCA通过特征值分解得到投影方向,而LDA则是通过计算类间和类内散度矩阵来得到投影方向。

Python实现算法

以下是使用Python实现的简单LDA算法示例:

import numpy as np

import matplotlib.pyplot as plt

class LDA:

def __init__(self, n_components):

self.n_components = n_components

self.projection_matrix = None

def fit(self, X, y):

# 计算每个类别的均值向量

class_means = [np.mean(X[y == i], axis=0) for i in np.unique(y)]

overall_mean = np.mean(X, axis=0)

# 计算类内散度矩阵和类间散度矩阵

within_class_scatter_matrix = np.sum([np.dot((X[y == i] - mean).T, X[y == i] - mean) for i, mean in enumerate(class_means)], axis=0)

between_class_scatter_matrix = np.sum([len(X[y == i]) * np.outer((mean - overall_mean), (mean - overall_mean)) for i, mean in enumerate(class_means)], axis=0)

# 正则化类内散度矩阵

within_class_scatter_matrix += np.eye(X.shape[1]) * 1e-8

# 特征值分解

eigenvalues, eigenvectors = np.linalg.eig(np.linalg.inv(within_class_scatter_matrix).dot(between_class_scatter_matrix))

# 选取前n_components个特征向量作为投影方向

indices = np.argsort(eigenvalues)[::-1][:self.n_components]

self.projection_matrix = eigenvectors[:, indices]

def transform(self, X):

# 将数据投影到主成分上

return np.dot(X, self.projection_matrix)

# 使用示例

# 构造一个二维数据集

X = np.array([[1, 2],

[2, 3],

[3, 4],

[4, 5],

[5, 6]])

y = np.array([0, 0, 1, 1, 1]) # 两类数据

# 创建LDA对象并进行拟合

lda = LDA(n_components=1)

lda.fit(X, y)

# 进行数据转换

transformed_data = lda.transform(X)

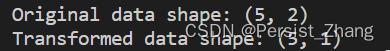

print("Original data shape:", X.shape)

print("Transformed data shape:", transformed_data.shape)

# 绘制结果图

plt.scatter(transformed_data[:, 0], np.zeros(transformed_data.shape[0]), c=y, cmap='viridis')

plt.title('LDA Results')

plt.xlabel('Principal Component 1')

plt.ylabel('Class')

plt.show()

以上代码实现了一个简单的LDA类,包括fit方法用于拟合数据和计算投影矩阵,以及transform方法用于将数据投影到主成分上。

总结

本文介绍了LDA算法的理论基础、算法过程、优缺点,以及与PCA算法的区别与联系。LDA算法能够有效地提取数据集的主要特征,并保留了数据集的类别信息,在某些情况下可以更好地适用于分类任务。通过Python实现了一个简单的LDA算法示例,展示了LDA的基本原理和应用。在实际应用中,我们可以根据具体问题的需求选择合适的降维方法来处理数据。

本文详细阐述了线性判别分析(LDA)的理论背景、步骤,探讨了其与PCA的差异,以及在分类任务中的优势。通过Python示例展示了如何使用LDA进行数据降维和可视化。

本文详细阐述了线性判别分析(LDA)的理论背景、步骤,探讨了其与PCA的差异,以及在分类任务中的优势。通过Python示例展示了如何使用LDA进行数据降维和可视化。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?