逻辑回归和线性回归都是通过把一系列数据点预测计算出一条合适的“线”,将新的数据点映射到这条预测的“线”上,继而做出预测。

线性回归

线性回归预测的是直线,参数计算使用最小二乘法。

对于定义域x(-∞,+∞)上的值域y也是(-∞,+∞),这样的一个很明显的不合理处是,当我们加入惩罚项时,那些离群点容易受到极大的影响。

假如使用线性回归对{0,1}二分类问题做预测,则一个真值为1的样本,其预测值为100,那么将会对其产生很大的惩罚,这也和实际情况不符合,更大的预测值说明为1的可能性越大,而不应该给予越大的惩罚。

而且对于分类问题来说,在新加一组数据之后,线性预测的准确率通常容易降低很多,所以线性回归更适合用来预测数据,而逻辑回归则更适合做分类。

逻辑回归

线性回归预测的是“S线”,损失函数是最大似然,参数计算使用梯度下降方法。

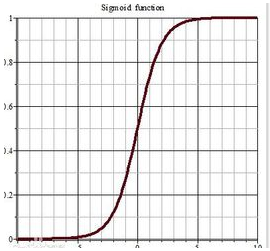

对于定义域x(-∞,+∞)上的值域y是(0,1),这样就能通过一个sigmoid函数把所有的数据都映射到(0,1)区间。

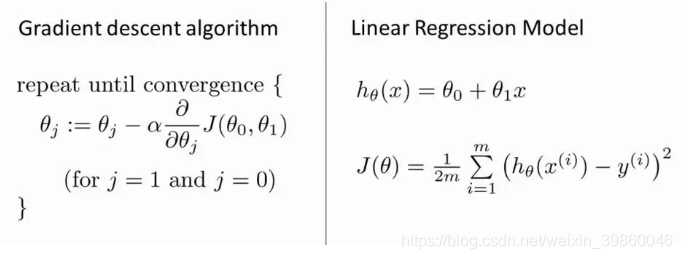

之所以线性回归可以用最小二乘法究其原因是其函数简单,求导可得参数值。而逻辑回归加入sigmoid函数后,函数复杂不易直接求解所以采用梯度下降算法,参考图示:

更多关于逻辑回归中使用最大似然方式来求解模型的参数的数学推导可以参考这篇文章

梯度下降、线性回归算法对比

逻辑回归与线性回归

| 线性回归 | 逻辑回归 |

|---|---|

| 主要用来做预测 | 主要用来做分类 |

| 拟合函数 | 预测函数 |

| 求参:最小二乘法 | 求参:梯度下降 |

1776

1776

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?