注:欢迎关注本人分享有关个性化推荐系统公众号:Tiany_RecoSystem

最近看一些基于LSTM网络的NLP案例代码,其中涉及到一些input_size, num_hidden等变量的时候,可能容易搞混,首先是参照了知乎上的一个有关LSTM网络的回答https://www.zhihu.com/question/41949741, 以及github上对于LSTM比较清晰的推导公式http://arunmallya.github.io/writeups/nn/lstm/index.html#/3, 对于lstm cell中各个门处理,以及隐含层的实际物理实现有了更深刻的认识,前期一些理解上还模糊的点 也在不断的分析中逐渐清晰。

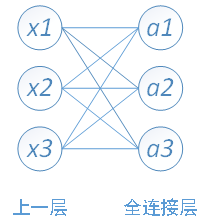

首先,在DNN网络中全连接是一个非常重要的概念,在整个深度网络中,会存在多个全连接层,因此我们先给出一个简单的全连接网络结构图以及对应的矩阵计算公式,能够清晰的明白全连接网络的计算原理,对我们在理解输入向量维度与隐含层维度之间的关系有一定的帮助, 首先给出一个简单的全连接结构图:

其中,x1、x2、x3为全连接层的输入,a1、a2、a3为输出,那么该全连接网络对应的计算公司可推到如下:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

4265

4265

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?