Exploring Self-attention for Image Recognition

Exploring Self-attention for Image Recognitionarxiv.org一 文章出发点

现在哪哪都用的注意力。

文章认为传统的卷积可分为,特征聚集(空间卷积)+特征变化(通道卷积),实际也就是分通道独立卷积的思想。而且特征聚集中3*3卷积所考虑的空间大小固定,所以作者也提出将传统卷积解耦,然后将特征聚集的本质理解为:局部区域内的像素特征加权求和。所以作者提出利用注意力机制自动生成这个权(空间卷积参数),也就是以前的卷积参数,从而实现了增加所考虑的局部区域大小,而又不增加参数的目标。

二 文章怎么做

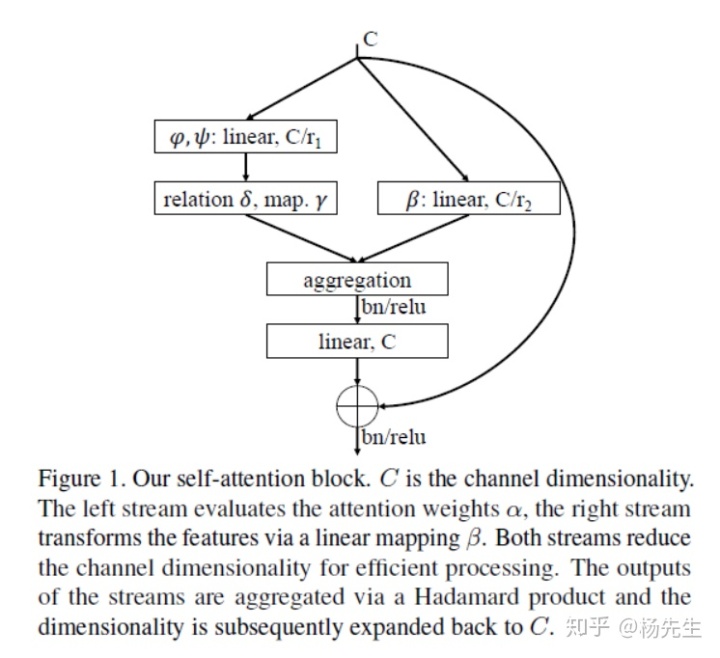

文章通篇只有一张图,如下,也就是文章的基本卷积模块

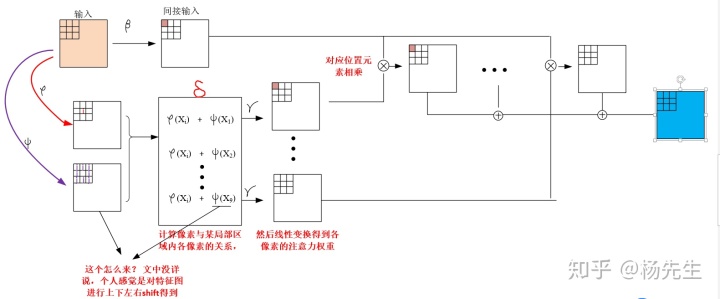

为了便于理解,我这里将它画成了如下形式。图中某些箭头上方的符号都可以简单理解为一个类似1*1卷积层的操作。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

9万+

9万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?