前言

其实看了这么久的SVM也没有在任何一个实验中真实确定地作为最终方法使用过,因为。。。。这玩意效果真的很差很差很差!!!!!

但是直觉告诉我有一天我会遇到我的如意文章,踏着SVM来找我,所以我还是坚持继续好好学下去,这应该是在上了一学期《模式识别》和一学期《矩阵分析》以后再回来小推一下,理解更深刻了。。。。吧?

本章接着之前的SVM直观理解继续深入,有兴趣的同学可以回去看看:

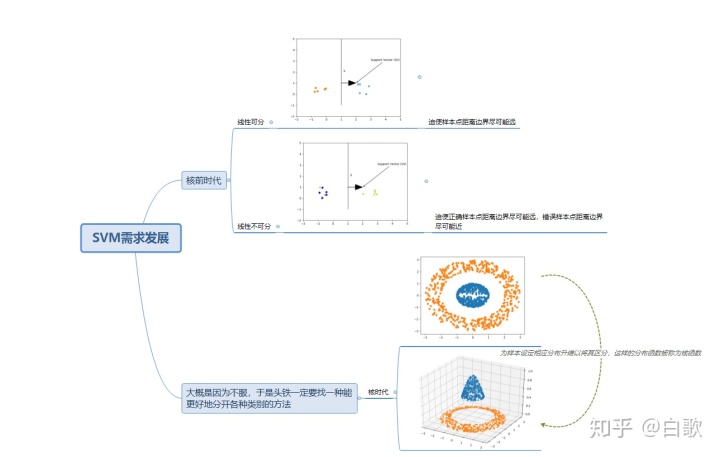

白歌:帮助理解SVM+RBF的代码(python)zhuanlan.zhihu.comemm稍微运行一下感受一下就可以回来了,然后这里是SVM随需求发展而增加内容的。。。流程图?帮助对SVM中涉及到的各个部件大致有啥用有个了解呐

支持向量

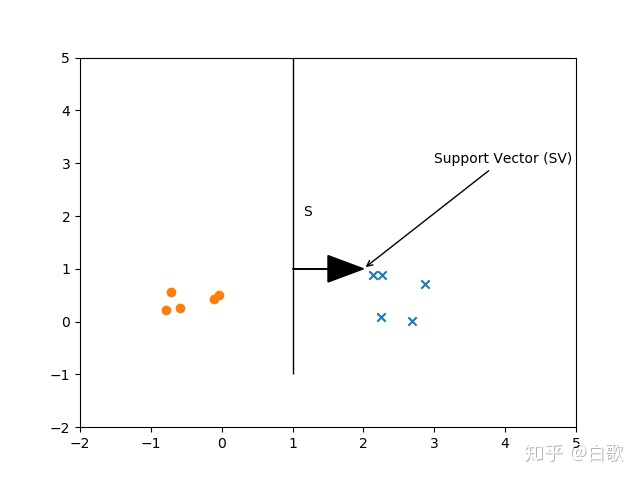

首先SVM的全称是Support Vector Machine,那么支持向量(Support Vector)是什么呢?你看:

图中分类边界S的Support Vector就是支持向量啦~而支持向量所决定的直线(超平面,具体超平面是个啥不懂的话就自行查一下啦)就是两个类的分类边界,至于一个法向量为何能决定一个超平面,请看:

法向量决定超平面

设法向量SV坐标为

可知超平面上的点的坐标为

即:

正好法向量与超平面垂直,而由上式可知,法向量的元素即为超平面的系数。所以SVM求得了支持向量,即为求得了支持向量机的分类边界。

线性可分问题

还是那张图,你看:

假设样本点为

该投影长度也即为点

令:

又由于

同理,

此时,可知,当||SV||越小,则

此时

其中

线性不可分问题

先看之前提到的拉格朗日方程,其中,只有当

所以这种情况下拉格朗日方程更多地是被当做SVM的损失函数使用,于是就被转换为:

其中,

交叉熵定义如下:

交叉熵(Cross Entropy)是Shannon信息论中一个重要概念,主要用于度量两个概率分布间的差异性信息——百度百科

公式如下:

具体为啥这个函数能反映概率分布的差异性,还没仔细研究,就假装很懂地说,它就这样吧,其中

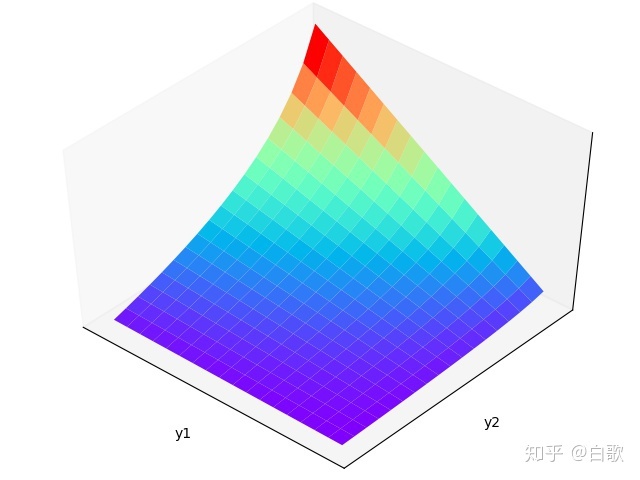

由图可知,在每一个水平线上,

下一篇:SVM对偶问题

921

921

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?