1. 回顾特征值和特征向量

首先回顾下特征值和特征向量的定义:

其中,A是一个

求出特征值和特征向量有什么好处呢?就是我们可以将矩阵A特征分解。如果我们求出了矩阵A的n个特征值

其中, W 是这 n 个特征向量所组成的

题外延伸------矩阵压缩:![]()

那么:![]()

假设A为维矩阵,如果正常表示矩阵A共需使用

个元素,如果将取得的特征值

按从大到小排序,即

,则将A的压缩表示为

,即最少只需要

个元素。

注意到要进行特征分解,矩阵A必须为方阵。

那么如果A不是方阵,即行和列不相同时,我们还可以对矩阵进行分解吗?答案是可以,此时我们的SVD登场了。

2. SVD推导

Step1:矩阵分解

假如 A 为

证明:1)对称性:对称性

2)正定性:正定性

对于矩阵A,有

因此,

根据上述公式,有

其中,

从而得出:

Step2:矩阵计算

得到矩阵A的表示后,我们应该如何计算向量 U 和 V 呢?继续往下面分析:

首先计算出A的转置

利用上式可以得到,

同理可得

可以得到

题外延伸-----矩阵(图像)压缩:

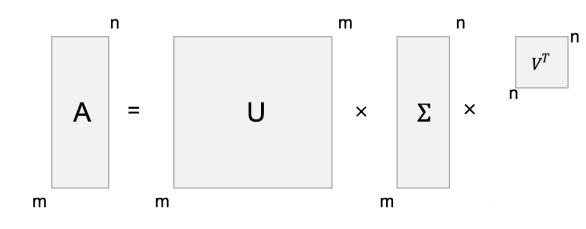

一个的矩阵A经SVD分解后,可以写成如下形式:

![]()

假设A为维矩阵,在没有压缩时表示矩阵A共需要

个元素。如果将取得的特征值按从大到小排序,即

,则A的压缩最小压缩表示为

,即需要

个元素。 当压缩储存量为

时,误差为

![]()

例题讲解

我们举一个简单的例子讲解矩阵时如何进行奇异值分解的。定义矩阵A为:

首先求出

进而求出

接着求出 AA^T 的特征值和特征向量:

利用

也可以用

最终得到矩阵A的奇异值分解为:

SVD的一些性质

对于奇异值,他跟我们特征分解中的特征值类似,在奇艺置矩阵中也是按照从大到小排列,而且奇异值的减少特别快,在很多情况下,前10%甚至1%的奇异值就占了全部的奇异值之和的99%以上的比例。也就是说,我们也可以用最大的k个奇异值和对应的左右奇异向量来近似描述矩阵(与前面描述的题外延伸之矩阵压缩类似),由于这个重要的性质,SVD也可以用于PCA降维,来做数据压缩和去噪,也可以用于推荐算法,将用户和喜好对应的矩阵做特征分解,进而得到隐含的用户需要来做推荐。同时也可以用于NLP中的算法,比如潜在语义索引(LSI)。

参考:1. https:// zhuanlan.zhihu.com/p/29 846048

参考:2. https://www. csuldw.com/2017/03/09/2 017-03-09-svd/

36万+

36万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?