R-Bert:使用Bert进行关系抽取

时间:2019

使用数据是SemEval2010(带有方向),不涉及远程监督噪声数据。

使用数据是SemEval2010(带有方向),不涉及远程监督噪声数据。

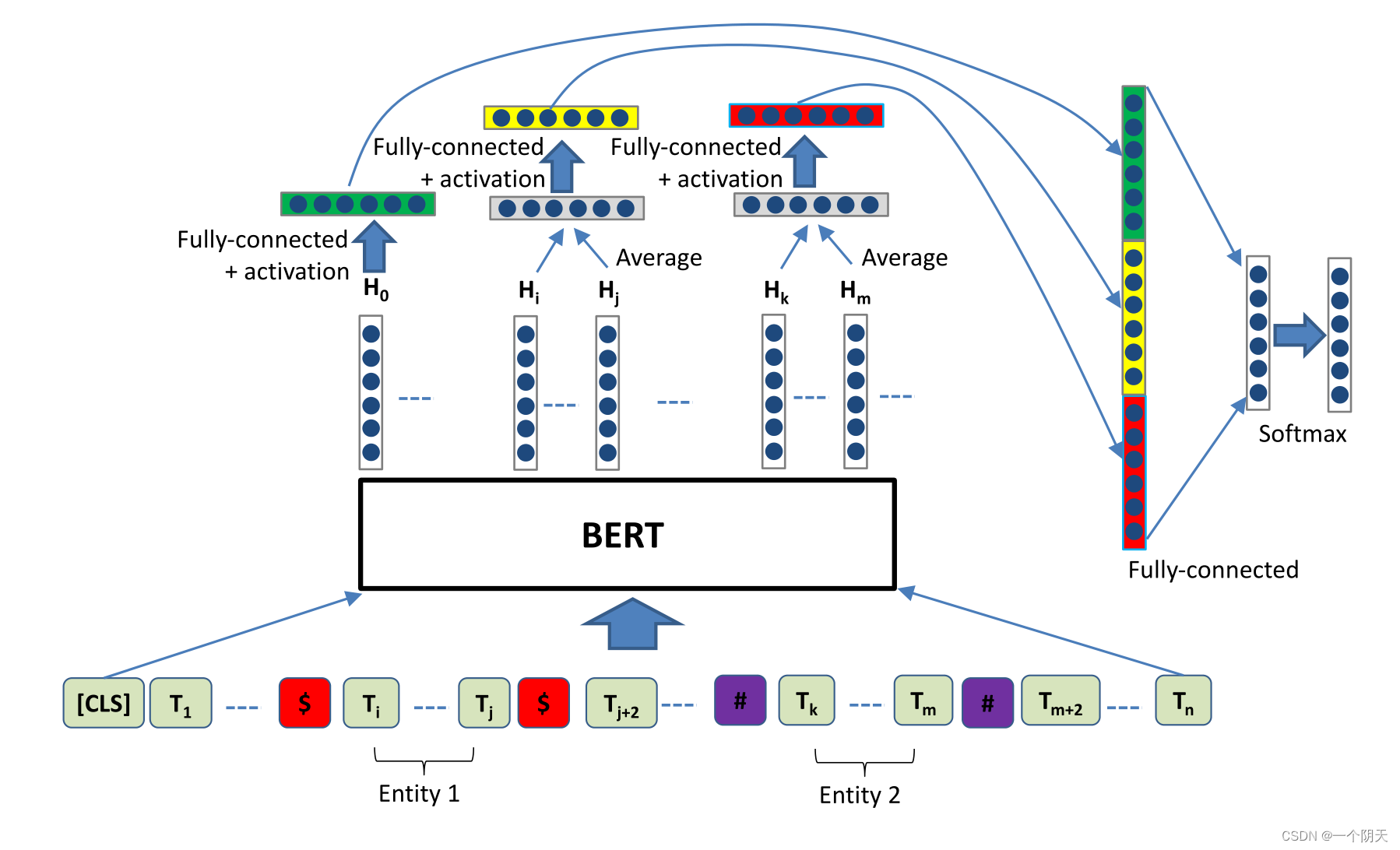

方法:在每个句子开头添加[CLS]标志,在分类任务中,经过Bert处理后,其最终隐藏状态可作为句子表示。强调关系抽取任务的实体本质,捕获实体的位置信息,在每个头实体前后添加特殊符号$,在每个尾实体前后添加特殊符号#,特殊符号作为token进行处理。

给定一个带有实体 e1 和 e2 的句子 s,假设它从 BERT 模块输出的最终隐藏状态为 H。假设向量 Hi 到 Hj 是实体 e1 的 BERT最终隐藏状态向量,Hk 到 Hm 是来自实体 e2 的 BERT最终隐藏向量。应用平均操作来获得两个目标实体中的每一个的向量表示。ÿ

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

484

484

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?