目标检测系统的标杆 YOLO 系列,再次获得了重磅升级。

自今年 2 月 YOLOv9 发布之后, YOLO(You Only Look Once)系列的接力棒传到了清华大学研究人员的手上。

上周末,YOLOv10 推出的消息引发了 AI 界的关注。它被认为是计算机视觉领域的突破性框架,以实时的端到端目标检测能力而闻名,通过提供结合效率和准确性的强大解决方案,延续了 YOLO 系列的传统。

论文地址:https://arxiv.org/pdf/2405.14458

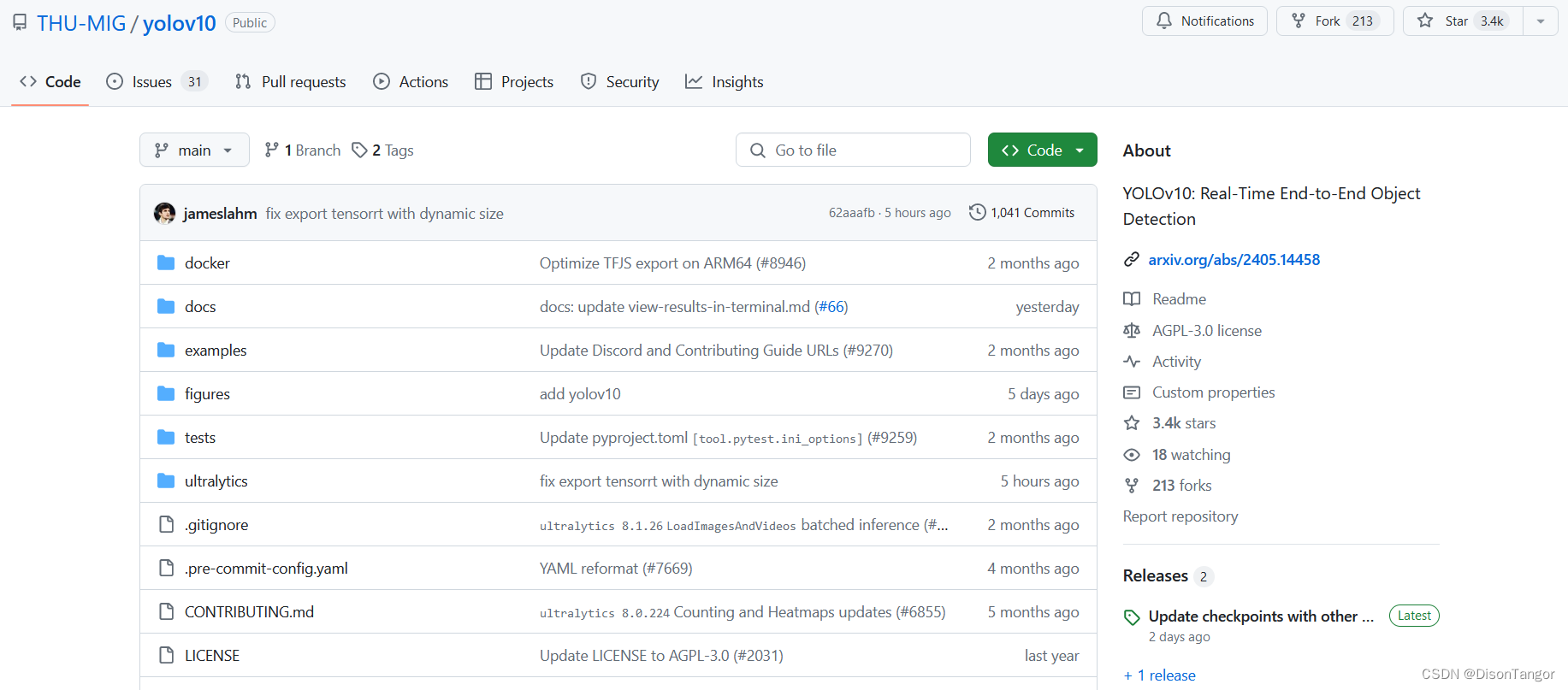

项目地址:https://github.com/THU-MIG/yolov10

YOLO 因为性能强大、消耗算力较少,一直以来都是实时目标检测领域的主要范式。该框架被广泛用于各种实际应用,包括自动驾驶、监控和物流。其高效、准确的物体检测能力使其成为实时识别行人和车辆等任务的理想选择;在物流方面,它有助于库存管理和包裹跟踪,通过 AI 能力帮助人们在很多工作上提高了效率。

几年来,研究人员对 YOLO 的架构设计、优化目标、数据增强策略等进行了探索,取得了显著进展。然而,后处理对非极大值抑制(NMS)的依赖阻碍了 YOLO 的端到端部署,并对推理延迟产生不利影响。此外,YOLO 中各个组件的设计缺乏全面彻底的检查,导致明显的计算冗余并限制了模型的能力。

YOLOv10 的突破就在于从后处理和模型架构方面进一步提升了 YOLO 的性能 - 效率边界。

为此,研究团队首次提出了 YOLO 无 NMS 训练的一致双重分配(consistent dual assignment),这使得 YOLO 在性能和推理延迟方面有所改进。

研究团队为 YOLO 提出了整体效率 - 准确率驱动的模型设计策略,从效率和准确率两个角度全面优化 YOLO 的各个组件,大大降低了计算开销并增强了模型能力。

大量实验表明,YOLOv10 在各种模型规模上都实现了 SOTA 性能和效率。例如,YOLOv10-S 在 COCO 上的类似 AP 下比 RT-DETR-R18 快 1.8 倍,同时参数数量和 FLOP 大幅减少。与 YOLOv9-C 相比,在性能相同的情况下,YOLOv10-B 的延迟减少了 46%,参数减少了 25%。

而且此次的Yolo pt也发布于 Huggingface,但是依旧是沿用ultralytics 工具包,而不是transformer的ViT。

pip install supervision git+https://github.com/THU-MIG/yolov10.git

from ultralytics import YOLOv10

import supervision as sv

import cv2

MODEL_PATH = 'yolov10n.pt'

IMAGE_PATH = 'dog.jpeg'

model = YOLOv10(MODEL_PATH)

image = cv2.imread(IMAGE_PATH)

results = model(source=image, conf=0.25, verbose=False)[0]

detections = sv.Detections.from_ultralytics(results)

box_annotator = sv.BoxAnnotator()

category_dict = {

0: 'person', 1: 'bicycle', 2: 'car', 3: 'motorcycle', 4: 'airplane', 5: 'bus',

6: 'train', 7: 'truck', 8: 'boat', 9: 'traffic light', 10: 'fire hydrant',

11: 'stop sign', 12: 'parking meter', 13: 'bench', 14: 'bird', 15: 'cat',

16: 'dog', 17: 'horse', 18: 'sheep', 19: 'cow', 20: 'elephant', 21: 'bear',

22: 'zebra', 23: 'giraffe', 24: 'backpack', 25: 'umbrella', 26: 'handbag',

27: 'tie', 28: 'suitcase', 29: 'frisbee', 30: 'skis', 31: 'snowboard',

32: 'sports ball', 33: 'kite', 34: 'baseball bat', 35: 'baseball glove',

36: 'skateboard', 37: 'surfboard', 38: 'tennis racket', 39: 'bottle',

40: 'wine glass', 41: 'cup', 42: 'fork', 43: 'knife', 44: 'spoon', 45: 'bowl',

46: 'banana', 47: 'apple', 48: 'sandwich', 49: 'orange', 50: 'broccoli',

51: 'carrot', 52: 'hot dog', 53: 'pizza', 54: 'donut', 55: 'cake',

56: 'chair', 57: 'couch', 58: 'potted plant', 59: 'bed', 60: 'dining table',

61: 'toilet', 62: 'tv', 63: 'laptop', 64: 'mouse', 65: 'remote', 66: 'keyboard',

67: 'cell phone', 68: 'microwave', 69: 'oven', 70: 'toaster', 71: 'sink',

72: 'refrigerator', 73: 'book', 74: 'clock', 75: 'vase', 76: 'scissors',

77: 'teddy bear', 78: 'hair drier', 79: 'toothbrush'

}

labels = [

f"{category_dict[class_id]} {confidence:.2f}"

for class_id, confidence in zip(detections.class_id, detections.confidence)

]

annotated_image = box_annotator.annotate(

image.copy(), detections=detections, labels=labels

)

cv2.imwrite('annotated_dog.jpeg', annotated_image)

3770

3770

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?