近日,香港大学与字节跳动合作研发的基于流动的视频生成模型 Goku 正式发布。该模型利用先进的生成算法,可以根据文本提示生成高质量的视频内容,极大地丰富了数字艺术的表现形式。

为了展示 Goku 模型的强大功能,研究团队制作了一系列精彩的视频示例,这些示例不仅展示了模型的技术能力,也展现了其在创意表现上的无限潜力。

Goku 模型的特点在于其高效的生成速度和图像质量。通过使用大量的数据训练,Goku 可以生成包括动画、自然风光、动物行为等多种场景。研究人员使用了原版的 MovieGenBench 提示进行测试,确保了演示效果的一致性和公平性。

Goku 还支持直接生成虚拟数字人视频。Goku+将文本转换为超现实的人类视频,明显优于现有的方法。特别是,它可以生成超过20秒的视频,以稳定的手部动作和人类受试者极具表现力的面部和身体动作为特色。

另外支持从产品图片生成和人物互动视频,保持产品样式以及生成产品展示视频,可以从文本生成广告视频等功能。

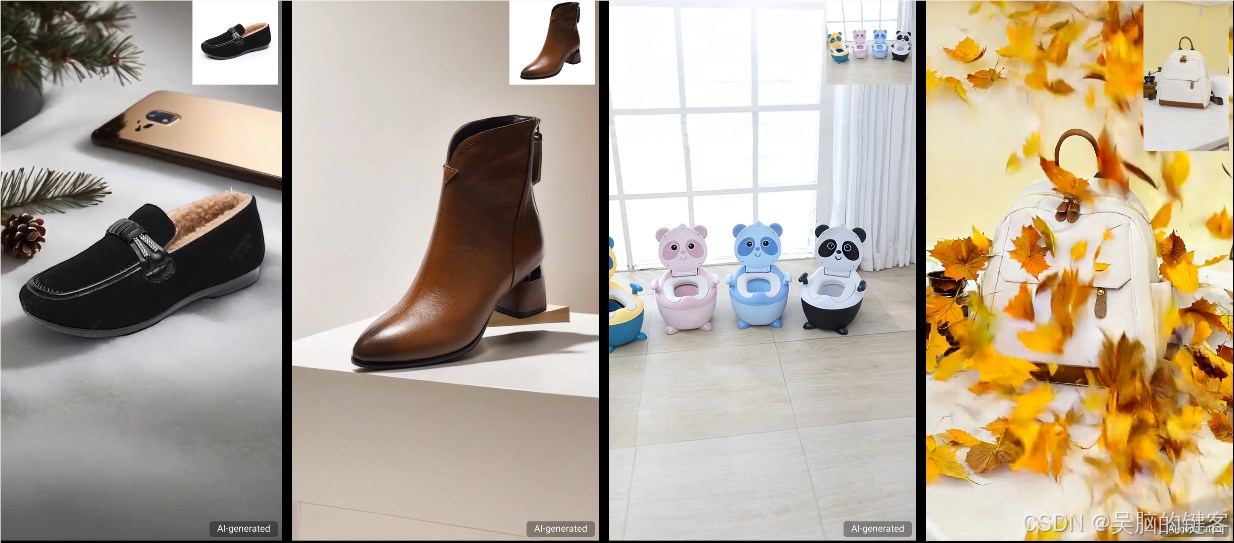

如下图:Goku+将产品图片转化为引人入胜的视频片段,确保端到端的优化。这一过程增强了您的营销材料的吸引力和有效性。

如下图:制作逼真且极具吸引力的视频,专门展示特定产品。这些视频有效地捕捉了产品的精髓,提高了观众的参与度和兴趣。

另外,模型支持文本创建定制的高清视频,以优化广告场景,明显优于竞争对手的视频基础模型。

项目入口:https://saiyan-world.github.io/goku/

Github: https://github.com/Saiyan-World/goku

数据集:https://huggingface.co/datasets/saiyan-world/Goku-MovieGenBench

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?