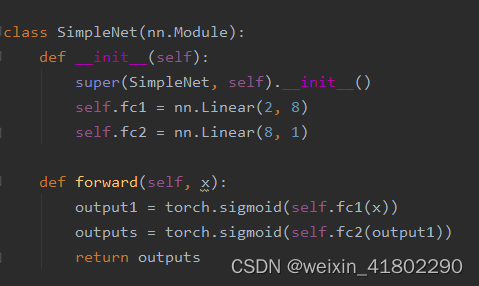

结构是最简单的一层输入层、一层隐藏层和一层输出层,输入特征数为2,输出为1(二分类)。

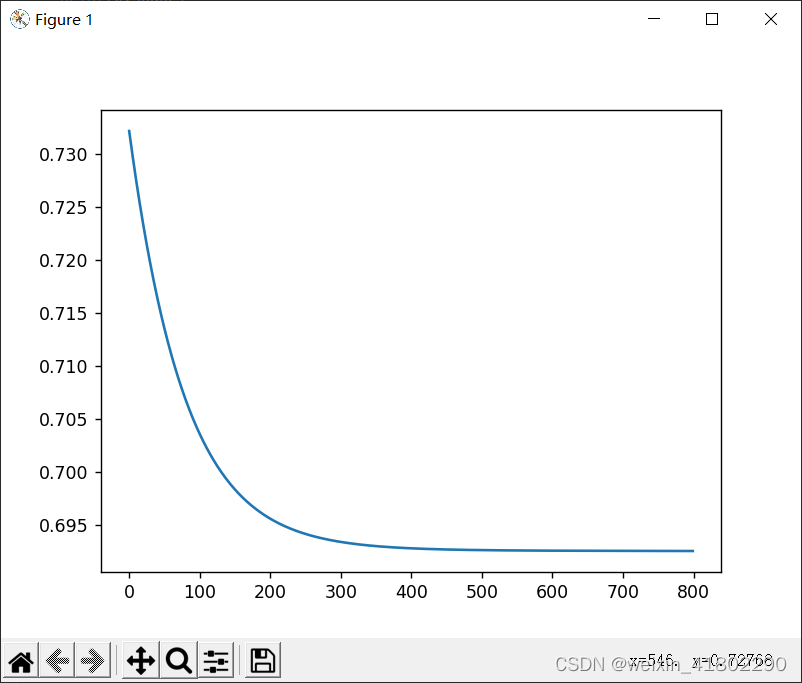

一开始看损失函数的迭代曲线还以为训练的很好。

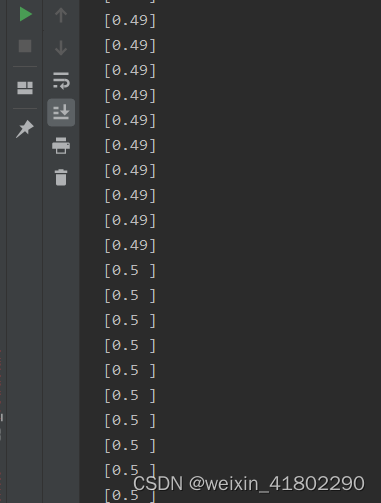

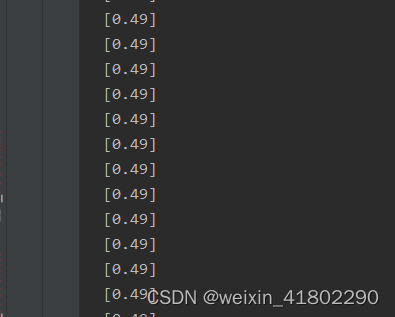

结果一看输出。。。

全是0.5左右。

然后赶紧看看参数的变化情况,输入以下指令:

for name, param in model.named_parameters():

print(name, " ", param)

果然,参数没变化。

一开始我认为是没有归一化导致的,因为有两个特征,两个特征的量级不一样。但是,对数据进行归一化后没有什么效果,于是多加几层试了试。。

还是一样。

然后我想起在用tensorflow时,处理图片的卷积操作每一层前面都加了一层BatchNorm2d,于是我在每一层sigmoid函数前加了一层BatchNorm1d

有一定效果,但识别精度并不理想。应该也不是这个的原因。

后续又改了改别的地方,比如激活函数、损失函数。。也试了试了网上的各种方案,都没有用,最后把梯度下降函数从SGD改用了Adam ,结果瞬间不一样了,或是说正常了。

当然,可能有些过拟合了,不过,那就是下一步的工作了。

3967

3967

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?