昇思Mindspore学习Day7:模型训练

模型训练一般分为四个步骤:

1.构建数据集。

2.定义神经网络模型,

3.定义超参、损失函数及优化器。

4.输入数据集进行训练与评估。

现在我们有了数据集和模型后,可以进行模型的训练与评估。

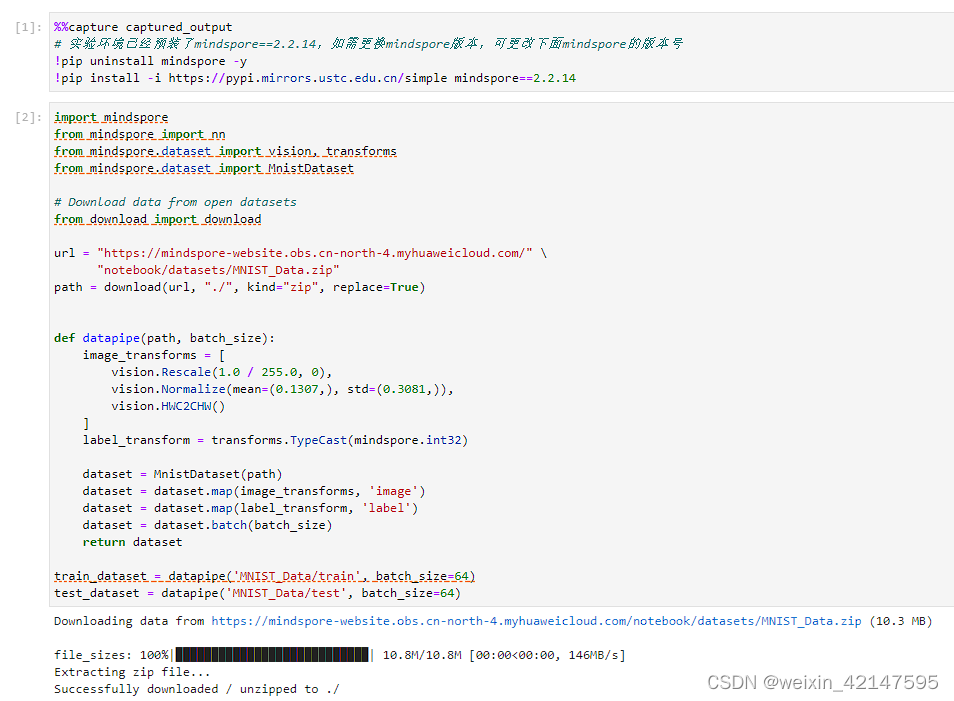

1. 构建数据集

首先从数据集 Dataset加载代码,构建数据集。

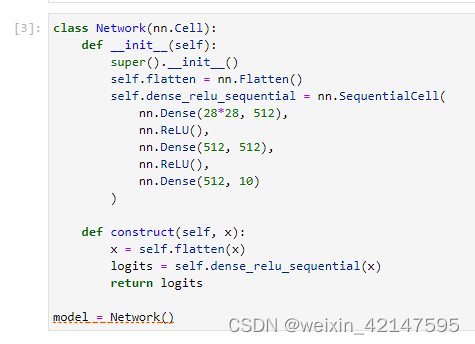

2. 定义神经网络模型

从网络构建中加载代码,构建一个神经网络模型。

3. 定义超参、损失函数、优化器

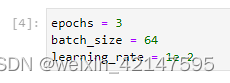

3.1 超参

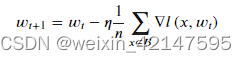

超参(Hyperparameters)是可以调整的参数,可以控制模型训练优化的过程,不同的超参数值可能会影响模型训练和收敛速度。目前深度学习模型多采用批量随机梯度下降算法进行优化,随机梯度下降算法的原理如下:

公式中,n是批量大小(batch size),m是学习率(learning rate)。另外,wt为训练轮次t中的权重参数,VI为损失函数的导数。除了梯度本身,这两个因子直接决定了模型的权重更新,从优化本身来看,它们是影响模型性能收敛最重要的参数。一般会定义以下超参用于训练:

训练轮次(epoch):

训练时遍历数据集的次数。

批次大小(batch size):

数据集进行分批读取训练,设定每个批次教据的大小。batch size过小,花费时间多,同时梯度震荡严重,不利于收敛;batch size过大,不同batch的梯度方向没有任何变化,容易陷入局部极小值,因此需要选择合适的batch size,可以有效提高模型精度、全局收敛。

学习率(learning rate):

如果学习率偏小,会导致收敛的速度变慢,如果学习率偏大,则可能会导致训练不收敛等不可预测的结果。梯度下降法被广泛应用在最小化模型误差的参数优化算法上。梯度下降法通过多次选代,并在每一步中最小化损失函数来预估模型的参数。学习率就是在迭代过程中,会控制模型的学习进度。

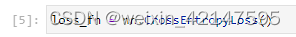

3.2 损失函数

损失函数(loss function)用于评估模型的预测值(logits)和目标值(targets)之间的误差。训练模型时,随机初始化的神经网络模型开始时会预测出错误的结果。损失函数会评估预测结果与目标值的相异程度,模型训练的目标即为降低损失函数求得的误差。

常见的损失函数包括用于回归任务的 nn.MSELoSS(均方误差)和用于分类的 nn.NLLLoss (负对数似然)等nn.CrossEntropyLoss 结合了 nn.LogSoftmax 和 nn.NLLLos5 ,可以对logits 进行归一化并计算预测误差。

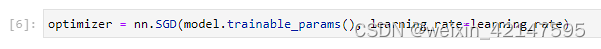

3.3 优化器

模型优化(Optimization)是在每个训练步骤中调整模型参数以减少模型误差的过程。MindSpore提供多种优化算法的实现,称之为优化器(Optimizer)。优化器内部定义了模型的参数优化过程(即梯度如何更新至模型参数),所有优化逻辑都封装在优化器对象中。在这里,我们使用SGD(Stochastic Gradient Descent)优化器。

我们通过 model.trainable_params()方法获得模型的可训练参数,并传入学习率超参来初始化优化器。

–在训练过程中,通过微分函数可计算获得参数对应的梯度,将其传入优化器中即可实现参数优化,具体形态如下:

–grads = grad_ fn(inputs)

–optimizer(grads)

4.训练与评估

设置了超参、损失函数和优化器后,我们就可以循环输入数据来训练模型。一次数据集的完整选代循环称为一轮(epoch)。每轮执行训练时包括两个步骤:

1.训练:迭代训练数据集,并尝试收敛到最佳参数。

2.验证/测试:迭代测试数据集,以检查模型性能是否提升。

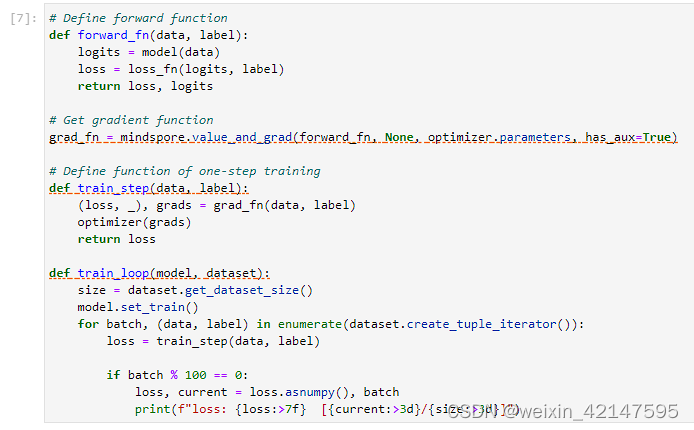

接下来我们定义用于训练的 train_loop 函数和用于测试的 test_ loop 函数。

使用函数式自动微分,需先定义正向函数 forward_fn,使用value_and_grad获得微分函数 grad_fn。然后,我们将微分函数和优化器的执行封装为 train_step 函数,接下来循环迭代数据集进行训练即可。

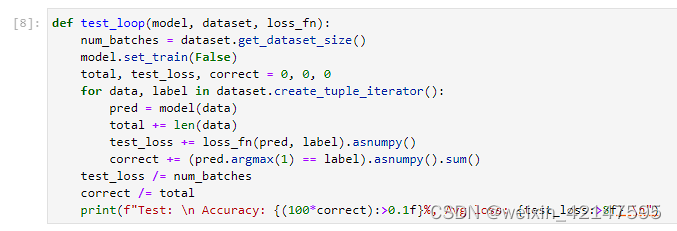

test_loop 函数同样需循环遍历数据集,调用模型计算loss和Accuray并返回最终结果。

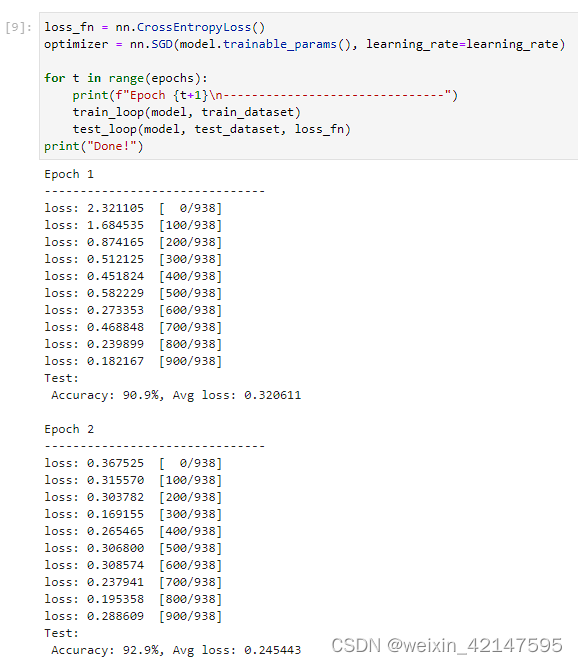

我们将实例化的损失函数和优化器传入 train_loop和 test_loop 中。训练3轮并输出loss和Accuracy,查看性能变化。

5. 训练完成打上标签和时间

793

793

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?