Sequence-to-Sequence 模型

2014年,Sutskever 等人提出了 sequence-to-sequence(seq2seq) 模型,是通过使用神经网络将一个序列映射到另一个序列的通用框架。

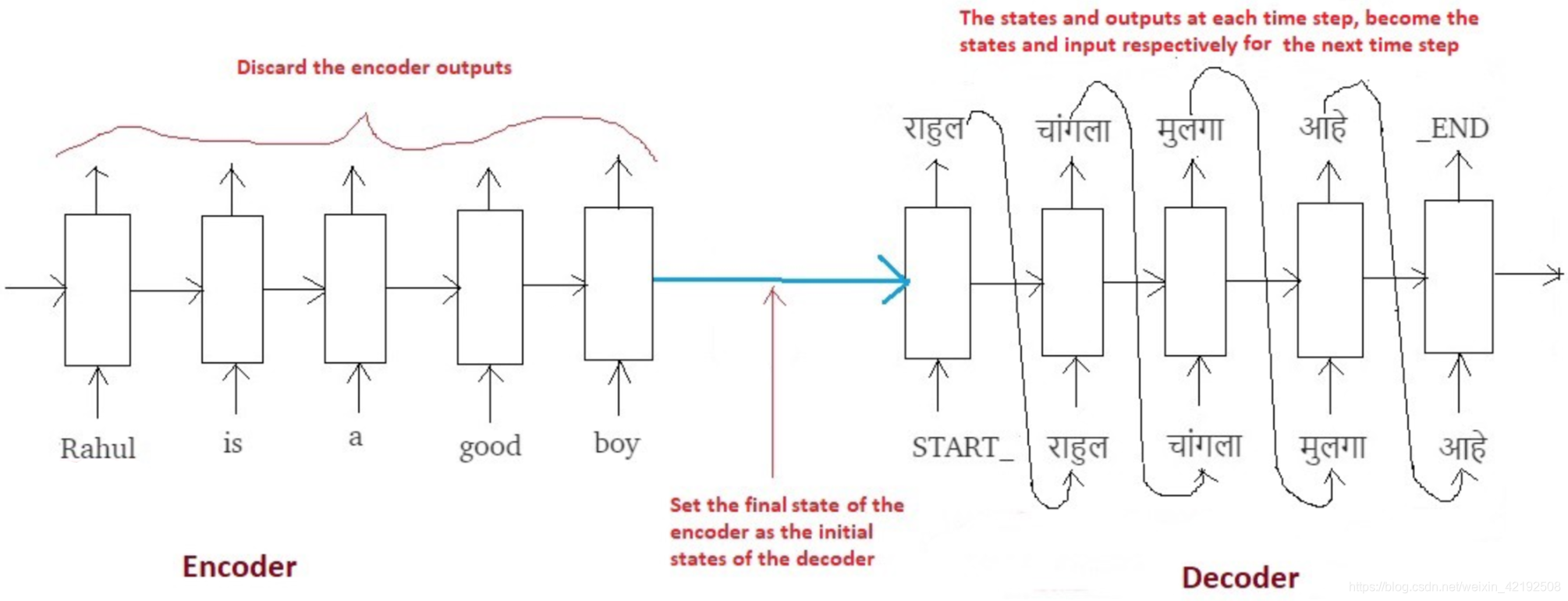

Seq2Seq 模型最常用 Encoder-Decoder 结构构建:

通过编码器(Encoder)神经网络逐个符号地处理输入序列,并将输入序列的所有信息压缩为向量表示形式(context vector),然后解码器(Decoder)神经网络根据编码器状态逐个符号地预测输出值,在解码过程中,将前一步预测出的值作为下一步预测的输入:

编码器和解码器常用的神经网络有 CNN、RNN、LSTM、GRU 等等,下面以 LSTM 为例子来解释一下训练过程。

Encoder LSTM

LSTM 处理长度为 的输入序列:

LSTM 从输入序列(

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

357

357

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?