DAY2

给定一些常量

| 字母 | 定义 |

|---|---|

| m | 训练集的数量 |

| x | 输入变量(特征) |

| y | 输出变量(预测的目标函数) |

| h | 假设函数(hypothesis) |

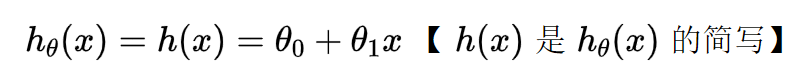

线性回归函数

单变量线性回归函数(预测函数)

对应的图形 - y是一个关于x的线性函数

预测值与实际差的平方误差:

平方误差代价函数

latex代码:

\displaylines{平方误差代价函数\\ J_{(\theta _{0},\theta _{1})}= \frac{1}{2m} \sum_{i=1}^{m}{(h_{\theta}(x^{(i)})-y^{(i)})^2}}

设定theta_0:=0,变化theta_1

由于公式用latex写太浪费时间了,所以直接上传写好的笔记,做一个学习记录

凸函数全局最优解 - 图解

梯度下降算法

对导数项的详细解释

问题:如果theta已经到达局部最优解,下一步梯度下降会如何?

梯度下降法+平方误差代价函数==线性回归算法

Batch梯度下降算法局部最优解 - 图解

梯度下降算法一般没有全局最优解,大部分都是局部最优解,就如图3-2和3-1一样,最优解是要看梯度下降的方向,也就是theta的值

3876

3876

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?