卷积神经网络

一般卷积层,ReLU层,池化层可以写成一个套餐

用预训练好的模型进行迁移学习

用人家已经训练好的模型(torchvision.model),已经训练好的参数,进行初始化!

数据量越小,用预训练的时候基本上全部冻结住,自己加全连接层,数据量多,可以将预训练模型少冻结一些,也是自己加全连接层。

ResNet

“好不好无所谓,但是一定不能比原来差。”所以深度可以继续延申。

网络结构

Input:图片输入

ZeroPad:边缘填充

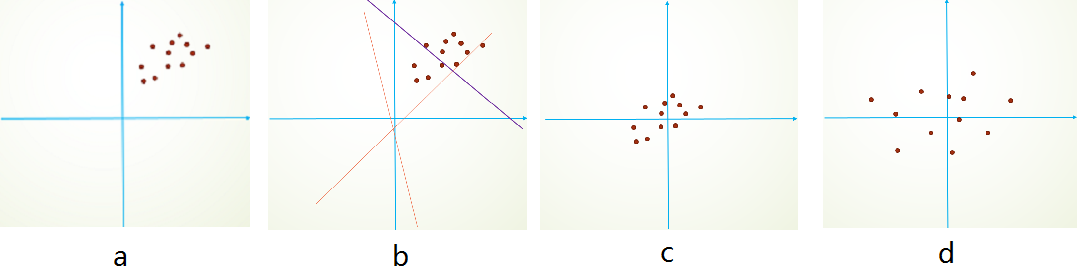

BatchNorm:将图片进行归一化,普通数据是上述图a这样,经过迭代从橙色虚线收敛到紫色的线,但是如果将数据平移到原点,并且再进一步通过变换拉到数据之间的相对差异性,那么就会更快收敛到另一条“紫色”的线。

红色I模块(跳过)Identity_block:这种情况是三层卷积的输出结果格式一样

蓝色C模块(格式统一)Convolution_block:这种情况是三层卷积的输出结果格式不一样,所以需要将格式统一,利用1*1的卷积。

文章探讨了卷积神经网络的基本构造,包括卷积层、ReLU激活和池化层。介绍了使用预训练模型进行迁移学习的方法,特别是当数据量小时,通常会冻结大部分预训练模型参数并添加全连接层。ResNet模型被提及,其设计允许网络深度增加而不导致梯度消失问题。BatchNorm层的作用在于加速收敛过程,而Identity_block和Convolution_block则分别处理格式不变和变化的卷积输出。

文章探讨了卷积神经网络的基本构造,包括卷积层、ReLU激活和池化层。介绍了使用预训练模型进行迁移学习的方法,特别是当数据量小时,通常会冻结大部分预训练模型参数并添加全连接层。ResNet模型被提及,其设计允许网络深度增加而不导致梯度消失问题。BatchNorm层的作用在于加速收敛过程,而Identity_block和Convolution_block则分别处理格式不变和变化的卷积输出。

2109

2109

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?