假设batch为2,(2,3,256,256)这样的样本

LN比较直观就是在每个独立的样本上计算均值和方差,然后归一化。(2,3,256,256)

归一化是将数据放缩到[0,1]或[-1,1]这样的区间内,标准化是让数据符合特定均值和方差的分布。

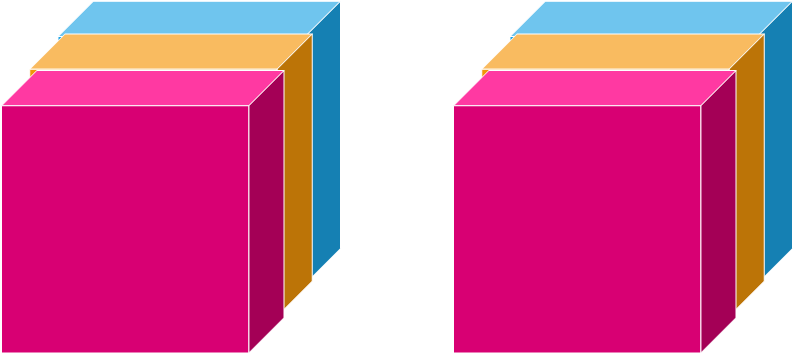

BN是按照一个batch中所有样本的通道计算均值和方差,它的计算单位是所有蓝色通道,所有黄色通道,所有红色通道。(2,3,256,256)

假设batch为2,(2,3,256,256)这样的样本

LN比较直观就是在每个独立的样本上计算均值和方差,然后归一化。(2,3,256,256)

归一化是将数据放缩到[0,1]或[-1,1]这样的区间内,标准化是让数据符合特定均值和方差的分布。

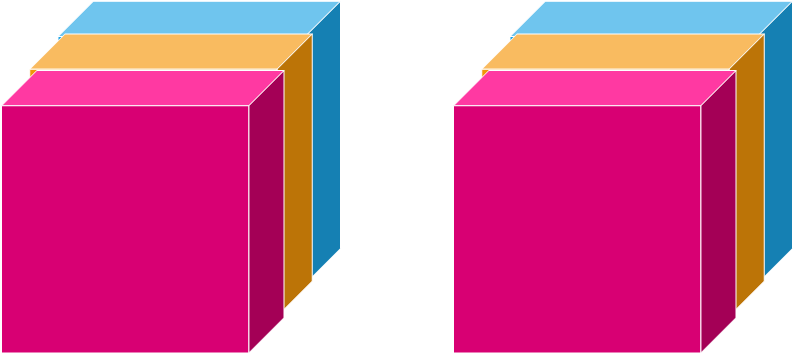

BN是按照一个batch中所有样本的通道计算均值和方差,它的计算单位是所有蓝色通道,所有黄色通道,所有红色通道。(2,3,256,256)

1361

1361

1029

1029

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?