图片标注工具LabelImg

1、安装方式 pip install labelimg

2、运行方式在命令行输入labelimg即可出现

3、将生成的XML文件和相应的图片保存在同一文件夹下

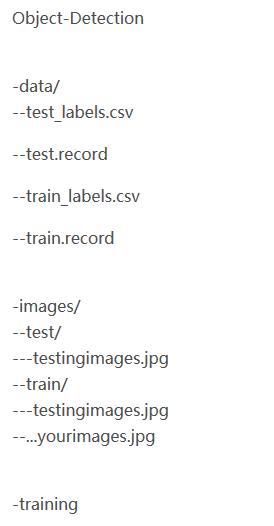

文档目录结构

在object_detection文件夹下按如下创建文档目录结构

生成record文件

生成过程:XML–>CSV–>record

代码:见小郭的GitHub,就这样一步步的生成两个record文件。把文件保存到相应的位置

配置模型config文件

config文件可以在object_detection\samples\configs目录下找到,将之复制到object_detection\training文件夹下,打开进行配置

1、第9行,num_classes是标签类别,根据自己模型更改数量

2、第156、157行,是是否在现有模型基础上进行训练,如果不是可以注释掉;如果想在已给现有的模型上继续训练可以更改fine_tune_checkpoint: “PATH_TO_BE_CONFIGURED/model.ckpt” 更改PATH_TO_BE_CONFIGURED为模型位置,例如可以更改为ssd_mobilenet_v1_coco

3、第141行的batch_size数值需要根据自己的显卡性能进行适配,最小值是1。

4、第175、189行,分别是train、test的record文件的相对位置,例data\train.record。第177、191行是一样的,是pbtxt文件的相对位置(pbtxt文件是保存标签类别的文件,可以在data文件夹里面找到pbtxt文件模板,复制一份,根据自己的模型进行相应的修改)例:data\train.pbtxt

进行训练

打开cmd,定位到object_detection文件夹下,执行下面的命令,等待。

(若想要每100步显示信息,则在model_main.py ,import区域加入 tf.logging.set_verbosity(tf.logging.INFO)就可以每100步显示一个信息。)

python model_main.py --logtostderr --pipeline_config_path=training/ssd_mobilenet_v1_coco.config --model_dir=training\ --num_train_steps=50000 --num_eval_steps=2000

另开一个终端,同样进入到object_detection目录下,输入:

tensorboard --logdir=training

就可以查看训练进度啦。

训练完成

1、cmd定位到object_detection文件夹下,运行

python export_inference_graph.py \ --input_type image_tensor \ --pipeline_config_path training/ssd_mobilenet_v1_coco.config \ --trained_checkpoint_prefix training/model.ckpt-NUM\ --output_directory DD

把NUM更改为训练的模型最新的步数、DD改为要输出的文件夹名字

model.ckpt-NUM可以在train文件夹下查看最新name

2、找到之前测试阶段使用的代码,在相应的位置进行修改,模型改为刚刚生成的模型文件夹等待在目标文件夹生成相应图片

参考:https://www.cnblogs.com/zongfa/p/9663649.html

---------https://blog.csdn.net/dy_guox/article/details/79111949

3760

3760

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?