比如一张图片如果是

64*64

的,那么它的数据量就是

64×64×3

,因为每张图片都有 3 个颜色通道。那么图片的特征向量维度为

12288

。

比如一张图片如果是

64*64

的,那么它的数据量就是

64×64×3

,因为每张图片都有 3 个颜色通道。那么图片的特征向量维度为

12288

。

对的!64×64还是比较小的,如果操作更大的图片,给你举个例子,

比如一张 1000×1000 的图片,那么特征向量的维度达到了 1000×1000×3,因为有 3 个 RGB 通道,所以数字将会是 300 万。

如果特征维度为300万,那么我们的神经网络需要300万个输入,如果神经网络的隐藏层有

1000个隐藏单元

,那么输入层和第一个隐藏层之间的参数矩阵的大小是会有 30亿个参数,仅仅输入层和隐藏层之间就有

30亿个参数

。

在参数如此大量的情况下

,难以获得足够的数据来

防止神经网络发生过拟合

,而且还存在巨大的压力。

对的!64×64还是比较小的,如果操作更大的图片,给你举个例子,

比如一张 1000×1000 的图片,那么特征向量的维度达到了 1000×1000×3,因为有 3 个 RGB 通道,所以数字将会是 300 万。

如果特征维度为300万,那么我们的神经网络需要300万个输入,如果神经网络的隐藏层有

1000个隐藏单元

,那么输入层和第一个隐藏层之间的参数矩阵的大小是会有 30亿个参数,仅仅输入层和隐藏层之间就有

30亿个参数

。

在参数如此大量的情况下

,难以获得足够的数据来

防止神经网络发生过拟合

,而且还存在巨大的压力。

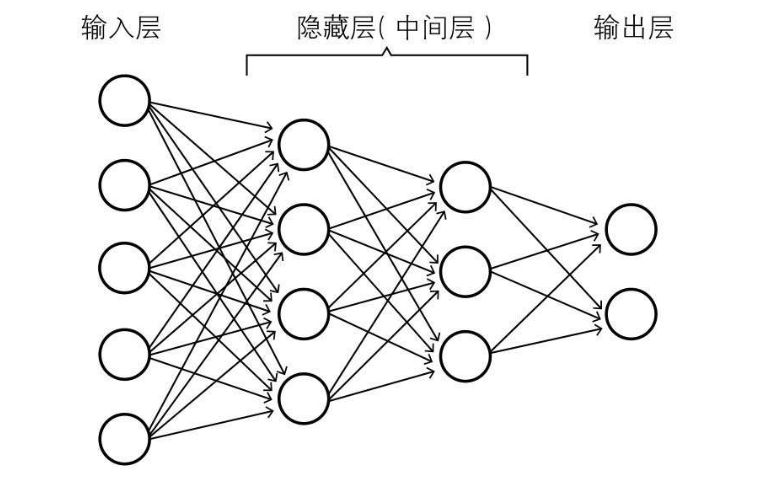

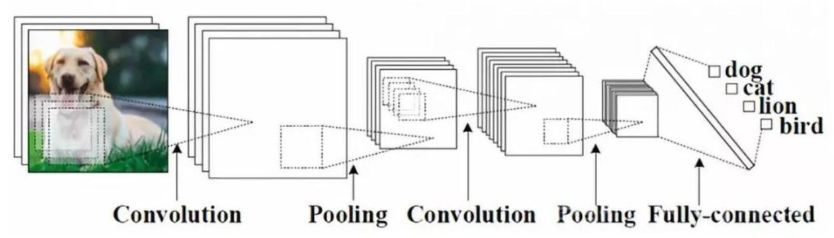

先来看下面这张图

先来看下面这张图

大致可以分为这几个步骤:

卷积层-Pooling-卷积层-Pooling-全连接层-softmax

那么这样就用卷积操作代替了全连接的操作,可以进行有效的提取特征。那么卷积的特性包括:

权值共享

和

局部连接

。我想大家看一下下面这个就更明显了!

大致可以分为这几个步骤:

卷积层-Pooling-卷积层-Pooling-全连接层-softmax

那么这样就用卷积操作代替了全连接的操作,可以进行有效的提取特征。那么卷积的特性包括:

权值共享

和

局部连接

。我想大家看一下下面这个就更明显了!

(图片来源:csdn博客)

为了使得卷积神经网络更形象,请看下面几个图:

(图片来源:csdn博客)

为了使得卷积神经网络更形象,请看下面几个图:

这节课我们知道了为什么卷积神经网络能更好的处理图片,同时也大体了解了神经网络,后面会按照章节讲解计算机视觉CNN!

这节课我们知道了为什么卷积神经网络能更好的处理图片,同时也大体了解了神经网络,后面会按照章节讲解计算机视觉CNN!

参考文献

1.http://www.elecfans.com/rengongzhineng/580113.html 2.今日头条|B站AI专栏素材 3.https://blog.wj2015.com/

3724

3724

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?