专栏导读

🔥🔥本文已收录于《Python基础篇爬虫》

🉑🉑本专栏专门针对于有爬虫基础准备的一套基础教学,轻松掌握Python爬虫,欢迎各位同学订阅,专栏订阅地址:点我直达

🤞🤞此外如果您已工作,如需利用Python解决办公中常见的问题,欢迎订阅《Python办公自动化》专栏,订阅地址:点我直达

的

🔺🔺此外《Python30天从入门到熟练》专栏已上线,欢迎大家订阅,订阅地址:点我直达

背景

-

由于我最近想学习关于人民网的一些信息,我看到页面有三个模块,分别是【最新】【国内】【国际】,于是我想获取这三个模块的文章,并写入word文档中

测试代码

分析

1、首先我们发现请求响应的返回不在【Response】中,而是直接在网页中

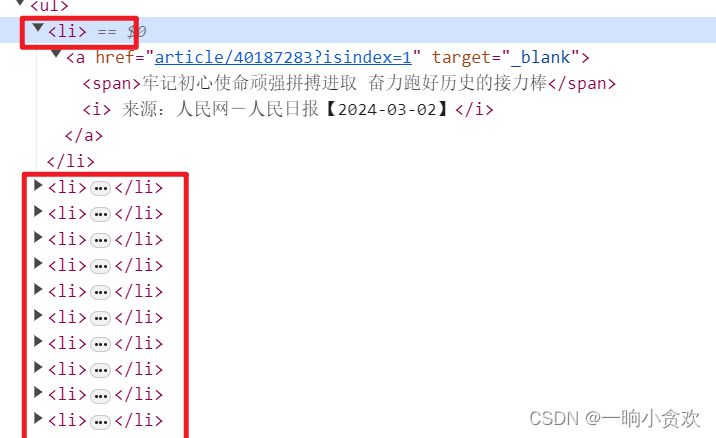

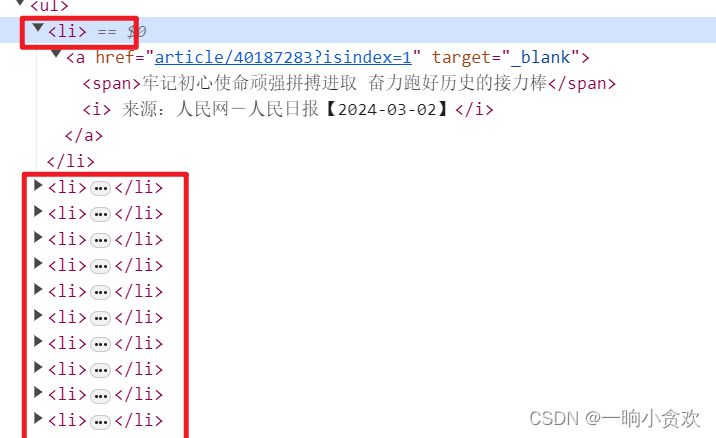

2、我们发现网页中有三个【li】标签,分别表示【最新】【国内】【国际】中的文章url

3、所以我们决定此次爬虫应该是用 lxml+xpath比较合适,说干就干!

请求网址

url: http://jhsjk.people.cn/

请求参数

无

代码测试

'''

@Project :人民网爬虫

@File :main_.py

@IDE :PyCharm

@Author :一晌小贪欢(278865463@qq.com)

@Date :2024/3/3 11:54

'''

import json

import requests

url = 'http://jhsjk.people.cn/'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/103.0.0.0 Safari/537.36'}

res_data= requests.post(url=url, headers=headers)

res_data.encoding = "utf-8"

print(res_data.text)

数据分析

利用lxml+xpath进一步分析

我们看见每一个 文章链接在a标签中,文章标题在span标签中

知道这个就好办了!

先利用lxml获取所有的【li】

news_data = tree.xpath('//div[@class="news-box"]//div[@class="news"]//ul//li')

获取文章链接

url_data = i.xpath('a/@href')[0]

获取标题

title = i.xpath('a/span')[0]

成功!!

将获取链接再获取文章内容

我们发现文章各种标题,以及内容都在 div class="d2txt clearfix" 这个标签中

测试代码

'''

@Project :人民网爬虫

@File :main_.py

@IDE :PyCharm

@Author :一晌小贪欢(278865463@qq.com)

@Date :2024/3/3 11:54

'''

import json

import reque

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?