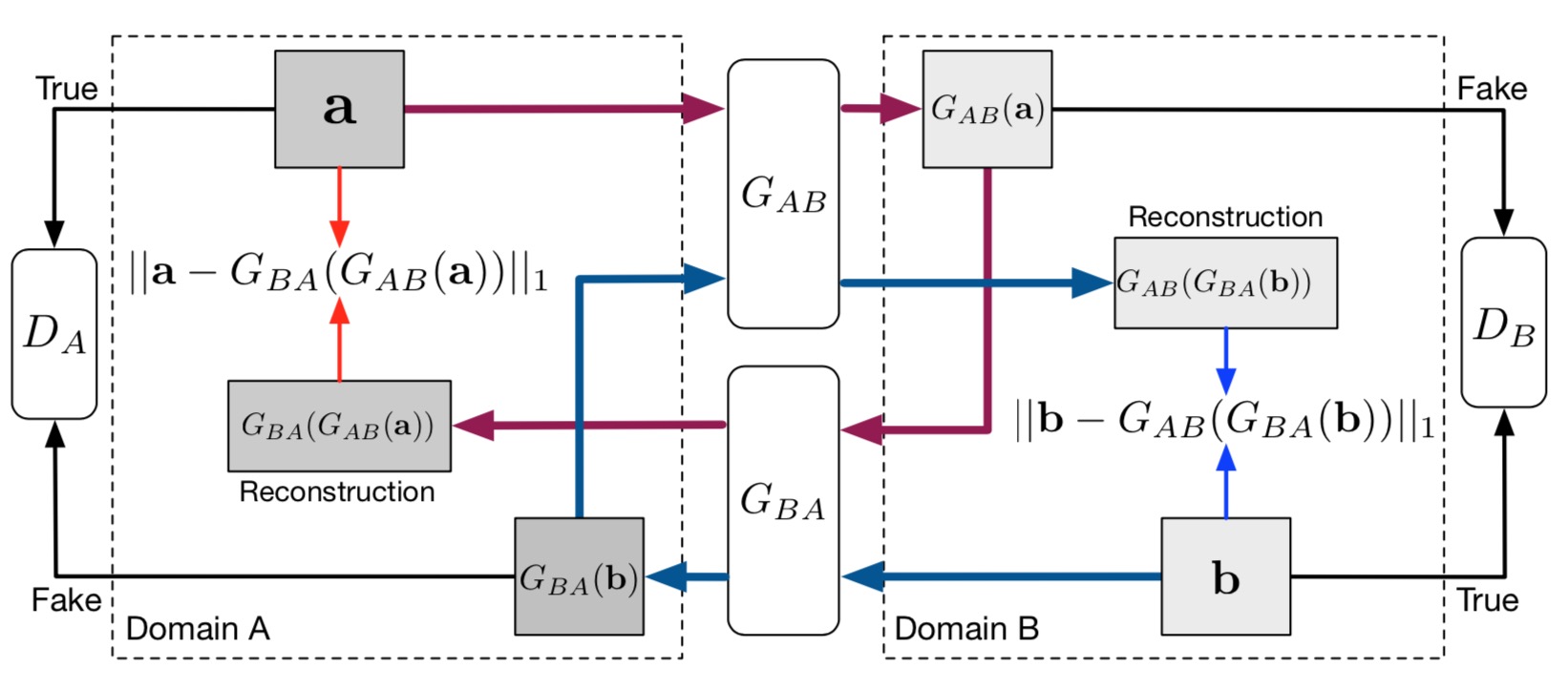

另外,我们引入了两个判别函数:

- 用于区分{x} 与 {F(y)} 的 Dx

- 用于区分{y} 与 {G(x)} 的 Dy 。

我们的构建的模型包含两类组件(Our objective contains two types of terms):

- 对抗损失(adversarial losses),使生成的图片在分布上更接近于目标图片;

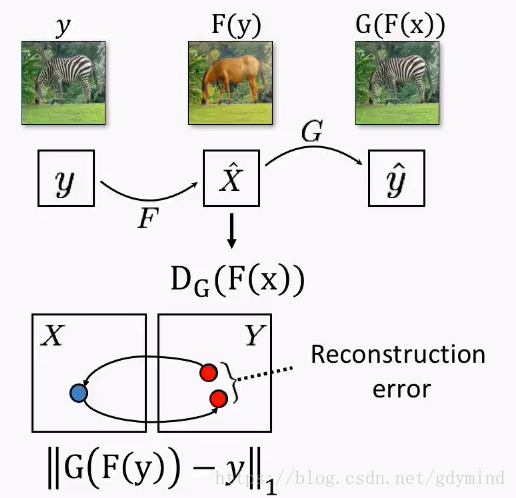

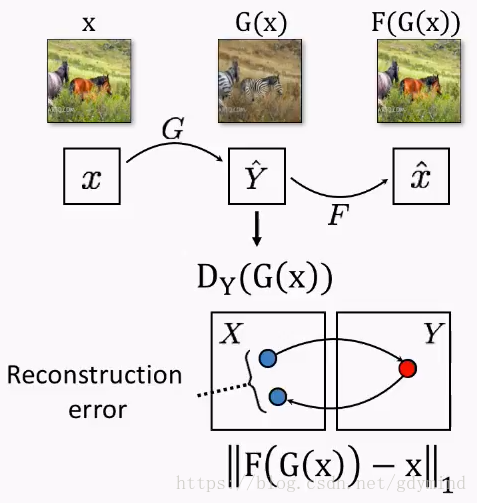

- 循环一致性损失(cycle consistency losses),防止学习到的映射 G与F 相互矛盾。

CycleGAN算法笔记_AI之路-CSDN博客_cyclegan

结合下面的图来理解

包含两个生成器和两个鉴别器

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?