文章目录

1、logistics回归

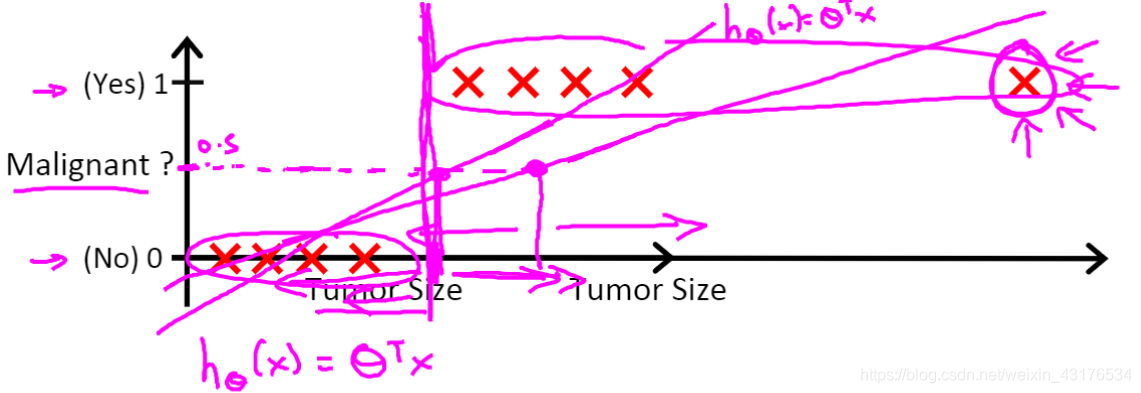

在处理分类问题时,使用线性回归难以将数据分好。如图,一个远处的样本点会大幅度影响线性回归曲线的走向,导致分类不准确。 因此要寻找一种适合分类的模型,比如logistics回归。这个方法用到了sigmoid函数,如图所示:

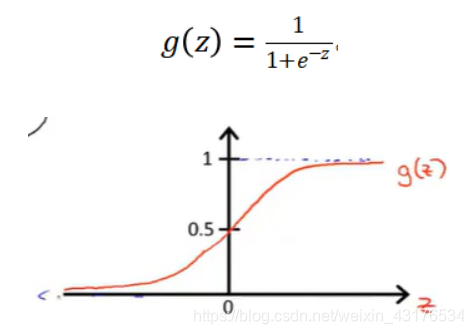

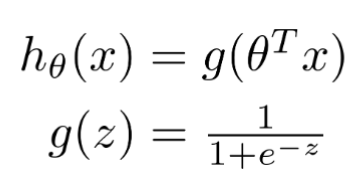

因此要寻找一种适合分类的模型,比如logistics回归。这个方法用到了sigmoid函数,如图所示:

当z趋于0+时,g(z)趋于1,当z趋于0-时,g(z)趋于0。这样就可以将数据区分为小于0和大于0两份。

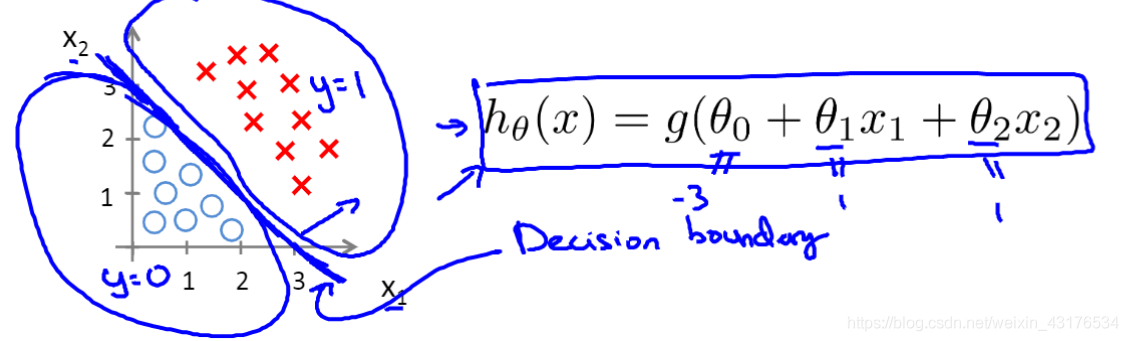

但仅有这样一个分类函数是不够的,我们还需要一个完整的函数将两种数据分开,在分类流程中,这个函数被称为决策边界。

如上图所示,将红叉和蓝圈分开来的直线,就是决策边界,这个带有参数的函数直线也是整个假设函数的一部分,将决策边界与sigmoid函数结合起来就是整个假设函数。

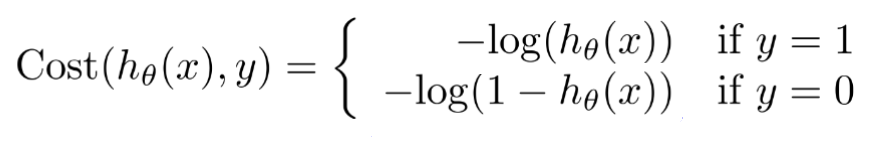

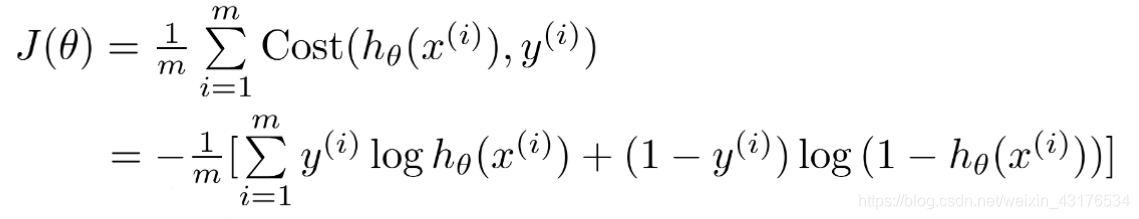

有了新的假设函数,就有新的代价函数,新的代价函数如图所示:

因为h(x)取值在0和1之间,所以这个函数的意义就是鉴别h(x)是否等于y,如果不等,则有代价值,否则为0。通过数学手段简化后得到下面式子:

得到代价函数之后,就可以通过梯度下降法优化参数求出最优解了。最终通过得到的模型预测输出。

2、多元分类

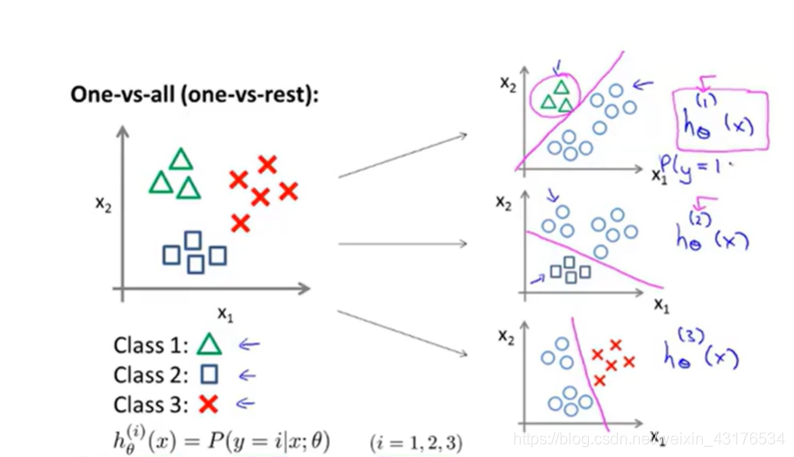

当分类涉及到两种以上的类型时,需要对分类算法进行改进。

具体的改造方法是构造多个分类器,分类器的数量等于需要划分的类型数量。每一个分类器都有一个决策边界,将其中一种类型与其他类型分开。这种做法可以使得在面对不同的输入时找到契合度最好的分类器。

当需要预测时,将输入分别放入所有分类器中,并选择得出的h(θ)值最大的分类器并得出结果。

总结

本章学习了logistics回归的原理。

3011

3011

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?