梯度下降法代码python实现 -有数据有图有真相

今天我们做了一个实验,通过生成多元回归数据进行梯度下降求解权重

-

生成一份线性数据 y = w 1 ∗ x 1 = w 2 ∗ x 2 + w 3 ∗ x 3 + b y=w_1*x_1=w_2*x_2+w_3*x_3+b y=w1∗x1=w2∗x2+w3∗x3+b

代码测试为 y = 5 ∗ x 1 = w 2 ∗ 7 + 4 ∗ x 3 + 8 y=5*x_1=w_2*7+4*x_3+8 y=5∗x1=w2∗7+4∗x3+8 -

为线性数据增加噪声值 y=y+np.random.randn()*1+8

-

之后通过梯度下降算法进行迭代,迭代次数5000轮

-

绘制误差和权重迭代曲线

下面代码对于学习而言是个非常好的例子,如有疑问,可以在博客留言询问

import numpy as np

import os

import matplotlib.pyplot as plt

w=np.array([5,7,4])

sample=np.random.randint(0,10,(100,3))

y=np.dot(sample,w)

#print(sample)

#print(y)

y=y+np.random.randn()*1+8

print(y)

w_zz=np.array([1,1,1,1])

learn_rating=0.0001

p=0

w=[[1],[1],[1],[1]]

loss=[]

for i in range(5000):

d=0

p=0

loss_sum=np.array([])

for x in sample:

sample_convert=np.append(x,1)

# print(sample_convert)

# print(np.dot(sample_convert,w_zz)-y[p])

loss_sum=np.append(loss_sum,(np.dot(sample_convert,w_zz)-y[p])**2)

d=d+learn_rating*sample_convert*(np.dot(sample_convert,w_zz)-y[p])

p=p+1

# print(w_zz)

w_zz=w_zz-d

loss.append(loss_sum.mean())

print(loss_sum.mean())

for i in range(4):

w[i].append(w_zz[i])

print(w_zz)

#print(w)

plt.plot(w[0])

plt.plot(w[1])

plt.plot(w[2])

plt.plot(w[3])

plt.legend(["w1","w2","w3","w4"])

plt.show()

plt.plot(loss[500:])

plt.show()

os.system("pause")

截图过下图所示

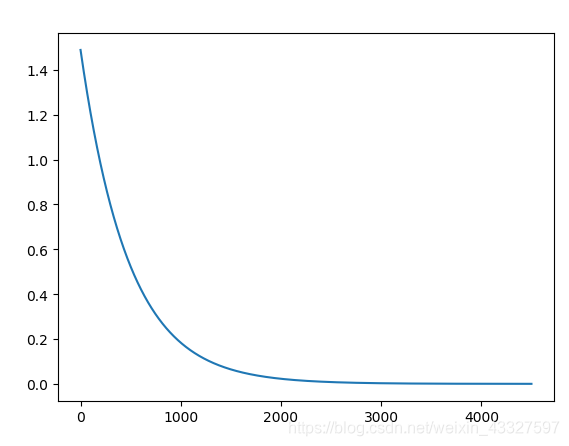

误差曲线图

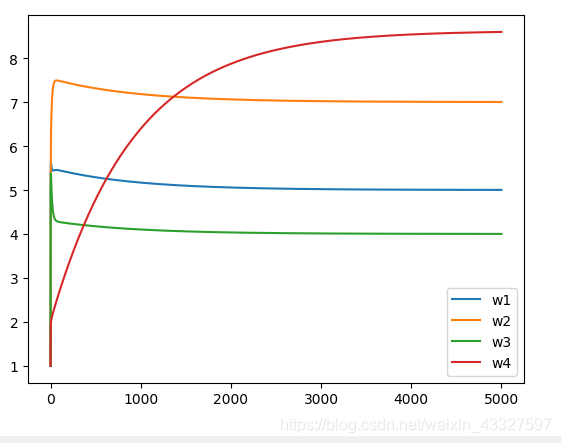

权重迭代曲线图:

数据我已经上传到我的资源,可以免费下载,文件名为BP神经网络

1183

1183

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?