在b站上看视频学习tensorflow基本知识,同时记录一下~

由于课程第一节讲的是环境搭建,那部分自己完成了,没有听课,所以就从(二)开始吧

- 视频内容:02-1;02-2;02-3;02-4

- 主要内容:Tensorflow的基础使用,包括对图(graphs),会话(session),张量(tensor),变量(Variable)的一些解释和操作。

- 代码链接参考:github,由于所有的代码都是在Jupyter Notebook中进行编写以及运行,所有代码编写过程中有很多次运行,查看输出结果。

- 代码格式是.ipynb格式,查看代码方法:已经安装好了Anaconda等环境,打开终端,输入

Jupyter Notebook,就可以按照路径打开代码了。

02-1:创建图和启动图

首先,需要对tensorflow有一个基本的了解,如图:

最重要的一点就是:图代表计算的一个过程,图需要在会话中执行。

例子:创建图和启动图代码:

import tensorflow as tf

# 常量op

m1 = tf.constant([[3,3]]) #1行2列

m2 = tf.constant([[2],[3]]) #2行1列

product = tf.matmul(m1,m2) #创建一个矩阵乘法op,把m1和m2传入

print(product)

#结果:Tensor("Matul_2:0",shape=(1,1),dtype=int32)

#输出结果看一下,发现是一个tensor,并不是数字15,这是因为我们只是定义了op,并没执行

#定义一个会话,启动图

with tf.Session() as sess:

# 使用sess的run方法来执行矩阵乘法op

result = sess.run(product) #调用run(product)时,其实就是一层一层往上去调用

print(result) #结果:[[15]]

print(type(result)) #结果:<class 'numpy.ndarray'>

02-2:tensorflow中变量的使用

变量的定义tf.Variable以及初始化init = tf.global_variables_initializer()。

import tensorflow as tf

x = tf.Variable([1,2])

a = tf.constant([3,3])

# 增加一个减法op

sub = tf.subtract(x,a)

# 增加一个加法op

add = tf.add(a,sub)

# 全局变量初始化

init = tf.global_variables_initializer()#初始化所有变量,这里是只有一个变量,其他代码用这句的时候可以初始化所有的变量

with tf.Session() as sess:

sess.run(init)

print(x.value)

print(sess.run(sub))

print(sess.run(add))

"""

结果:

<bound method RefVariable.value of <tf.Variable 'Variable:0' shape=(2,) dtype=int32_ref>>

[-2 -1]

[1 2]

"""

完成一个数值递增的图以及会话中执行

import tensorflow as tf

# 创建一个变量,初始化为0

state = tf.Variable(0, name='counter')

# 创建一个op

new_value = tf.add(state,1)

# 赋值op

update = tf.assign(state,new_value)

# 初始化全局变量

init = tf.global_variables_initializer()

# 变量初始化为0,循环更新并打印

with tf.Session() as sess:

sess.run(init)

print(sess.run(state))

for _ in range(5):

sess.run(update)

print(sess.run(state))

"""

结果:

0

1

2

3

4

5

"""

02-3:fetch和feed的使用

fetch指同时运行,意思是在Session中可以同时执行多个OP,得到其运行的结果

feed允许在运行的时候再传入值,传入的参数要用字典来表示

import tensorflow as tf

#fetch :在会话中同时运行多个op

input1 = tf.constant(3.0)

input2 = tf.constant(2.0)

input3 = tf.constant(5.0)

add = tf.add(input2,input3) #7

mul = tf.multiply(input1,add) #21

with tf.Session() as sess:

result = sess.run([mul, add]) #在会话中同时运行了多个op

print((result))

#结果:[21.0, 7.0]

#feed

# 创建占位符

input1 = tf.placeholder(tf.float32)

input2 = tf.placeholder(tf.float32)

output = tf.multiply(input1, input2)

with tf.Session() as sess:

# feed数据以字典形式传入

print(sess.run(output, feed_dict={input1:[2.0],input2:[6.0]}))

#结果:[12.]

02-4:tensorflow简单示例

import tensorflow as tf

import numpy as np

#使用numpty生成100个随机点,可以看成是一个样本

x_data = np.random.rand(100)

y_data = x_data*0.1+0.2 #实际上是一条直线

#构进一个线性模型

b=tf.Variable(0.)

k=tf.Variable(0.)

y=k*x_data+b #y相当于是预测值

#二次代价函数

loss = tf.reduce_mean( tf.square(y_data-y)) #tf.reduce_mean求平均值

#定义一个梯度下降发进行训练优化

optimizer = tf.train.GradientDescentOptimizer(0.2) #0.2学习率

#最小化代价函数

train =optimizer.minimize(loss)

#初始化变量,就算是你给变量了一个初始值,也要进行初始化

init=tf.gloabal_variables_initalizer()

with tf.Session() as sess:

sess.run(init)

for step in range(201):

sess.run(train)#每一次迭代,会最小化loss,往上推,发现是在改变k和b

if step%20==0:

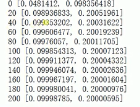

print(step,sess.run([k,b]))

结果:

3968

3968

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?