逻辑回归模型介绍

原理:

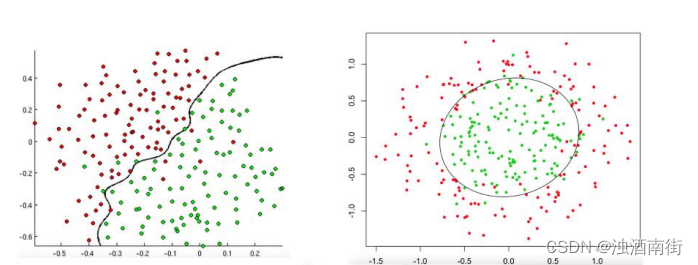

逻辑斯谛回归(logistic regression)是经典的分类方法,它属于对数线性模型,原理是根据现有的数据对分类边界线建立回归公式,以此进行分类。

定义:

在线性回归模型的基础上,使用Sigmoid函数,将线性模型的结果压缩到[0,1]之间,使其拥有概率意义,它可以将任意输入映射到[0,1]区间,实现值到概率转换。

逻辑斯蒂分布

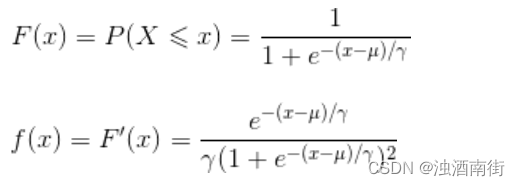

设X是连续随机变量,若X服从逻辑斯蒂分布,是指X具有以下分布函数和密度函数

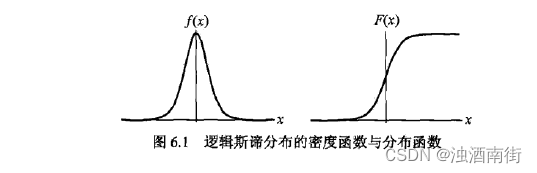

μ为位置参数(控制分布/密度函数坐标轴上位置),γ 为形状参数(控制函数的形状),图形如下

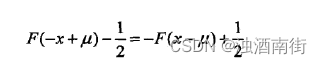

逻辑斯谛分布的分布函数F(x)的曲线如图所示,其图形是一条S形曲线,曲线在中心附近增长最快,在两端增长速度较慢。当x无穷大时,F(x)接近于1;当x无穷小时,F(x)接近于0。该曲线以点(μ,1/2)为中心对称,既满足:

二项逻辑斯谛回归模型

二项逻辑斯蒂回归模型是一种分类模型,由条件概率分布P(Y|X)表示,形式为参数化的逻辑斯蒂分布?这里随机变量X取值为实数,随机变量Y取值为1或0。

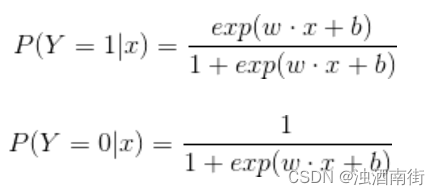

二项逻辑斯谛回归模型是如下的条件概率分布:

这里x属于实数,Y属于{0,1}是输出,w和b是参数,w称为权值向量,b称为偏置,为w和x的内积。

对于给定的输入实例x,按照上述分布函数可以求得P(Y=1|x)和P(Y=0|x)。逻辑斯谛回归是比较两个条件概率值的大小,将实例x分到概率值大的那一类。

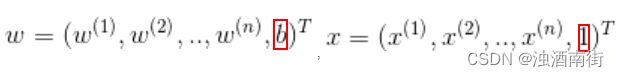

有时候为了方便,将权值向量和输入向量加以扩充,仍记作w,x,即

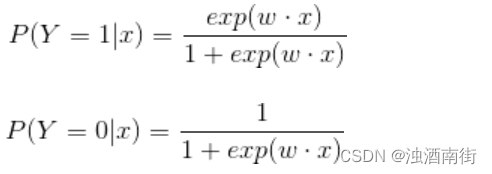

这时,逻辑斯蒂回归模型如下:

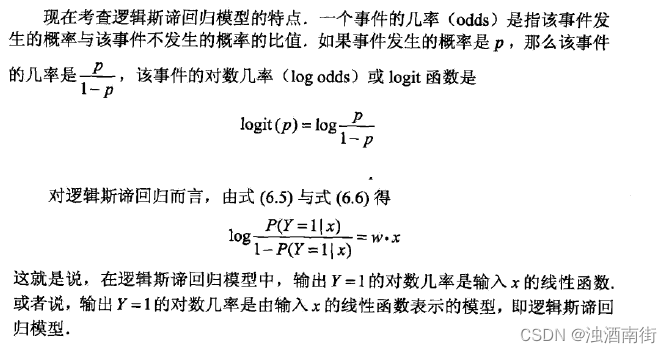

事件的对数几率(log odds)

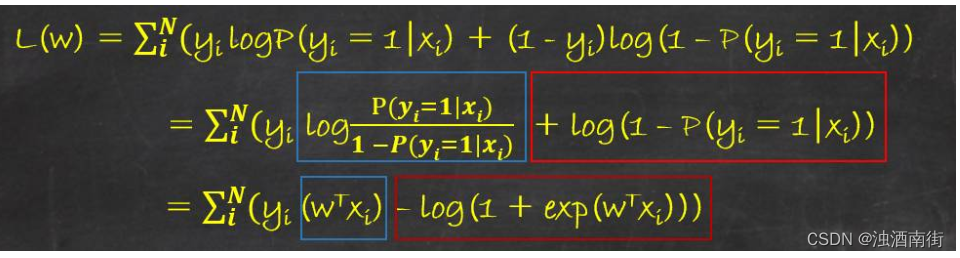

目标函数

对数似然函数

首先极大似然函数是一种确定模型参数的方法,它确定参数值的方法是通过找到最大化模型产生真实数据的那一组参数。

最大似然估计就是通过已知结果去反推最大概率导致该结果的参数。

极大似然估计是概率论在统计学中的应用,它提供了一种给定观察数据来评估模型参数的方法,即 “模型已定,参数未知”,通过若干次试验,观察其结果,利用实验结果得到某个参数值能够使样本出现的概率为最大,则称为极大似然估计。逻辑回归是一种监督式学习,是有训练标签的,就是有已知结果的,从这个已知结果入手,去推导能获得最大概率的结果参数,只要我们得出了这个参数,那我们的模型就自然可以很准确的预测未知的数据了。

这样问题就变成了以对数似然函数为目标函数的最优化问题。逻辑斯蒂回归学习中通常采用的方法是梯度下降法以及拟牛顿法。

将利用极大似然估计得到的w值代入上述的模型中,即可用于测试数据集的预测。

逻辑回归是一种经典的分类方法,基于Sigmoid函数将线性模型结果转化为[0,1]区间,赋予概率意义。逻辑斯蒂分布是其基础,而二项逻辑斯蒂回归模型用于二分类问题。目标函数通过极大似然估计确定模型参数,优化方法包括梯度下降和拟牛顿法。

逻辑回归是一种经典的分类方法,基于Sigmoid函数将线性模型结果转化为[0,1]区间,赋予概率意义。逻辑斯蒂分布是其基础,而二项逻辑斯蒂回归模型用于二分类问题。目标函数通过极大似然估计确定模型参数,优化方法包括梯度下降和拟牛顿法。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?