EMFusion: An unsupervised enhanced medical image fusion network

(EMFusion: 一种无监督的增强医学图像融合网络)

由于目前大多数方法是对不同模态的医学图像使用相同的表示,通过主观定义去决定要保留的特征,会导致独特的信息失真。故,我们提出无监督增强医学图像融合网络,同时执行表层和深层约束一增强信息保留。表面水平约束基于显着性和丰度度量,以保留主观定义的直观特征。在深层约束中,基于预先训练的编码器的唯一通道客观地定义了唯一信息。我们使用结构图像 (例如MRI) 中的高质量细节来减轻功能图像 (例如PET,SPECT) 中的马赛克,这使得我们的融合结果的色度信息得到增强。

介绍

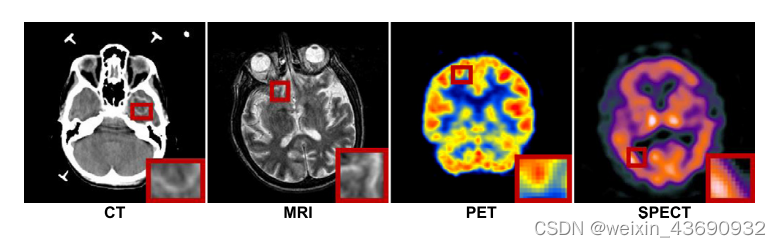

根据成像技术,多模态医学图像通常关注不同类别的信息,分为结构信息和功能信息。结构系统提供结构和解剖信息。例如,计算机断层扫描 (CT) 检测致密结构,例如骨骼和植入物。磁共振成像 (MRI) 提供软组织信息。功能系统包括正电子发射断层扫描 (PET) 和单光子发射计算机断层扫描 (SPECT)。PET表征肿瘤功能和代谢,SPECT反映组织和器官的血流 。

考虑到这些单模态图像的局限性,图像融合旨在将多模态图像中的典型信息和互补信息合并为单个输出,以实现更好的人类视觉感知和自动检测。

传统方法的融合一般是先分解,再利用手工制作的融合规则进行融合(需要相同的表示/分解方式,这也是缺点)。

许多基于深度学习的方法,虽然可以通过端到端设计避免融合规则的设计,但是医学图像的融合缺乏ground- truth,这使如何设计端到端模型成了难题,以及我们如何避免主观定义的独特特征。

此外,从上图可以注意到的,功能性医学图像 (例如,PET/SPECT图像) 本质上受到低信号噪声比 (SNR) 和有限的空间分辨率的影响。图像质量不理想受到一些退化因素的干扰,包括物理和硬件的限制,软件问题,马赛克等,使得PET和SPECT图像给识别功能信息带来困难,降低了检测精度。相比之下,MRI图像包含高质量的纹理细节。如果它们可以用于增强功能图像并减轻马赛克,则融合结果对于自动检测将更有价值。

综上我们提出了我们自己的方法->enhanced medical image fusion network (EMFusion)

贡献

-我们提出了一种用于医学图像融合的端到端无监督网络。它同时执行表层和深层约束以保存信息。

-在表面水平上,我们通过综合考虑显着性和丰度来测量源图像的活动水平。不同的表示/测量方式更适合多模态图像。

-在深层约束中,通过神经网络客观地衡量唯一性。因此,它进一步增强了独特信息的保存。

-EMFusion不是直接将色度信息保留在功能图像中,而是通过融合网络生成色度信息。MRI图像的纹理细节用于减轻马赛克,从而增强色度信息。

相关工作

Traditional medical image fusion methods

多种传统的医学图像融合方法。根据分解方案,这些方法可分为六类 😦 i) 基于金字塔的方法; (ii) 基于小波的方法,包括小波 ,离散小波,平稳小波,对偶树离散小波 、提升小波 等; (iii) 基于稀疏表示的方法 ; (iv) 基于子空间的方法,包括主成分分析 (PCA) ,非负矩阵分解 (NMF) 、独立成分分析 (ICA) 等; (v) 基于显著特征的方法 ; (vi) 其他方法,包括curvelet 、shearlet 等。

在这些方法中,不可避免地需要设计一些融合规则来生成权重图。这些权重图用于融合分解的子部分或系数。最后,通过逆变换生成融合结果。但是,设计分解方式和融合规则既费力又复杂。此外,这些方法对不同模态的图像使用相同的表示,并旨在保留相同的特征,例如高频信息,边缘等。但是,在多模态图像中,生命信息差异很大。例如,CT图像中的密集结构以对比度反映,而PET/SPECT图像中的功能信息以颜色表示。因此,对于多模态图像使用相同的表示是不合适的。

Deep networks for medical image fusion

深度学习在医学图像上的应用,Liu等人提出了一种网络,用于生成融合权重图,同时整个过程通过金字塔以多尺度方式进行。它是一个由高质量图像补丁及其模糊版本训练的监督模型。Xia等人用堆叠自动编码器 (SAE) 的思想训练了多个基本单元,得到深度堆叠神经网络。它将图像分解成多频图像,融合后放回最后一层,得到融合图像。在这些作品中,深度学习仅应用于某些子部分,以替代手工制作的特征提取或权重生成方式,而其他子部分仍由手动设计。

基于生成对抗网络 (GANs),DDcGAN在生成器和两个判别器之间建立了对抗网络,以使融合结果与两种类型的源图像无法区分。Huang等人通过构建多生成器多鉴别器条件GAN提出了MGMDcGAN。第一个cGAN生成真实的融合图像,第二个cGAN增强密集结构的信息,同时防止功能信息被掩模削弱。此外,还提出了几种统一的融合网络 。其中,IFCNN是一种应用中的训练方法的监督方法。这些方法通过主观地预先定义独特的特征来保存信息。此外,它们仅使用神经网络来融合亮度通道和MRI图像,而色度通道则直接保留而无需处理。MRI图像中清晰的纹理细节被忽略,没有被充分利用。因此,功能图像中的马赛克严重模糊了融合结果。

总之:我们新提出的方法都没有以上缺点。

方法

Problem formulation

我们将源图像表示为大小为 𝐻 × 𝑊 × 𝐶𝑎 的 𝐼𝑎 和大小为 𝐻 × 𝑊 × 𝐶𝑏 的 𝐼𝑏,其中 𝐻 和 𝑊 分别表示高度和宽度。𝐶 为通道数。我们的目标是学习 (𝐼𝑎,𝐼𝑏) 和 𝐼𝑓 之间的映射。𝐼𝑓 是大小为 𝐻 × 𝑊 × 𝐶𝑓 其中 𝐶𝑓 = max(𝐶𝑎,𝐶𝑏) 的融合图像。对于多模态医学图像,融合任务包括以下典型任务 😦 i) CT和MRI图像融合; (ii) PET和MRI图像融合; (iii) SPECT和MRI图像融合。

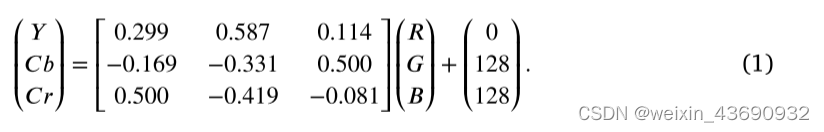

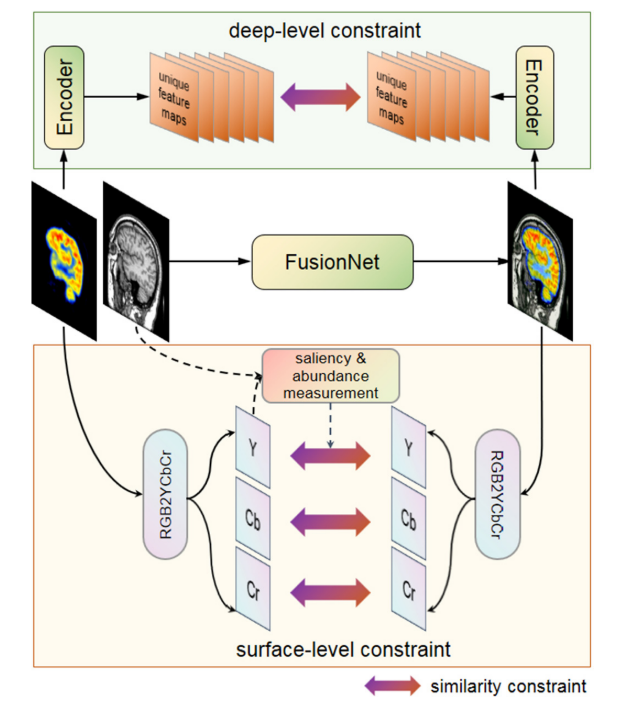

对于PET/SPECT图像,我们的目标是保留功能 (颜色) 信息。由于它们的色度(饱和度)信息在MRI图像中不可用,因此我们将它们传输到YCbCr空间中,并将色度信息分离到Cb和Cr通道中。然后,将Y (亮度) 通道与MRI图像融合。融合图像应保持Y通道的强度分布。在CT图像中,生命信息是具有高像素强度/显着性的密集结构 (例如骨骼和植入物)。在MRI图像中,保留丰富的纹理更有价值。基于以上分析,这些图像的特征主要有两种形式: 像素强度和纹理。 一方面,融合图像应保持显着的像素强度,以保留密集的结构或功能信息。另一方面,融合图像应保持丰富的纹理以保留软组织信息。因此,我们根据显著性和丰度进行测量。根据测量结果,我们在融合图像和源图像之间分配相似性约束 。由于它在图像级别上,因此我们也将其称为曲面级别约束。

然而,根据手工制作的测量标准,CT/PET/SPECT图像中某些显着性较低的区域将被省略,同时它们也可能包含MRI图像所没有的信息。为了避免这种情况,我们进行了补充和客观的测量,以增强独特信息的保存。考虑到神经网络可以提取各种特征作为替代,我们根据编码器网络提取的特征图定义唯一性。提取的融合结果的独特特征应与CT/PET/SPECT图像保持相似。由于此约束基于提取的特征,因此我们将其称为深层约束。表层和深层约束相结合,相互补充。

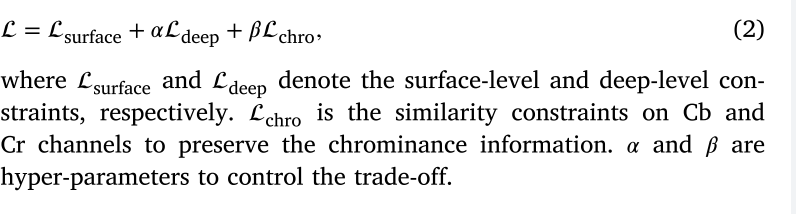

此外,我们希望在MRI图像中使用丰富的细节来减轻PET/SPECT图像中的马赛克。换句话说,MRI图像有望增强Cb和Cr通道。根据公式(1),由于Y通道是RGB通道的线性组合,因此其增强可以促进RGB通道的增强,这也将在Cb和Cr通道中显示。基于它,**我们直接生成RGB图像,而不是Y通道,**如下图所示。表面级约束是在转换后的YCbCr通道上执行的。这样,后续的通道合并和空间转换也可以保存在我们的方法中。

(约束仅在训练阶段应用。在测试阶段,仅需要融合网即可生成融合结果。)

我们训练融合网学习融合映射。因此,其损失函数可以定义如下:

Surface-level constraint based on saliency and abundance measurement

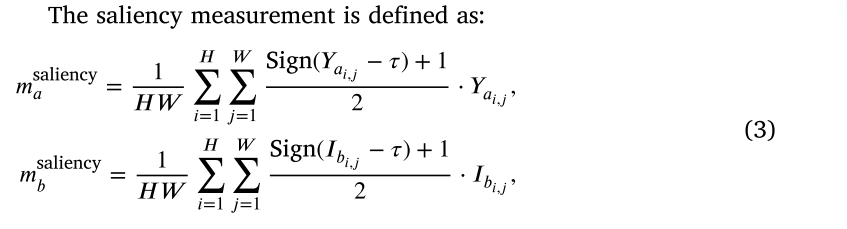

我们假设 𝐼𝑎 是CT/PET/SPECT图像,𝐼𝑏 是相应的MRI图像 (𝐶𝑏 = 1)。由于希望保留显着的像素强度和丰富的梯度,因此我们对 𝑌𝑎 和 𝐼𝑏 进行了显着性和丰度(abundance)测量。当 𝐼𝑎 为PET/SPECT图像时,𝑌𝑎 为 𝐼𝑎 的Y通道; 而当 𝐼𝑎 为CT图像时,𝑌𝑎 = 𝐼𝑎。

其中 𝜏 是筛选显著区域的阈值。sign (⋅) 是符号函数。下标 𝑖 和 𝑗 表示像素在第 𝑖 行和第 𝑗 列。

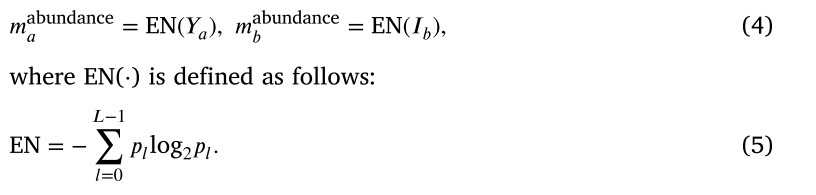

为了丰富度测量(abundance measurement),我们利用熵来测量图像中包含的信息,具有更多纹理细节的区域从信息论的角度将显示出更大的信息量 (更大的熵) 。尽管熵和梯度都可以评估纹理细节的丰度,但是熵具有梯度所没有的优势。如CT图像所示,它在密集结构的边缘上包含一些具有较大值的梯度。而在其他地区,梯度稀疏且小得多。如果使用梯度作为测量标准,则测量结果将被边缘严重误导。相反,**熵是通过图像中每个灰度级的概率分布来测量的。它考虑了整体像素强度分布,并且不受稀疏大的梯度的影响。**为此,我们使用熵来测量,其数学定义为:

𝐿 是灰度等级的数量,并设置为256。𝑝𝑙 是对应灰度的概率。更大的EN意味着包含更多的信息。

在显著性和丰度测量相结合的情况下,可以分别得到 𝐼𝑎 和 𝐼𝑏 的最终浅层水平测量结果作为它们的活度(activity)得分:

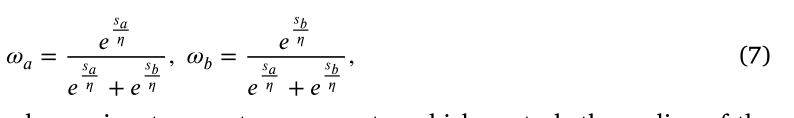

然后,我们使用活动分数来分配其重要度权重 𝜔𝑎 和 𝜔𝑏。我们依靠重要性权重来分别限制融合图像和两个源图像之间的相似性。重要性权重越高,则融合图像与对应的源图像之间的相似度应该越高。一方面,𝜔𝑎 和 𝜔𝑏 之间的数值大小关系应与 𝑠𝑎 和 𝑠𝑏 之间的数值大小关系一致。另一方面,权重应满足条件 𝜔𝑎+𝜔𝑏 = 1且0 ≤ 𝜔𝑎,𝜔𝑏 ≤ 1。因此,我们根据softmax函数分配 𝜔𝑎 和 𝜔𝑏

其中 𝜂 是一个温度参数,它控制 𝑠𝑎 和 𝑠𝑏 之间差异的缩放。

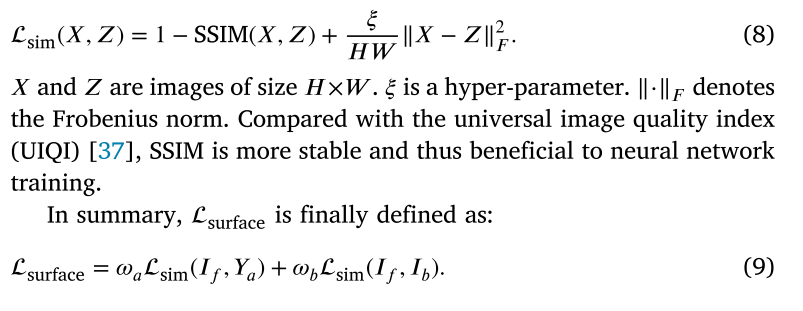

对于相似性约束,我们使用结构相似性指数测度 (SSIM) 和均方误差同时约束高频和低频信息的相似性:

Deep-level constraint for enhanced preservation of unique information

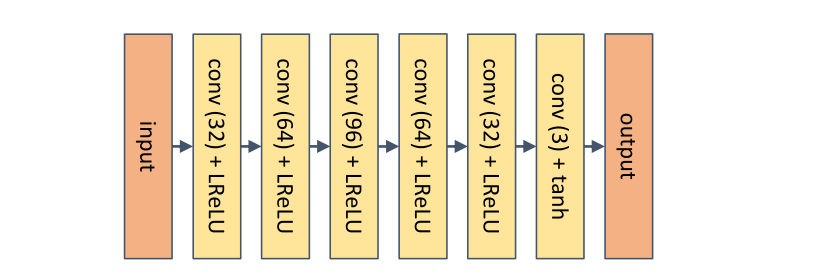

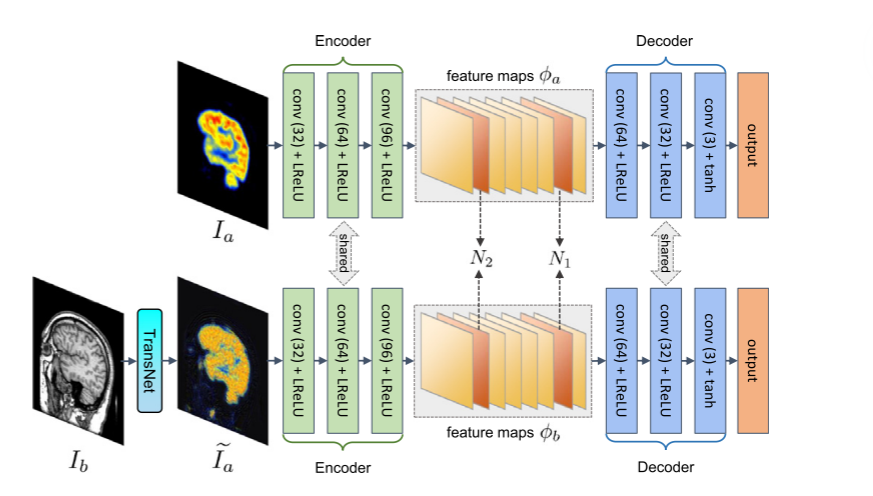

如公式中所定义(3),在显着性活动测量中只能检测和考虑大于 𝜏 的像素强度。它限制了显着性低的区域的信息保留。相比之下,根据公式(5),EN将所有值考虑在内,无需筛选即可测量abundance。因此,𝐼𝑏 中的所有纹理细节都被考虑在内,而 𝐼𝑎 中的一些信息被省略了。为了更完整和客观地定义 𝐼𝑎 中的唯一信息,我们执行深层次的定义。根据唯一性的定义,𝐼𝑎 的唯一信息只有在 𝐼𝑎 中,没有在 𝐼𝑏 中。如果可以通过特定的转换从 𝐼𝑏 获取 𝐼𝑎 中的信息,则此信息不是 𝐼𝑎 所独有的。因此,我们将 𝐼𝑎 的唯一信息定义为无法传给𝐼𝑏 。为此,我们首先学习一个转换 𝑓𝑇,该转换将 𝐼𝑏 转换为伪 𝐼𝑎,称为 ̃ 𝐼𝑎,即 ̃ 𝐼𝑎 = 𝑓𝑇 (𝐼𝑏)。 ̃ 𝐼𝑎 应尽可能与 𝐼𝑎 相似,以覆盖尽可能多的公共信息,如图3所示。一个名为TransNet的网络被训练学习 𝑓𝑇,其中输入为 𝐼𝑏,输出为 ̃ 𝐼。TransNet的网络体系结构如图4所示。

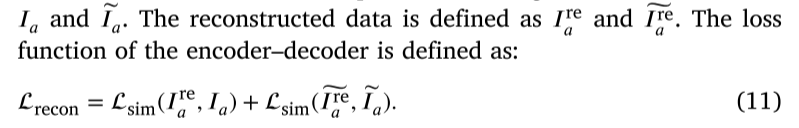

根据公式定义其损失函数来约束 ̃ 𝐼𝑎 和 𝐼𝑎 之间的相似性:

我们依靠从卷积神经网络中提取的特征图来定义唯一信息。因此,对编码器-解码器网络进行了训练,以提取特征并重建输入。训练数据由 𝐼𝑎 和 𝐼 ̃ 𝑎 组成。

网络架构如下图所示:

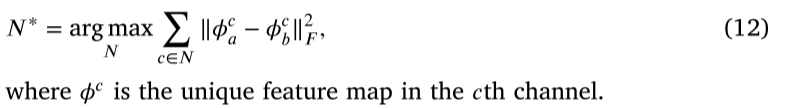

使用预先训练的编码器-解码器,可以通过编码器提取许多特征图。我们将从 𝐼𝑎 中提取的特征图定义为 𝜙𝑎,从 ̃ 𝐼a中提取的特征图定义𝜙𝑏 ,因为 ̃ 𝐼a从 𝐼𝑏 中转移的,从 𝐼𝑓 中提取的特征图定义为 𝜙𝑓,从 ̃ 𝑓 中提取的特征图定义为 𝜙𝑓。通常,特征图在一个通道上对应于一种类型的特征。如果某些通道上的 𝜙𝑎 和 𝜙𝑏 差异较大,我们将这些通道上的特征图视为 𝐼𝑎 的唯一信息。这些通道具有提取独特特征图的功能。我们用一个集合 𝑁 = {𝑁 1,𝑁 2,…,𝑁𝑛} 来表示这些通道的序号。在我们的工作中,我们设置 𝑛 = 10 (大约所有特征图的10%)。那么,最优解的解可以在数学上表示为:

由于这些通道可以提取 𝐼𝑎 中的唯一信息,因此从这些通道提取的特征图中,𝐼𝑓 被期望与 𝐼𝑎 保持相似。它是深层约束的定义,其数学定义为:

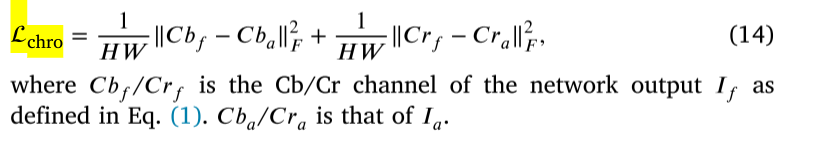

Chrominance constraint

当 𝐼𝑎 为PET/SPECT图像时,应在融合图像 𝐼𝑓 中保留色度信息。因此,基于Cb和Cr通道定义了L chro :

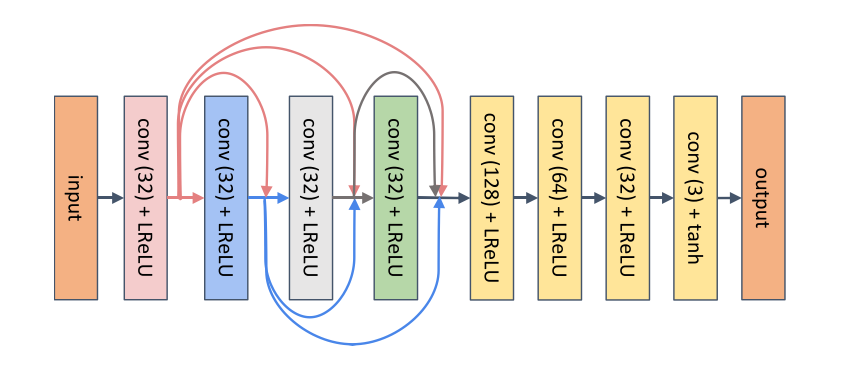

FusionNet

我们训练一个名为FusionNet的网络,以学习融合结果和源图像之间的映射。它以两个源图像的级联作为输入,直接输出最终的融合结果。FusionNet的网络体系结构如图6所示。它由八个卷积层组成。对于前四层,我们采用密集连接层。原因是已经证明,**如果靠近输入的层和靠近输出的层之间存在短连接,则可以更有效地训练卷积神经网络。**因此,我们以前馈方式在前四个层中的每个层与其余层之间建立了短连接。它可以减轻梯度消失的问题并增强特征传播,同时大大减少参数数量。最后,通过前四层提取的特征被馈送到随后的卷积层中,以逐渐减少通道并生成最终的融合图像。

3084

3084

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?