图像超分中的深度学习网络

论文:Deep Learning for Image Super-resolution:A Survey

1.通常,使用深度学习技术的SR算法的系列在以下主要方面彼此不同:不同类型的网络体系结构[、不同类型 损失函数、不同类型的学习原则和策略等

质量评估

2.质量评估:主流的还是PSNR和SSIM

PSNR:通过最大可能像素值(表示为L)和图像之间的平均平方误差(MSE)来定义PSNR。一般情况下

使用8位图像表示,L=255,PSNR的典型值从20到40不等,其中越高越好。但仅关心相同

位置的像素值之间的差异,而不是人的视觉感知(即,图像的外观如何)。

SSIM: 在图像之间的结构相似性,基于三个相对独立的比较,即亮度、对比度和结构。

(也提出了MSSIM,它将图像分割为多个窗口,评估每个窗口的SSIM,最后将它们平均为最终的MSIM。)

MOS:平均意见得分,人主观给图片打分

Task-based Evaluation基于任务的评价:评估重建性能。具体来说,研究人员将原始和重建的HR图像输入一个经过训练的模型,并通过比较对预测性能的影响来评估重建质量。

其他:多尺度结构相似性(MSSSIM)、信息保真度准则(IFC)和视觉信息保真度(VIF)、特征相似度(FSIM)

操作通道

3.操作通道:RGB和YCrCb。较早的模型有利于在YCbCr空间操作,但最近的模型倾向于在RGB通道上操作。

有监督算法

4.有监督算法:它们本质上是一组组件的组合,例如模型框架、上采样方法、网络设计和学习策略等。

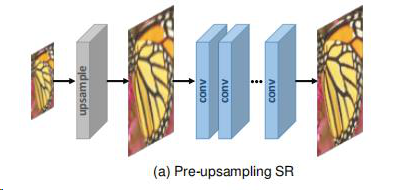

预上采样

1)预上采样Pre-upsampling Super-resolution:在所有处理操作前,进行上采样。具体地,使用传统方法(例如,双三次插值)将LR图像向上采样到具有期望大小的粗HR图像,然后在这些图像上应用深度CNN以用于重建高质量图像。

减少了学习难度,且可以输入任意比例图像,但同时也会放大噪声,且由于大多数操作在高维图像上,时间和空间复杂度较高

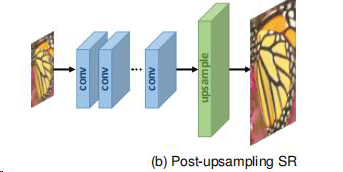

后采样超分

2)后采样超分Post-Upsampling Super-resolution:上采样层被置于网络末端用来产生输出图像,并带有可学习参数。这样做不仅可以让网络能够自适应的学习上采样过程,还能让特征提取过程在低维空间上进行,极大的降低计算负担。它还带来了相当快的训练速度和推理速度。但这种方法不能适应不同的放大倍数,要为每一种放大倍数重新训练一次模型

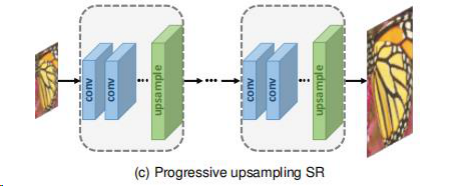

逐步上采样

3)逐步上采样Progressive Upsampling Super-resolution:模型通过多次上采样逐步获得目标尺寸的超分辨图像,这种设计不仅能降低学习难度,还能从一定程度上兼容不同的放大倍数。此外,这种多阶段学习的网络结构设计可以结合一些特定的学习方法(诸如课程学习、多监督学习)进一步降低学习难度。拉普拉斯金字塔SR网络Laplacian pyramid SR network (LapSRN)用的这个结构,此框架下的模型基于CNN的级联,并逐渐重建更高分辨率的图像,在每个阶段,图像被向上采样到更高的分辨率,并且被CNN细化。通过将困难的任务分解为简单的任务,该框架下的模型不仅大大降低了学习难度,而且获得了更好的性能,解决了多尺度超分辨率问题,而不引入过多的空间和时间成本,然而,这些模型也遇到了一些问题,例如多个阶段的复杂模型设计和训练难度,因此需要更多的结构设计以及训练策略

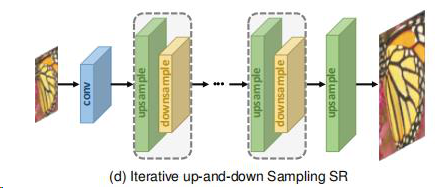

迭代上下采样

4)迭代上下采样超分辨率Iterative Up-and-down Sampling Super-resolution:更好地挖掘深LR-HR关系,尝试迭代地应用反向投影细化,即,计算重构误差,然后将其重新融合以调整HR图像强度。向上和向下采样层,并提出深背投影网络(DBPN),以交替的方式互相连接上下采样层,使用所有中间重建的HR特征映射的级联重建最终HR结果。DBPN中使用的背投单元(the back-projection units)具有非常复杂的结构并且需要繁重的手动设计。由于这一机制刚刚被引入以深度学习为基础的超分辨率。 他的框架具有巨大的潜力,需要进一步的探索。

上采样的学习方式

5.上采样的学习方式:

1)基于插值:最近邻插值 (Nearest Neibor): 使用中心像素块填充满插值空隙;双线性插值 (Bilinear): 在横竖两个方向上进行线性插值;双三次插值 (Bicubic): 在横竖两个方向上进行三次插值,插值时均为先进行横向插值再进行纵向插值与双线性插值相比,双三次插值的运算量为4×4像素,从而以较少的插值伪迹和较低的速度获得了更平滑的结果。

2)反卷积:具体来说,它通过插入零值和进行卷积来扩展图像,从而提高图像的分辨率。在原始像素周围填充足够数量的0可以保证卷积得到的特征图的尺寸符合放大倍数要求。反卷积层由于其与原始卷积的兼容性而被广泛应用,但反卷积层具有“非均匀重叠效应”,这会导致生成图像带有典型的棋盘纹理,使生成效果变差。

3)亚像素卷积:通过卷积生成多个信道然后再整合它们,亚像素层使用多个卷积核直接在原始图像上(带padding)做卷积,然后将得到的多个特征图进行重排列合成出一张更大的图像,这要求特征图的数量必须是放大倍数的平方。与转置卷积层相比,亚像素层最大的优势是接收域更大,提供了更多的上下文信息以帮助生成更准确的细节。

残差块

6.残差块:shortcut以及元素点积

1)全局残差:它避免了从一个完整的图像到另一个图像的复杂转换,只需要学习一个残差映射来恢复丢失的高频细节。常用于预先上采样框架

2)局部残差:用于缓解网络深度不断增加造成的退化问题,提高学习能力。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

50

50

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?