自用

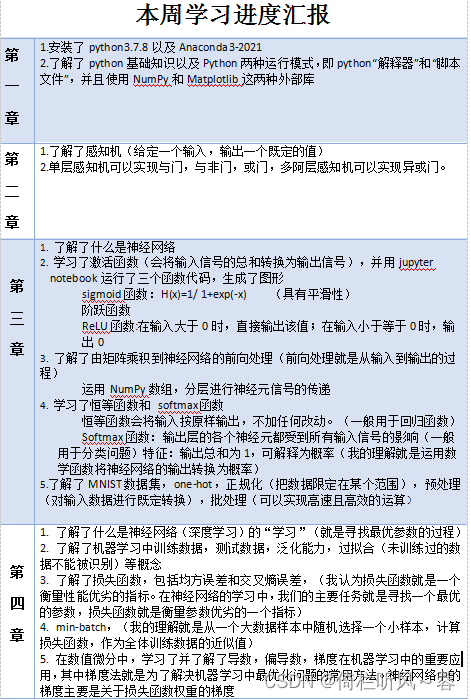

第一章 1.安装了python3.7.8以及Anaconda3-2021

2.了解了python基础知识以及Python两种运行模式,即python“解释器”和“脚本文件”,并且使用NumPy和Matplotlib这两种外部库

第二章 1.了解了感知机(给定一个输入,输出一个既定的值)

2.单层感知机可以实现与门,与非门,或门,多阿层感知机可以

实现异或门。

第三章 1. 了解了什么是神经网络

2. 学习了激活函数(会将输入信号的总和转换为输出信号),并用jupyter notebook运行了三个函数代码,生成了图形

sigmoid函数:H(x)=1/ 1+exp(-x) (具有平滑性)

阶跃函数

ReLU函数:在输入大于0时,直接输出该值;在输入小于等于0时,输出0

3. 了解了由矩阵乘积到神经网络的前向处理(前向处理就是从输入到输出的过程)

运用NumPy数组,分层进行神经元信号的传递

4. 学习了恒等函数和 softmax函数

恒等函数会将输入按原样输出,不加任何改动。(一般用于回归函数)

Softmax函数:输出层的各个神经元都受到所有输入信号的影响(一般用于分类问题)特征:输出总和为1,可解释为概率(我的理解就是运用数学函数将神经网络的输出转换为概率)

5.了解了MNIST数据集,one-hot,正规化(把数据限定在某个范围),预处理(对输入数据进行既定转换),批处理(可以实现高速且高效的运算)

第四章 1.了解了什么是神经网络(深度学习)的“学习”(就是寻找最优参数的过程)

2.了解了机器学习中训练数据,测试数据,泛化能力,过拟合(未训练过的数据不能被识别)等概念

3.了解了损失函数,包括均方误差和交叉熵误差,(我认为损失函数就是一个衡量性能优劣的指标。在神经网络的学习中,我们的主要任务就是寻找一个最优的参数,损失函数就是衡量参数优劣的一个指标)

4.min-batch,(我的理解就是从一个大数据样本中随机选择一个小样本,计算损失函数,作为全体训练数据的近似值)

5.在数值微分中,学习了并了解了导数,偏导数,梯度在机器学习中的重要应用,其中梯度法就是为了解决机器学习中最优化问题的常用方法。神经网络中的梯度主要是关于损失函数权重的梯度

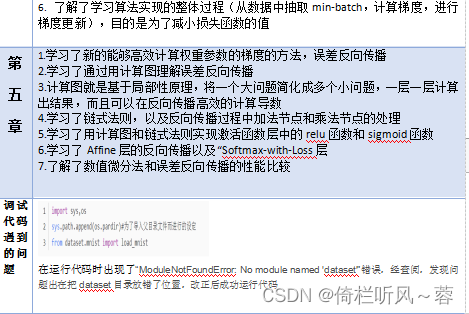

6.了解了学习算法实现的整体过程(从数据中抽取min-batch,计算梯度,进行梯度更新),目的是为了减小损失函数的值

第五章 1.学习了新的能够高效计算权重参数的梯度的方法,误差反向传播

2.学习了通过用计算图理解误差反向传播

3.计算图就是基于局部性原理,将一个大问题简化成多个小问题,一层一层计算出结果,而且可以在反向传播高效的计算导数

4.学习了链式法则,以及反向传播过程中加法节点和乘法节点的处理

5.学习了用计算图和链式法则实现激活函数层中的relu函数和sigmoid函数

6.学习了Affine层的反向传播以及“Softmax-with-Loss层

7.了解了数值微分法和误差反向传播的性能比较

416

416

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?