论文阅读笔记|A view-free image stitching network based on global homography

前言

L. Nie, C. Lin, K. Liao, M. Liu, and Y. Zhao, “A view-free image stitching network based on global homography,” Journal of Visual Communication and Image Representation, p. 102950, 2020.

本文提出了一种基于全局单应性的视角自由的图像拼接网络,简称VFISNet,

源码地址

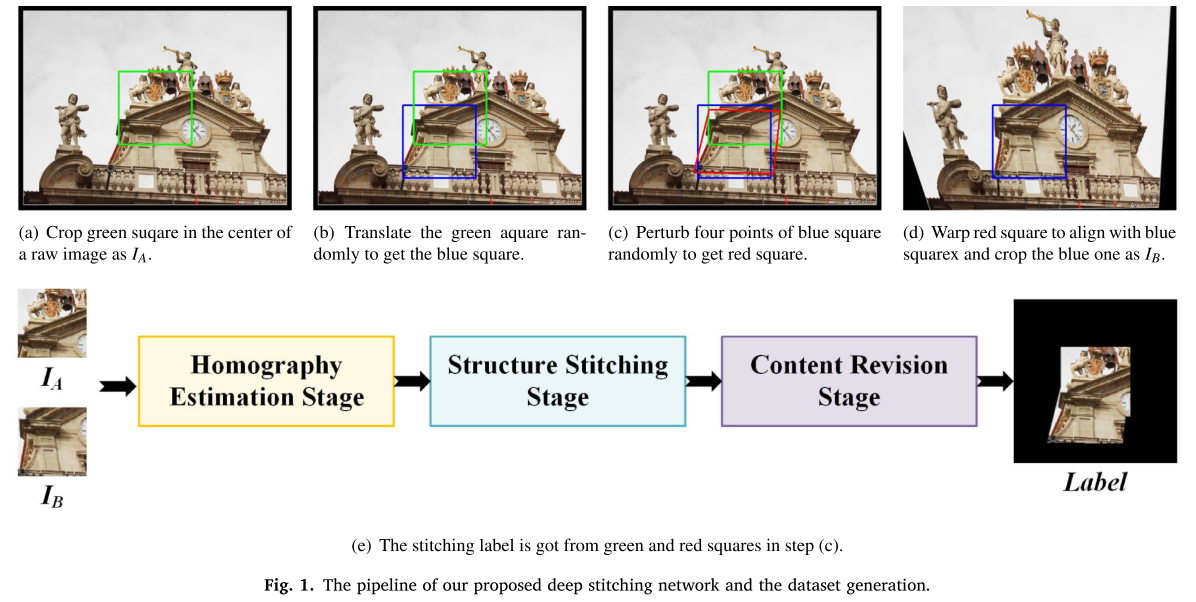

算法框架如图所示:

主要包括三个阶段:

- Homography Estimation

- Structure Stitching

- Content Revision

本文的主要贡献:

- 提出了一个视角自由的图像拼接网络

- 为了尽可能减轻伪影,设计了一个global correlation层和一个结构到内容逐渐拼接模块

- 构造了一个图像拼接合成数据集,图像之间的重叠区域更小

VFISNet

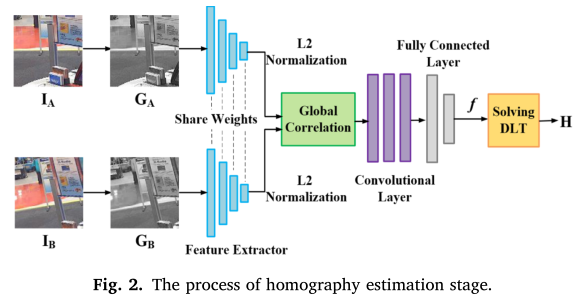

Homography estimation stage

单应性估计阶段就是基于先前的DHN方法,一个VGG风格的特征提取骨干网络。接着为了减小平均角点误差,提升单应性估计精度,从光流估计方法(PWC-Net、Flownet2等)得到启发,作者引入了一个Global Correlation层,然后接了三个卷积层和两个全连接层,输出是8个参数的

f

f

f,表示图像 IB 相对于图像 IA 四个顶点的偏移量。再通过DLT层计算出图像 IB 变换到图像 IA 的单应性矩阵H。

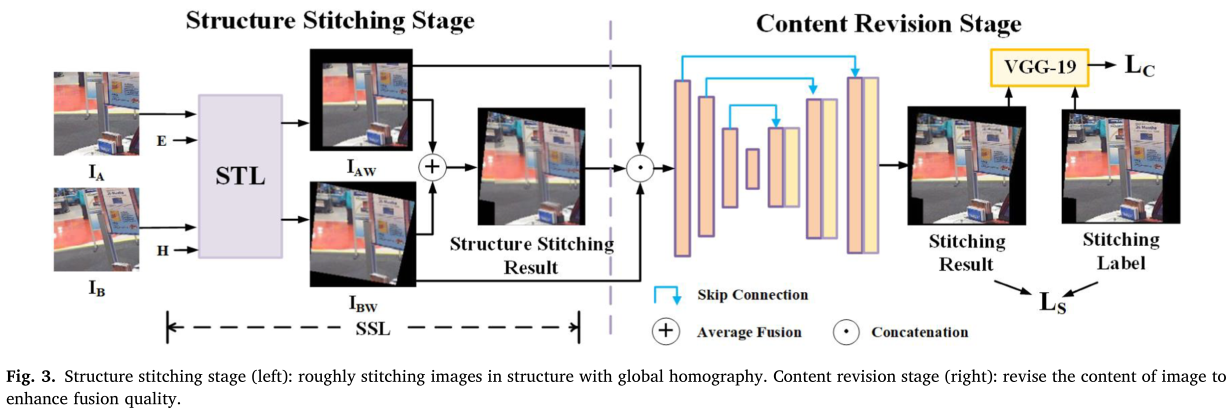

Structure stitching stage

结构拼接阶段是基于空间变换网络。对于IA,使用单位矩阵,变换为IAW;对于IB,使用单应性估计阶段得到的H,变换为IBW,IAW和IBW通过平均融合得到Structure Stitching Result。再将IAW、IBW、Structure Stitching Result连接得到一个9通道的图像。此时得到的是一个粗对齐拼接结果,因为单应性估计是从图像四个顶点的偏移量计算出,不会将每个像素对齐,一点预测误差就会导致整个拼接结果视觉上的模糊。

Content revision stage

内容修正阶段是一个UNet网络,输入是粗对齐拼接结果,输出是精确对齐拼接结果。

损失函数

对于单应性估计阶段,损失函数是预测偏移量和ground truth偏移量之间的MSE误差;

对于内容修正阶段,损失函数是预测拼接结果和ground truth label之间的L1误差,此外还加上了VGG19前4层提取特征图之间的L2误差。

数据集生成

如开头图所示

1.首先在COCO2014数据集的一张图片上随机裁剪出一个128×128的区域,如图中绿框所示,作为IA;

2.接着在[-64, 64]范围内进行随机位移,得到图中蓝框;

3.然后在[-25, 25]范围内对图像四个顶点随机扰动,得到图中红框,红框相对于绿框四个顶点的偏移量就作为单应性估计阶段的ground truth偏移量,红框和绿框围成的像素内容作为内容修正阶段的Label;

4.将绿框到红框计算出的单应性矩阵逆变换应用到原图上,在蓝框位置处裁剪出IB。

从而得到一组训练样本(IA,IB,f,Label)。

实验

训练:分两步,先训练Homography estimation stage,再训练后面Content revision stage。

评价:

- 与深度单应性估计方法比较

- 与现有拼接方法比较

- 消融实验

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?