Camera基础知识培训

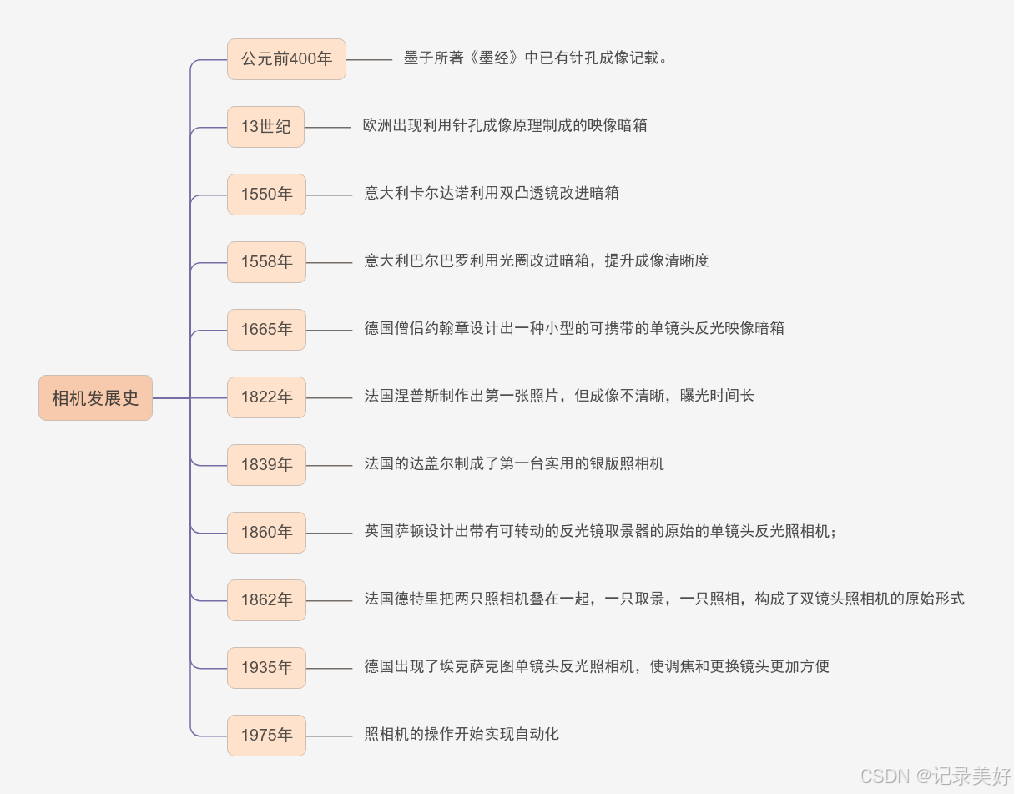

1.相机发展史

1.1 史前阶段:光学原理的探索(公元前-19世纪初)

1.暗箱(Camera Obscura)

- 公元前4世纪:中国墨子与古希腊亚里士多德发现小孔成像原理。

- 文艺复兴时期:达芬奇用暗箱辅助绘画,随后改进为便携式设备,成为现代相机的雏形。

1.2 摄影术的诞生(19世纪)

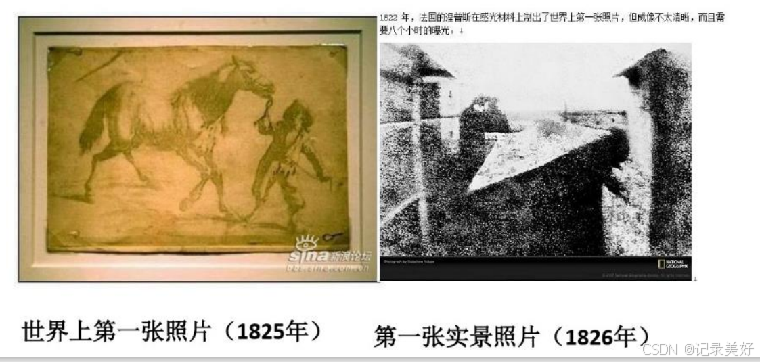

1.首个永久影像(1826)

法国发明家尼埃普斯用涂布沥青的锡板拍摄《窗外》,曝光时间长达8小时。

2.达盖尔银版法(1839)

达盖尔发明银版摄影术,将曝光时间缩短至分钟级,摄影术正式面世。

3.湿版与干版技术(1850s-1870s)

湿版火棉胶法(1851)普及了肖像摄影,干版技术(1871)使摄影材料更易保存。

1.3 胶片时代的革命(1888-20世纪末)

1.柯达的平民化(1888)

乔治·伊士曼推出全球首款胶卷相机“柯达1号”,口号“你只需按下快门”。

2.35mm胶片与小型化(1913-1925)

徕卡发布首款35mm便携相机Leica I(1925),开启了新闻与街头摄影浪潮。

3.单反结构成熟(1940s-1950s)

东德Exakta Varex(1949)实现可换镜头单反设计,尼康F系列(1959)确立专业单反标准。

4.自动化与普及(1960s-1990s)

美能达SR-T 101(1966)引入测光技术;1977年佳能AE-1成为畅销自动曝光的单反机型。

1.4 数码时代颠覆传统(1975-2010s)

1.早期数码实验

柯达工程师史蒂文·萨松发明首台数码相机原型机(1975),重3.6公斤,记录黑白图像到磁带。

2.商业化突破

富士DS-1P(1988)首用闪存卡;柯达DCS 100(1991)为专业新闻数码单反。

3.消费级数码兴起

索尼Cyber-shot DSC-F1(1996)推动家用数码相机普及;佳能EOS 5D(2005)实现全画幅数码化。

1.5 智能手机与计算摄影(2000s至今)

1.手机摄像头崛起

夏普J-SH04(2000)首次搭载11万像素摄像头;iPhone 4(2010)的500万像素与Retina屏重塑移动摄影。

2.多摄与AI算法(2017至今)

华为P20 Pro(2018)配置三摄,引入夜景AI算法;Google Pixel的计算摄影技术(如HDR+)优化成像质量。

3.无反相机替代单反

索尼α7系列(2013)推动全画幅无反市场;佳能、尼康于2018年后全面转向无反系统。

1.6 未来趋势

- 计算摄影深化:AI实时优化、虚拟光圈模拟等技术普及。

- 三维影像重构:LiDAR与多传感器融合实现3D建模。

- 影像元宇宙结合:VR/AR内容创作推动360°相机发展。

小结

从暗箱到AI摄影,相机既是科技进步的缩影,也彻底改变了人类记录与表达的方式。每一次技术跃迁(银版→胶片→数码→计算)都让影像更易得、更富创意。

2.Camera硬件介绍

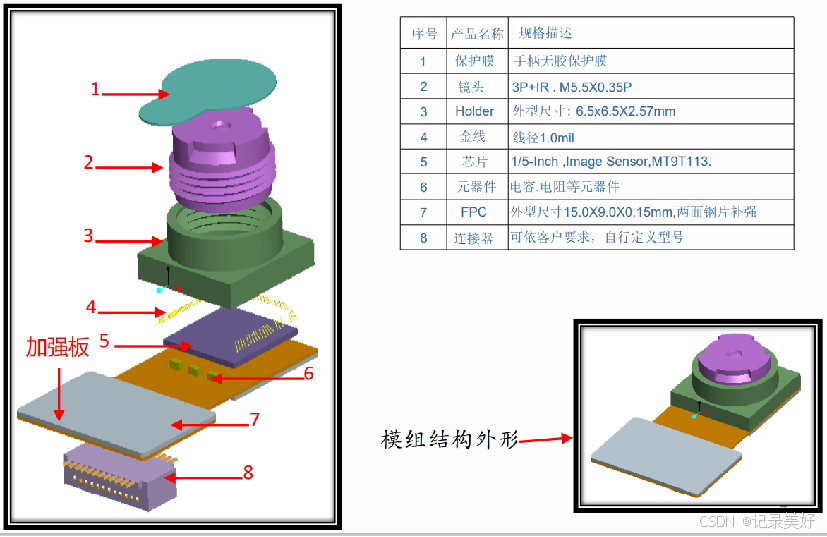

2.1 Camera主要部分

Camera的主要部件分为保护膜,镜头,镜座(Holder)、金线,芯片(sensor)、电子元器件、FPC、连接器几个部分。

- 保护膜:适用于对与镜头的保护,防止镜头出现灰尘或者污渍,以及防止镜头镜片出现划痕。

- 镜头:主要作用是聚集光线,并将光线折射到传感器上

- 马达(VCM):通过移动镜头来实现光学变焦

- IR滤光片:人眼感测器只能检测到波长介于400nm至700nm之间的可见光,IR滤光片就是用来避掉户外的红外线的光线,避免画面整个偏红,常用的IR有两种:1:普通的IR玻璃;2:蓝玻璃。

- 镜座(Holder):Holder是镜头的支撑体,目的是为了遮光和密封。Holder的材料一般会使用PC,ABS,LCP或PA46/66等塑胶料。重点是控制Holder的Particle状况

- 金线:用于连接sensor和FPC

- 芯片(sensor):感光元件,通过将光信号转变为电信号,最后将电信号换为数字信号生成图像数据。

- 元器件:用于搭建电路

- FPC:与连接器一起完成camera单体内部相关器件与手机主板之间的信号导通。

- 连接器:Camera模组一般使用的连接器类型有两种:1、金手指拔插式;2、按压式;3、插座式

2.1.1 Camera镜头介绍

Camera镜头用于改变光线,从而是外界的光线聚集在sensor上形成图像。

手机相机的镜头往往是由多种镜片组成的,不同镜片之间可能会插入间隔环来保证不同镜片之间的距离。

镜片的类型可大致分为:塑料球面镜片,塑料非球面镜片,玻璃球面镜片,玻璃非球面镜片等。

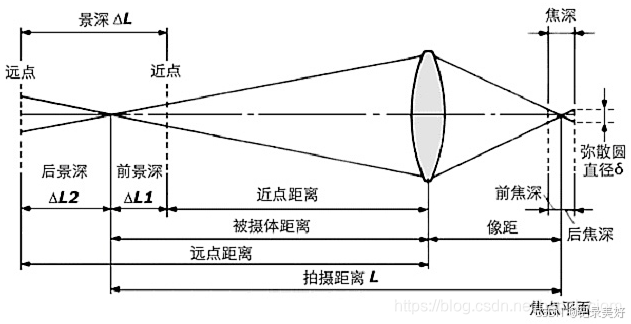

镜头的参数主要分为:焦距、FOV(视场角)、光圈、色差/球差/慧差、景深、畸变等

-

焦距/相距:镜头的焦距可以确定当前镜头可以清晰成像的距离;

-

FOV(视场角):视场角是指镜头成像所能覆盖的范围,是由焦距和sensor尺寸决定的:镜头焦距越短,视场角越大;sensor尺寸越大,视场角越大

-

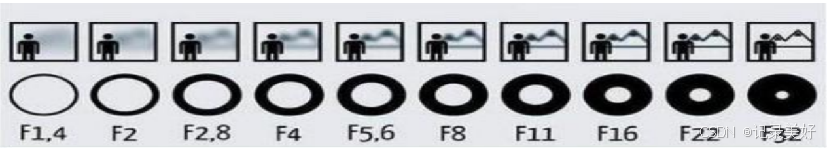

光圈:光圈值越大,代表光圈越小,景深越大。光圈代表了镜头的进光量,和光学显微镜的光圈作用相同,当光圈越大时,进光量越大,图像就更亮,反之图像更暗。

-

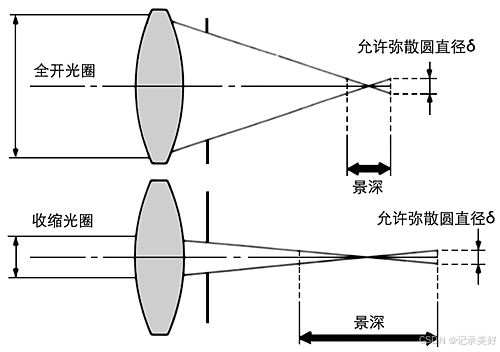

景深:景深DOF:Depth of Field,当焦点对准某一点时,其前后都仍可清晰的范围。

镜头的景深是由光圈、焦距、拍摄主体距离一起决定。

光圈越大,景深越小;光圈越小,景深越大;

2.1.2 Camera马达介绍

Camera马达原理是在holder内有一个小型的强力磁场,通过driver IC来控制VCM内部线圈的电流二产 生磁场力,从而带动中间的lens,而形成自动变焦的效果。

手机相机常用的用的CCM马达是VCM(Voice Coil Motor)通过微距离移动整个镜头,改变焦距,实现清 晰影像。

AF距离=I2-I1

2.1.3 Camera sensor介绍

CameraSensor原理传感器,是一种电子相机中的设备,它可以将镜头所呈现的光学图像转换为电信号。

在camera方面,sensor可以理解为芯片,里面包括一些像素点(pixel),以及isp信号处理器,现在市面上的CCM sensor大致可以分为两种,一种为CMOS,一种为CCD。

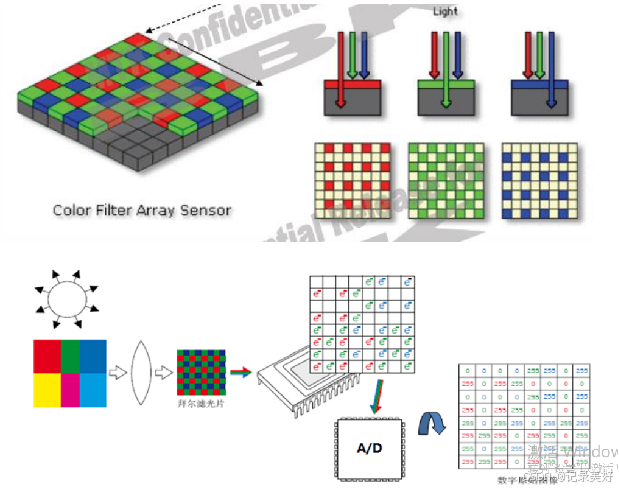

手机camera使用的更多是CMOS的sensor,CMOS sensor的列阵都是采用Bayer模式,Bayer就是采用多枚滤光器呈棋盘状分布在感应区,其中绿色像素的数量是红色和蓝色的两倍,这点是针对人的眼睛对绿色最为敏感。

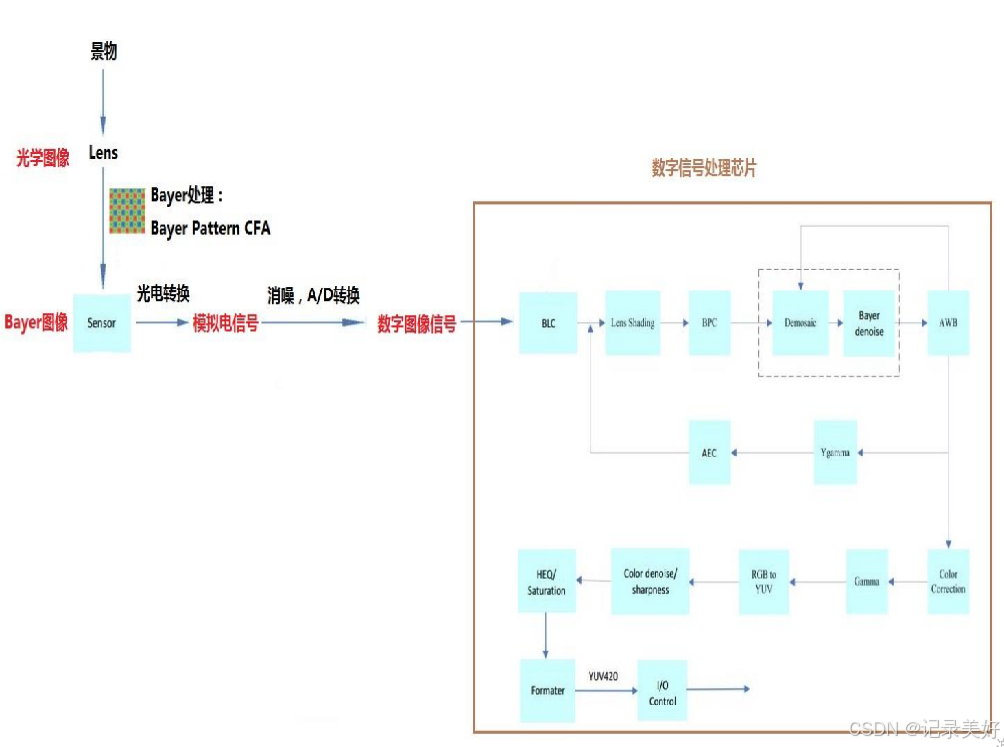

2.1.4 Camera图像传输与处理

Sensor的经过曝光转换得到的数字信号,也就是数字原始图像,就是我们常说的raw图,此时的图像未经过处理,我们也无法正常查看,且此时的图像会由于硬件原因存在诸如颜色,噪点等问题。此时就需要isp(图像信号处理单元)对传感器输入的信号进行运算处理,最终得出经过线性纠正、噪点去除、坏点修补、颜色插值、白平衡校正、曝光校正等处理后的结果。

一般来说平台都是拥有isp芯片的,所以sensor可以直接将原始数据传递给平台,但是也有部分CCM是自带isp处理能力的,这种CCM就可以直接输出yuv格式的图像。

2.1.5 名词解释

- BLC:black level correct黑电平矫正,sensor即使在黑暗的环境下也会存在电流的输出,这部分电流对图像造成的影响需要纠正,否则颜色会出现部分异常。

- Lens shading:由于镜头的特性会导致sensor的进光量在不同区域不一样,一般表现为中间获得的光更多,边缘获得的光更少,也就使得sensor转换的原始图像出现中间亮四周暗的情况,Lens shading可以纠正这种亮度异常,让图像亮度一致;

- BPC:坏点矫正,sensor的像素中可能存在某些像素与其他像素明显不同,会导致图像中的某个像素点颜色异常,所以需要矫正。

- Demosaic:将raw图像换为RGB图像

- Bayer denoise:去除图像转换造成的噪声。

- AWB:自动白平衡,用于改变图片的色温,从而让最终看到的图像与人眼看到的图像接近。

- AEC:自动曝光控制,用于改变图像曝光的时间,根据不同环境调节曝光时间,让最后的图像不至于过亮或者过暗。

- Ygamma/gamma:为图像进行伽马编码的目的是用来对人类视觉的特性进行补偿,从而根据人类对光线或者黑白的感知,最大化地利用表示黑白的数据位或带宽。

- Color correction:颜色校正;

- Collor denoise/sharpness:再次去噪,并进行锐化,使图片更清晰

- **HEQ/Saturation:**调整色彩饱和度

经过一系列的处理后,isp会输出yuv的图像,此时的图像已经与最终的图像可能没有区别了,通过编码将yuv转换为jpeg格式或其他格式就是我们最终见到的图像。

2.2 Camera串口介绍

2.2.1 GPIO

GPIO(General Purpose I/O Ports)意思为通用输入/输出端口,就是一些引脚,可以通过它们输出高低电平或者通过它们读入引脚的状态-是高电平或是低电平。

2.2.2 I2C

I2C(Inter Integrated Circuit),简称IIC或I2C,是由Philips公司开发的两线时串行总线,用于SOC与外设的连接通讯,它只需要两根线就能实现I2C的通讯,采用主从模式,主的一方可以读写数据,而从的一方只能等待被读写。从的一方没有主动权。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?