文章目录

为什么要用CNN来处理图片

卷积神经网络近年来在计算机视觉中大放异彩,是什么特点让卷积神经网络在图像处理方面大火呢?

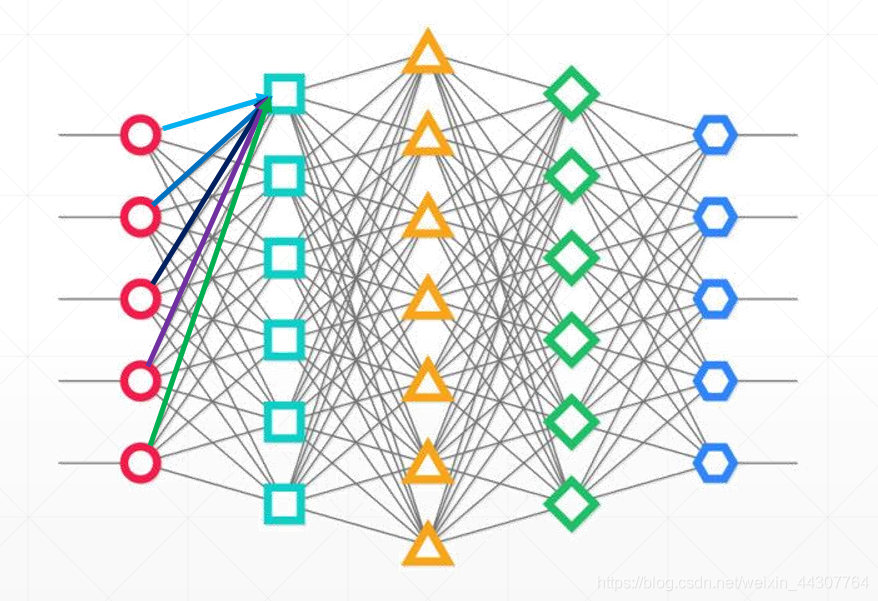

首先我们来看一张图片:

这是一张普通的表示全连接神经网络的结构图。大家可以看到全连接神经网络中,每一个节点都与前一层所有的节点想连接。鉴于图像数据和其他数据的区别,我们做个简单的计算即可发现全连接神经网络处理图像的弊端。

比如一个像素很低3232的图片数据,那么它的输入既有1024个节点,那么神经网络的第二层的第一个节点则需要1024个权重w来和前一层进行连接,同理第二层的第二个节点也需要1024个权重w和第一层所有节点连接…… 并且此处第一层的权重和第二层的权重之间是不同的,是没有联系的。所以可想而知,这个神经网络的数据量和计算量将是十分庞大的。并且大家都知道,现在随着对图片清晰度要求的逐步提高,图片早已不可能是3232像素的图片了,那对全连接层处理图片来说将是灾难。

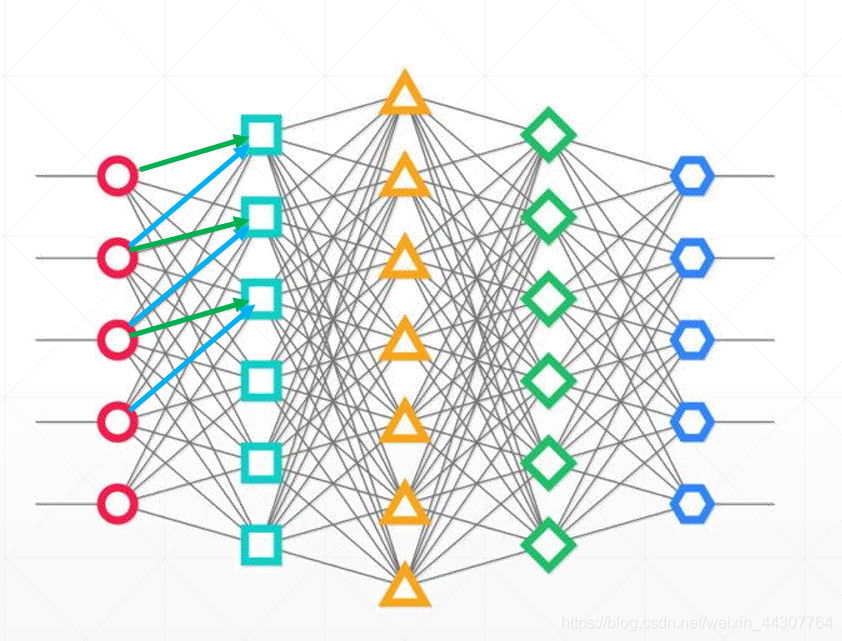

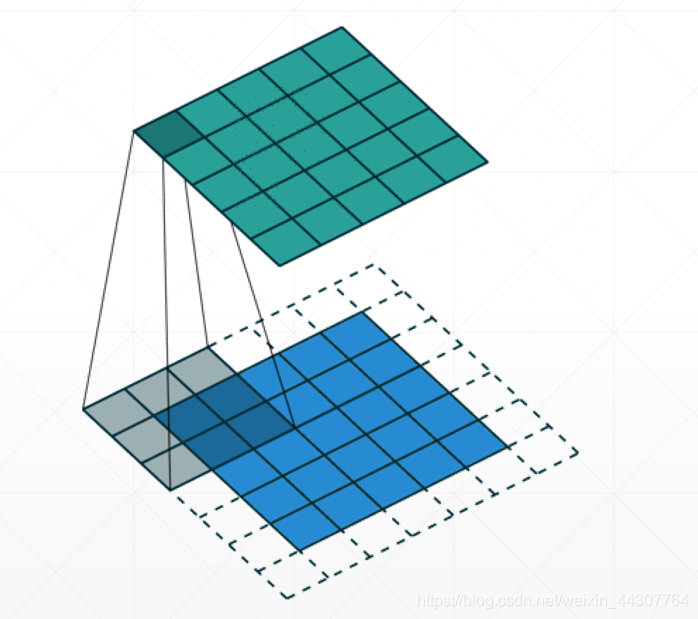

卷积神经网络的不同之处在下图可以直观感受到:

卷积神经网络的优点既体现在此处,如果将全连接神经每个节点的处理比作一次扫描的话。那么全连接层是一次扫描全部节点,且每个节点的观察方式还不一样,卷积层则是一次扫描邻近的部分节点,节点之间的观察方式是一样的。

这里我强调了“邻近的”这三个字,是因为对于图像数据其实还有一个特点,就是相邻的像素点之间的关系比较大,距离较远的像素点之间的关系可能就比较小,所有研究这相邻的像素点之间的关系的意义其实更大。

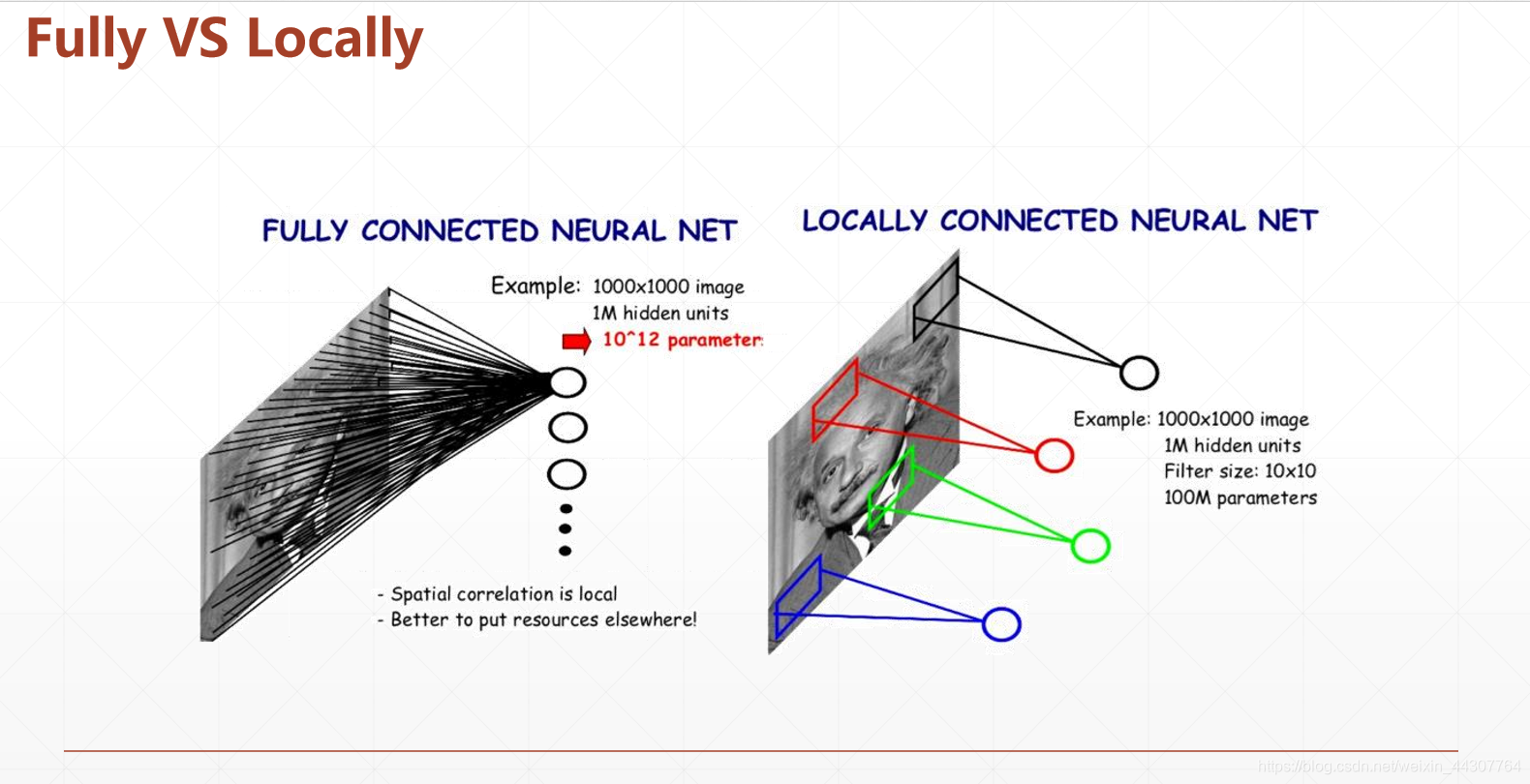

下面这张图片很形象的表达的卷积神经网络的优势:

卷积操作简述

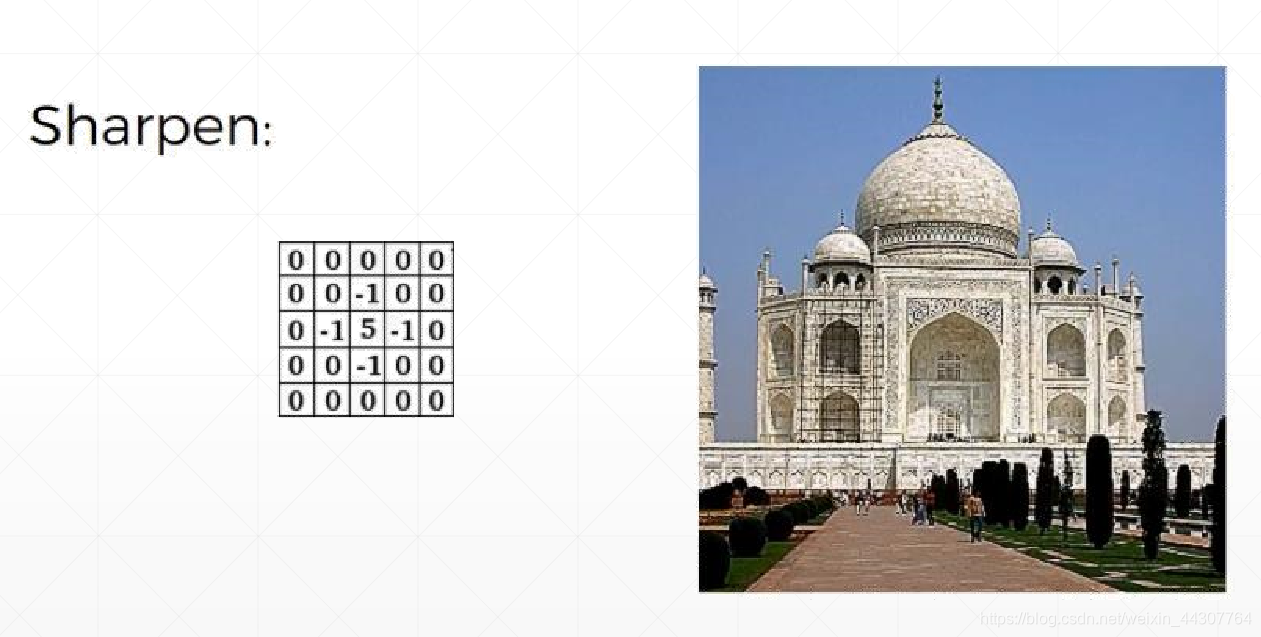

其实最早卷积操作出现在在计算机视觉(CV)当中。那是为了得到不同效果的图片设计了不同的卷积操作,

比如为了得到锐化后的图片

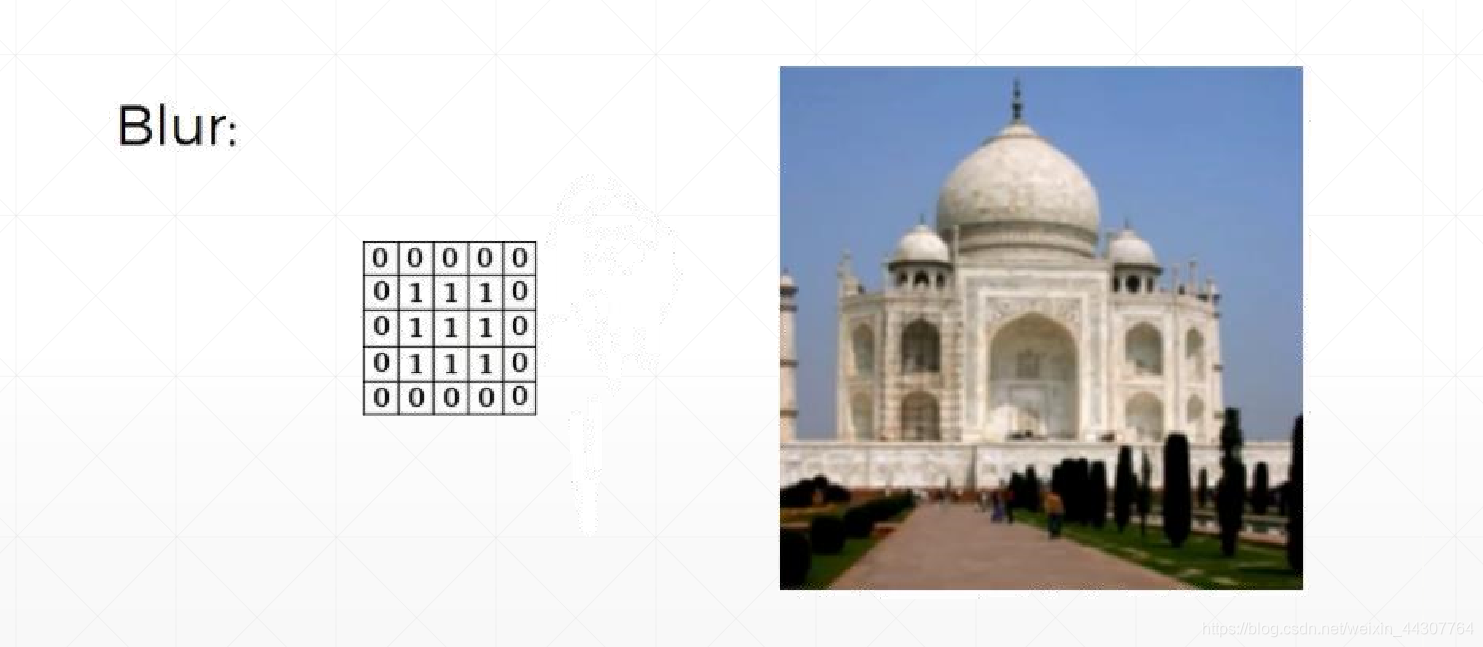

为了得到模糊化的图片

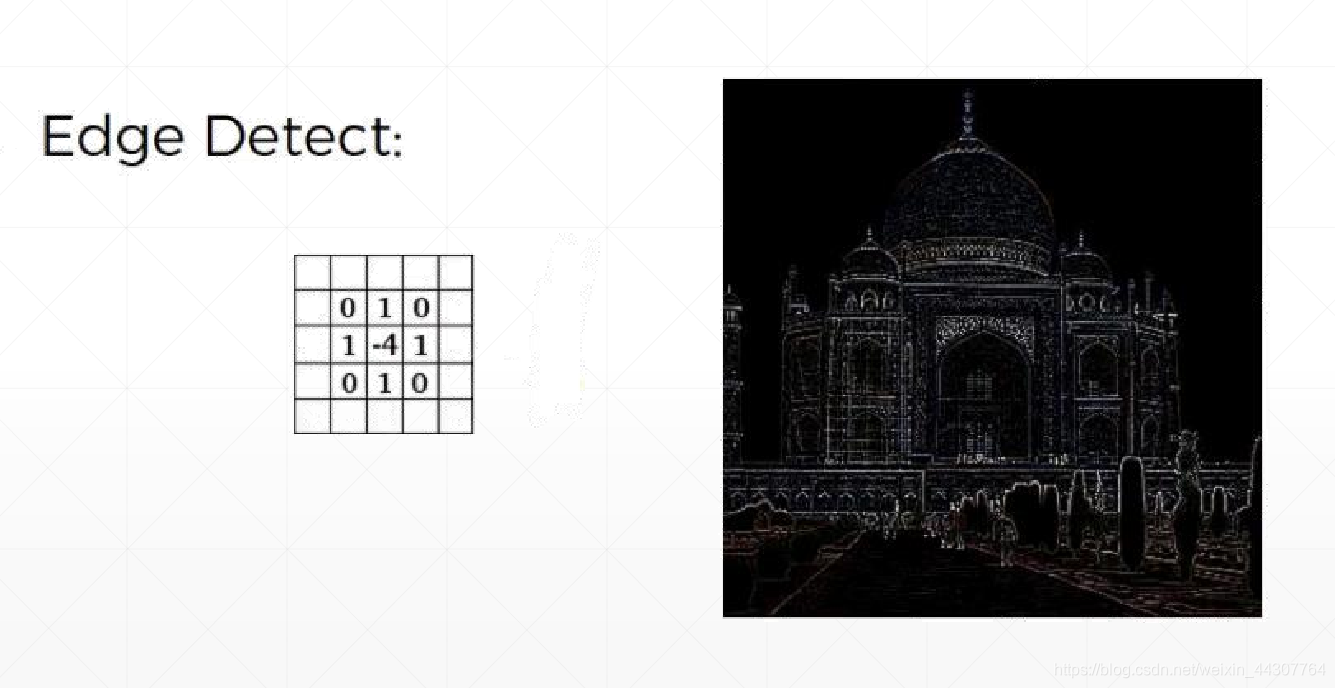

为了得到边缘化的图片:

在此处的应用中,卷积核中的权重是一开始就已经固定好了,并且有着属于自己的特殊含义,因为不同卷积核得到了不同的结果。而在卷积神经网络中,我们的目的就是为了经过不断训练得到卷积核中的权重w,训练的过程是基于SGD(Stochastic Gradient Descent,随机梯度下降)得到的,并且权重w也没有特定的目的。

而是为了不断提取特征,卷积核就相当于与一种观察方式。比如从底层像素级的概念,逐步到模块级别的概念等

low level Feature–> Mid level Feature–>High Level Feature

相乘再累加?

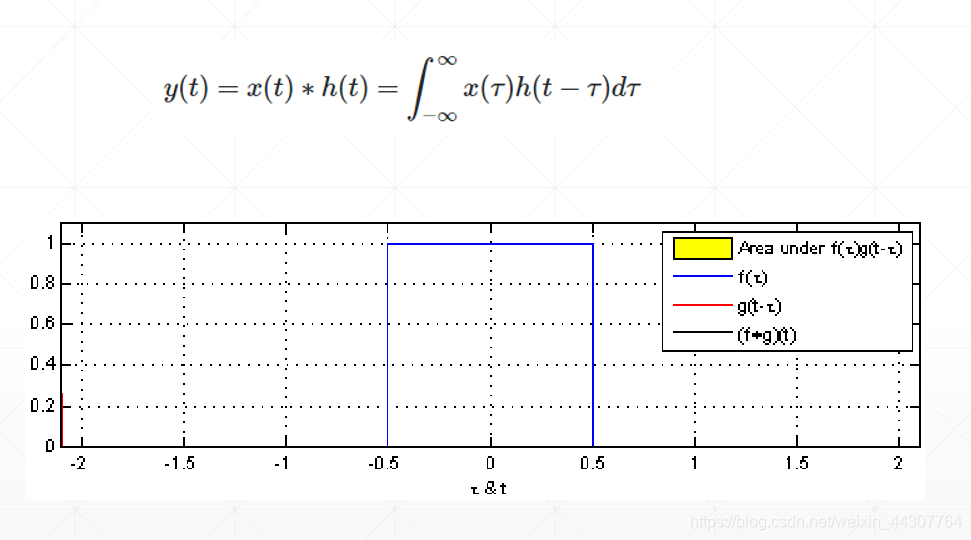

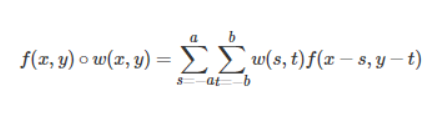

我们都知道卷积操作并不神秘,就是卷积核中的对应元素与图片上的对应元素进行相乘再累加,那为什么要相乘再累加呢,这里就要说到信号学上面的一个概念,信号学上将两个函数之间的操作定义为卷积。下面的公式就定义一个卷积操作,

在连续的函数里面,卷积体现在函数的积分上,例如这个公式中对τ积分。这一点在离散上就体现为相乘再累加,同时对于这个公式来说,t不一样,积分得到结果不一样,改变t就相当于在卷积中移动卷积核重新相乘再累加。

信号学中关于卷积的介绍和推导远不止这么简单,这只是我目前粗浅的理解。

卷积层中重要的操作与概念

在实现卷积中,有一些我们不得不了解操作和概念,当我们了解了这些之后,才能更好的去实战。

两个重要操作 Padding & Stride

经过卷积层的处理之后得到的输出的shape要比输入的shape要小一点,为了使输入和输出保持一致,,就需要Padding操作。从图中也可以看出,所谓的padding就是将输入的shape变大一点。

而Stride操作代表了卷积核移动的步长,比如stride = 1就代表一次移动一格。

通过合理的调节Padding 和 stride 就可以使得输出的shape满足自己的需求。

两个重要概念 池化 & 采样

图片在经过卷积层的处理得到特征图(feature map)之后,为了进一步得到图像的高阶特征,这时候就会用到池化层。

平均池化:倾向于保留突出背景特征

最大池化:倾向于保留突出纹理特征

池化层所用到的技术就是采样。采样我的简单理解就是对一个feature map放大或者缩小,放大就叫做上采样,缩小就叫做下采样。在这个过程中采取的方式不同,所着重保留的图像的特征也不同。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2077

2077

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?