1.准备软件包

(1)下载地址:

https://www.apache.org/dyn/closer.lua/spark/spark-2.4.3/spark-2.4.3-bin-hadoop2.7.tgz

(2)版本:spark-2.4.3-bin-hadoop2.7.tgz

2.上传到自定义位置解压

3.vi /etc/hosts 添加127.0.0.1 bogon localhost (bogon根据主机名更改)

环境变量最好也配置一下 vi /etc/profile

export SPARK_HOME=/home/usr/java/spark-2.3.3-bin-hadoop2.7

export PATH=$PATH:${SPARK_HOME}/bin

4.进入到解压的目录,找到conf文件夹

(1)slaves.template 去掉templat后缀,为slaves,

mv slaves.template slaves

vi slaves

进入slaves 末尾添加localhost 保存

(2)spark-env.sh.template 去掉template后缀 为 spark-env.sh

mv spark-env.sh.template spark-env.sh

vi spark-env.sh

进入spark-env.sh 在末尾添加如下,保存退出

export JAVA_HOME=/home/usr/java/jdk1.8.0_11 ==改为自己本机地址==

export SPARK_MASTER_HOST=192.168.XXX.XXX ==改为自己本机的ip==

export SPARK_MASTER_POST=7077

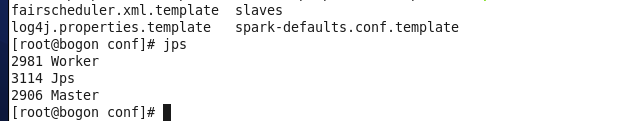

5.运行解压目录下sbin文件下start-all.sh

sbin/start-all.sh

6.效果图如下展示,即单机版完成

1. 修改slaves 添加localhost

2. 修改spark-env.sh

==3.==修改 /etc/hosts

搞定

页面

详细步骤前面的文章都有

ssh localhost 报错:https://blog.csdn.net/weixin_44385419/article/details/100073500

spark 搭建详细步骤:https://blog.csdn.net/weixin_44385419/article/details/96603221

139

139

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?