逻辑斯谛回归是统计学习中的经典分类方法。

最大熵是概率模型学习的一个准则。

逻辑斯谛回归模型和最大熵模型都属于对数线性模型。

一、逻辑斯谛回归模型

1.1 逻辑斯谛分布:

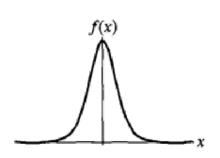

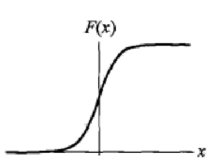

设X是连续随机变量,X服从逻辑斯谛分布是指X具有下列分布函数和密度函数:

式中,μ为位置参数,γ>0为形状参数。

图一 逻辑斯谛分布函数

图二 逻辑斯谛分布密度函数

1.2. 二项逻辑斯谛回归模型

二项逻辑斯谛回归模型是一种分类模型,由条件概率分布P(Y|X)表示形式为参数化的逻辑斯谛分布。这里,随机变量X取值为实数,随机变量Y取值为1或0.

二项逻辑斯谛回归模型是如下的条件概率分布:

一个事件的几率是指该事件发生的机率与该事件不发生的概率的比值,如果事件发生的概率是p,该事件的对数几率或logit函数是:

对于逻辑斯蒂回归而言,由上式得:

在逻辑斯谛回归模型中,输入Y=1的对数几率式输入x的线性函数。

1. 3多项逻辑斯谛回归

二、最大熵模型

2.1最大熵原理

最大熵原理认为,学习概率模型时,在所有可能的概率模型中,熵最大的模型时最好的模型。所以,最大熵原理也可以表述为在满足约束条件的模型合中选取最大熵模型。

直观地,最大熵原理认为要选择的概率模型首先必须满足已有的事实,即约束条件,在没有更多信息的情况下,那些不确定的部分都是“等可能的"。

2.2最大熵模型的定义

给定训练数据集,可以确定联合分布P(X,Y)的经验分布和边缘分布P(X)的经验分布。分别以P`(X,Y)和P`(X)表示.

用特征函数f(x,y)描述输入x和输出y之间的某一个事实。其定义是:

f(x,y)=1 x与y满足某一事实 否则f(x,y)=0

假设满足所有约束条件的模型集合为:

定义在条件概率分布P(X|Y)上的条件熵为:

则模型C中条件熵H(p)最大的模型称为最大熵模型。

2.3最大熵模型的学习

最大熵模型的学习过程就是求解最大熵模型的过程,最大熵模型的学习可以形式化为约束最优化问题。

对于给定的训练数据集以及特征函数,最大熵模型的学习等价于约束最优化问题:

三 模型学习的最优化算法

3.1改进的迭代尺度法

已知最大熵模型为:

其中:

对数似然函数为:

目标是通过极大似然估计学习模型参数,即求对数似然函数的极大值。

对数似然函数的想法是:假设最大熵模型当前的参数向量是w=(w1,w2,w3,…,wn),希望找到一个新的向量w+u=(w1+u1,w2+u2,…,wn+un),使得模型的对数似然函数值增大。

5543

5543

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?