摘要

大型语言模型(llm)展示了一系列有前途的能力——从一步一步渐进的规划到常识性推理——这可能为机器人提供效用,但仍然容易产生自信的幻觉预测。在这项工作中,我们提出了KNOWNO,它是一个测量和调整基于llm的规划者的不确定性的框架,这样他们就能知道他们何时不知道,并在需要时寻求帮助。KNOWNO建立在保形预测理论的基础上,为任务完成提供统计保证,同时在复杂的多步骤规划设置中最小化人工帮助。实验在各种模拟和真实的机器人设置涉及任务不同模式的歧义(例如,从空间到数值的不确定性,从人类偏好维诺格勒模式)表明KNOWNO表现在现代基线(可能涉及集合或广泛提示调优)的提高效率和自主性,同时提供正式的保证。KNOWNO可以在不进行LLM模型微调的情况下使用,并提出了一种有前途的轻量级方法来建模不确定性,可以随着基础模型不断增长的能力进行补充和扩展。

目标

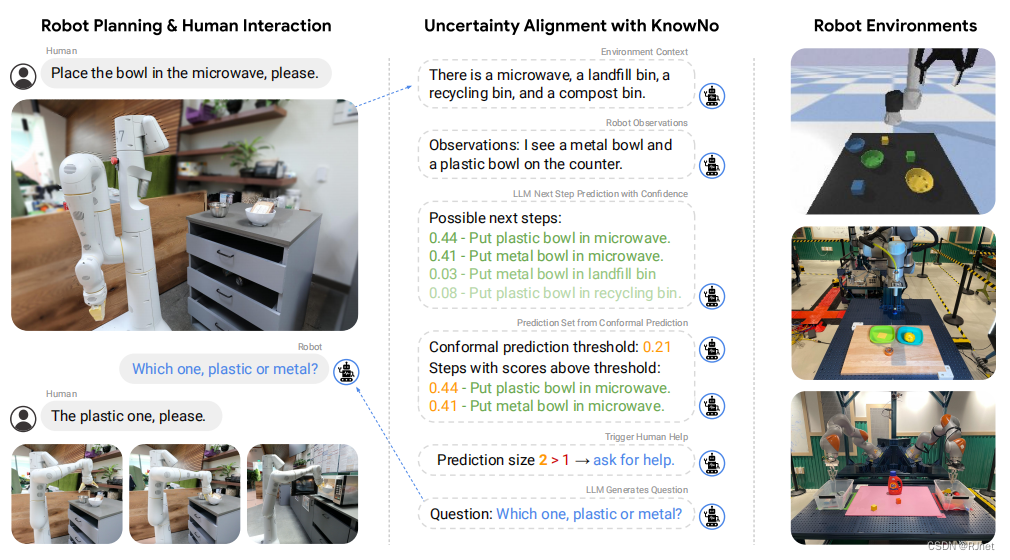

赋予机器人不确定性能力,也就是让机器人认识到有一些事情它们无法完成,同时也允许我们在机器人不确定时向它们提供帮助和澄清,解决大模型的幻觉。

例如,一个负责加热食物的机器人可能会被要求“把碗放在微波炉里”;如果柜台上有多个碗,说明就不明确了。此外,金属碗对微波炉可能不安全。机器人不应该在这种模糊的环境下采取行动,破坏微波炉,甚至引起火灾,而是应该知道它何时不知道,并要求澄清(例如,询问应该在微波炉里放哪个碗)。之前基于语言的规划工作要么不寻求这样的澄清,要么通过大量的提示,这需要仔细的提示工程,以防止机器人过度依赖寻求帮助。

另外,之前的方法并不能提供一种方法来确保寻求帮助会达到所期望的任务成功水平。

目标

我们形式化这些挑战通过两个需求:

(1)校准信心:机器人应该寻求足够的帮助,以确保统计保证水平的任务成功指定的用户;

(2)最小的帮助:机器人应该减少总量的帮助通过缩小可能的歧义的任务。

我们将这些充分性和最小性条件称为不确定性对齐

方法

共型预测:对于输入,不直接返回预测值y,而是返回一个包含y的候选集合Y,并保证真实预测值落入Y的概率大于等于 1−𝛼 。若存在两个及以上的值大于等于 1−𝛼,则存在不确定性。

Conformal Prediction - 知乎 (zhihu.com)

若存在不确定性,就询问。

实验

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?