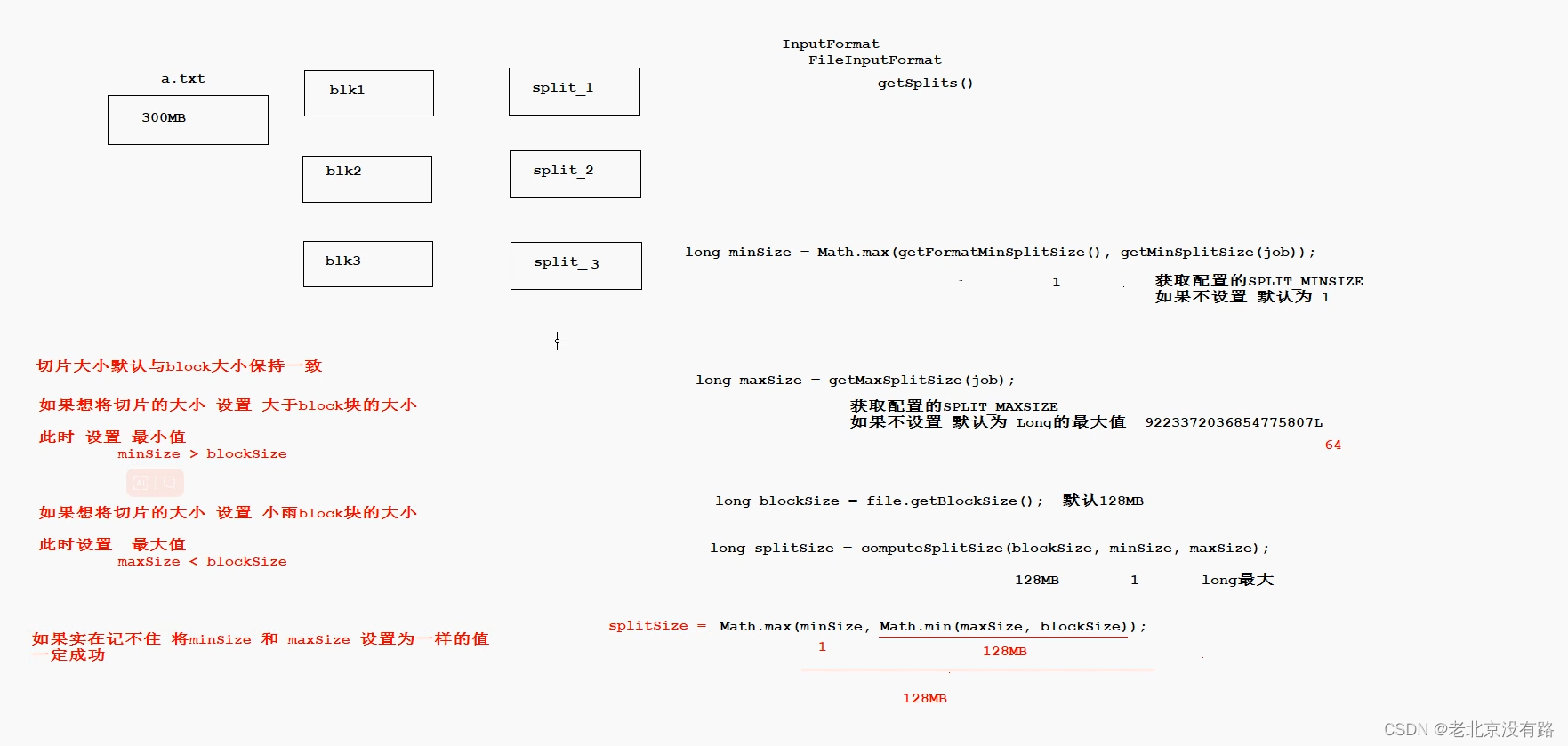

切片是一个逻辑概念 在不改变现在数据存储的情况下,可以控制参与计算的节点数目 通过切片大小可以达到控制计算节点数量的目的 有多少个切片就会执行多少个Map任务

hdfs上数据存储的一个单元,同一个文件中块的大小都是相同的

因为数据存储到HDFS上不可变,所以有可能块的数量和集群的计算能力不匹配 我们需要一个动态调整本次参与计算节点数量的一个单位,因此引入了切片的逻辑概念

切片的默认大小是与block块的大小相同,

查看源码分析

源码中FileInputFormat组件中的getSplits方法

minsize和maxsize分别获取切片的最大值和最小值

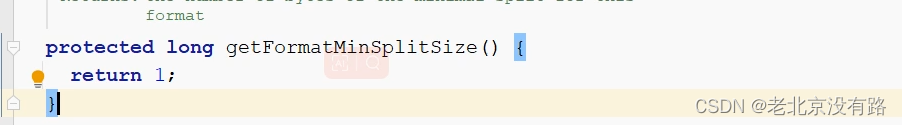

获取最小值

long minSize = Math.max (getFormatMinSplitSize(),getMinSplitsize(job));

getFormatMinSplitSize() =1

其中配置文件中SPLIT_MINSIZE没有进行设置,默认值为1,因此getMinSplitsize(job)=1

那么可以得到long minSize= Math.max(1,1),即最小值为1;

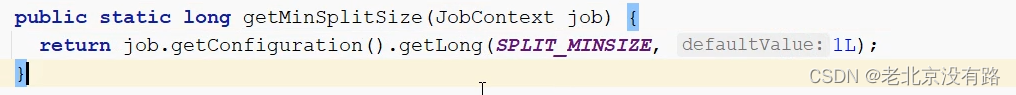

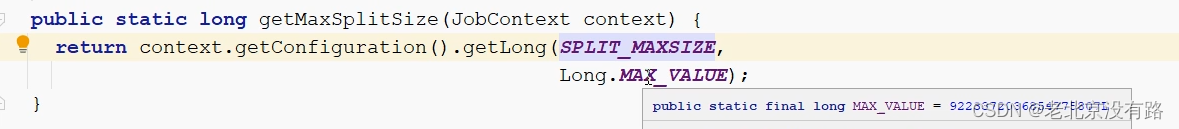

获取最大值

long maxSize= getMaxSplitSize(job);

与SPLIT_MINSIZE一样,配置文件中没有对SPLIT_MAXSIZE进行设置,而Long.MAX_VALUE即Long的最大值9223372036854775807L为

maxSize=9223372036854775807L

因此long maxSize= 9223372036854775807L

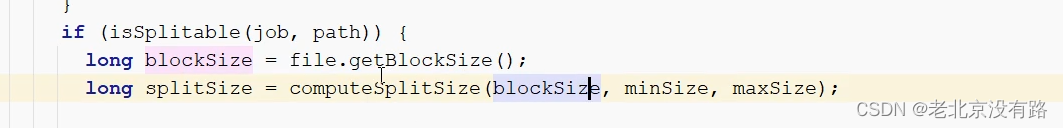

long blockSize = file.getBlockSize();block块的默认大小为128MB

long splitSize = computeSplitSize(blockSize,minSize, maxSize);其中三个参数的默认值分别为128MB , 1 , Long最大值

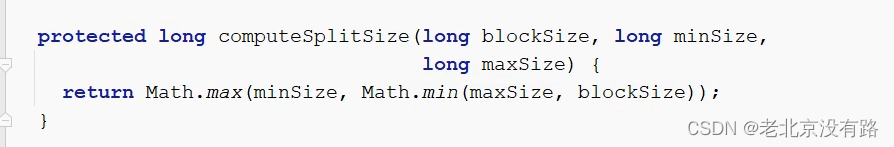

computeSplitSize源码如下

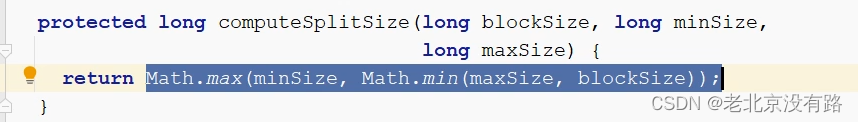

Math.max(minSize, Math.min(maxSize, blockSize))

根据以上源码可以得知.

minSize= 1

Math.min=128MB

返回值为较大值128,因此切片的默认大小为128MB

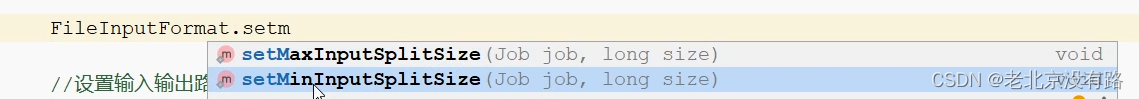

设置切片大小

可以使用如下方法进行设置

注意事项

根据上面源码返回的值可以得知在设置时需要注意:

由于block块即blockSize的默认大小为128MB,如果要设置切片大小小于128MB时,将值赋给minSize=64,如下:

Math.max(64,Math.min(1,128))

会发现此时切片大小设置失败仍然为默认值128MB,同理将切片大小调整大于128MB时赋值给maxSize也会设置失败

因此在在设置时:

1、如果需要将切片大小调整小于128MB,需要赋值给maxSize

2、如果需要将切片大小调整大于128MB,则需要赋值给minSize

如果记不清楚在实践时可以同时赋值给maxSize和minSize`

300

300

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?