12.2. 异步计算

今天的计算机是高度并行的系统,由多个CPU核、多个GPU、多个处理单元组成。

通常每个CPU核有多个线程,每个设备通常有多个GPU,每个GPU有多个处理单元.

Python是单线程的,将来也是不太可能改变的。因此在诸多的深度学习框架中,采用了一种异步编程(asynchronous programming)模型来提高性能.

PyTorch则使用了Python自己的调度器来实现不同的性能权衡。对于PyTorch来说GPU操作在默认情况下是异步的。

当你调用一个使用GPU的函数时,操作会排队到特定的设备上,但不一定要等到以后才执行。

这允许我们并行执行更多的计算,包括在CPU或其他GPU上的操作。

import os

import subprocess

import numpy

import torch

from torch import nn

from d2l import torch as d2l

12.2.1. 通过后端异步处理

我们要生成一个随机矩阵并将其相乘。让我们在NumPy和PyTorch张量中都这样做,看看它们的区别。

请注意,PyTorch的tensor是在GPU上定义的。

# GPU计算热身

device = d2l.try_gpu()

a = torch.randn(size=(1000, 1000), device=device)

b = torch.mm(a, a)

with d2l.Benchmark('numpy'):

for _ in range(10):

a = numpy.random.normal(size=(1000, 1000))

b = numpy.dot(a, a)

with d2l.Benchmark('torch'):

for _ in range(10):

a = torch.randn(size=(1000, 1000), device=device)

b = torch.mm(a, a)

# result

numpy: 1.2837 sec

torch: 0.0010 sec

通过PyTorch的基准输出比较快了几个数量级。

NumPy点积是在CPU上执行的,而PyTorch矩阵乘法是在GPU上执行的,后者的速度要快得多。

但巨大的时间差距表明一定还有其他原因。默认情况下,GPU操作在PyTorch中是异步的。

强制PyTorch在返回之前完成所有计算,这种强制说明了之前发生的情况:计算是由后端执行,而前端将控制权返回给了Python。

with d2l.Benchmark():

for _ in range(10):

a = torch.randn(size=(1000, 1000), device=device)

b = torch.mm(a, a)

torch.cuda.synchronize(device)

# result

Done: 0.0106 sec

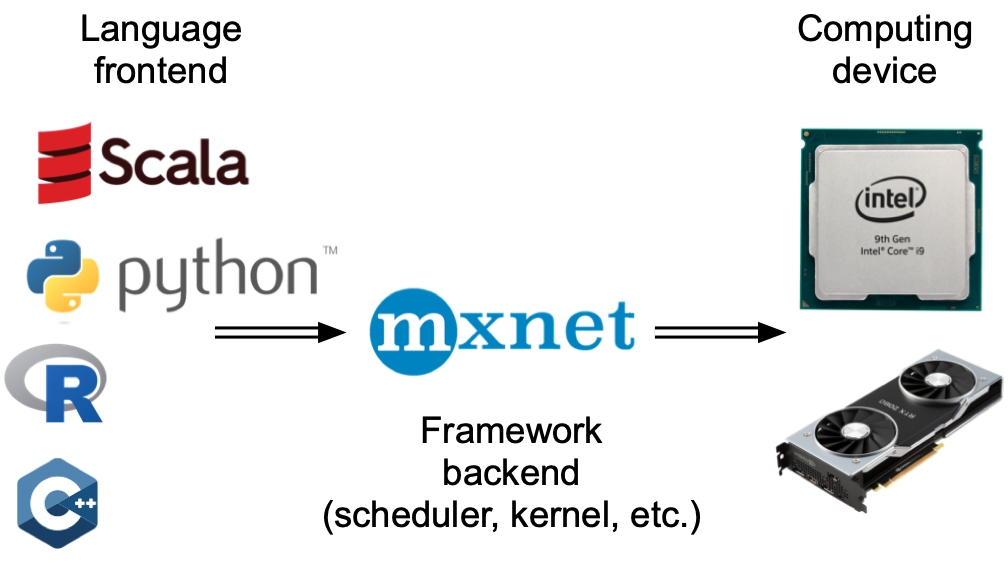

编程语言前端和深度学习框架后端

12.2.4. 小结

-

深度学习框架可以将Python前端的控制与后端的执行解耦,使得命令可以快速地异步插入后端、并行执行。

-

异步产生了一个相当灵活的前端,但请注意:过度填充任务队列可能会导致内存消耗过多。建议对每个小批量进行同步,以保持前端和后端大致同步。

-

芯片供应商提供了复杂的性能分析工具,以获得对深度学习效率更精确的洞察。

1108

1108

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?