sklearn k-近邻算法

核心思想:你的“邻居”来推断出你的类别

定义:如果一个样本在特征空间中的 k个最相似(即特征空间中最邻近)的样本中的大多数属于某一个类别,则该样本也属于这个类别。

来源:KNN算法最早是由Cover和Hart提出的一种分类算法

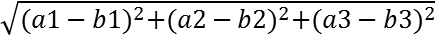

如何求距离:计算距离公式

两个样本的距离可以通过如下公式计算,又叫欧式距离

比如说,a(a1,a2,a3),b(b1,b2,b3)

相似样本,特征之间的值应该都是相近的。

sklearn k-近邻算法是需要做标准化处理的。

1. sklearn k-近邻算法API

sklearn.neighbors.KNeighborsClassifier(n_neighbors=5,algorithm='auto')

n_neighbors:int,可选(默认= 5),k_neighbors查询默认使用的邻居数

algorithm:{

‘auto’,‘ball_tree’,‘kd_tree’,‘brute’},可选用于计算最近邻居的算法:‘ball_tree’将会使用 BallTree,‘kd_tree’将使用 KDTree。‘auto’将尝试根据传递给fit方法的值来决定最合适的算法。 (不同实现方式影响效率)

k值取值:会影响结果。

2. k近邻算法实例-预测入住位置

确定此问题是一种分类问题:

特征值:x,y坐标, 定位准确性,年,日,时,周 目标值:入住位置的ID

处理:0<x<10 0<y<10

1.由于数据量大,为了缩小数据量,缩小x,y

2.时间戳处理(年、月、日、周、时、分、秒),当做新的特征

3.几千几万,少于指定签到人数的位置删除

数据的处理

1、缩小数据集范围

DataFrame.query()

2、处理日期数据

pd.to_datetime

pd.DatetimeIndex

3、增加分割的日期数据

4、删除没用的日期数据

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

299

299

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?