安装Spark

安装Scala

环境配置:

VMware 15

jdk1.8

hadoop-2.7.1

scala-2.11.12

spark-2.4.0

虚拟机:

master

slave1

slave2

资源(内含scala、spark):

链接:https://pan.baidu.com/s/1FLA_ei6PgEMmsahzXTsjIg

提取码:7i68

环境交待完毕,进入正题。

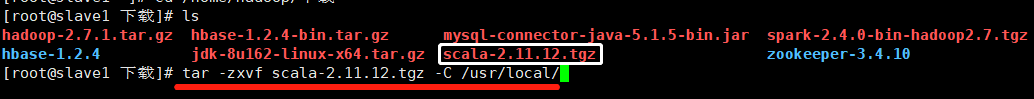

首先,将scala传至虚拟机(可使用xshell等工具)再解压到目标路径,最后修改环境变量并测试。

解压命令: tar -zxvf 压缩包路径名 -C 目标路径

举例(此时压缩包在当前目录,故可以直接用压缩包名):

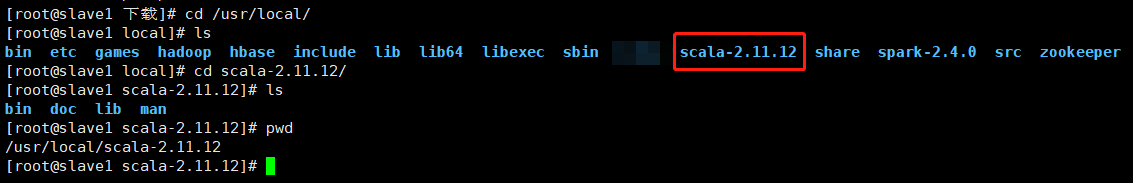

进入安装目录:

使用命令 pwd , 获取路径 将其复制下来。

紧接着配置环境变量,使用命令

vi /etc/profile

进入界面,按“i”进入编辑模式:

将复制好的路径赋值给SCALA_HOME

(注意!配置环境变量 “=” 两边不能有空格!!!)

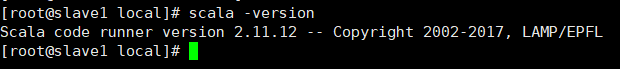

最后,测试一下:

使用命令:

scala -version

还要将其分发给子节点(举例)

scp -r /usr/local/scala-2.11.12 root@slave1:/usr/local

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

451

451

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?