系列文章目录

T-rep:使用时间嵌入对时间序列进行表征学习 ICLR2024

文章目录

摘要

多元时间序列表示

多元时间序列对标准机器学习技术提出了挑战,因为它们通常是未标记的、高维的、有噪声的,并且包含缺失的数据。为了解决这个问题,我们提出了T-Rep,这是一种以时间步粒度学习时间序列表示的自监督方法。T-Rep与其特征提取器一起学习时间向量嵌入,以从信号中提取趋势、周期性或分布位移等时间特征。这些时间嵌入在借口任务中被利用,在表示中合并平滑和细粒度的时间依赖性,以及增强对缺失数据的鲁棒性。我们在下游分类、预测和异常检测任务上评估T-Rep。将其与现有的时间序列自监督算法进行比较,它在所有三个任务中都表现出色。我们在缺失的数据体系中测试T-Rep,在那里它被证明比其同行更具弹性。最后,我们提供潜在空间可视化实验,突出学习表征的可解释性。

提示:以下是本篇文章正文内容

一、引言

多元时间序列在医学、气候科学或金融等领域已经变得无处不在。不幸的是,它们是高维和复杂的对象,很少有数据被标记(Yang & Wu, 2006),因为这是一个昂贵且耗时的过程。因此,利用未标记数据来构建多元时间序列的无监督表示已成为人们非常感兴趣的挑战,因为这些嵌入可以显著提高预测、分类或异常检测等任务的性能(Deldari等人,2021;苏等人,2019)。这推动了时间序列自监督学习(SSL)模型的发展,首先专注于构建用于分类和聚类的实例级表示(Tonekaboni等人,2021;Franceschi等人,2019;Wu等人,2018)。然后开发了更细粒度的表示,以在时间步长级别对时间序列建模(Yue等人,2022),这是医疗保健或传感器系统等领域的关键。通过细粒度嵌入,可以捕获细微的变化、周期性模式和不规则性,这些对于异常检测至关重要(Keogh等人,2006),以及理解和预测疾病进展。面对样本间变异性或数据缺失(Yue et al., 2022),这些表示也比原始数据更具弹性,这是人类活动识别(HAR)和医学中的常见问题。

学习时间序列表示时的一个中心问题是在潜在空间中合并时间,特别是对于时间步长级嵌入。在SSL中,时间结构是通过借口任务来学习的。在当前最先进的(SOTA)模型中,这些任务是对比的(Tonekaboni等人,2021;Yue等人,2022;Banville et al., 2021),这构成了重要的局限性(Zhang et al., 2023)。在对比技术中,学习信号是二元的:正对应该是相似的,而负对应该是非常不同的(Chen et al., 2020)。这使得在嵌入中获得连续或细粒度的时间概念变得不可行,因为这些任务只表示两个点是否应该相似,而不是它们应该有多接近或相似。因此,嵌入的轨迹不太可能准确地反映数据的时间结构。

此外,时间对比任务与有限状态系统不兼容,在有限状态系统中,信号随时间在S状态之间有规律地(周期信号)或不规则地转换。这类任务通过时间上的接近来定义正对,通过时间上的距离来定义负对(Banville et al., 2021;Franceschi等人,2019),这可能会导致抽样偏差问题。负对的点可能在时间上很远,但距离很近(即非常相似),正对的点可能很近,但差异很大(例如,想想脉冲信号)。这种不连贯的信息阻碍了学习,并可能导致嵌入结构不佳。有限状态系统在传感器系统、医疗监控或天气系统等现实场景中非常常见,因此处理这些周期至关重要。

为了解决上述问题,我们提出了T-Rep,一种用于学习(单变量和多变量)时间序列的细粒度表示的自监督方法。T-Rep通过使用时间嵌入改进了SSL中的时间处理,时间嵌入集成在特征提取编码器中,并在借口任务中加以利用,帮助模型学习详细的时间相关特征。我们将时间向量嵌入定义为时间嵌入,得到一个学习函数hψ的输出,该函数编码了时间信号的特征,如趋势、周期性、分布移位等。因此,时间嵌入增强了我们的模型对缺失数据的弹性,并在面对有限状态系统和非平稳性时提高了其性能。我们在分类、预测和异常检测的各种数据集上评估T-Rep(见第5节),特别是脓毒症(Reyna et al., 2020a;Goldberger et al., 2000)一个真实世界的数据集,包含来自重症监护病房(ICU) 40,336名患者的多变量时间序列,具有噪声和缺失数据。我们的主要贡献总结如下:

•据我们所知,我们提出了时间序列的第一个自监督框架,以在其借口任务中利用时间嵌入。这有助于模型学习细粒度的时间依赖性,为潜在空间提供比现有方法更连贯的时间结构。时间嵌入的使用也鼓励了对缺失数据的恢复能力,并产生了更多的信息密集和可解释的嵌入。

•我们比较了T-Rep和SOTA自监督模型在分类、预测和异常检测方面的时间序列。它在使用较低维潜在空间时始终优于所有基线,并且对丢失数据的恢复能力也比现有方法强。此外,我们的潜在空间可视化实验表明,学习到的嵌入具有高度的可解释性。

二、相关工作

Representation Learning for time series 该领域使用的第一个技术是基于编码器和解码器的,经过训练可以重建原始时间序列。这些模型包括Autowarp (Abid & Zou, 2018)、TimeNet (Malhotra等人,2017)和LSTM-SAE (Sagheer & Kotb, 2019),它们都具有基于rnn的架构。还使用了受变分自编码器(Kingma & Welling, 2013)启发的模型,特别是Interfusion (Li等人,2021)、SOM-VAE (Fortuin等人,2018)和OmniAnomaly (Su等人,2019),后者将VAE与规范化流结合起来。仅编码器的方法最近更流行,通常基于对比方法(Zhang et al., 2023)。对比预测编码(CPC) (Oord等人,2018)框架试图利用infoNCE损失最大化未来潜在状态和上下文向量之间的相互信息。该方法已适用于异常检测(Deldari等人,2021)和一般表示(Eldele等人,2021)。TS-TCC (Eldele et al., 2021)通过对原始信号进行弱变换和强变换来增强CPC。此外,计算机视觉中基于增强的对比方法(Chen等人,2020)已经通过改变增强来适应时间序列(Kiyasseh等人,2021)。针对可穿戴传感器(Cheng et al., 2020)和ecg (kiyaseh et al., 2021)提出了特定领域的转换,例如噪声注入、裁剪、翘翘和抖动(P¨oppelbaum et al., 2022)。这些方法的问题在于,它们做出的变换不变性假设可能不满足信号(Zhang et al., 2023;Yue et al., 2022)。TS2Vec (Yue et al., 2022)通过上下文一致性解决了这个问题。

Time-Embeddings in time series representations仅用于基于变压器的架构,这需要位置编码模块(Vaswani et al., 2017)。而有些则使用原始的固定正弦位置编码(Haresamudram et al., 2020;Zhang et al., 2022), Zerveas et al.(2021)和Tipirneni & Reddy(2022)分别选择使用线性层和完全连接层学习时间嵌入。使用或学习更复杂的时间嵌入是一个很大程度上未被探索的途径,似乎有希望处理序列数据中的长期趋势和季节性(周期性)(Zhang等人,2023;Wen et al., 2022)。时间序列中最精细的时间嵌入是Time2Vec (Kazemi et al., 2019),它是为监督学习任务开发的,尚未在自监督环境中得到利用。在现有的自监督模型中,编码器使用时间嵌入来提供位置信息(Zerveas et al., 2021;Tipirneni & Reddy, 2022;Haresamudram et al., 2020;Zhang et al., 2022),但从未在借口任务中被利用。表现最好的模型使用对比技术来学习时间依赖性,它只提供二进制信号(Zhang et al., 2023)。T-Loss (Franceschi等人,2019)遵循相邻窗口应该相似的假设,并围绕这一想法构建了三重损失。TNC (Tonekaboni et al., 2021)扩展了这一框架,将信号划分为固定窗口以构建其正对和负对。In Banville et al. (2021);Yue et al. (2022);Franceschi等人(2019),正对和负对由不同时间步长数量的阈值划分,这使得这些方法不适合捕获数据中的周期性或不规则重复模式。此外,所有这些对比方法都非常粗糙,因此很难学习细粒度的时间依赖性。

综上所述,现有方法在从时间序列中提取空间特征方面取得了巨大进展,但时间特征的学习仍然有限。特别是,它们不适合处理重复出现的模式(周期性或不规则),并且难以学习细粒度的时间依赖性,因为对比任务的二进制信号和采样偏差。

三、背景

本研究的目的是改进时态数据表示学习中对时间的处理。这些创新与最先进的空间特征学习和模型训练方法、上下文一致性和分层损失框架相结合(Yue et al., 2022)。

3.1问题定义

给定数据集 X = { x 1 , . . . , x N } ∈ R N × T × C X=\{\mathbf{x}_{1},...,\mathbf{x}_{N}\}\in\mathbb{R}^{N\times T\times C} X={x1,...,xN}∈RN×T×C对于长度为T的N个时间序列,具有C个通道,自监督学习的目标是学习一个函数 f θ , s.t. ∀ i ∈ [ 0 , N ] , z i = f θ ( x i ) f_\theta\text{, s.t. }\forall i\in[0,N],\mathbf{z}_i=f_\theta(\mathbf{x}_i) fθ, s.t. ∀i∈[0,N],zi=fθ(xi)。每个 z i ∈ R T × F \mathbf{z}_{i}\in\mathbb{R}^{T\times F} zi∈RT×F是长度为T且具有F个通道的 x i \mathbf{x}_{i} xi的表示,它应该尽可能多地保留原始数据的特征。 f θ ( ⋅ ) f_{\theta}(\cdot) fθ(⋅)是通过从未标记的数据X中设计人工监督信号(称为pretext tasks)来学习的。

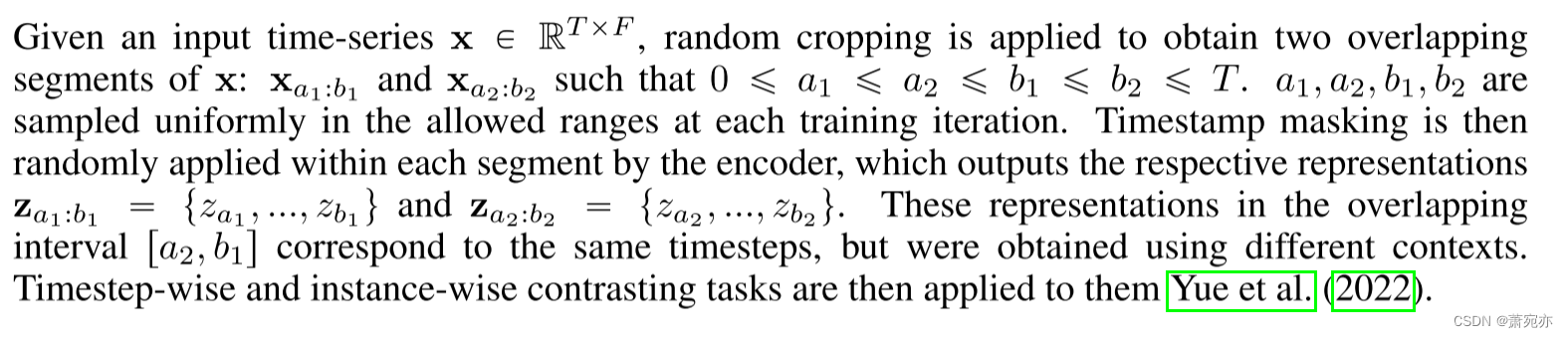

3.2上下文一致性

上下文一致性的目标是学习时间序列的上下文不变表示。其思想是采样时间序列x的两个重叠段x1和x2,对其应用随机时间戳屏蔽,从而为重叠窗口创建两个不同的上下文(随机选择窗口和屏蔽时间步长)。然后鼓励重叠时间步中的表示相似,从而导致上下文不变的表示。Yue等人(2022)与上下文一致性框架一起引入了两个对比任务来提取空间和时间特征。

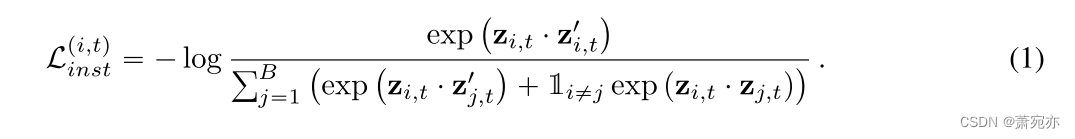

Instance-wise contrasting鼓励在不同上下文下对相同时间序列的表示进行类似的编码,并且不同的实例是不相似的(Yue等人,2022)。设B为批大小,i为时间序列索引,t为时间步长。

z

i

,

t

\mathbf{z}_{i,t}

zi,t和

z

i

,

t

′

\mathbf{z}_{i,t}^{\prime}

zi,t′表示两种不同情况下对应的表示向量。损失函数为:

Temporal contrasting鼓励不同上下文下的时间序列表示在各自的时间步长匹配时进行类似的编码,而在时间步长不同时则相隔很远(Yue et al., 2022)。损失函数如Eq. 2所示,其中Ω为两个子序列重叠的时间步长集合:

3.3 HIERARCHICAL LOSS

分层损失框架在不同尺度上应用和求和模型的损失函数,从每个时间步表示开始,并应用maxpool操作来减少尺度之间的时间维度(Yue et al., 2022)。这使用户可以控制用于下游任务的表示的粒度,而不会牺牲性能。它还使模型对缺失数据更具鲁棒性,因为它利用周围表示中的远程信息来重建缺失的时间步长(Yue et al., 2022)。

四、方法

4.1编码器架构

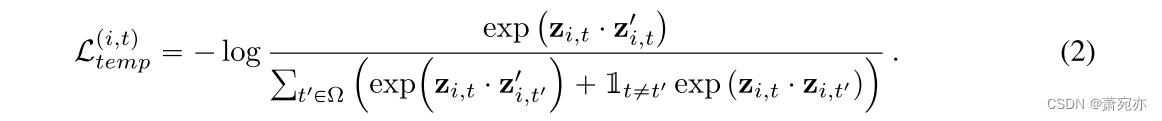

下面是我们的卷积编码器,它包含3个模块。整个模型结构如图1所示。

图1:T-Rep体系结构和工作流。左边部分显示了不同模块之间的相互作用(线性投影、时间嵌入模块和编码器)。中间部分展示了用于训练模型的4个借口任务,以及它们提取的特征类型。右侧显示了损失计算:单个借口任务损失的线性组合被传递给分层损失算法(见附录a .2.1)。

Linear Projection Layer 第一层将单个点 x i , t ∈ R C \mathbf{x}_{i,t}\in\mathbb{R}^C xi,t∈RC投影到具有固定数量通道f的向量 u i , t ∈ R F \mathbf{u}_{i,t}\in\mathbb{R}^F ui,t∈RF上,随机时间戳屏蔽在线性投影后(仅在训练期间)独立应用于每个 u i \mathbf{u}_{i} ui,作为上下文一致性框架的一部分(Yue et al., 2022)。

Time-Embedding Module

时间嵌入模块 h ψ h_{\psi} hψ负责直接从时间序列样本指标t中学习与时间相关的特征 τ t \boldsymbol{\tau}_{t} τt(趋势、周期性、分布移位等)。时间嵌入函数不像变压器的位置编码模块那样是固定的,它与编码器的其余部分共同学习。这使得时间嵌入变得灵活,它们可以适应手头的数据。时间嵌入模块的架构选择会影响下游任务的性能,在附录A.4中进行了讨论。对于一般应用程序,我们建议使用Time2Vec (Kazemi et al., 2019),它可以捕获趋势和周期性。据我们所知,T-Rep是第一个将时间嵌入模块和卷积编码器结合在时间序列自监督学习中的模型。

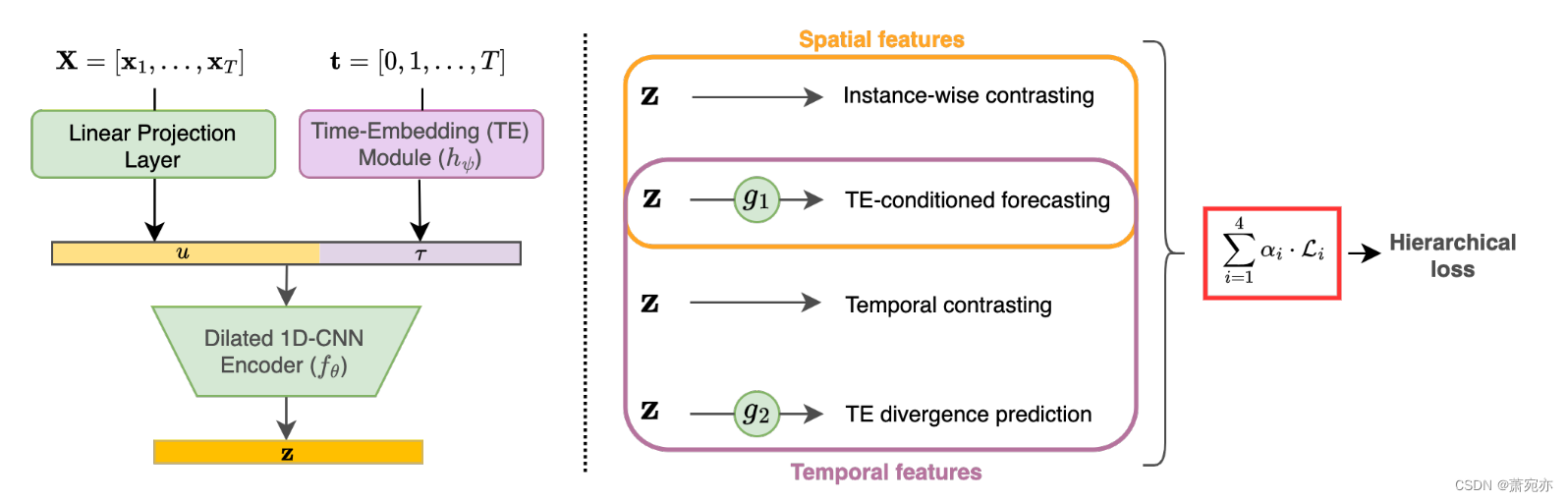

时间嵌入模块必须返回定义概率分布的向量(和为1的正分量)。这是由于在借口任务中使用了统计散度度量,详细信息见第4.2.1节。我们通过实验发现,满足这一约束的最佳方法是对模块的最后一层应用s形激活,然后将每个元素除以向量和:

其中

τ

t

\tau_{t}

τt包含K个元素,

σ

(

⋅

)

\sigma(\cdot)

σ(⋅)是sigmoid函数,

h

ψ

h_{\psi}

hψ是由ψ参数化的时间嵌入模块。在线性投影后,将时间嵌入向量

T

t

\mathcal{T}_t

Tt与向量

u

i

,

t

\mathbf{u}_{i,t}

ui,t串联起来,并将向量

[

u

i

,

t

τ

t

]

T

[\mathbf{u}_{i,t}\tau_t]^T

[ui,tτt]T馈送到编码器

f

θ

f_{\theta}

fθ。

时间卷积网络(TCN)编码器编码器的主体, f θ ( ⋅ ) f_{\theta}\left(\cdot\right) fθ(⋅),结构为残差块序列,每个块包含两层与GeLU激活交错的1D展开卷积。卷积扩张参数随着网络深度的增加而增加,首先关注局部特征,然后是长期依赖关系: d = 2 i \begin{aligned}d=2^{i}\end{aligned} d=2i,其中i为块索引。扩张卷积已被证明在时间序列的监督学习和无监督学习中都非常有效(Zhou et al., 2021;Tonekaboni等,2021;Bai et al., 2018)。

4.2 PRETEXT TASKS

我们在下面提出了两个新的SSL借口任务,它们利用时间嵌入,并被设计成相互补充。首先,“时间嵌入散度预测Time-embedding Divergence Prediction”描述了通过时间嵌入获得的信息如何构建潜在空间并包含在时间序列表示中。另一方面,“时间嵌入条件预测Time-embedding-conditioned Forecasting”任务关注的是时间嵌入和表征应该包含什么信息。

4.2.1 TIME-EMBEDDING DIVERGENCE PREDICTION

开发的第一个借口任务旨在将时间概念整合到潜在空间结构中。它包括预测两个时间嵌入 τ \boldsymbol{\tau}^{} τ和 τ ′ \boldsymbol{\tau}^{\prime} τ′之间的散度度量,给定相应时间步长的表示。该任务的目的是使潜在空间中的距离与时间距离相关,从而产生比对比学习更平滑的潜在轨迹。

让我们正式地定义这个回归任务。取一个batch

X

∈

R

B

×

T

×

C

\begin{aligned}X\in\mathbb{R}^{B\times T\times C}\end{aligned}

X∈RB×T×C,从中我们抽取

x

i

,

t

\mathbf{x}_{i,t}

xi,t和

x

j

,

t

′

∀

i

,

j

∈

∣

0

,

B

∣

\mathbf{x}_{j,t^{\prime}}\forall i,j\in|0,B|

xj,t′∀i,j∈∣0,B∣和

任务输入是差值

z

i

,

t

−

z

j

,

t

′

′

\mathbf{z}_{i,t}-\mathbf{z}_{j,t'}^{\prime}

zi,t−zj,t′′,其中

z

i

,

t

\mathbf{z}_{i,t}

zi,t是上下文c下

x

i

,

t

\mathbf{x}_{i,t}

xi,t的表示,

z

j

,

t

′

′

\mathbf{z}_{j,t^{\prime}}^{\prime}

zj,t′′是上下文

c

′

c^{\prime}

c′下

x

j

,

t

′

\mathbf{x}_{j,t^{\prime}}

xj,t′的表示。在不同的上下文中使用表示进一步鼓励上下文不变表示,详见3.2节。回归目标为

y

=

D

(

τ

,

τ

′

)

y=\mathcal{D}(\boldsymbol{\tau},\boldsymbol{\tau}^{\prime})

y=D(τ,τ′)。τ和τ1分别是t和t1的时间嵌入,

D

\mathcal{D}

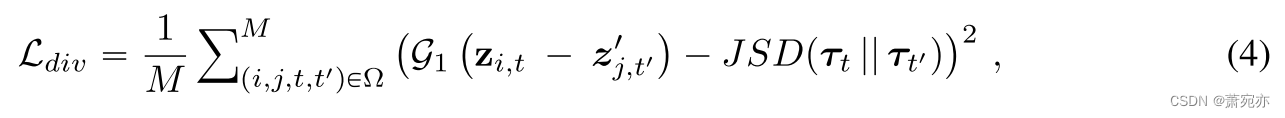

D是统计散度的度量,用于度量时间嵌入分布之间的差异。我们使用Jensen-Shannon散度(JSD), KL散度的平滑和对称版本(Lin, 1991)。任务丢失为:

其中Ω为随机抽样的表示对的时间/实例索引集(大小为M)。使用散度可以让我们捕捉到两个分布度量的差异,而一个简单的范数只能捕捉到两个向量的差异。假设时间嵌入是一个三维向量,它学习了时间的层次表示(相当于秒、分、小时),这种细微差别是很重要的。在所有时间尺度上相差1.0(01:01:01)与相差3.0小时,在分和秒(03:00:00)上没有差异(03:00:00)是非常不同的情况,但不能用简单的矢量范数捕获。

4.2.2 TIME-EMBEDDING-CONDITIONED FORECASTING

我们的第二个pretext task是在时间嵌入向量中加入预测信息,以及在表示中加入上下文感知,以鼓励对缺失数据的鲁棒性。该任务采用在特定时间步长的时间序列的表示,并试图预测附近点的表示向量,条件是目标的时间嵌入。

所使用的输入是concatenation串联

[

z

i

,

t

τ

t

+

Δ

]

T

\begin{bmatrix}\mathbf{z}_{i,t}&\boldsymbol{\tau}_{t+\Delta}\end{bmatrix}^T

[zi,tτt+Δ]T,在时刻t的表示

z

i

,

t

∈

R

F

\mathbf{z}_{i,t}\in\mathbb{R}^{F}

zi,t∈RF和目标的时间嵌入

τ

t

+

Δ

∈

R

K

\tau_{t+\Delta}\in\mathbb{R}^{K}

τt+Δ∈RK。

Δ

m

a

x

\Delta_{max}

Δmax是一个超参数,用于确定预测目标可以被采样的范围。目标是编码表示

z

i

,

t

+

Δ

\mathbf{z}_{i,t+\Delta}

zi,t+Δ在均匀采样的时间步长

t

+

Δ

,

Δ

∼

U

[

−

Δ

m

a

x

,

Δ

m

a

x

]

t+\Delta,\Delta\sim\mathcal{U}[-\Delta_{max},\Delta_{max}]

t+Δ,Δ∼U[−Δmax,Δmax]。输入通过任务头

G

2

:

R

F

+

K

↦

R

F

\mathcal{G}_2:\mathbb{R}^{F+K}\mapsto\mathbb{R}^F

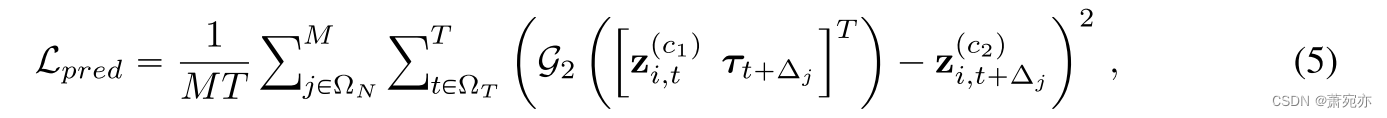

G2:RF+K↦RF转发,这是一个具有ReLU激活的2层MLP。损失是一个简单的MSE,由:

其中

Δ

j

∼

U

[

−

Δ

m

a

x

,

Δ

m

a

x

]

\Delta_j\sim\mathcal{U}[-\Delta_{max},\Delta_{max}]

Δj∼U[−Δmax,Δmax],

Ω

M

\Omega_{M}

ΩM和

Ω

T

\Omega_{T}

ΩT是每一批随机抽样的实例和时间步的集合,其各自的基数由超参数M和T控制。上下文c1和c2是从

{

c

,

c

′

}

\{c,c^{\prime}\}

{c,c′}中随机选择的,因此它们可能相同或不同,进一步鼓励上下文一致性。在目标的时间嵌入上调节这个预测任务,迫使模型从信号的时间位置提取尽可能多的信息。这将产生更多信息密集的时间嵌入,在处理单个轨迹进行预测和异常检测时可以利用它。

在实践中,我们选择一个较短的预测范围 Δ m a x ⩽ 20 , \Delta_{max}\leqslant20, Δmax⩽20,,因为重点不是构建适合预测的表示,而是“上下文感知”表示。这种上下文感知是通过向后和向前进行预测来实现的,鼓励表示包含有关其周围环境的信息,使它们对丢失的时间步具有鲁棒性。较长的预测范围将推动表征包含比空间特征更多的预测特征,使模型偏离围绕分类、聚类和其他“比较”或实例级下游任务的用例。

这一借口任务的一个关键目标是建立对缺失数据的复原力。这是通过(1)学习信息密集的时间嵌入来实现的,即使在数据缺失的情况下也可以使用;(2)通过学习上下文感知表示来实现的,它可以预测在它们附近缺失的时间步长。

五、实验

本节介绍了评估T-Rep学习表征的实验。由于下游任务的多样性,我们不执行超参数调优,并在任务之间使用相同的超参数。此外,尽可能在所有评估模型中使用相同的体系结构和超参数,以确保公平的比较。实验细节和繁殖指南见附录A.2和A.3。为进行这些实验而编写的代码已经公开了。

5.1时间序列异常检测

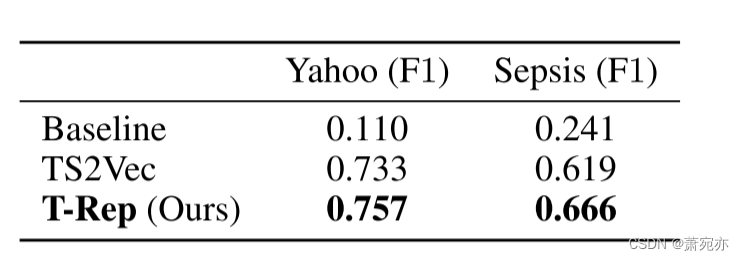

我们进行了两个实验,在雅虎数据集上进行基于点的异常检测(Nikolay Laptev, 2015),在2019年PhysioNet Challenge的败血症数据集上进行基于段的异常检测(Reyna et al., 2020a;Goldberger et al., 2000)。我们选择将这两种类型的任务作为基于段的异常检测任务,这有助于避免与点调整异常检测相关的偏差(Kim et al., 2022)。Yahoo包含367个合成和真实的单变量时间序列,具有异常值和变点异常。脓毒症是一个真实世界的数据集,包含来自重症监护病房40,336名患者的多变量时间序列,具有噪声和缺失数据。这项任务包括检测败血症,这种医学异常仅在2.2%的患者中存在。在这两个数据集上,我们将T-Rep与自监督模型TS2Vec (Yue等人,2022)进行比较,并在每个数据集上使用与TS2Vec和T-Rep相同的异常检测协议的基线,但使用的是原始数据。我们在两个数据集上遵循流异常检测程序(Ren et al., 2019)。有关程序的详细信息可在附录A.2.3中找到,其中还详细说明了适用于败血症的预处理。

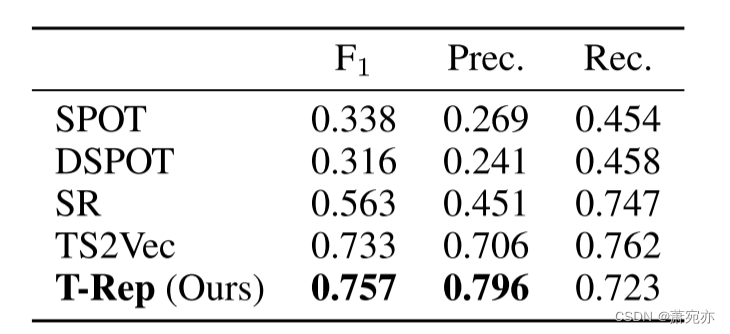

表1:时间序列异常检测F1分数,在Yahoo数据集上基于点的异常和脓毒症数据集上基于段的异常。异常包括异常值和变点。TS2Vec结果使用官方源代码(Zhihan Yue, 2021)进行复制。

1https://github.com/Let-it-Care/T-Rep

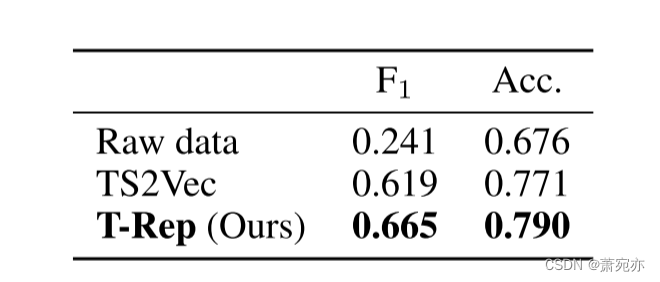

表7显示了评估结果(更详细的结果载于附录A.9)。TRep在两个数据集上的表现都是最强的,在Yahoo上的F1得分为75.5%,在Sepsis上的F1得分为66.6%。这分别比之前的SOTA TS2Vec增加了2.4%和4.8% (Yue et al., 2022)。T-Rep的性能可以归因于它对时间特征的详细理解,这有助于它更好地检测分布外或异常行为。它在Yahoo上的潜在空间维数为200,比TS2Vec使用的320维要小(Yue et al., 2022),进一步表明T-Rep比其前辈学习了更多的信息密集表示。

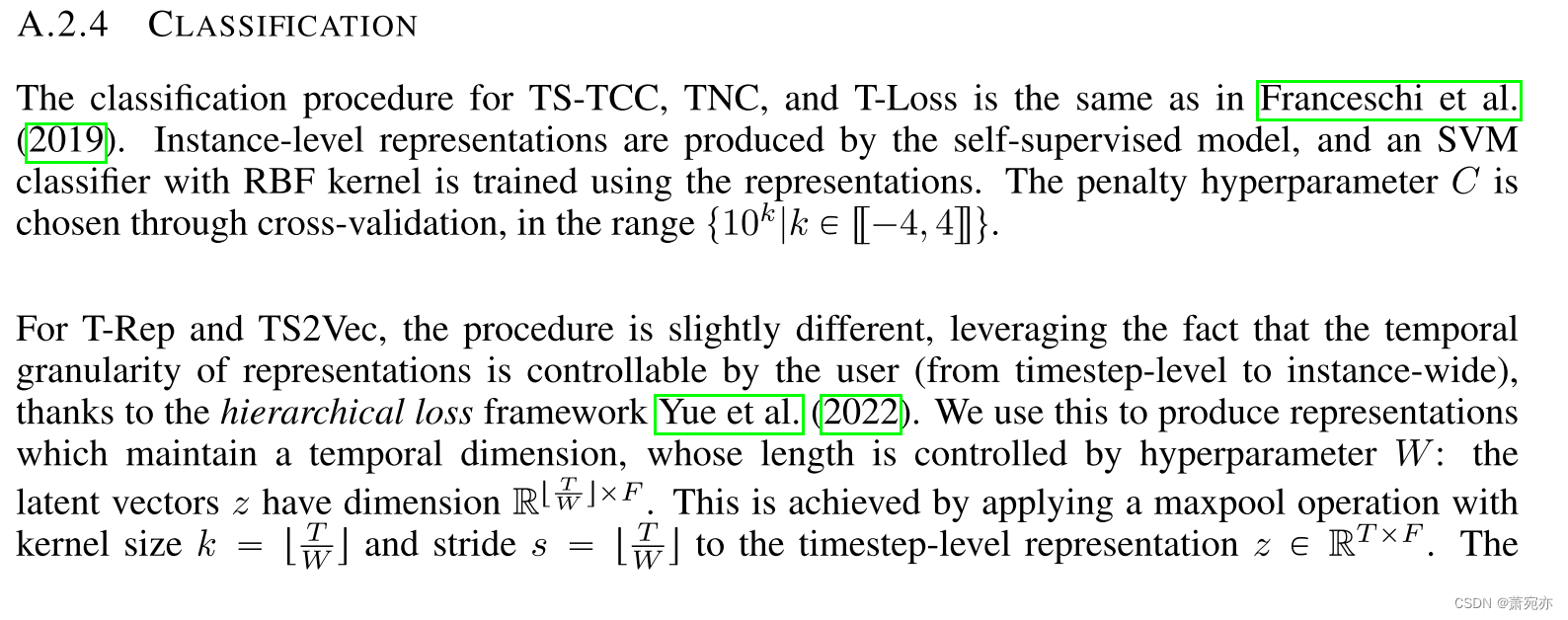

5.2时间序列分类

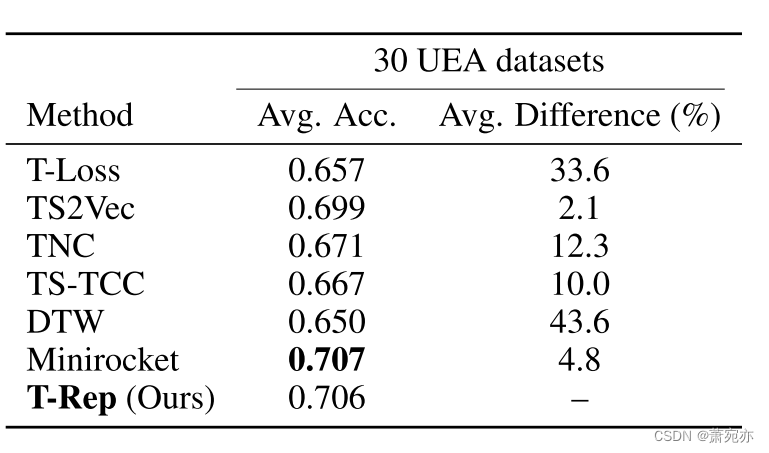

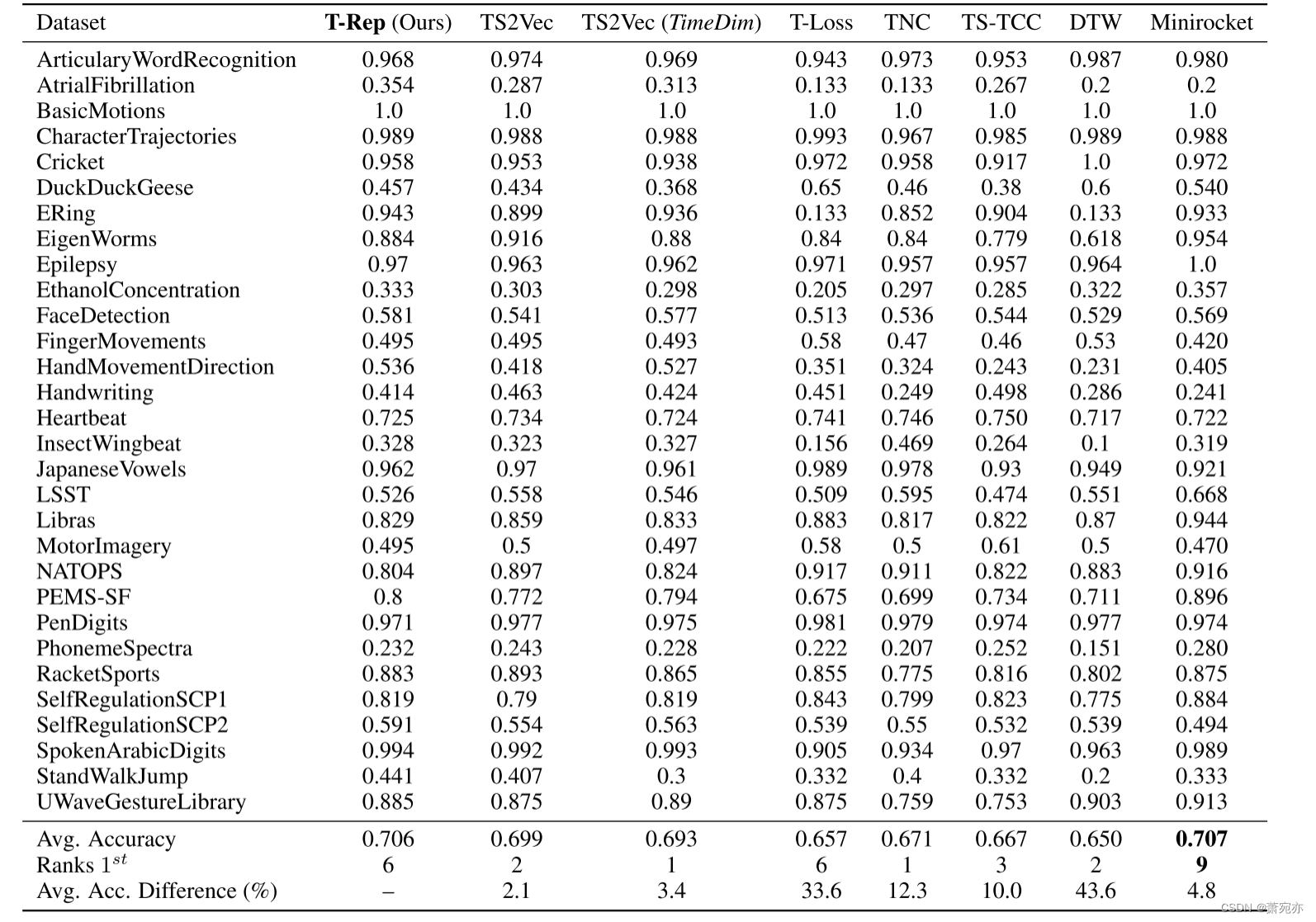

分类过程类似于Franceschi等人(2019)引入的过程:由自监督模型产生表征z,然后训练具有RBF核的SVM分类器对表征进行分类(步骤和复制细节参见附录a .2和a .3)。我们将T-Rep与SOTA自监督时间序列模型进行比较:TS2Vec (Yue等人,2022)、TLoss (Franceschi等人,2019)、TS-TCC (Eldele等人,2021)、TNC (Tonekaboni等人,2021)、Minirocket Dempster等人(2021)和基于dtw的分类器(M¨uller, 2007)。这些模型是在东英吉利大学分类档案的30个多变量时间序列上进行评估的,这些时间序列来自医学、传感器系统、语音和活动识别等不同领域(Dau等人,2019)。

评估结果总结在表2中,完整的结果显示在附录A.7中,以及关于所选评估指标的更多细节。表2显示,T-Rep的准确率比TS2Vec平均高2.1%,比Minirocket平均高4.8%。就平均准确率而言,T-Rep的准确率优于所有竞争对手,除了Minirocket,后者领先0.001。TS2Vec的性能与T-Rep非常接近,仅低0.07。T-Rep平均值为正。尽管Avg较低,但与迷你火箭的差距更大。Acc因为Minirocket的表现通常略好于T-Rep,但当T-Rep更准确时,它的优势更大。值得注意的是,Minirocket是专门为时间序列分类开发的(截至目前是SOTA),而T-Rep是一个通用的表示学习模型,突出了它在应用程序中的优势。所有基线的潜在空间维度都设置为320,除了Minirocket使用9996维度(根据官方代码)。T-Rep仅使用128个维度,但利用其表示的时间维度(详见附录A.2.4)。

表2:UEA档案的多变量时间序列分类结果。DTW, TNC和TSTCC结果直接取自Yue等人(2022),而TS2Vec和Minirocket结果使用官方代码复制。“阿维格。“差异”衡量T-Rep与给定模型相比所带来的准确度的相对差异。

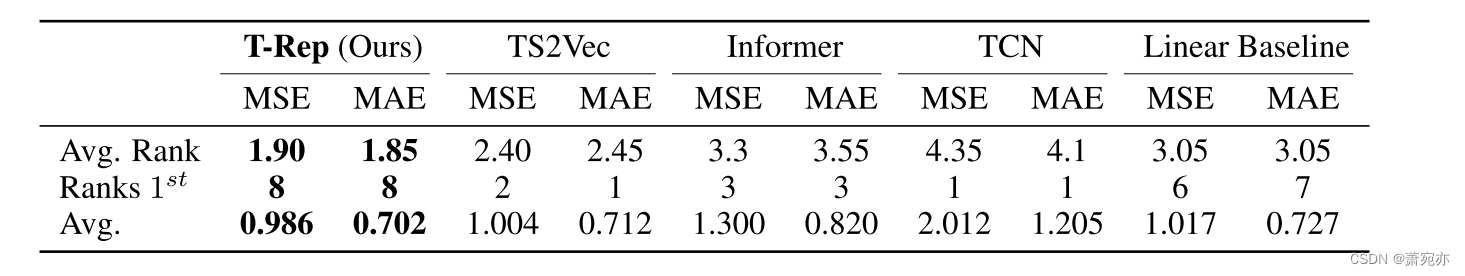

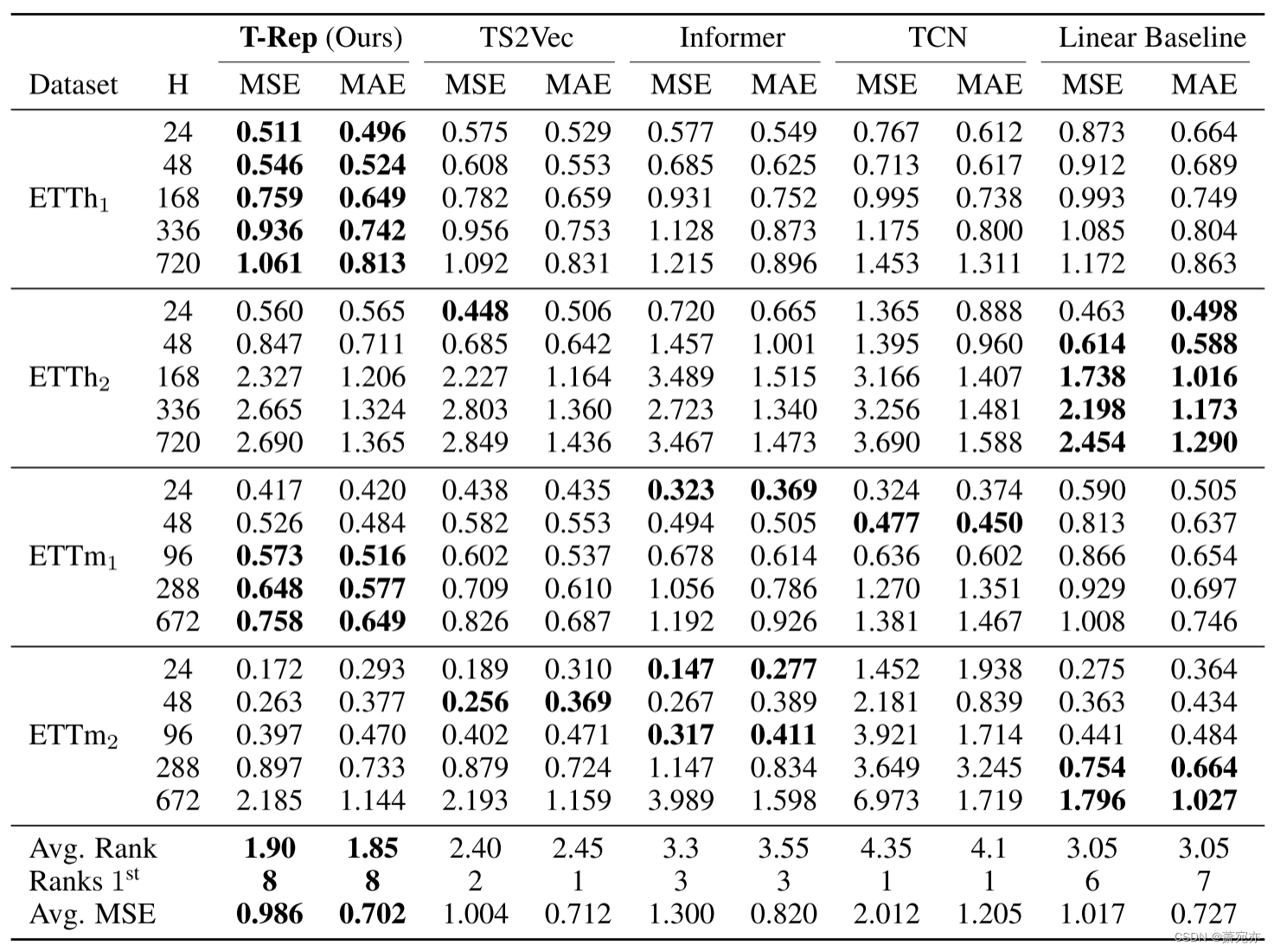

5.3时间序列预测

我们对四个公共ETT数据集(ETTh1, ETTh2, ETTm1, ETTm2)执行多元预测任务,其中包含电力和电力负荷数据以及油温(Zhou et al., 2021)。采用附录a .2.2中所述的程序,在多个层面上进行预测。我们将T-Rep与TS2Vec (Yue等人,2022),时间序列的SOTA自监督模型,Informer (Zhou等人,2021),时间序列预测中的SOTA,以及TCN (Bai等人,2018)进行比较,TCN是一种与T-Rep具有相同主干架构的监督模型,以及在原始数据上训练的线性模型。表3列出了所有数据集和预测范围的平均汇总结果(完整结果见附录A.8)。

表3显示,T-Rep在MSE和MAE方面都取得了最好的平均分数,在监督的SOTA Informer上MSE下降了24.2% (Zhou et al., 2021),在自监督的SOTA TS2Vec上略有提高1.80% (Yue et al., 2022)。它也取得了更好的平均排名,排名第一,超过任何其他模型。此外,线性基线是第二个最经常排名第一的模型,在这个指标上击败了TS2Vec。然而,该模型在所有数据集上的表现并不好,因此在MAE和MSE方面排名第3。有趣的是,大多数现有的时间序列自监督方法使用高维潜在空间(F”320维/时间步)(Franceschi等人,2019;Tonekaboni et al., 2021),因此用于生成表3中的基线结果。这可能是下游应用的一个问题,它可能面临维度的诅咒(Verleysen & Franc, 2005)。然而,T-Rep优于所有基线,其潜在空间几乎比基线小3倍,仅使用f128维度。T-Rep的优异表现可以归功于它对时间的综合处理,通过其时间嵌入模块更容易地捕捉趋势,季节性或分布变化。

表3:ETT数据集上5个不同预测层次的多元时间序列预测结果。给出的结果是在所有数据集/预测范围内的平均值。“排名第一”指标计算的是一款车型在竞争对手中排名第一的次数。所有模型的结果都是基于我们自己的复制,使用每个模型的官方代码(见附录A.2)。

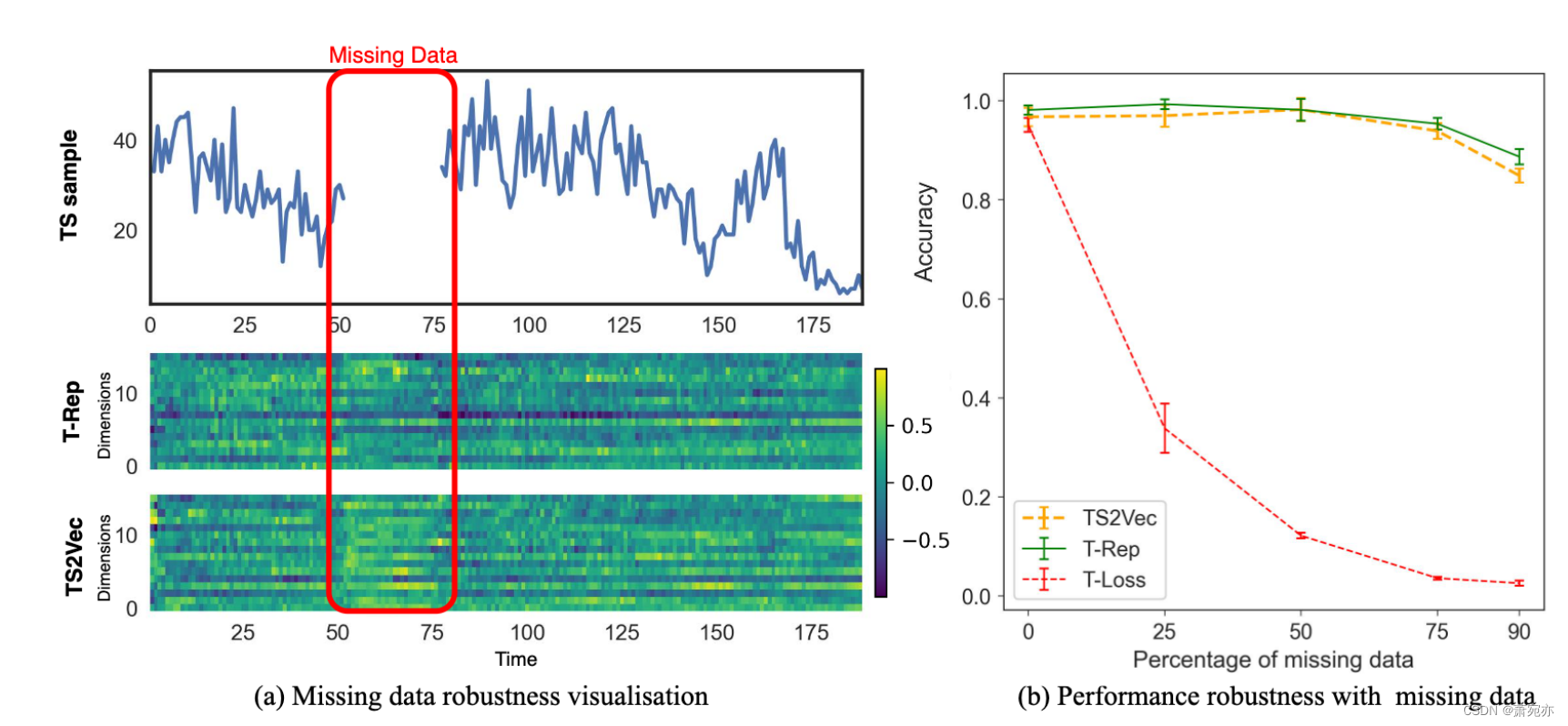

5.4对缺失数据的鲁棒性

T-Rep的开发考虑了医疗和HAR应用,需要对缺失数据有很强的恢复能力,我们在两个不同的实验中对其进行了评估。在第一个定性实验中,我们使用UCR存档Dau等人(2019)的DodgerLoopGame数据集可视化不完整时间序列的表示,该数据集具有25个缺失时间步长的连续片段(见图2.a的顶部行)。然后,我们可视化了T-Rep和TS2Vec的时间序列表示的热图(下一行),显示了方差最大的15个维度。T-Loss (Franceschi等人,2019)不包括在内,因为它不产生时间阶跃级表示。对于TS2Vec,缺失时间步长的表示非常突出(它们更亮,反映更高的值),说明模型正在努力插值,而不是产生分布外表示。另一方面,T-Rep为这些缺失的时间步长产生了更合理的表示,在缺失点的区域内外进行了更平滑的过渡,以及与周围区域的数据分布相匹配的现实插值。

图2:T-Rep对UCR存档数据集上缺失数据的鲁棒性说明。(a)显示了面对缺失数据时T-Rep和TS2Vec的热图表示,(b)显示了T-Rep、TS2Vec (Yue等人,2022)和T-Loss (Franceschi等人,2019)在分类任务中缺失数据百分比的准确性。误差条表示6次列车测试运行的标准差。

其次,我们决定在UCR存档的ArticularyWordRecognition数据集上进行更定量的实验,检查不同缺失数据量的分类准确性(Dau等人,2019)。我们将T-Rep的性能与TS2Vec (Yue等人,2022)和T-Loss(一种专门为下游分类和聚类任务设计的时间序列自监督表示学习模型)进行了比较(Franceschi等人,2019)。结果是明确的,T-Rep的性能对缺失数据具有极强的弹性,从完整数据集的98%准确率开始,面对75%的缺失数据时仅下降1.3%,最终在只有10%的可用数据时达到86.5%(图2.b的绿色曲线)。TS2Vec的性能也非常强(橙色曲线),遵循与T-Rep相似的趋势,平均准确率降低2%,当90%的数据丢失时,性能下降更为明显,下降到82.7%。另一方面,T-Loss对任何丢失的数据更加敏感。当丢失90%的数据(红色曲线)时,其性能呈指数级下降,仅为2.6%。

5.5消融研究

为了从经验上验证T-Rep的组件和借口任务,我们使用ETT数据集进行预测和异常检测任务的消融研究,使用PhysioNet Challenge的败血症数据集进行异常检测。除非指定,Time2Vec是所选的时间嵌入方法。w/o te条件预测为“时间嵌入条件”预测任务分配0.0的权重,均匀地重新分配权重。w/o TE散度预测的行为类似,但对于“时间嵌入散度预测”任务。w/o新借口任务仅保留时间嵌入模块和两个TS2Vec借口任务,隔离了不同时间嵌入架构对性能的影响。我们探索了一个具有ReLU激活(w/ MLP TE模块)和RBF特征向量(w/ Radial Basis features TE模块)的全连接双层MLP。原始的TS2Vec模型(无TE模块)也包括在消融研究中,缺乏任何T-Rep元素。

表4:ETT预测数据集(以MSE测量)和脓毒症异常检测数据集(以F1评分测量)的消融研究结果。百分比变化计算为修改后模型的性能与T-Rep之间的相对差异。

表4中的结果证实,提出的借口任务和向编码器添加时间嵌入模块有助于T-Rep的性能:删除其中任何一个都会降低两个任务的分数。这些结果也说明了这两个任务的相互依赖性,就像在预测中,只留下一个任务比去掉两个借口任务得到的结果更差。这也证明了我们对时间嵌入的首选选择是正确的,因为Time2Vec (Kazemi等人,2019)在这两个任务中都优于其他两种架构。

六、结论

我们提出了T-Rep,一种以时间步粒度学习时间序列表示的自监督方法。T-Rep与其编码器一起学习时间向量嵌入,以提取时间特征,如趋势,周期性,分布移位等。这与利用时间嵌入的借口任务一起,允许我们的模型学习详细的时间依赖性,并捕获数据中的任何周期性或不规则重复模式。我们在分类、预测和异常检测任务上评估T-Rep,在这些方面它优于现有方法。这突出了时间嵌入在时间序列中捕获时间依赖性的能力。此外,我们证明了T-Rep在缺失数据体系中的效率,并提供了学习嵌入空间的可视化实验,以突出我们方法的可解释性。

A附录

A.1潜在空间结构

本节旨在评估T-Rep在不同环境下产生的表征,并展示其可解释性。我们进行了两个实验,分别检验实例内和实例间的潜在空间结构。

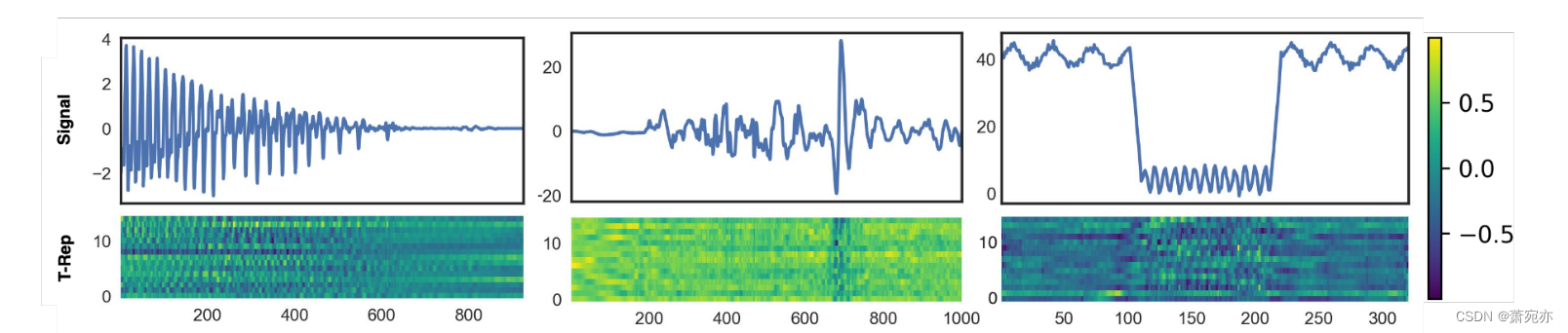

图3:潜在空间中的时间序列表示轨迹。上面一行显示输入信号,下面一行显示随时间变化的热图。每个表示只显示了15个变化最大的维度。最左边的两个图的数据来自UCR存档数据集,最右边的图的数据是合成的。

在第一个实验中,我们从UCR存档中选择了2个数据集(Dau et al., 2019),并创建了一个合成数据集。然后,我们为每个数据集绘制一个时间序列样本,并显示相应的T-Rep表示随时间演变的热图(每个表示向量仅显示方差最大的15个维度)。

图3展示了T-Rep捕获的各种输入信号属性。最左边的图展示了Phoneme数据集的样本(Dau等人,2019),我们看到T-Rep捕获了周期性,特别是频率的变化和幅度的减小。图(b)是猪中心静脉压医学数据集的提取(Dau等人,2019),其中T-Rep准确地检测到输入信号中的异常,在相应的峰值处表现为值的急剧变化(由绿色到蓝色的颜色变化表示)。最后,最右边的图展示了一个具有突然分布移位的合成数据集。T-Rep的表示用较浅的颜色和频率的变化来捕捉这一点,就像在原始信号中一样。最后,我们可以观察T-Rep如何为图2中缺失的数据生成一致的表示。A(详见5.4节)。该实验突出了T-Rep学习表征的可解释性,准确地反映了原始信号的特性。

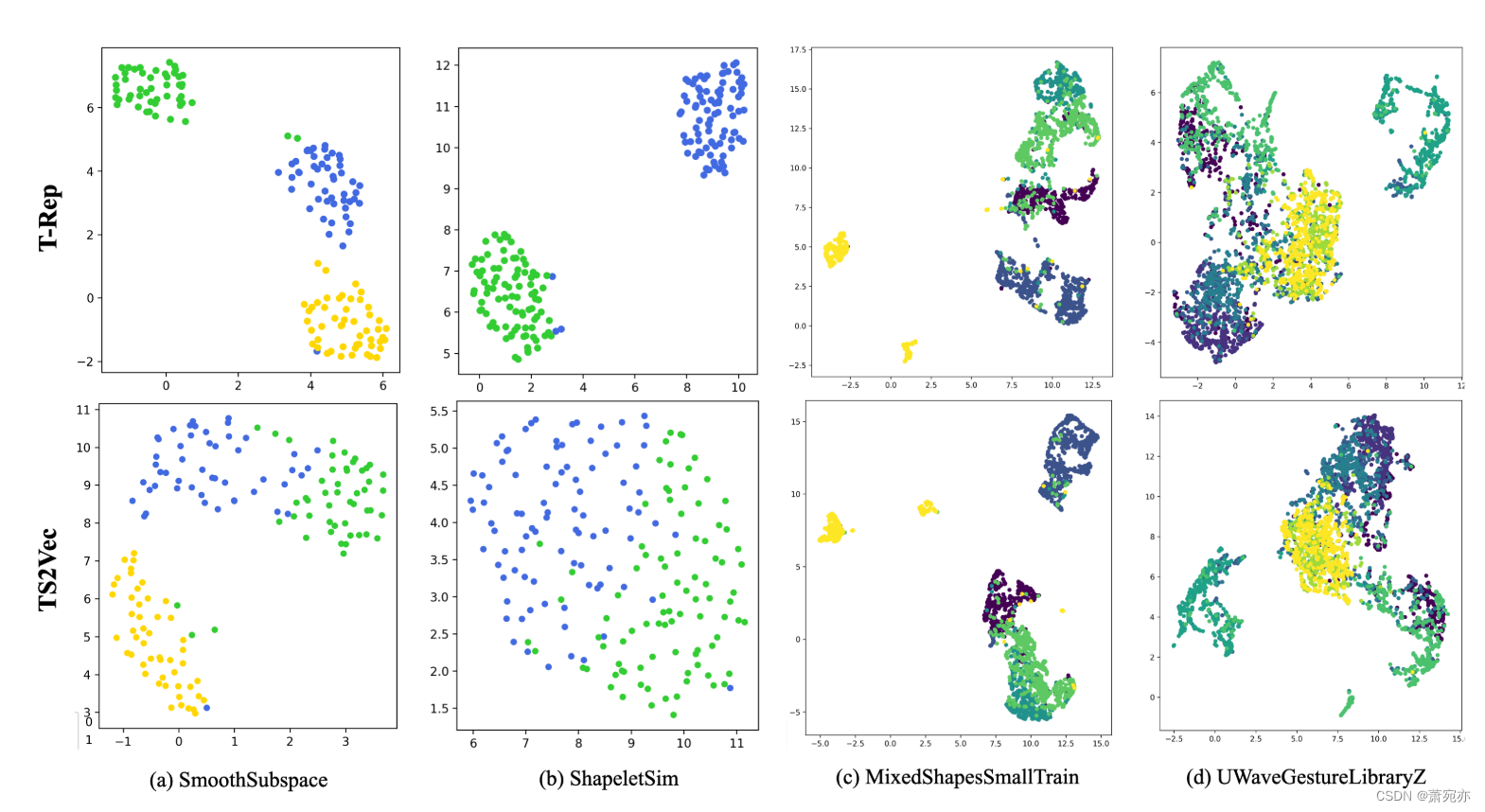

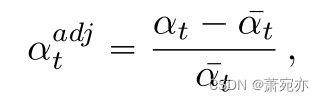

为了研究全局潜在空间结构(实例间),我们查看了T-Rep在五个UCR数据集Dau等人(2019)上学习的表示的UMAP图(McInnes等人,2018)。每个实例用一个点来表示,用它所属的类来着色,以显示潜在空间结构是否区分数据集的不同类。我们包含了TS2Vec学习到的表征,以了解T-Rep的新组件如何影响学习到的潜在空间。结果如图4所示。

查看128个UCR数据集的umap,我们注意到T-Rep和TS2Vec的潜在空间结构通常是相似的,并且/或具有相似的质量。如图4中最右边的两个图所示,这可以用T-Rep侧重于学习时间特征(并使用TS2Vec的任务来学习空间特征)这一事实来解释,从而导致表征随着时间的演变存在更大的差异(参见图3)。

为了专注于学习详细的时间特征,T-Rep对TS2Vec的空间特征借口任务的权重较低。虽然人们可能会直观地认为这会导致较低质量的空间特征,但这不是我们的实验所显示的。事实上,对于所有测试的数据集,我们都没有观察到潜在空间结构的显着下降,这进一步得到了5.2节中提供的分类结果的支持,其中T-Rep以小幅度优于TS2Vec。这些结果表明,在一个实例中学习详细的时间结构是比较不同实例的有用特征。图4最左边的两个图说明了这一点,在这里我们看到T-Rep的集群比TS2Vec的集群更有凝聚力和分离性。这个实验真正突出了t - rep的多功能性,提高了数据集规模(实例间区分)和单个时间序列(时间步粒度)的表示质量。

图4:在5个UCR数据集上学习到的T-Rep和TS2Vec表示的UMAP可视化。每种颜色代表一个不同的类别。TS2Vec结果使用官方代码生成(Zhihan Yue, 2021)。

A.2实验细节

模型的实现是在Python中完成的,使用Pytorch 1.13 (Paszke等人,2019)进行深度学习,使用scikit-learn (Pedregosa等人,2011)进行svm、线性回归、预处理等。我们始终使用Adam优化器(Kingma & Ba, 2014),并在带有Cuda 11.7的单个NVIDIA GeForce RTX 3060 GPU上训练所有模型。

如实验部分所述,没有执行超参数调优。我们使用批量大小为16,学习率为0.001,将所有数据集和任务的最大epoch数设置为200。我们使用10个剩余块用于编码器网络,并将隐藏通道宽度设置为128。将所有卷积层的核大小设置为3。下文A.2.1节详细说明了借口任务的权重。至于时间嵌入的选择,我们使用带有ReLU激活的全连接双层MLP进行分类任务,使用Time2Vec进行预测和异常检测任务(参见附录a .4了解更多信息)。对于所有实验(除非另有说明),每个数据集对模型进行10次训练和测试,以减轻随机性。实验中不使用随机种子。

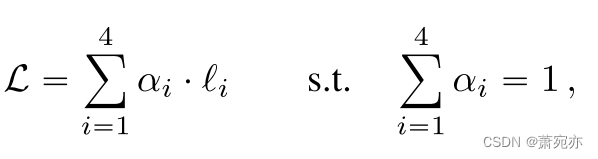

A.2.1 PRETEXT TASK WEIGHTS

如图1所示,传递给分层损失计算框架的损失是托辞任务损失的线性组合:

其中αi表示任务i的权值。选择任务权重可以看作是一个语义问题,也是一个优化问题:提取的特征当然取决于赋予每个任务的权重,但权重的选择也会影响最终损失的优化情况。平衡这两个因素是一个复杂而有趣的研究方向,我们将其留给未来的工作。对于所有借口任务(实例对比,时间对比,时间嵌入散度预测,时间嵌入条件预测),我们使用相同的权重:

α

i

=

0.25

∀

i

∈

[

1

,

4

]

\alpha_i~=~0.25~\forall i\in\left[1,4\right]

αi = 0.25 ∀i∈[1,4]。所有下游任务都是如此,不执行特定于任务的调优。

A.2.2预测

A.2.3 ANOMALY DETECTION

Yahoo

异常检测任务遵循流评估程序(Ren et al., 2019),其中给定时间序列段

{

x

1

,

.

.

.

,

x

t

}

\{x_{1},...,x_{t}\}

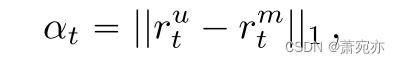

{x1,...,xt},目的是推断最后一点xt是否异常。为了避免漂移,输入数据按照ADF检验得出的根数d进行差分d次(Dickey & Fuller, 1979)。为了公平比较,我们遵循Yue等人(2022)的异常检测程序,该程序为xt计算异常分数αt。αt由表征之间的不相似性给出,其中感兴趣的观察xt已被掩盖与未被掩盖。由于模型是用随机掩蔽训练的,因此即使有掩蔽输入,它也应该输出一个连贯的表示,从而导致较小的αt。然而,如果点xt呈现异常,则掩码表示将与未掩码表示非常不同,因为它预期的是“正常”行为,而不是异常,从而导致αt的高值。更精确地说,αt由:

其中

r

t

u

r_{t}^{u}

rtu是未屏蔽的xt的表示,

r

t

m

r_{t}^{m}

rtm是被屏蔽的观测值的表示。异常评分采用前Z点的平均值进行调整:

其中 α t ˉ = 1 Z ∑ i = t − Z Z α i \bar{\alpha_{t}}=\frac1Z\sum_{i=t-Z}^{Z}\alpha_{i} αtˉ=Z1∑i=t−ZZαi。在推理时,如果调整后的异常分数 α t a d j \alpha_{t}^{adj} αtadj高于一定阈值,则检测到异常:$\alpha_{t}^{adj}>\mu+\beta\cdot\sigma $,其中µ和σ为历史分数的平均值和标准差,β为超参数。如果在异常发生后的7个时间步内检测到异常,则按照Ren等人(2019)介绍的程序认为是正确的。为了减轻训练过程中随机性的影响,每个模型都训练和测试了10次,报告的结果为平均值。

Sepsis

Sepsis的异常检测程序与雅虎不同。我们使用监督方法,因为只有一种类型的异常(败血症)需要检测,所以我们可以对其拟合一个模型,获得比纯无监督方法更高的分数(就像雅虎所做的那样)。对于雅虎这样的数据集,人们无法做到这一点,因为那里有各种各样的异常现象,无法明确分类。尽管以监督的方式解决,但我们认为脓毒症检测仍然是一项异常检测任务,并且与分类不同,因为我们是对单个时间步而不是整个时间序列进行分类,从而评估T-Rep的不同特征。为了表现良好,T-Rep必须产生具有准确实例内结构的表示,其中健康时间步长与异常(败血症)时间步长(以自我监督的方式学习)非常不同。非常低的正样本数量(2.2%)进一步支持了这一点,因此在原始数据上训练分类模型效率不高。由于这些原因,尽管我们在我们的表示之上使用了一个监督模型,但我们认为这个任务是一个异常检测任务。

脓毒症数据集首先通过前向填充所有缺失值和比生理数据粒度更低的特征来预处理,以确保我们在所有时间步都有所有特征的数据。然后将时间序列的长度标准化为45(患者ICU住院时间在原始数据中有所不同),对应于每个患者在ICU的最后45小时。然后,我们根据医学相关性(“HR”、“Temp”、“Resp”、“MAP”、“肌酐”、“胆红素直接”、“葡萄糖”、“乳酸”、“年龄”、“iculs”)选择10个特征。我们发现,与2019年PhysioNet挑战赛中表现最好的选手所做的相比,这是相当“轻”的预处理。这样做是有目的的,以进一步突出模型性能之间的差距。

我们得到了一个数据集

X

∈

R

N

×

45

×

10

\mathbf{X}\in\mathbb{R}^{N\times45\times10}

X∈RN×45×10。我们在这个数据集上训练自监督模型TS2Vec和T-Rep,然后在长度为6的滑动窗口中编码单个时间序列(这个窗口长度看起来像是医学上合理的回顾周期,但我们没有进行参数调优)。因此,我们获得了潜在表征

A.2.4分类

在表示中保持时间维度是有利的,因为与简单地使用一个实例范围的向量相比,它提供了时间序列潜在轨迹的更好快照。这对T-Rep尤其重要,它的创新在于处理时间并将其纳入潜在轨迹。因为保持一定的时间性会增加传递给支持向量机的向量zflat的维数,所以我们使用较小的潜在维数F来补偿。在实践中,我们使用W=10和F=128,但没有执行超参数调优,因此这些可能不是最优参数。与所有其他实验一样,报告的结果是在每个数据集训练和测试每个模型10次后获得的平均值。

有趣的是,对于TS2Vec, TimeDim过程不会导致性能提高,因此使用Franceschi等人(2019)的原始过程(使用实例范围表示)获得的分数如表2所示。总而言之,对于表2中报告的结果(在论文的主体中),T-Rep是唯一使用TimeDim过程的模型。TS2Vec、TNC、T-Loss、TS-TCC均采用Franceschi等人(2019)介绍的程序。表5报告了这两个过程的TS2Vec结果,其中包含了单个数据集的分数,以及汇总指标。

A.3基线的复制细节

TS2Vec: TS2Vec的结果(Yue et al., 2022)已经使用官方代码(在这里找到)进行了复制。TS2Vec使用的超参数与原始论文完全相同(除了批量大小,在我们的复制中设置为16),并且尽可能与T-Rep相同。超参数中唯一值得注意的区别是T-Rep使用稍宽的隐藏通道来适应时间嵌入向量的额外使用。发表在TS2Vec论文中的结果没有用于预测任务,因为我们对实验设置进行了轻微的更改,特别是在预测中删除了协变量的使用。对于异常检测和分类,我们使用了我们自己的复制,因为结果与最初发表的结果略有不同,我们将其归因于以下原因。首先,对我们来说,批量大小从8个变化到16个,原始论文认为这很重要(Yue et al., 2022)。其次,我们引入了一个新的分类过程,因此我们必须在这个新设置中测试TS2Vec。此外,我们对所有模型进行了10次训练和测试,以减轻随机性并获得更稳定的结果,而原始TS2Vec论文的结果并非如此(Yue et al., 2022)。此外,我们没有使用任何随机种子,而TS2Vec代码库Zhihan Yue(2021)显示,使用随机种子进行单次运行就可以产生结果。

Informer:对于ETTh1、ETTh2和ETTm1数据集,我们使用Informer论文(Zhou et al., 2021)中发表的结果。然而,本文不包括ETTm2的结果,因此我们使用官方代码(在这里找到)和默认超参数(在原始论文中也使用)来获得这些结果。

TCN: T-Rep的编码器架构是一个TCN网络(Bai等人,2018),因此我们重用了我们的代码来实现预测TCN模型,仅将训练部分更改为使用有监督的MSE损失。超参数(通道宽度,学习率,优化器)与T-Rep相同。

对于分类任务,TS-TCC (Eldele et al., 2021)、TNC (Tonekaboni et al., 2021)和DTW (M¨uller, 2007)的结果取自TS2Vec论文(Yue et al., 2022),基于他们自己的复制。T-Loss的结果(Franceschi等人,2019)直接取自T-Loss论文(Franceschi等人,2019)。

对于异常检测任务,SPOT、DSPOT (Siffer等人,2017)和SR (Ren等人,2019)的基线结果直接取自TS2Vec论文(Yue等人,2022)。

A.4时间嵌入选择

时间嵌入结构的选择取决于希望提取的时间特征。对于关注捕获周期性和趋势的用户,类似time2vec的模块是理想的(Kazemi et al., 2019)。专注于这些特征有助于它成为异常检测和预测的最佳表现。如果不确定要提取哪些特征,也可以使用全连接MLP,这可能导致可解释性较差,但非常灵活和富有表现力的嵌入。我们发现这是分类任务的最佳时间嵌入。我们还实现了一种基于RBF特征的时间嵌入模型,该模型在异常检测中表现良好。除了Time2Vec的简单案例(Kazemi et al., 2019)之外,人们还不太清楚何时以及为什么不同的时间嵌入比其他时间嵌入表现更好。我们把这个作为未来研究的领域。

A.5上下文一致性

TS2Vec为对比学习引入了一种新的成对抽样方法:上下文一致性。其思想是采样时间序列的两个重叠部分,并鼓励重叠时间步长的表示相似。随机变换应用于每个采样段,导致重叠窗口的不同上下文。理想情况下,编码器应该提取一个窗口的表示,它与周围的上下文是不变的。

上下文一致性方法非常强大,因为它有助于学习不同子序列分布的不变性(在非平稳数据的情况下可能会有所不同),而无需对时间序列分布进行任何潜在假设。这与时间数据的其他SSL方法形成对比,这些方法通常以对噪声、裁剪、翻转等不变性假设的形式呈现归纳偏差(Zhang et al., 2023)。

A.6层次损耗

分层损失框架在不同尺度上应用和求和模型的损失函数,从每个时间步表示开始,并应用maxpool操作来减少尺度之间的时间维度(Yue et al., 2022)。这使用户可以控制用于下游任务的表示的粒度,而不会牺牲性能。它还使模型对缺失数据更具鲁棒性,因为它利用周围表示中的远程信息来重建缺失的时间步长(Yue et al., 2022)。其精确算法如图5所示,摘自Yue et al. (2022):

A.7 uea分类完整结果

表5给出了30个UEA多元时间序列数据集Dau等(2019)分类任务的完整结果。评估的模型是T-Rep,遵循附录A.2.4中详细介绍的TimeDim程序,TS2Vec Yue等人(2022),遵循TimeDim程序和Franceschi等人(2019),T-Loss Franceschi等人(2019),TNC Tonekaboni等人(2021),TS-TCC Eldele等人(2021)和DTW M¨uller(2007)中介绍的原始程序。

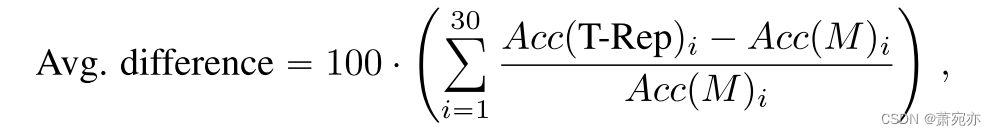

表5:T-Rep等自监督模型在30个UEA数据集上对时间序列的分类准确率

用于评估的指标如下:

•平均精度:测量的测试集精度,在所有数据集上的平均值。

•

Ranks

1

s

t

\textbf{Ranks }1^{st}

Ranks 1st:该指标衡量给定模型在所有比较模型中表现最好的数据集数量。例如,T-Rep在30个数据集中的10个上是表现最好的模型。

•**

Avg. Acc. Difference:

\text{Avg. Acc. Difference:}

Avg. Acc. Difference:**异:衡量T-Rep和给定模型M之间的相对差异,在所有30个数据集上取平均值。计算公式为:

其中

A

c

c

(

M

)

i

\begin{aligned}Acc(M)_i\end{aligned}

Acc(M)i是模型M在数据集i上的精度。

•

Avg. Rank:

\text{Avg. Rank:}

Avg. Rank::对于每个数据集,我们基于准确性计算模型与其他模型的排名。然后报告所有30个数据集的平均排名。

A.8预测全部结果

表6给出了Zhou et al.(2021)在4个ETT数据集上预测任务的完整结果。我们将T-Rep与TS2Vec (Yue等人,2022),时间序列的SOTA自监督模型,以及Informer (Zhou等人,2021),时间序列预测中的SOTA以及TCN (Bai等人,2018)进行比较,后者是一种更简单的模型,与T-Rep具有相同的主干架构,但使用有监督的MSE损失进行训练。

表6:四个ETT数据集的多变量时间序列预测结果。“排名第一”指标衡量给定模型在所有比较模型中是最好的情况的数量。

A.9时间序列异常检测完整结果

表7:Yahoo Webscope数据集上的时间序列异常检测结果。异常包括异常值和变点。TS2Vec结果使用官方源代码(Zhihan Yue, 2021)进行复制,而所有其他基线结果均直接取自Yue等人(2022)。

表8:脓毒症数据集Reyna et al. (2020b)基于时间序列分段的异常检测结果。TS2Vec结果使用官方源代码(Zhihan Yue, 2021)进行复制。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?