2.1信息论概述

2.2信息的测度:离散熵

2.2.1离散熵

对随机变量X不确定性,随机性的度量

描述随机变量的平均不确定性

无量纲

信息量:获得的信息的数量熵的差值

熵只与随机变量的总体结构有关,它表征随机变量的总体的平均不确定性

2.2.2联合熵与条件熵

观测Y以后,仍保留的关于X的不确定量

X,Y独立时

一般情况下

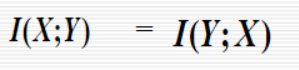

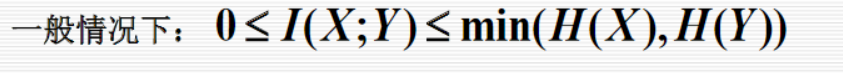

2.3信息的测度:互信息

I(X;Y)是随机变量X的概率矢量p和条件概率矩阵Q的函数

互信息的函数性质

- I(p;Q)是p(x)的上凸函数——p(x)可以看成信道输入的概率分布

- I(p;Q)是Q的下凸函数——Q可以看成信道转移概率分布

- 若概率是两p是离散无记忆的

- 若条件概率矩阵Q是离散无记忆的

- 若概率矢量p和条件概率矩阵都是离散无记忆的

2.4信息的测度:微分熵

微分熵可以作为连续随机变量不确定程度的相对度量

高斯分布

h c ( U ) = 1 2 l o g 2 π e σ 2 h_c(U)=\frac{1}{2}log2{\pi}e{\sigma}^2 hc(U)=21log2πeσ2

连续随机变量的联合熵与条件熵

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?