JSON格式的数据保存为CSV文件

如何保存?

我们知道JSON格式的数据大概长这样:

[{key1:value1, key2:value2, key2:value3},{key1:value1, ...},{key1:value1, ...},...]

csv文件保存的函数为f.writerow(),该函数需要的参数为一个列表,这个列表中的数据就是JSON格式中一个map的所有的value,然后每个map转化为一个列表,大概每个列表长这样。

# 单个列表

[value1, value2, value3]

然后为了方便,我们将所有的这样的列表都嵌套到一个列表中,这样保存的时候直接遍历这个列表保存。

# 多个列表

[[value1, value2, value3],

[value1, value2, value3],

[value1, value2, value3]]

一、首先我们需要创建一个JSON格式的数据

Code 1:

# pprint是一个可以格式化输出JSON格式的数据的文件,这样方便我们看出数据的格式

import pprint

# 初始化一个列表用于存放数据

json_list = []

for i in range(10):

# 将每个map都放入列表中

json_list.append({'name': 'name' + str(i), 'age': str(i), 'phone_num': i})

# 格式化打印输出

pprint.pprint(json_list)

Out 1:

# 可以看出列表中存放了10个字典,每个字典的格式相同。

# 符合上面的JSON格式

[{1: 'name0', 'age': '0', 'phone_num': 0},

{1: 'name1', 'age': '1', 'phone_num': 1},

{1: 'name2', 'age': '2', 'phone_num': 2},

{1: 'name3', 'age': '3', 'phone_num': 3},

{1: 'name4', 'age': '4', 'phone_num': 4},

{1: 'name5', 'age': '5', 'phone_num': 5},

{1: 'name6', 'age': '6', 'phone_num': 6},

{1: 'name7', 'age': '7', 'phone_num': 7},

{1: 'name8', 'age': '8', 'phone_num': 8},

{1: 'name9', 'age': '9', 'phone_num': 9}]

二、获取map的keys 并将数据转换为嵌套列表

为了方便保存的时候方便进行索引,于是先获取json内map的key值。

Code 2:

# map.keys()函数可以获得一个map的所有key值,并放回一个列表,但是需要list类型转换

keys = list(json_list[0].keys())

# 这里输出类型转换前的类型和样子 供参考

print(json_list[0].keys(), type(json_list[0].keys()))

print(keys, type(keys))

可以看出 类型转换前和转换后的类型是不同的

Out 2:

dict_keys(['name', 'age', 'phone_num']) <class 'dict_keys'>

['name', 'age', 'phone_num'] <class 'list'>

将数据转换为嵌套列表

Code 3:

list_json_data = []

for i in range(10):

list_json_data.append([json_list[i][x] for x in keys])

# 上面一行的代码等于 :

# 1、

# list_json_data.append([json_list[i][keys[0]], json_list[i][keys[1]], json_list[i][keys[2]]])

# 2、

# tmpList = []

# for x in keys:

# tmpList.append(json_list[i][x])

# list_json_data.append(tmpList)

print(list_json_data)

Out 3:

[['name0', '0', 0], ['name1', '1', 1], ['name2', '2', 2], ['name3', '3', 3], ['name4', '4', 4], ['name5', '5', 5], ['name6', '6', 6], ['name7', '7', 7], ['name8', '8', 8], ['name9', '9', 9]]

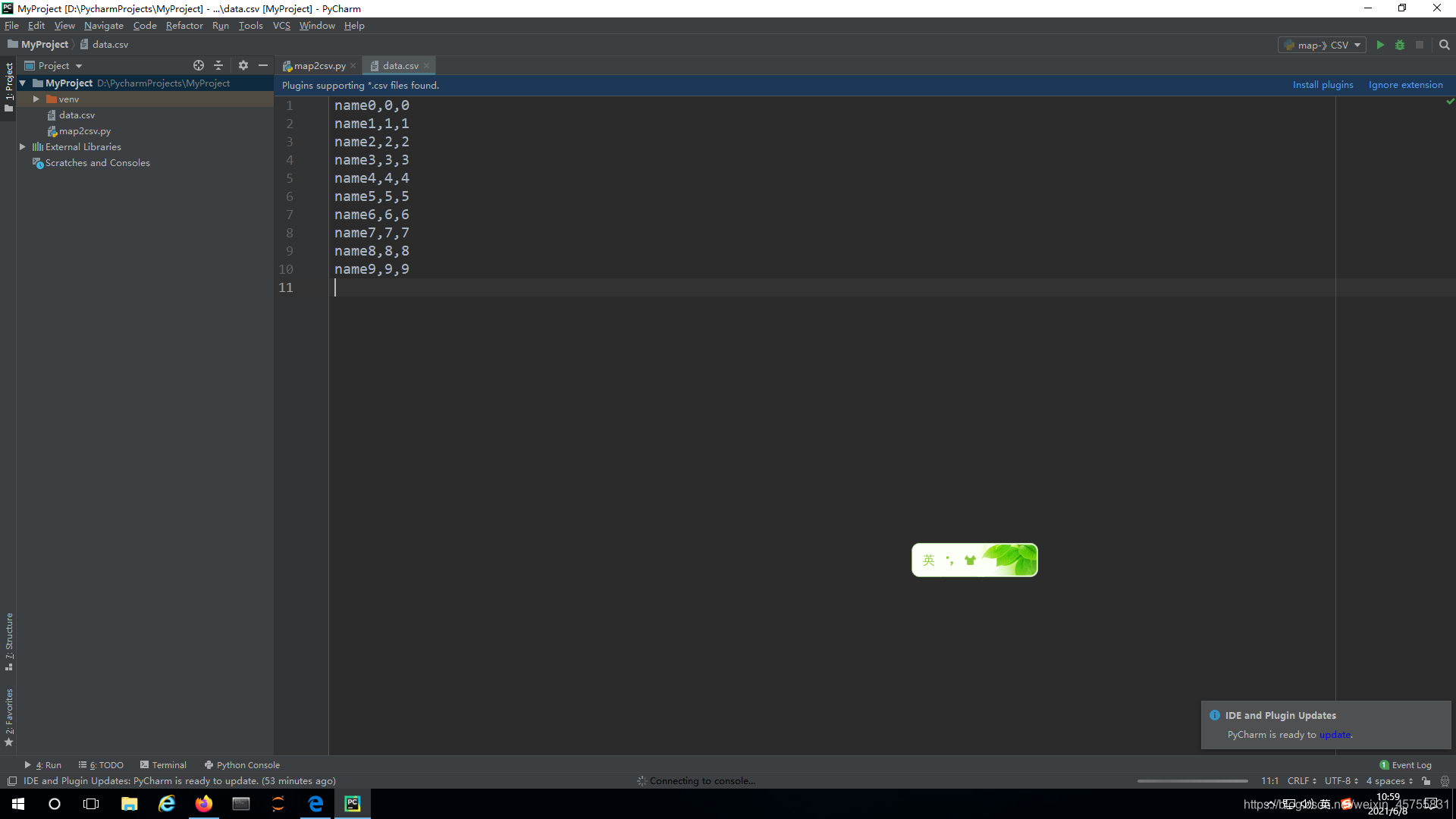

三、保存为CSV文件

这里打开一个data.csv文件,由于是使用了’w’(write),如果是读请使用’r’(read),如果是需要一直添加请使用’a’(add),因此不用担心会报没有该文件的错,它会自动生成,这里的编码格式选择了utf-8-sig,也可以写utf-8,但是有时候会出现乱码问题,这里的newline=’'是为了防止出现空行的出现。

Code 4:

with open('data.csv','w',encoding='utf-8-sig',newline='') as f:

# 初始化 csv writer 对象

f = csv.writer(f)

# 遍历json数据列表并保存每个列表

for list_data in list_json_data:

f.writerow(list_data)

保存成功!

四、完整代码 json2csv

import csv

import pprint

''' json format

[{key:value, key:value, key:value},{key:value, ...},{key:value, ...},...]

'''

json_list = []

for i in range(10):

json_list.append({'name': 'name' + str(i), 'age': str(i), 'phone_num': i})

pprint.pprint(json_list)

keys = list(json_list[0].keys())

print(json_list[0].keys(), type(json_list[0].keys()))

print(keys, type(keys))

list_json_data = []

for i in range(10):

# [json_list[i][x] for x in keys]

list_json_data.append([json_list[i][x] for x in keys])

# tmpList = []

# for x in keys:

# tmpList.append(json_list[i][x])

# list_json_data.append(tmpList)

# list_json_data.append([json_list[i][keys[0]], json_list[i][keys[1]], json_list[i][keys[2]]])

print(list_json_data)

with open('data.csv','w',encoding='utf-8',newline='') as f:

f = csv.writer(f)

for list_data in list_json_data:

f.writerow(list_data)

CSV文件读取为JSON格式的数据

既然我们知道如何从JSON到CSV了,那么CSV到JSON就是倒过来做一遍喽~

一、读取数据

Code 5:

import csv

with open('data.csv','r',encoding='utf-8') as f:

# 这里将csv.reader()迭代器强制转换为list格式

list_data = list(csv.reader(f))

print(csv.reader(f))

print(list_data)

虽然 格式看不太懂 但是是可遍历的数据类型

Out 4:

<_csv.reader object at 0x0000027BE0426C40>

[['name0', '0', '0'], ['name1', '1', '1'], ['name2', '2', '2'], ['name3', '3', '3'], ['name4', '4', '4'], ['name5', '5', '5'], ['name6', '6', '6'], ['name7', '7', '7'], ['name8', '8', '8'], ['name9', '9', '9']]

将数据存入JSON

Code 6:

# 初始化 keys 列表

keys = ['name', 'age', 'phone_num']

# 初始化JSON列表

json_data = []

# 遍历嵌套列表数据

for data in list_data:

#将每个keys和嵌套列表中的列表结合为key和value

json_data.append({keys[x]: data[x] for x in range(3)})

# 等同于:

# tmpMap = {}

# for x in range(3):

# tmpMap[keys[x]] = data[x]

# json_data.append(tmpMap)

pprint.pprint(json_data)

可以看看是不是和之前一样 嘿嘿嘿

Out 5:

[{'age': '0', 'name': 'name0', 'phone_num': '0'},

{'age': '1', 'name': 'name1', 'phone_num': '1'},

{'age': '2', 'name': 'name2', 'phone_num': '2'},

{'age': '3', 'name': 'name3', 'phone_num': '3'},

{'age': '4', 'name': 'name4', 'phone_num': '4'},

{'age': '5', 'name': 'name5', 'phone_num': '5'},

{'age': '6', 'name': 'name6', 'phone_num': '6'},

{'age': '7', 'name': 'name7', 'phone_num': '7'},

{'age': '8', 'name': 'name8', 'phone_num': '8'},

{'age': '9', 'name': 'name9', 'phone_num': '9'}]

完整代码 csv2json

import csv

import pprint

with open('data.csv', 'r', encoding='utf-8') as f:

# 这里将csv.reader()迭代器强制转换为list格式

print(csv.reader(f))

list_data = list(csv.reader(f))

print(list_data)

keys = ['name', 'age', 'phone_num']

json_data = []

for data in list_data:

json_data.append({keys[x]: data[x] for x in range(3)})

# tmpMap = {}

# for x in range(3):

# tmpMap[keys[x]] = data[x]

# json_data.append(tmpMap)

pprint.pprint(json_data)

508

508

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?